Clear Sky Science · nl

Evaluatie van AI-gestuurde leerassistenten in technische hoger onderwijsprogramma’s met implicaties voor betrokkenheid van studenten, ethiek en beleid

Waarom dit belangrijk is voor de huidige studenten

Studenten wenden zich tot chatbots en andere kunstmatige-intelligentiehulpmiddelen voor hulp bij huiswerk, programmeren en lastige lesstof. Maar kunnen deze tools echt het leren ondersteunen, en wat gebeurt er met kwesties als spieken, eerlijkheid en vertrouwen wanneer software een studiepartner wordt? Dit artikel volgt een praktijktest in civiele techniek- en milieutechniekvakken waarin een AI-gestuurde “Educational AI Hub” werd uitgeprobeerd en waarin studenten werd gevraagd wat werkte, wat hen zorgen baarde en hoe zij vinden dat AI in de toekomst van het hoger onderwijs zou moeten passen.

Één digitale studiegenoot, veel ingebouwde hulpmiddelen

De Educational AI Hub is een cursus-specifieke leerassistent die binnen het online leerplatform van de universiteit draait. In plaats van vragen naar een algemene chatbot te sturen die op het hele internet is getraind, communiceren studenten met een assistent die nauw verbonden is met hun colleges, opdrachten en syllabus. Achter de schermen leest het systeem door de door docenten goedgekeurde cursus-PDF’s, splitst die in doorzoekbare fragmenten en voert alleen die fragmenten in een geavanceerd taalmodel om studentvragen te beantwoorden. De Hub biedt zes hoofdtools: korte door AI gegenereerde aantekeningen, een vraag-en-antwoord-chatbot, flashcards, automatisch nagekeken quizzes, een codeerhulp-"sandbox" en snelle antwoorden op syllabuslogistiek. Het is ontworpen om te functioneren als een toegankelijke, altijd-beschikbare onderwijsassistent in plaats van als een snelkoppelingmotor.

Hoe de studie werd uitgevoerd

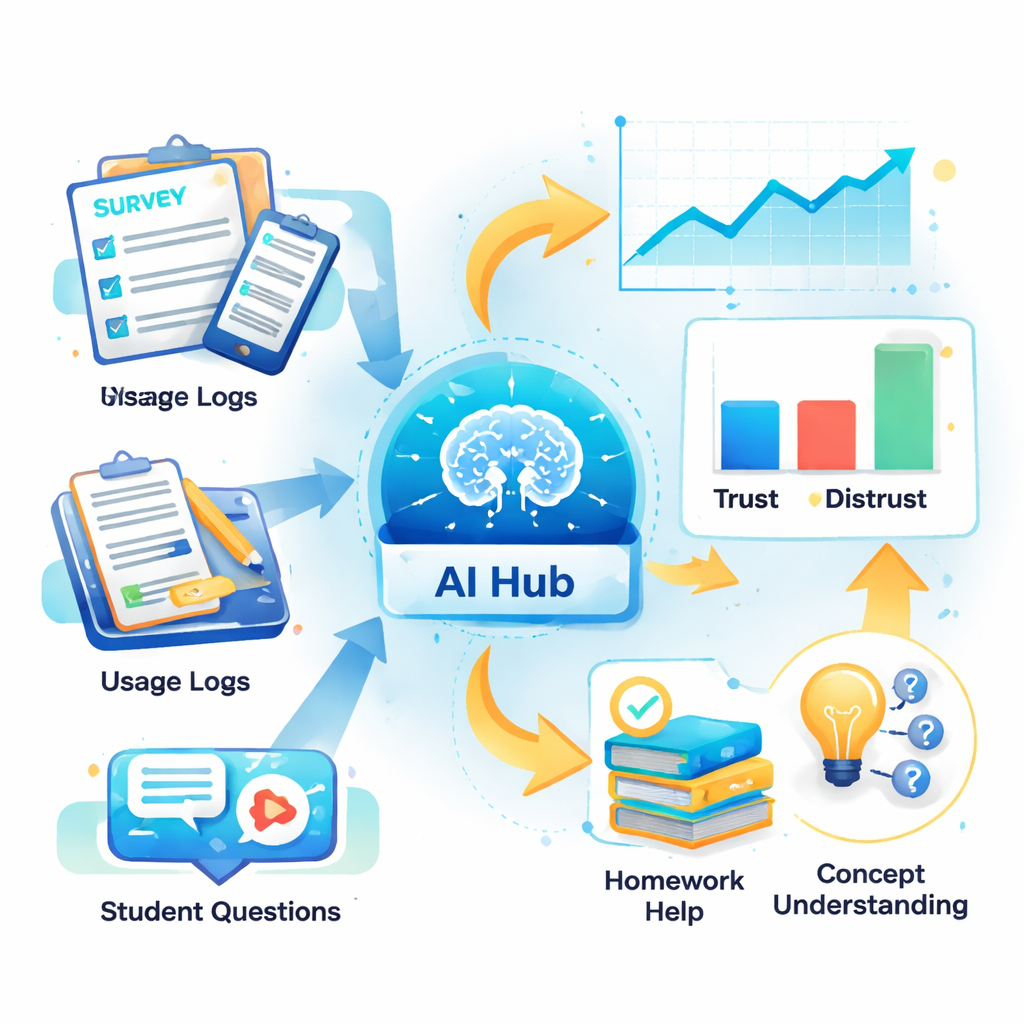

Om te zien hoe studenten de assistent daadwerkelijk gebruikten, implementeerden de onderzoekers deze in twee bachelorvakken technische opleidingen aan een grote openbare onderzoeksuniversiteit. Vijfenzestig van de 77 ingeschreven studenten boden vrijwillig mee te doen. Ze vulden vragenlijsten in aan het begin en het einde van het semester over hun ervaring met AI, hun vertrouwen in dergelijke tools en hun zorgen over ethiek en academische integriteit. Tegelijkertijd logde het systeem onopvallend elke interactie: welke functies studenten gebruikten, hoe vaak ze terugkwamen en wat voor soort vragen ze stelden. Het team codeerde ook honderden studentvragen in thema’s zoals “softwarehulp”, “theorievragen” en “opdrachtverduidelijking” om te begrijpen welke hulp studenten echt zochten.

Wat studenten waardeerden — en wat ze niet volledig vertrouwden

De populairste functie veruit was de chatbot, die meer dan 90 procent van alle interacties uitmaakte. Studenten gebruikten die veel om vastgelopen technologische taken in tools zoals ArcGIS en MATLAB te ontgrendelen en om kernbegrippen en formules uit de techniek te verduidelijken. Velen gaven aan dat de assistent het makkelijker maakte om cursusmateriaal te begrijpen en huiswerk af te ronden, en sommigen zeiden dat ze zich comfortabeler voelden om vragen aan de AI te stellen dan aan docenten of assistenten. Toch zagen de meeste studenten menselijke hulp nog steeds als gelijkwaardig of beter van kwaliteit. Zorgen over onjuiste of misleidende antwoorden van AI — soms aangeduid als "hallucinaties" — zorgden ervoor dat veel gebruikers de assistent als een handige eerste stap zagen in plaats van als een definitieve autoriteit.

Ethische grijze gebieden en beleidsverwarring

Zelfs wanneer studenten de tool waardeerden, voelden ze zich onzeker over de regels rond het gebruik ervan. Velen wisten niet precies wat werd beschouwd als academisch wangedrag bij werken met AI en vreesden ten onrechte van fraude te worden beschuldigd. Bijna de helft dacht dat AI niet automatisch de academische integriteit ondermijnt, maar een vergelijkbaar aandeel voelde zich terughoudend om het bij beoordeeld werk te gebruiken. Belangrijk is dat studenten geen verbod op AI wilden; in plaats daarvan pleitten ze voor "enigszins beperkende" cursusregels met duidelijke richtlijnen. De meesten waren het erover eens dat het gebruiken van AI als academische hulp ethisch kan zijn en gaven aan soortgelijke tools in andere vakken te willen zien, zolang de verwachtingen in heldere taal worden uitgelegd en gekoppeld aan verantwoordelijkheidsgedragingen zoals bronnen controleren en vermelden van hulp.

Van data naar beter onderwijs en leren

Gebruikslogboeken en vragenlijstantwoorden vertelden een consistent verhaal: studenten gebruikten de AI Hub het meest wanneer ze het vertrouwden, zich er prettig bij voelden en het als werkelijk nuttig voor cursustaken zagen, zoals conceptherziening en huiswerk. Minder vertrouwen in AI ging samen met minder gebruik, terwijl comfort en ervaren nut gekoppeld waren aan frequentere betrokkenheid. Toch schreven studenten de tool niet alleen de verbeterde cijfers toe, en velen bleven algemene chatbots gebruiken voor programmeren of wiskunde die buiten het cursusmateriaal vielen. Deze patronen suggereren dat AI-assistenten het beste werken als een gerichte ondersteuningslaag binnen een cursus — niet als vervanging van docenten en niet als een allesomvattende oplossing.

Wat dit betekent voor het klaslokaal van de toekomst

De kernboodschap voor een breed publiek is dat AI-studiehulpjes technische vakken toegankelijker kunnen maken en studenten een laagdrempelige manier bieden om op elk moment vragen te stellen, maar dat ze leren niet als bij toverslag los oplossen. In deze studie zagen technische studenten de Educational AI Hub als een handige metgezel die problemen kon oplossen en lastige ideeën kon uitleggen, terwijl ze nog steeds op docenten en traditionele studiegewoonten vertrouwden. Hun grootste zorgen gingen niet zozeer over de technologie zelf, maar over onduidelijke regels en de angst voor beschuldigingen van fraude. De auteurs betogen dat als universiteiten AI echt willen inzetten om onderwijs te verbeteren, ze slimme, cursusbewuste tools moeten combineren met duidelijke, transparante beleidsregels en actieve begeleiding door docenten, zodat studenten niet alleen van AI leren, maar ook hoe ze het verantwoordelijk kunnen gebruiken.

Bronvermelding: Sajja, R., Sermet, Y., Fodale, B. et al. Evaluating AI-powered learning assistants in engineering higher education with implications for student engagement, ethics, and policy. Sci Rep 16, 7565 (2026). https://doi.org/10.1038/s41598-026-39237-5

Trefwoorden: AI in het onderwijs, technische studenten, leerassistent, academische integriteit, studentbetrokkenheid