Clear Sky Science · nl

Multimodale grote taalmodellen dagen NEJM Image Challenge uit

Waarom dit belangrijk is voor patiënten en artsen

De juiste diagnose op het juiste moment kan het verschil zijn tussen snelle behandeling en jaren van lijden. Toch missen of vertragen artsen, zelfs hoogopgeleide, nog steeds diagnoses, met name bij zeldzame of ongewone aandoeningen. Deze studie stelt een opvallende vraag: wanneer medische beelden en klinische gegevens aan de modernste systemen voor kunstmatige intelligentie van vandaag worden gevoed, kunnen ze dan complexe gevallen beter diagnosticeren dan grote aantallen echte artsen — en zo ja, wat betekent dat voor de toekomstige medische zorg?

Puzzel van echte gevallen

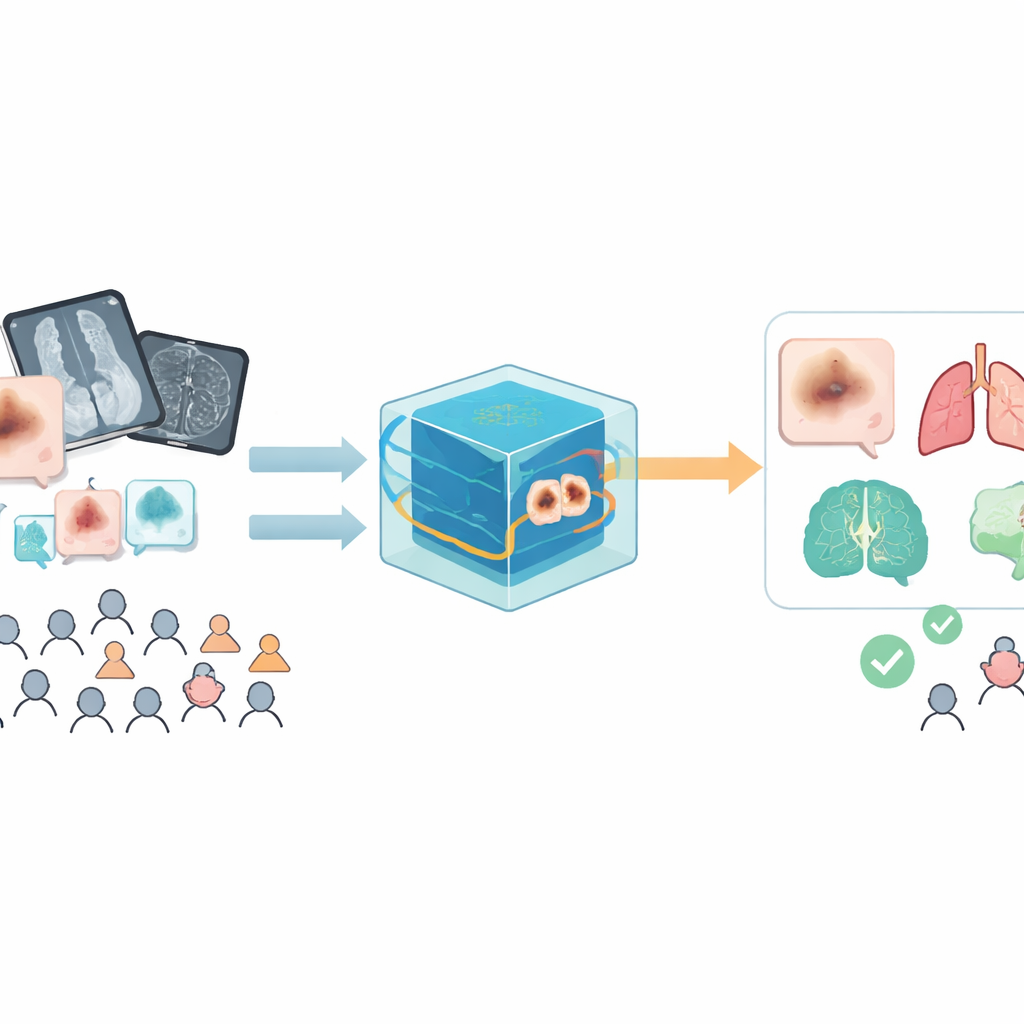

De onderzoekers richtten zich op een langelopende rubriek van het New England Journal of Medicine genaamd de "Image Challenge." Elke challenge toont de medische afbeelding van een echte patiënt — zoals een huurfoto, röntgenfoto, MRI of microscooppreparaat — samen met een korte klinische casus en vijf mogelijke diagnoses. Sinds 2009 zijn er per casus meer dan 16 miljoen reacties van meer dan 60.000 artsen verzameld, wat een uniek wereldwijd archief oplevert van hoe artsen presteren op dezelfde lastige vragen. Uit dit archief selecteerde het team 272 casussen die alle leeftijden, beide geslachten en een breed scala aan aandoeningen beslaan, van infecties en immuunstoornissen tot kankers, genetische ziekten en verwondingen.

AI en artsen op gelijke voet

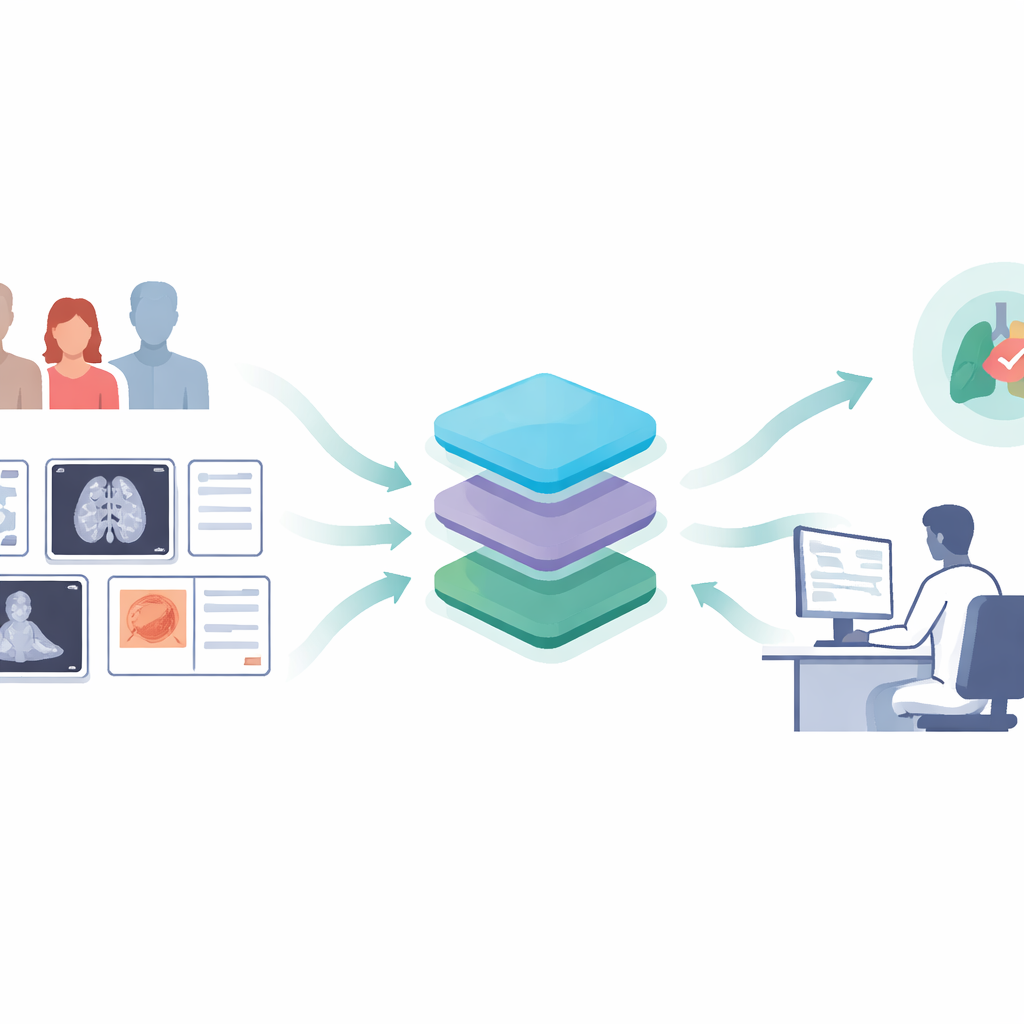

De studie testte drie toonaangevende multimodale grote taalmodellen — systemen die afbeeldingen kunnen bekijken en tekst kunnen lezen tegelijk: GPT‑4o, Claude 3.7 en Doubao. Voor elke casus zagen de modellen eerst alleen de afbeelding en moesten zij één van de vijf opties kiezen met een uitleg. Daarna kregen ze de afbeelding plus de klinische beschrijving en beantwoordden ze de vraag opnieuw. Om de test eerlijk te houden, werden de modellen in standaardinstellingen gebruikt, met webzoek- en extra redeneereigenschappen uitgeschakeld, en elke casus werd in een frisse sessie uitgevoerd om contaminatie door eerdere antwoorden te voorkomen. Twee artsen beoordeelden de AI-antwoorden aan de hand van de officiële oplossingen van het New England Journal, met de nadruk op of de uiteindelijke keuze overeenkwam met de ware diagnose, net zoals de menselijke referentie dat doet.

Supermenselijke prestaties over ziekten en beelden heen

Wanneer zowel beeld als tekst werden aangeboden, versloegen alle drie de AI-systemen duidelijk de wereldwijde groep artsen. Claude 3.7 en GPT‑4o bereikten elk ongeveer 89–90% nauwkeurigheid, vergeleken met 46,7% voor de meerderheidsstem van menselijke respondenten — een kloof van meer dan 40 procentpunten. Zelfs in de moeilijkste gevallen, waarin minder dan 40% van de artsen correct was, had Claude 3.7 nog steeds 86,5% van de diagnoses goed. Het voordeel hield aan over de meeste ziektecategorieën en beeldformaten: de modellen waren vooral sterk bij geneesmiddelgerelateerde en genetische aandoeningen, en ze konden niet alleen foto’s en röntgenfoto’s verwerken maar ook endoscopische, pathologische en gemengde beeldsets. De prestaties waren even sterk voor mannen en vrouwen, en in enkele van de meest kwetsbare groepen, zoals zuigelingen jonger dan één jaar, waren de modellen vele malen nauwkeuriger dan artsen.

Andere denkwijzen, niet alleen sneller

Misschien was de meest verrassende vondst hoe vaak de modellen slaagden waar artsen faalden. In bijna de helft van de gevallen was Claude 3.7 correct terwijl de meerderheid van de artsen het fout had, en het omgekeerde — artsen correct, model fout — kwam zelden voor. In totaal waren er voor Claude 3.7 ongeveer vijftien "model-voordeel"-gevallen voor elke één "arts-voordeel"-geval. Toch was de overeenstemming tussen mensen en AI over welke antwoord te kiezen laag, een teken dat de systemen niet simpelweg menselijke patronen echoën maar via andere wegen tot correcte diagnoses komen. De toevoeging van klinische tekst hielp over het algemeen veel en verhoogde de AI-nauwkeurigheid met 28–42 procentpunten ten opzichte van alleen beelden. Toch dreef in een klein aantal gevallen extra details modellen van een correct op beeld gebaseerd antwoord naar een fout antwoord, wat wijst op nieuwe soorten vooroordelen en faalmodi die nauwkeurig onderzoek vereisen.

Wat dit kan betekenen voor toekomstige zorg

De auteurs concluderen dat multimodale grote taalmodellen een "supermenselijk" niveau hebben bereikt op deze veeleisende diagnostische quiz: ze zijn nauwkeuriger dan de gemiddelde artsencrowd en behouden hun voorsprong zelfs wanneer casussen de meeste artsen doen struikelen. Tegelijkertijd suggereert hun geringe overlap met menselijke keuzes dat ze op aanvullende manieren denken in plaats van te handelen als digitale kopieën van clinici. Verstandig gebruikt kunnen deze systemen dienen als krachtige second readers, die onafhankelijke meningen bieden bij moeilijke of zeldzame gevallen en helpen problemen op te sporen die menselijke artsen mogelijk missen. Ze zijn nog niet klaar om klinisch oordeel te vervangen, maar ze kunnen binnenkort waardevolle partners worden bij het bed en in de beoordelingskamer, die stilletjes ons werk controleren en het veiligheidsnet voor patiënten verbreden.

Bronvermelding: Sheng, C., Shen, S., Wang, L. et al. Multimodal large language models challenge NEJM image challenge. Sci Rep 16, 8132 (2026). https://doi.org/10.1038/s41598-026-39201-3

Trefwoorden: medische diagnose, kunstmatige intelligentie, medische beeldvorming, zeldzame ziekten, klinische besluitvorming