Clear Sky Science · nl

RFGLNet voor domeingegeneraliseerde semantische segmentatie bij slecht weer met frequentie low-rank-versterking

De weg zien wanneer het weer omslaat

Autonome auto’s en bezorgrobots beloven veiligere, efficiëntere straten—maar alleen als ze betrouwbaar de wereld om hen heen kunnen “zien”. Regen, mist, sneeuw en donkere nachten maken dat zicht extreem lastig: contrast vervaagt, er verschijnt ruis en de randen van mensen, auto’s en stoepranden worden vaag. Dit artikel introduceert RFGLNet, een nieuw computerzichtsysteem dat is ontworpen om de weergave van de weg scherp te houden, zelfs als het weer het slechtst is.

Waarom slecht weer machines verblindt

De huidige zelfrijdende systemen vertrouwen vaak op semantische segmentatie, waarbij een algoritme aan elke pixel in een afbeelding een klasse toewijst—zoals weg, auto, voetganger of gebouw. Bij helder daglicht doen moderne neurale netwerken dit opmerkelijk goed. Bij hevige regen of dichte mist verliezen afbeeldingen echter helderheid, krijgen ze ruis en ontstaan er vage grenzen tussen objecten. Het verzamelen en labelen van enorme datasets voor elke nare weersomstandigheid is onbetaalbaar, dus de meeste systemen worden voornamelijk getraind op normale, zonnige beelden. Wanneer ze geconfronteerd worden met onvoorziene stormen of sneeuw, daalt de prestatie scherp. Eerdere oplossingen probeerden beelden eerst schoon te maken en daarna te segmenteren, of modellen aan te passen aan specifieke doelomstandigheden. Beide benaderingen blijken vaak broos, traag of te afhankelijk van gelabelde beelden bij slecht weer.

Een nieuw netwerk gebouwd voor zware omstandigheden

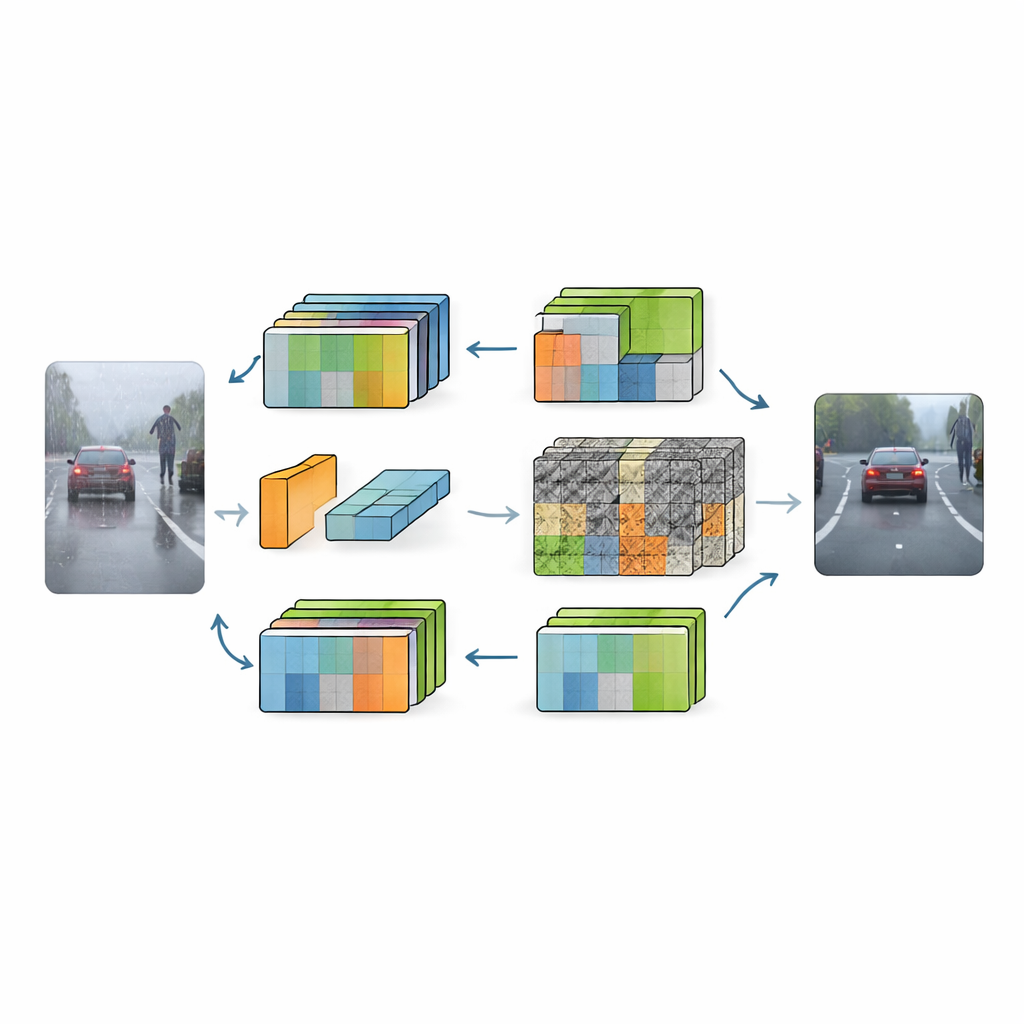

RFGLNet pakt dit probleem aan met een andere strategie: het leert uitsluitend van standaard stedelijke scènes overdag, maar generaliseert naar een breed scala aan zware omstandigheden. De auteurs beginnen bij DINOv2, een groot, voor-getraind visueel model dat bekendstaat om het vastleggen van rijke scènestructuur. In plaats van deze zware backbone vanaf nul opnieuw te trainen, bevriezen ze de parameters en voegen ze er een lichte set modules aan toe. Deze modules werken als slimme adapters die de interne representaties van de backbone herschikken zodat ze minder verward raken door visuele rommel van sneeuwvlokken, regendruppels of duisternis. Het resultaat is een systeem met slechts 4,32 miljoen trainbare parameters—klein vergeleken met typische visiemodellen—terwijl het toch leert omgaan met weercondities die het nooit tijdens training heeft gezien.

Hoe het netwerk leert het weer te filteren

De eerste innovatie van RFGLNet is een low-rank-module die in elke laag van de bevroren backbone wordt ingebracht. Voor de training voert deze module een wiskundige procedure uit die bekendstaat als singuliere-waarde-decompositie op een gesimuleerde feature-matrix. Dat levert een set compacte componenten die ruwweg overeenkomen met de structuur van DINOv2’s interne features vanaf het begin, in plaats van te beginnen vanuit willekeurige ruis. Tijdens training worden deze componenten bijgesteld, waardoor de module de features voorzichtig kan corrigeren voor de nieuwe taak zonder de kernkennis te verstoren. Het netwerk past vervolgens een op Fourier gebaseerde attentieblok toe dat de features naar het frequentiedomein verschuift. Daar representeren brede, langzaam variërende structuren vaak betekenisvolle objecten, terwijl scherpe, grillige patronen vaak overeenkomen met weergerelateerde ruis. Door hoge-frequentie rommel te onderdrukken en gladdere componenten te versterken, versterkt het systeem het globale scènesbegrip terwijl interferentie wordt verminderd.

Details verscherpen zonder afgeleid te raken

Zelfs met schonere globale features blijven kleine details zoals wegbelijning, hekrails en de omtrek van een verre voetganger kwetsbaar voor vervaging bij slecht weer. Om dit aan te pakken introduceren de auteurs een gegroepeerde ruimtelijke attentiemodule in het decoder-gedeelte van het netwerk. In plaats van alle feature-kanalen samen te behandelen, verdeelt deze module ze in groepen en leert voor elke groep afzonderlijke ruimtelijke wegingskaarten. Kanalen die belangrijke structuren dragen, zoals randen, kunnen dan worden benadrukt, terwijl kanalen die gedomineerd worden door ruis worden gedempt. Deze groepsspecifieke kaarten worden samengevoegd tot een globale ruimtelijke weging die fijne details verbetert en objectranden verscherpt over meerdere resoluties. In feite leert RFGLNet waar het nauwkeurig moet kijken en waar het afleidende nevel- of regenvlekjes kan negeren.

Praktisch rendement op uitdagende wegscènes

Om hun aanpak te testen, trainden de onderzoekers RFGLNet op de bekende Cityscapes-dataset van heldere stedelijke scènes overdag en evalueerden het vervolgens op de ACDC-dataset, die zich richt op rijden bij regen, sneeuw, mist en ’s nachts. Zonder ooit ACDC-labels tijdens training te zien, bereikte RFGLNet een mean intersection over union van 78,3 procent—en overtrof daarmee verschillende toonaangevende methoden voor domeingeneralisatie en adaptatie, waarvan veel groter en rekenkundig zwaarder zijn. Het presteerde vooral sterk bij het segmenteren van moeilijke klassen zoals muren en hekken, waarvan de randen gemakkelijk verloren gaan bij slecht weer. Tegelijkertijd draaide het model efficiënt op een enkele consumenten-gpu en verwerkte het tientallen beelden per seconde, een sleutelvereiste voor realtime rijsystemen.

Schoner zicht voor veiligere autonomie

Voor niet-specialisten is de conclusie dat RFGLNet laat zien hoe bestaande visuele backbones kunnen worden geüpgraded voor veiligere autonomie zonder eindeloos opnieuw trainen voor elke mogelijke storm. Door compacte low-rank-tuning, frequentie-gebaseerde ruisfiltering en gegroepeerde ruimtelijke attentie te combineren, leert het systeem essentiële scènestructuur intact te houden terwijl weergerelateerde rommel wordt weggestreken. Naarmate dergelijke methoden volwassen worden en op bredere verzamelingen van reële omstandigheden worden getraind, zouden ze zelfrijdende auto’s en robots kunnen helpen betrouwbare situationele waarneming te behouden wanneer de hemel donker wordt en de weg vooruit allesbehalve helder is.

Bronvermelding: Ye, X., Shi, X. & Li, Y. RFGLNet for adverse weather domain-generalized semantic segmentation with frequency low-rank enhancement. Sci Rep 16, 8253 (2026). https://doi.org/10.1038/s41598-026-39052-y

Trefwoorden: autonoom rijden, waarneming bij slecht weer, semantische segmentatie, robuustheid van computerbeeldspraak, domeingeneralisatie