Clear Sky Science · nl

Aandachtsgebaseerde werklastvoorspelling en dynamische hulpbrontoewijzing voor heterogene computomgevingen

Waarom slimere computers voor iedereen belangrijk zijn

Achter elke film die je streamt, elke kaart die je opent of elke AI-assistent waarmee je praat, werken enorme magazijnen vol computers onopgemerkt dag en nacht. Naarmate kunstmatige intelligentie krachtiger wordt, worden deze datacenters tot het uiterste belast: ze moeten veel verschillende soorten taken op vele soorten hardware balanceren, terwijl kosten, snelheid en energieverbruik onder controle blijven. Dit artikel introduceert een nieuwe manier om te voorspellen wat die computers in de nabije toekomst nodig zullen hebben en om werk over verschillende hardwaretypen te verdelen, zodat diensten snel en betrouwbaar blijven en er minder elektriciteit wordt verspild.

Veel taken, veel machines

Moderne datacenters vertrouwen niet langer op één type server. In plaats daarvan combineren ze traditionele processoren met krachtige grafische chips, gespecialiseerde AI-kaarten en herprogrammeermbare circuits. Verschillende AI-taken—zoals het trainen van een groot taalmodel, het leveren van realtime aanbevelingen of het analyseren van beelden—passen op zeer verschillende manieren bij deze machines. Vandaag de dag wijzen beheerders vaak middelen toe met vaste regels of eenvoudige prognoses op basis van het gebruik van gisteren. Wanneer de vraag plotseling stijgt, kan dat leiden tot trage reacties of gebroken serviceafspraken; wanneer de vraag daalt, kan dure hardware ongebruikt stilstaan en energie verbruiken zonder veel werk te doen.

Leren te kijken waar het telt

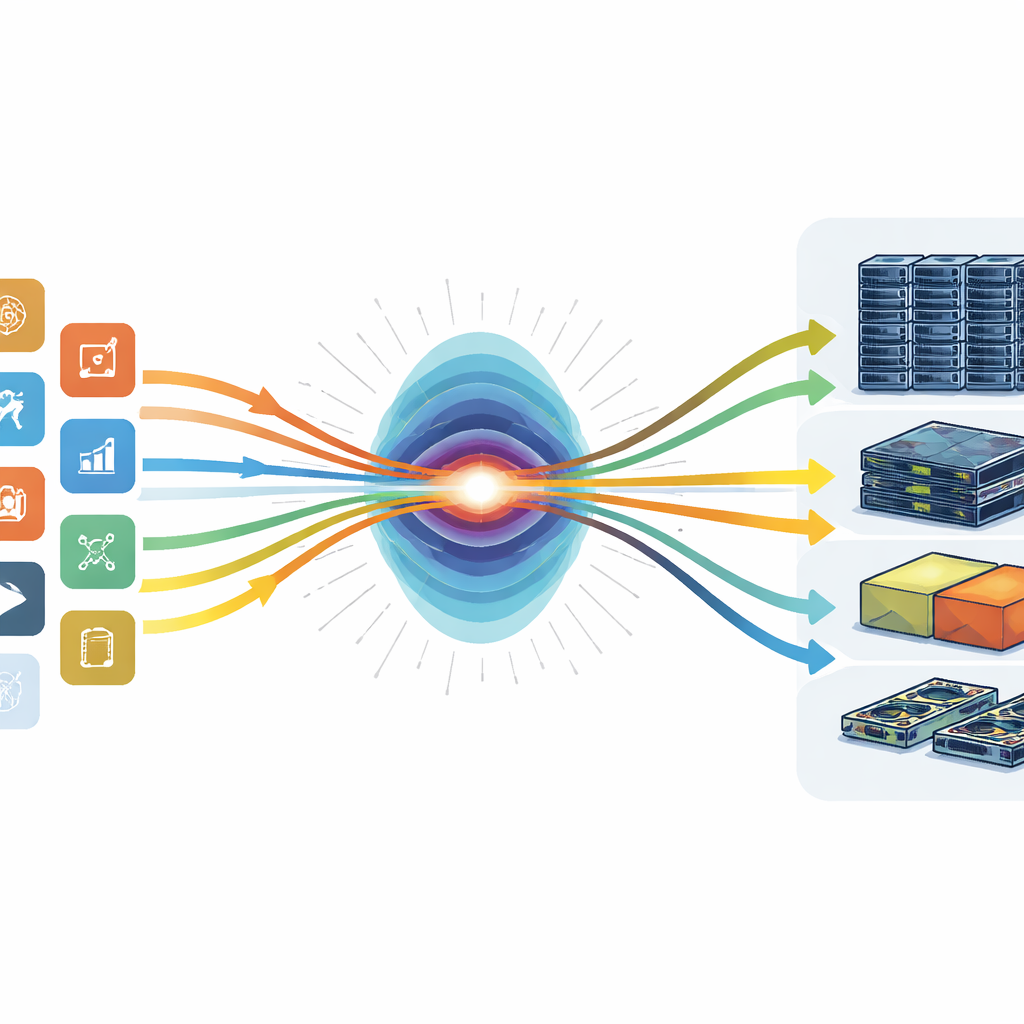

De auteurs lenen een concept uit de modernste AI-modellen, genaamd "attention" (aandacht), en passen het toe op datacenterbeheer. In plaats van alle historische gebruiksgegevens gelijk te behandelen, leert hun systeem welke momenten in de tijd en welke soorten taken het meest nuttig zijn om te voorspellen wat er daarna gebeurt. Een deel van het model richt zich op hoe elke werklast—zoals een trainingstaak of een online dienst—door de tijd heen verandert. Een ander deel kijkt zijwaarts naar de verschillende workloads die op hetzelfde moment draaien om verborgen verbanden bloot te leggen, zoals een patroon waarbij het afronden van een batch trainingsjobs vaak leidt tot een piek in gerelateerde online aanvragen. Door deze twee visies te combineren, kan het systeem toekomstige vraag naar processoren, geheugen en accelerators nauwkeuriger voorspellen dan eerdere methoden.

Voorspellingen omzetten in betere beslissingen

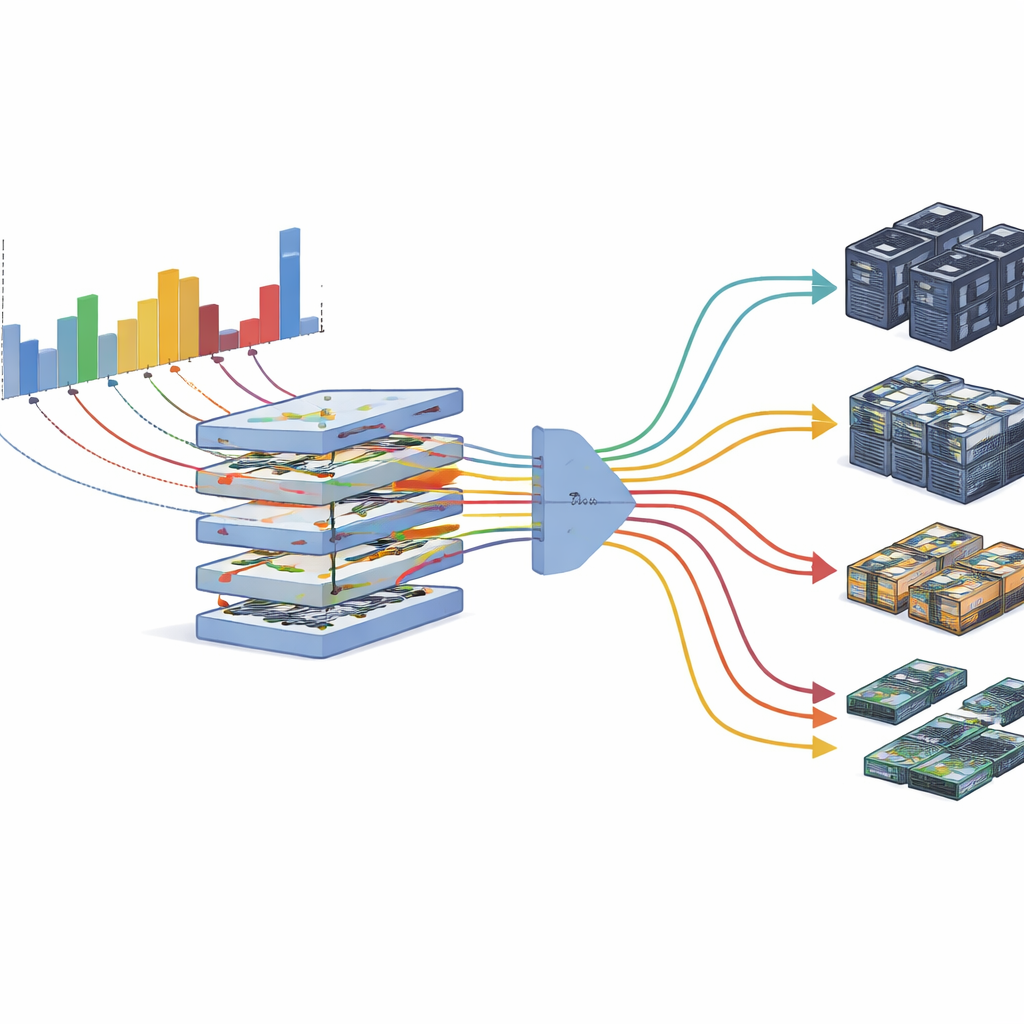

Voorspellen alleen is niet genoeg; het datacenter moet er ook op reageren. De tweede helft van het raamwerk zet deze prognoses om in concrete beslissingen over waar elke taak uitgevoerd moet worden. De auteurs behandelen dit als een evenwichtsoefening tussen drie doelen: taken snel afronden, zo weinig mogelijk energie gebruiken en machines bezet houden in plaats van ze idle te laten staan. Hun scheduler modelleert het datacenter als een netwerk van verschillende apparaten en gebruikt een optimalisatieprocedure om plaatsingen te kiezen die deze doelen afwegen volgens de voorkeuren van de beheerder. Omdat voorspellingen nooit perfect zijn, schat het systeem ook zijn eigen onzekerheid in en laat het veiligheidsmarges wanneer dat nodig is, waarna het de werkelijkheid in realtime bewaakt om aanpassingen te maken door laaggeprioriteerd werk te pauzeren of taken te verplaatsen wanneer het gebruik afwijkt van de verwachtingen.

Het systeem op de proef stellen

Om te zien hoe deze aanpak in de praktijk werkt, bouwden de onderzoekers een testcluster met een realistische mix van processoren, GPU's en gespecialiseerde AI-hardware en voedden het met gedetailleerde activiteitsgegevens van echte datacenters bij Google, Alibaba en een academisch laboratorium. Ze vergeleken hun methode met populaire voorspellingsinstrumenten en planningsstrategieën, inclusief technieken die in productiesystemen worden gebruikt en controllers gebaseerd op reinforcement learning. De aandachtsgebaseerde voorspeller deed consequent nauwkeurigere voorspellingen, vooral voor de scherpe pieken die vaak voorkomen in AI-werklasten. In combinatie met hun dynamische toewijzer verhoogde het systeem het totale hardwaregebruik tot ongeveer vier vijfde van de capaciteit, verkortte de gemiddelde taakvoltooiingstijd met ongeveer een kwart en verlaagde het energieverbruik met ongeveer 15 procent, terwijl serviceovertredingen op een zeer laag niveau bleven.

Wat dit betekent voor alledaagse gebruikers

Voor niet-specialisten is de belangrijkste conclusie dat slimere coördinatie binnen datacenters AI-diensten sneller, goedkoper en groener kan maken zonder nieuwe chips of gebouwen te vereisen. Door te leren waar in de stroom van gebruiksgegevens "aandacht" te besteden, helpt dit raamwerk bestaande hardware nuttiger te laten werken en minder vaak idle te zijn. Dat betekent dat bedrijven vluggere apps en krachtigere AI-tools kunnen leveren, terwijl ze de elektriciteitsrekening en de CO2-voetafdruk onder controle houden. Naarmate vergelijkbare voorspellings- en toewijzingssystemen zich verspreiden en rijpen, kan de onzichtbare infrastructuur van het internet niet alleen capabeler maar ook duurzamer worden.

Bronvermelding: Shao, S., Ding, X., Zhao, B. et al. Attention-based workload prediction and dynamic resource allocation for heterogeneous computing environments. Sci Rep 16, 8571 (2026). https://doi.org/10.1038/s41598-026-38622-4

Trefwoorden: datacenter planning, AI-werklastvoorspelling, heterogene computing, energie-efficiënt rekenen, hulpbrontoewijzing