Clear Sky Science · nl

Strengere privacy-audits van differentieel private stochastische gradient descent in het hidden state bedreigingsmodel

Waarom dit belangrijk is voor alledaagse technologie

Moderne apps leren voortdurend van onze gegevens, van foto’s en berichten tot medische dossiers. Een voorname manier om dit trainen veilig te houden heet differentiële privacy, waarbij zorgvuldig afgestemde ruis wordt toegevoegd zodat de data van geen enkel individu uitsteekt. Maar hoe weten we of deze beschermingen in de praktijk echt werken, zeker voor de diepe neurale netwerken van vandaag? Dit artikel onderzoekt die vraag en laat zien wanneer het verbergen van de “trainingsfilm” van een model echt helpt voor de privacy — en wanneer niet.

Hoe privé leren geacht wordt te werken

Differentially private stochastic gradient descent (DP-SGD) is het kernalgoritme voor privacy-beschermend machine learning. Het traint modellen stap voor stap op kleine datapunten, waarbij de gradient (de verbeteringsrichting) van elke stap wordt afgekapt en er voor het updaten van het model willekeurige ruis wordt toegevoegd. De theorie geeft bovengrenzen voor hoeveel invloed de data van één persoon op het eindmodel kan hebben, samengevat in een privacynummer dat vaak epsilon wordt genoemd. Tegelijkertijd probeert “privacy auditing” het getrainde model aan te vallen om te zien hoeveel informatie in de praktijk echt te achterhalen is. Als theorie en auditing overeenkomen, kunnen we ons privacyrekenwerk vertrouwen; als ze dat niet doen, ontbreekt er iets belangrijks.

Wat verandert er als alleen het eindmodel wordt vrijgegeven

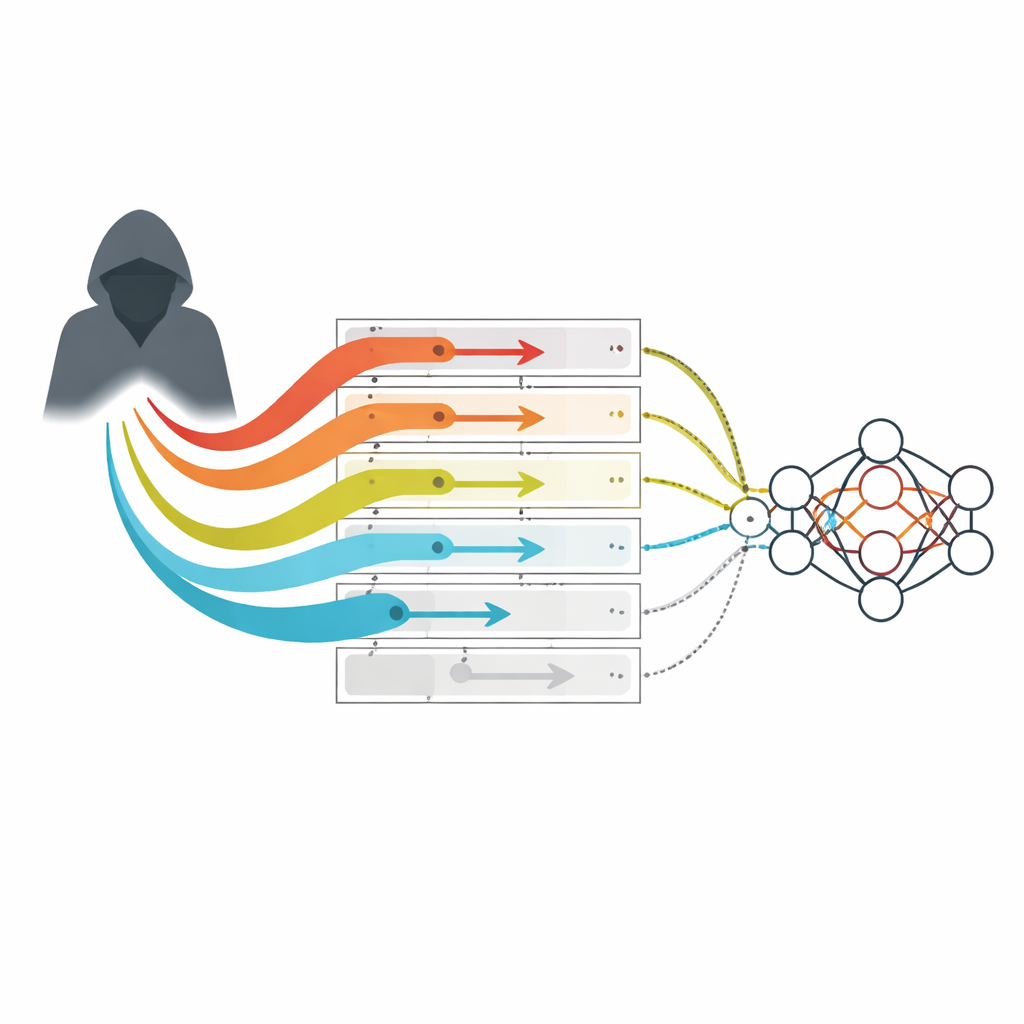

De meeste eerdere audits gingen uit van een krachtige tegenstander die elk tussenmodel tijdens het trainen kan zien. In de praktijk geven veel organisaties echter alleen het eindmodel vrij, niet de volledige trainingsgeschiedenis. Deze realistischer instelling heet het hidden state bedreigingsmodel. Recente theoretische werken suggereerden dat het verbergen van tussenmodellen, althans voor eenvoudige convexe problemen, de privacy in de loop van de tijd kan versterken: data die vroeg in de training is gebruikt wordt door latere ruizige updates als het ware ‘weggewassen’. Moderne deep learning steunt echter op sterk niet-convexe modellen, met een ruig en complex verliesoppervlak. Het was onduidelijk of diezelfde versterking daar ook optreedt — of dat bestaande aanvallen simpelweg te zwak waren om het volledige privacyverlies bloot te leggen.

Een nieuwe manier voor tegenstanders om het model te beïnvloeden

De auteur introduceert een nieuwe familie van “gradient-crafting” tegenstanders die zijn toegesneden op het hidden state model. In plaats van te proberen een speciaal datapunt te ontwerpen en vervolgens te bekijken hoe de bijbehorende loss tijdens het trainen verandert (zoals bij traditionele loss-gebaseerde aanvallen), schrijven deze tegenstanders rechtstreeks de opeenvolging van gradients voor die toegepast zouden worden als er een worst-case datapunt aanwezig is. Ze kiezen gradients die telkens de afkappingsdrempel raken en uitlijnen met parameter-richtingen die zelden worden gebruikt, waardoor hun invloed gemakkelijker te detecteren is ook zonder de tussenmodellen te zien. Er worden twee eenvoudige varianten bestudeerd: een die willekeurig een parametrerichting kiest, en een andere die het trainingsproces simuleert om de minst-geüpdate richting te vinden voordat sterke, herhaalde gradients daarin worden geïnjecteerd.

Wat de experimenten over het echte privacyrisico onthullen

Met dit raamwerk auditet het artikel DP-SGD op beeld- en tabelgegevens met gangbare architecturen zoals convolutionele en residuele netwerken, evenals een klein volledig verbonden model. Wanneer de gemaakte gradient bij elke trainingsstap wordt gebruikt, evenaren de nieuwe tegenstanders de strikte theoretische privacylimieten — ook al zien zij alleen het eindmodel. Dit betekent dat het in dit extreme geval verbergen van tussencheckpoints helemaal geen extra privacy biedt. Wanneer de gemaakte gradient minder vaak wordt ingevoegd, verandert het beeld: voor grote batches relatief tot het ruisniveau blijven de audits dicht bij de theorie (wederom suggererend dat er weinig echte versterking is), maar voor kleinere batches en hogere ruis ontstaat er een kloof die wijst op daadwerkelijke, zij het bescheiden, privacyversterking in niet-convexe instellingen.

Kijken in de limiet van het worst-case scenario

Om de absolute grenzen van privacy in het hidden state model te begrijpen, bestudeert het artikel ook een extremer theoretisch tegenstander die niet alleen gradients vormt maar ook een volledig verlieslandschap ontwerpt om de invloed van een speciaal datapunt over iteraties heen levend te houden. In deze gecontroleerde setting scheiden de resultaten helder twee regimes: bij grote batchgroottes is de privacyberekening op basis van standaardtheorie praktisch gezien strak, maar bij kleine batches en aanzienlijke ruis wordt vroege informatie over een datapunt gedeeltelijk in de loop van de tijd vergeten. Cruciaal is dat deze versterking zwakker is dan wat bekend is voor eenvoudige convexe problemen en dat het privacyrisico nooit volledig wordt uitgewist.

Wat dit betekent voor gebruikers en practici

Voor niet-experts is de belangrijkste conclusie dat het simpelweg verbergen van de trainingsgeschiedenis van een deep learning-model niet magisch veel sterkere privacy garandeert. Wanneer iemands data zeer frequent tijdens training wordt gebruikt, is het risico dichtbij wat de huidige conservatieve theorie al voorspelt. Enige extra bescherming doet zich voor in gunstigere regimes — kleine batches met significante ruis — maar die is beperkt en reduceert het risico niet tot nul. Deze bevindingen valideren deels bestaande privacyberekeningen en tonen ook hun grenzen aan, en bieden zo een helderder, realistischer beeld van hoeveel bescherming DP-SGD kan bieden wanneer alleen het eindmodel wordt gedeeld.

Bronvermelding: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

Trefwoorden: differentiële privacy, DP-SGD, privacy-auditing, beveiliging van machine learning, hidden state model