Clear Sky Science · nl

Een multischalige end-to-end methode voor verbetering en fusie van zichtbare en infrarode beelden

Schoner nachtzicht voor mensen en machines

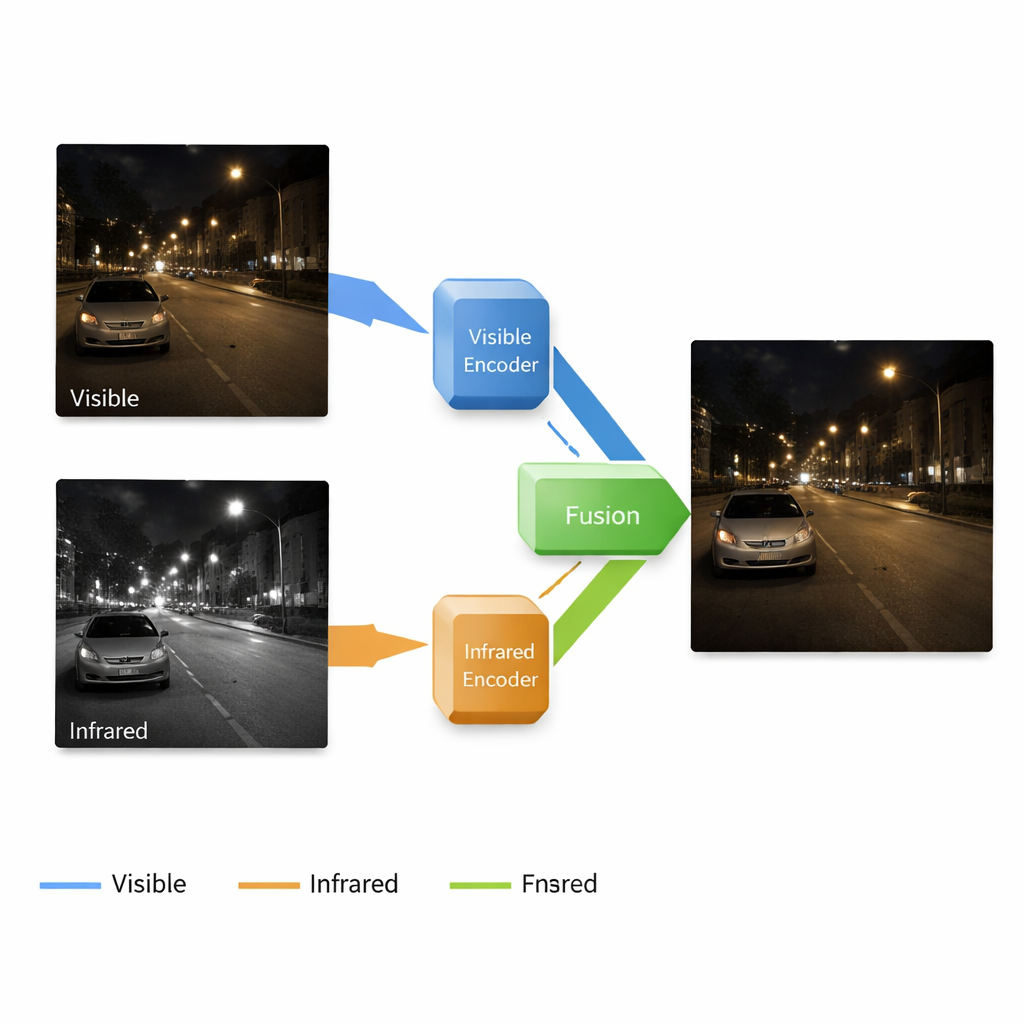

Iemand die ooit ’s nachts heeft geprobeerd een foto te maken weet hoe snel duisternis details wegvaagt: scènes zien er korrelig, wazig en vol vreemde kleuren uit. Veel cruciale technologieën — van wegcamera’s en alarmsystemen thuis tot zelfrijdende auto’s en reddingsdrones — moeten juist onder deze omstandigheden goed kunnen zien. Dit artikel presenteert een nieuwe manier om gewone kleurencamera’s te combineren met infrarode ‘warmte’-camera’s, zodat computers, en uiteindelijk mensen, heldere en gedetailleerde beelden van de wereld krijgen, zelfs bij bijna volledige duisternis.

Waarom twee soorten camera’s beter zijn dan één

Standaardcamera’s vangen hetzelfde soort licht op dat onze ogen zien, wat hun foto’s gemakkelijk maakbaar en interpreteerbaar maakt voor mensen, maar ze falen sterk wanneer licht schaars is: schaduwen slikken details, ruis verschijnt en kleuren verschuiven. Infraroodcamera’s doen het tegenovergestelde: ze detecteren warmtemotieven, waardoor mensen, dieren en voertuigen in het donker of door lichte mist zichtbaar worden, maar hun beelden missen fijne texturen en een natuurlijke uitstraling. Onderzoekers proberen al lange tijd deze twee perspectieven te fuseren tot één beeld dat eruitziet als een heldere kleurenfoto maar tegelijk warme, verborgen objecten onthult. Bestaande methoden behandelen echter vaak elk onderdeel — het ophelderen van donkere beelden, het opruimen van ruis en het samenvoegen van infraroodinformatie — als afzonderlijke taken. Die gefragmenteerde aanpak kan leiden tot slecht op elkaar afgestemde kenmerken en teleurstellende fusieresultaten.

Een enkele pijplijn die zowel opheldert als fuseert

De auteurs stellen een end-to-end systeem voor dat beelden in één doorlopende pijplijn verbetert en fuseert. Het is opgebouwd rond een neuraal netwerk met vier hoofdonderdelen: één tak leert donkere kleurbeelden schoon te maken en op te helderen, een andere tak leert de scène te representeren vanuit de infraroodcamera, een fusieblok combineert wat elke tak heeft geleerd en een decoder reconstrueert een eindbeeld uit deze gecombineerde signalen. Belangrijk is dat het systeem op meerdere schalen werkt, van grove vormen tot fijne texturen. Ondiepe lagen behouden randen en oppervlaktestructuren zoals bakstenen of wegmarkeringen, terwijl diepere lagen bredere structuren vastleggen — gebouwen, auto’s of bomen — en de locatie van warme doelen in het infraroodbeeld.

Drie leerkundige fasen in plaats van één grote sprong

In plaats van het hele systeem in één keer te trainen, gebruikt het team een driestappen-leerstrategie die is ontworpen voor stabiliteit en nauwkeurigheid. In de eerste fase ziet het netwerk alleen donkere zichtbare foto’s en leert het deze op te helderen zonder menselijke ‘perfecte’ referentiebeelden. Zorgvuldig gekozen verlies-termen sturen de output naar natuurlijke helderheid, stabiele kleuren, vloeiende gebieden zonder vlekkerige ruis en behouden textuur. In de tweede fase wordt dezelfde decoder hergebruikt terwijl een nieuwe infraroodtak leert infraroodbeelden trouw te reconstrueren, waardoor het netwerk leert hoe warmtemotieven eruit moeten zien. In de derde fase worden al die geleerde onderdelen bevroren en wordt alleen het fusieblok getraind om de twee representaties te mengen tot één hoogwaardig beeld dat zowel helder als informatie-rijk is.

De methode op de proef gesteld

De onderzoekers evalueerden hun aanpak op openbare datasets met gepaarde zichtbare en infrarode beelden gemaakt onder moeilijke lichtomstandigheden, zoals nachtelijke straten. Ze vergeleken met meerdere toonaangevende fusiemethoden, waaronder die gebaseerd op klassieke beeldtransformaties, standaard convolutionele netwerken en complexere generatieve modellen. Hun methode leverde over het algemeen scherpere details, gelijkmatigere helderheid en duidelijkere thermische doelen, en scoorde ook hoger op kwantitatieve maatstaven voor informatie-inhoud, randverscherping, structurele gelijkenis en contrast. Aanvullende experimenten, waarbij ze selectief sleutelcomponenten uit het systeem verwijderden, toonden aan dat elk onderdeel — het multischalige fusieblok, de gefaseerde training en adaptieve weging van zichtbare versus infrarode kenmerken — meetbaar bijdraagt aan de eindkwaliteit.

Wat dit betekent voor real-world visionsystemen

Voor niet-specialisten is de conclusie helder: dit werk laat zien dat één zorgvuldig getraind netwerk zowel donkere scènes kan ophelderen als warmte- en kleurbeelden op intelligente wijze kan samenvoegen tot één coherent beeld. De gefuseerde beelden behouden fijne texturen terwijl ze toch warme objecten accentueren, wat ze veel nuttiger maakt voor taken zoals nachtbewaking, rijhulpsystemen en augmented of virtual reality in schemerige omgevingen. Hoewel de auteurs enkele resterende problemen noemen — zoals verminderde contrast in zeer heldere gebieden en de behoefte aan snellere, lichtere modellen — markeert hun aanpak een belangrijke stap richting camerasystemen die betrouwbaar in het donker kunnen zien, op een wijze die natuurlijk en interpreteerbaar aanvoelt voor menselijke gebruikers.

Bronvermelding: Xin, Y., Huang, J., Sun, C. et al. A multi-scale end-to-end visible and infrared image enhancement fusion method. Sci Rep 16, 7135 (2026). https://doi.org/10.1038/s41598-026-38323-y

Trefwoorden: verbetering van beelden bij weinig licht, fusie van infrarode beelden, nachtzicht, multisensorbeeldvorming, deep learning visie