Clear Sky Science · nl

Een verbeterd YOLOv11-netwerk voor detectie van marien afval in onderwateromgevingen

Waarom het opsporen van onderwaterafval belangrijk is

Diep onder het oceaanoppervlak hopen zich stilletjes plastic zakken, flessen, vislijnen en ander afval op. Dit zwerfvuil schaadt het zeeleven, verstopt kwetsbare habitats en kan zelfs onderwaterrobots hinderen die wetenschappers gebruiken om de zee te bestuderen en te beschermen. Het hier samengevatte artikel beschrijft een slimmer computervisie-systeem dat camera’s en robots helpt om onderwaterafval in realtime automatisch te vinden en te labelen, zelfs in troebel, rommelig water.

De uitdaging om onder water goed te zien

In tegenstelling tot heldere daglichtfoto’s op land zijn onderwaterbeelden vaak donker, wazig en blauwig of groenig getint. Licht neemt snel af met diepte, zand en plankton maken het water troebel, en afvalstukken zijn vaak klein, deels verborgen of lijken op stenen en planten. Traditionele beeldverwerkingsmethoden hebben het moeilijk onder deze omstandigheden, en zelfs moderne deep-learning detectors missen soms kleine objecten of verwarren achtergrondtextuur met afval. Toch zijn nauwkeurige en snelle detecties cruciaal voor het in kaart brengen van vervuiling, het aansturen van opruimrobots en het volgen van hoe marien afval in de loop van de tijd verandert.

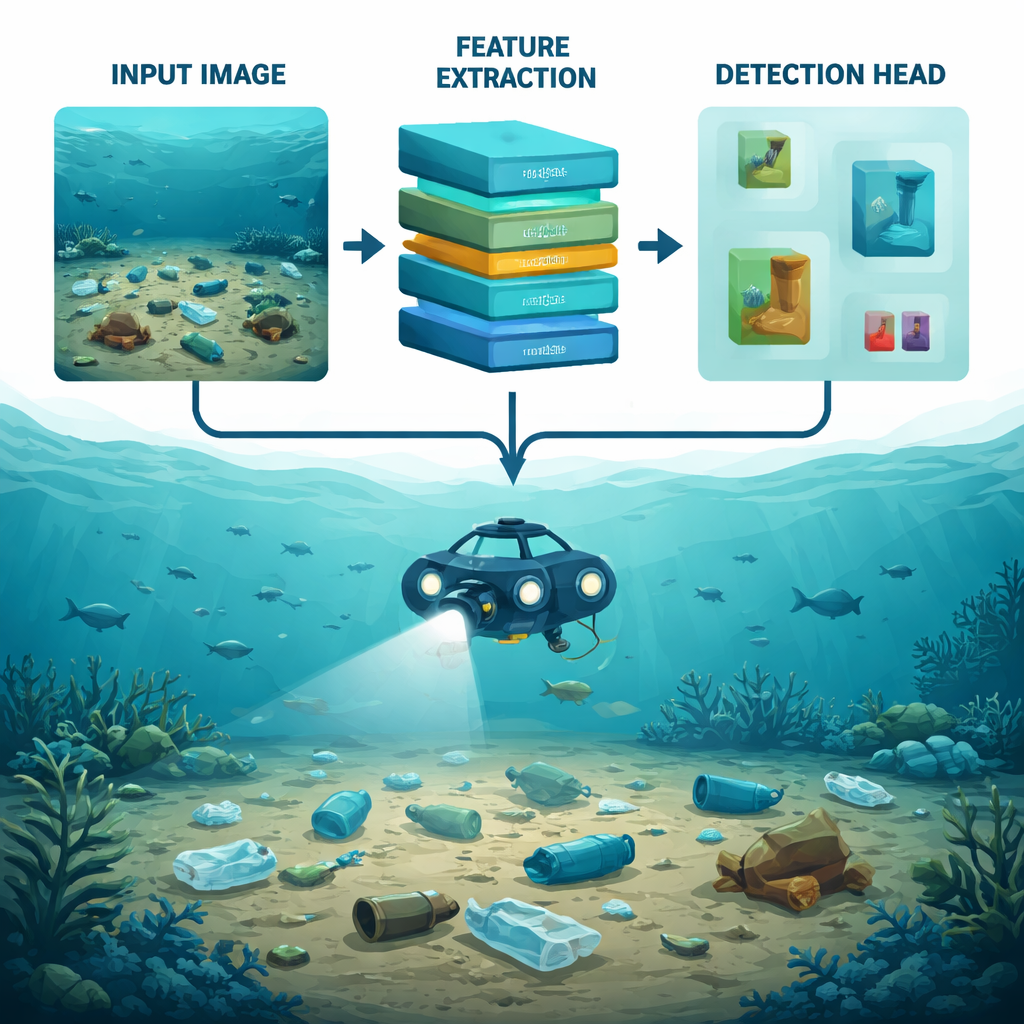

Bouwen op een snelle vision-werkpaard

De auteurs bouwen voort op YOLOv11, een recent lid van de “You Only Look Once”-familie van objectdetectors. YOLO-modellen zijn populair omdat ze een afbeelding één keer scannen en in realtime locaties en typen van vele objecten voorspellen. Het standaardontwerp van YOLOv11 is echter gemaakt voor meer typische scènes, zoals straten of interieurfoto’s, niet voor de visueel vijandige onderwaterwereld. Om die kloof te dichten, herontwerpen de onderzoekers twee belangrijke onderdelen van het netwerk: hoe het eerst visuele patronen uit een afbeelding haalt, en hoe het later beslist welke delen belangrijke afvalobjecten zijn en welke slechts ruisige achtergrond.

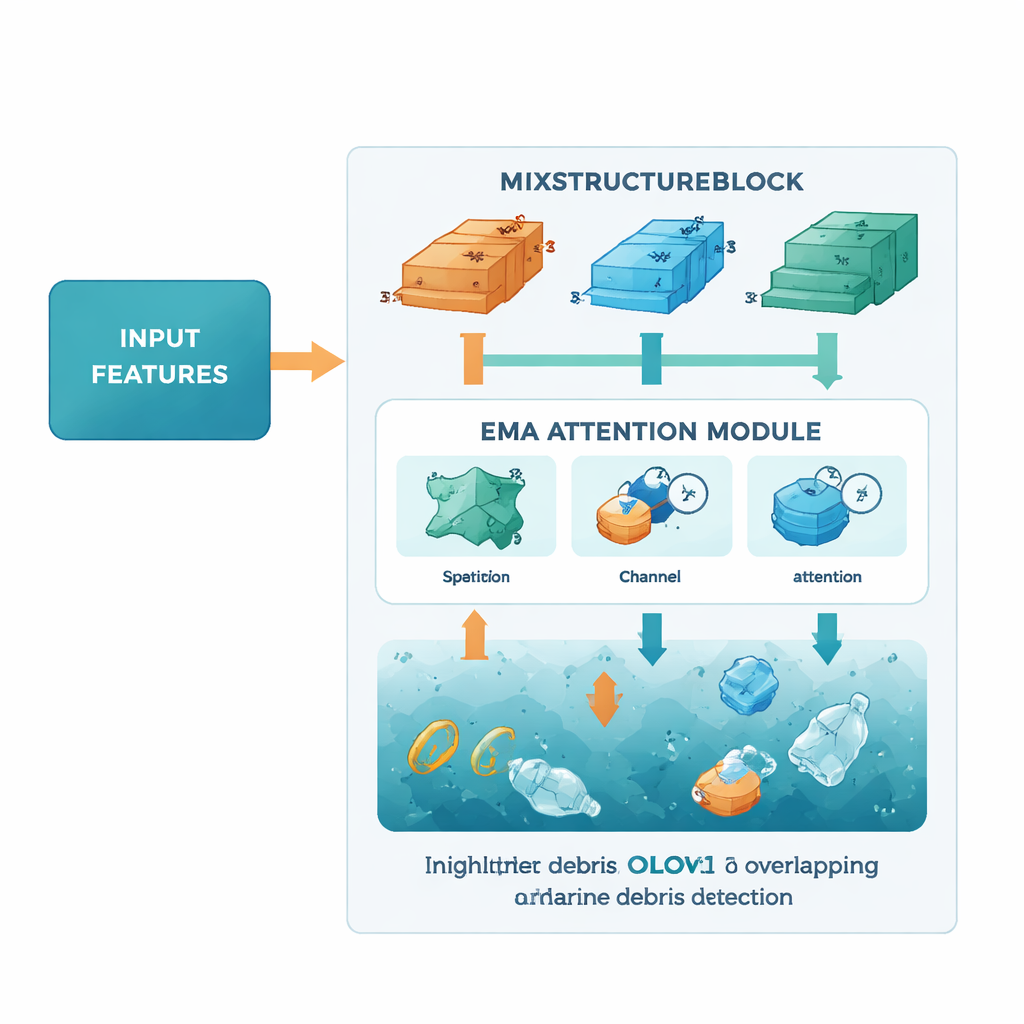

Een nieuwe manier om details op veel schalen te onderscheiden

De eerste verbetering is een module genaamd MixStructureBlock, die een standaard bouwblok in de YOLOv11-backbone vervangt. In plaats van één vast patroon van filters te gebruiken, voert MixStructureBlock meerdere parallelle takken uit die de scène met verschillende “venstergroottes” en tussenafstanden bekijken. Dit helpt het netwerk zowel fijne details op te merken, zoals de rand van een flessendop, als grotere vormen, zoals een drijvende tas. Daarnaast bevat het blok eenvoudige attentie-mechanismen die leren om informatieve kleuren en locaties te benadrukken en onbelangrijke achtergrondvlakken te onderdrukken. Het resultaat is een rijkere, schonere set kenmerken die kleine, vage stukjes afval gemakkelijker zichtbaar maken.

Het netwerk leren waar het moet letten

De tweede upgrade is een Efficient Multi-scale Attention (EMA)-module, toegevoegd later in het netwerk waar detecties plaatsvinden. EMA bekijkt de feature-maps zowel over ruimte als over kanalen en stelt daarmee effectief twee vragen tegelijk: “Waar in de afbeelding gebeurt iets belangrijks?” en “Welke typen patronen zijn op dit moment het meest relevant?” Door informatie op meerdere schalen te poolen en gebruik te maken van lichtgewicht wiskundige operaties, verscherpt EMA de focus van het netwerk op waarschijnlijke afvalgebieden—zoals overlappende objecten of zwakke items ver van de camera—terwijl het totale model compact en snel genoeg blijft voor realtime gebruik op ingebedde hardware.

Het systeem op de proef stellen

Om hun ontwerp te beoordelen, trainde en evalueerde het team het model op TrashCan, een grote openbare verzameling diepzeebeelden samengesteld in Japan. Een versie van de dataset labelt afval op specifiek objecttype (zoals beker, zak of metalen pijp), terwijl een andere items groepeert op materiaal (zoals plastic of textiel). Op beide versies presteert het verbeterde netwerk beter dan verschillende sterke referentiemodellen, waaronder het originele YOLOv11, eerdere systemen voor marien afval en andere op de onderwateromgeving gerichte YOLO-varianten. Het detecteert niet alleen meer afval correct, vooral kleine en dicht opeengepakte items, maar doet dat ook met een opmerkelijk kleine modelgrootte van ongeveer 5 megabyte, wat goed geschikt is voor stroombeperkte onderwatervoertuigen.

Wat dit betekent voor schonere oceanen

Concreet laat de studie zien dat het zorgvuldig heroverwegen van hoe een AI naar onderwaterbeelden “kijkt” een wezenlijk verschil kan maken bij het vinden van afval onder de golven. Door multischalige patroonextractie te combineren met slimme aandacht voor belangrijke gebieden, detecteert het voorgestelde systeem meer zwerfvuil terwijl het efficiënt genoeg blijft voor realtimegebruik. Ingezet op camerasystemen en onderwaterrobots kan zulke technologie wetenschappers en milieuinstanties helpen vervuilingshotspots in kaart te brengen, opruimacties te begeleiden en te monitoren of beleidsmaatregelen om marien zwerfvuil te verminderen effectief zijn—een stap dichter naar gezondere oceanen.

Bronvermelding: Yuanwei, J., Yijiang, D., Xuemei, W. et al. An improved YOLOv11 network for marine debris detection in underwater environment. Sci Rep 16, 7074 (2026). https://doi.org/10.1038/s41598-026-38305-0

Trefwoorden: detectie van marien afval, onderwaterrobotica, objectdetectie, deep learning, oceaanvervuiling