Clear Sky Science · nl

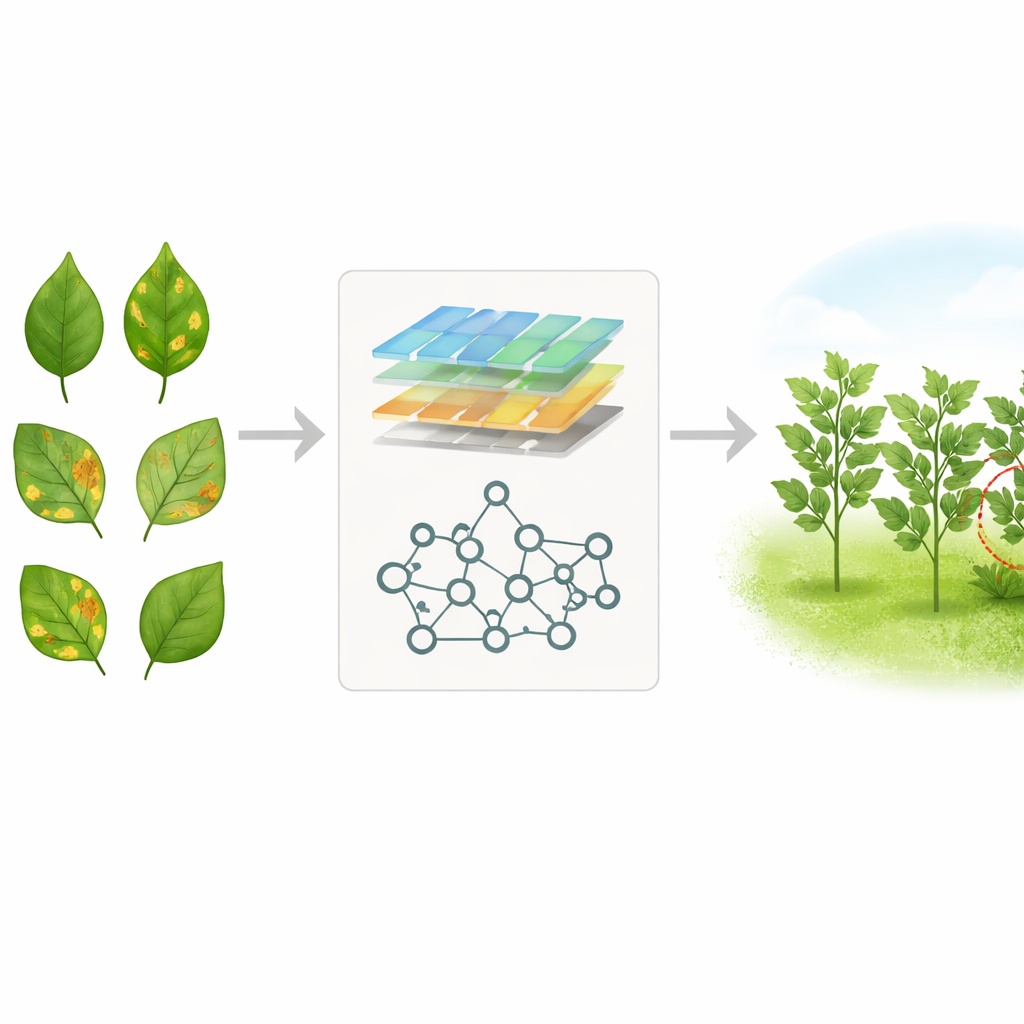

Een hybride deep-learningkader met convolutionele en transformer‑modellen voor robuuste classificatie van plantenziekten

Waarom het opsporen van zieke planten belangrijk is

Plantenziekten verwoesten elk jaar stilletjes een groot deel van de wereldwijde voedselproductie, verminderen de opbrengsten, schaden de inkomsten van boeren en bedreigen de voedselzekerheid. Deze ziekten vroeg ontdekken is lastig: akkers zijn groot, deskundige plantendeskundigen zijn schaars en veel symptomen zijn subtiel. Dit artikel onderzoekt hoe een nieuw type kunstmatige intelligentie tientallen bladaandoeningen uit eenvoudige foto’s kan herkennen, en zo een weg opent naar smartphone‑ of veldcamera‑hulpmiddelen die boeren helpen handelen voordat problemen zich verspreiden.

Van menselijke gut feeling naar digitale ogen

Traditionele diagnose berust op visuele inspectie door mensen en soms het opsturen van monsters naar een laboratorium. Dat proces is traag, subjectief en vaak niet beschikbaar in landelijke gebieden. In het afgelopen decennium hebben onderzoekers computers getraind om bladbeelden te ‘lezen’. Eerdere systemen vereisten ofwel handmatig ontworpen visuele kenmerken door ingenieurs, of gebruikten deep‑learningmodellen genaamd convolutionele neurale netwerken die uitblinken in het oppikken van texturen, kleuren en randen. Deze methoden verbeterden de nauwkeurigheid, maar hadden nog steeds moeite wanneer ziektesymptomen vaag waren, zich over het blad verspreidden of veel op elkaar leken bij verschillende aandoeningen. De nieuwe studie vraagt of het combineren van twee moderne AI‑benaderingen betrouwbaardere antwoorden kan opleveren in zulke moeilijke gevallen.

Het samenvoegen van twee manieren van kijken

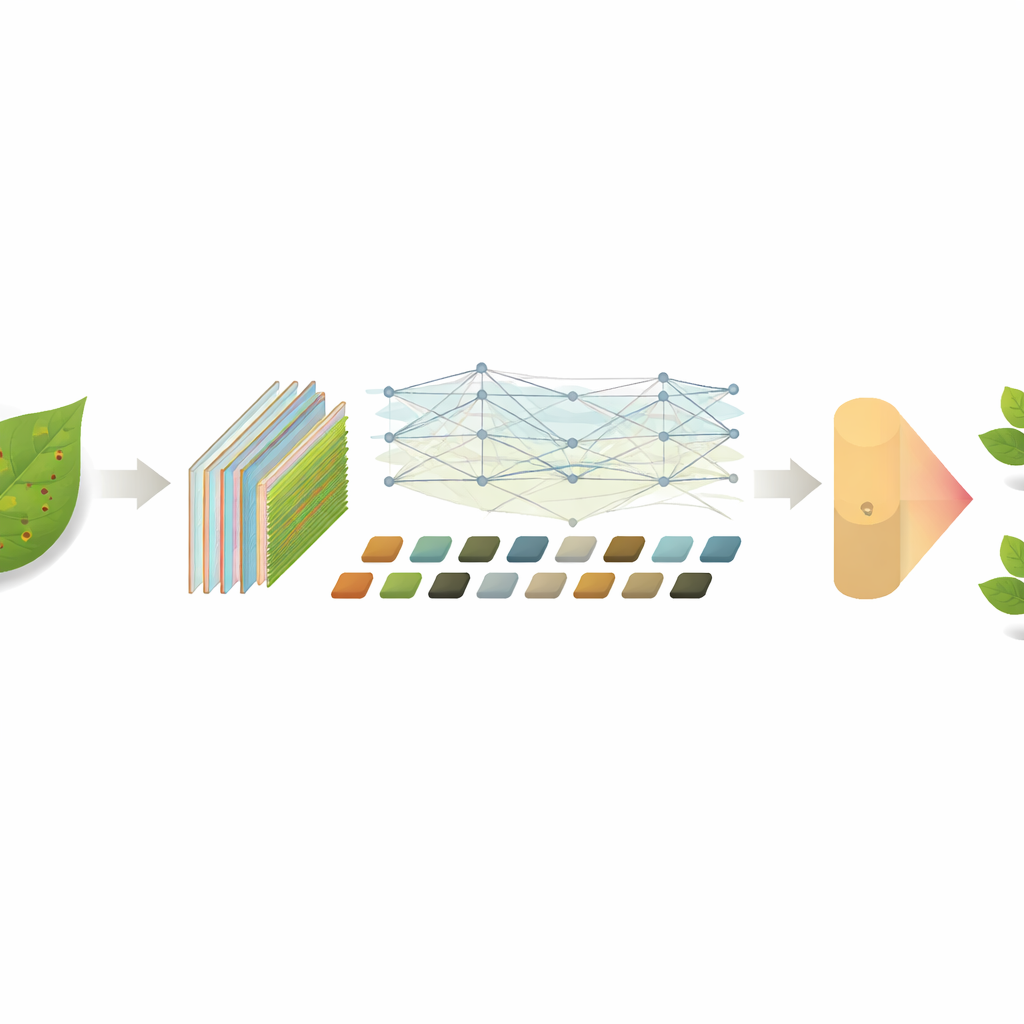

De auteurs bouwen een hybride systeem dat een convolutioneel netwerk fuseert met een nieuwer beeldmodel dat bekendstaat als een vision transformer. Het eerste deel, EfficientNet‑B7, werkt als een vergrootglas en scant bladfoto’s op fijne details zoals kleine vlekken, nerven en kleurverschuivingen. De output wordt vervolgens herschikt en doorgegeven aan een transformer (ViT‑B16), die is ontworpen om te zien hoe verschillende regio’s in het beeld zich over grote afstanden tot elkaar verhouden. Door de gedetailleerde kenmerken om te zetten in een reeks kleine patch‑achtige stukken en de transformer te laten wegen hoe elk patch met alle anderen interacteert, kan het systeem zowel lokale beschadigingen als het algemene patroon op het bladoppervlak begrijpen. Deze combinatie probeert na te bootsen hoe een ervaren agronoom nauwkeurig naar een letsel kijkt terwijl hij ook rekening houdt met de plaats en omgeving ervan.

Het systeem trainen met duizenden bladeren

Om hun model te trainen en te testen gebruikten de onderzoekers een grote publieke verzameling van 21.534 afbeeldingen met 38 verschillende omstandigheden, waaronder meerdere ziekten en gezonde bladeren van gewassen zoals appel, tomaat, druif en mais. Ze standaardiseerden de foto’s tot een gemeenschappelijke grootte en pasten digitale trucs toe — zoals rotaties, spiegelen en inzoomen — om de rommelige omstandigheden van echte velden na te bootsen. Het model leert eerst algemene visuele patronen van bestaande beeldgegevens en wordt daarna fijngeslepen op deze plantenverzameling. Tijdens de training volgt het team niet alleen de algemene nauwkeurigheid, maar ook hoe vaak het systeem elke ziekte correct herkent en hoe goed het valse alarmen vermijdt, zodat de prestaties zowel voor veelvoorkomende als voor zeldzamere klassen blijven standhouden.

Hoe goed de hybride benadering presteert

Wanneer geëvalueerd op onbekende beelden classificeert het hybride model plantgezondheid en ziekte in 98,13 procent van de gevallen correct en behaalt het hoge scores op strikte maatstaven voor precisie, recall en de balans daartussen. Het verwerkt zowel gezonde bladeren als lastige ziektes, hoewel zeer vroege symptomen moeilijker blijven. De auteurs vergelijken hun systeem met een reeks populaire alternatieven, waaronder op zichzelf staande convolutionele netwerken, zuivere transformermodellen, lichte mobiele netwerken, snelle detectoren zoals YOLO en klassieke hulpmiddelen zoals support vector machines en random forests. In deze head‑to‑head tests komt de hybride aanpak consequent als beste uit de bus en verslaat zelfs sterke concurrenten die alleen EfficientNet of ensembles van meerdere netwerken gebruiken.

Wat dit betekent voor boerderijen en voedsel

In praktische termen toont de studie aan dat het combineren van twee elkaar aanvullende AI‑‘blikken’ op een afbeelding — scherp lokaal detail en brede context — de automatische detectie van plantenziekten aanzienlijk kan verbeteren. Hoewel het huidige systeem nog redelijk duidelijke foto’s verwacht en het beste draait op machines met grafische processors, kunnen dezelfde ontwerpideeën worden aangepast tot lichtere versies voor smartphones, drones of goedkope veldapparaten. Naarmate deze hulpmiddelen rijpen, kunnen ze boeren snel ter plaatse aanwijzingen geven over wat hun gewassen aantast en waar, waardoor eerdere behandeling, verminderd chemisch gebruik en stabielere oogsten mogelijk worden. Voor alledaagse lezers is de kernboodschap dat slimmere camera’s en algoritmen krachtige bondgenoten worden bij het beschermen van de wereldwijde voedselvoorraad.

Bronvermelding: Jawed, M.M., Tufail, F.A., Ahmed, M.Z. et al. A hybrid deep learning framework using convolutional and transformer models for robust plant disease classification. Sci Rep 16, 9704 (2026). https://doi.org/10.1038/s41598-026-38209-z

Trefwoorden: detectie van plantenziekten, deep learning, vision transformer, precisie‑landbouw, beeldclassificatie