Clear Sky Science · nl

Stabiele aanpak gebaseerde diagonale recurrente kwantum-neurale netwerken voor identificatie van niet-lineaire systemen

Machines leren complexe systemen te begrijpen

Veel van de systemen die ons leven bepalen — van elektromotoren in apparaten tot turbulente luchtstromen en zelfs sommige medische processen — gedragen zich op ingewikkelde, niet-lineaire manieren. Dat betekent dat kleine veranderingen in hun ingangen verrassend grote of chaotische reacties kunnen uitlokken. Zulke systemen voorspellen en beheersen is lastig, maar essentieel voor efficiëntie, veiligheid en energiebesparing. Dit artikel introduceert een nieuw type leermachine dat ideeën uit kwantumcomputing, neurale netwerken en stabiliteitstheorie combineert om deze lastige gedragingen nauwkeuriger en betrouwbaarder te modelleren.

Waarom gewone modellen tekortschieten

Traditionele modelleertools gaan er vaak van uit dat oorzaak en gevolg netjes en proportioneel zijn, wat goed werkt voor eenvoudige of bijna-lineaire systemen. Veel echte systemen hebben echter geheugen, feedback en drempels die hun gedrag sterk niet-lineair maken. Klassieke neurale netwerken hebben geholpen, maar kennen ook hun beperkingen. Feedforward-netwerken, waarbij informatie maar één kant op stroomt, zijn goed voor statische taken maar worstelen wanneer vorige signalen een rol spelen. Recurrente netwerken, die informatie terugvoeren om geheugen te creëren, kunnen tijdsvariërend gedrag vastleggen maar zijn vaak moeilijk te trainen, gevoelig voor instabiliteit en rekenkundig kostbaar wanneer elke neuron met elke andere communiceert.

Kwantumideeën combineren met eenvoudige lussen

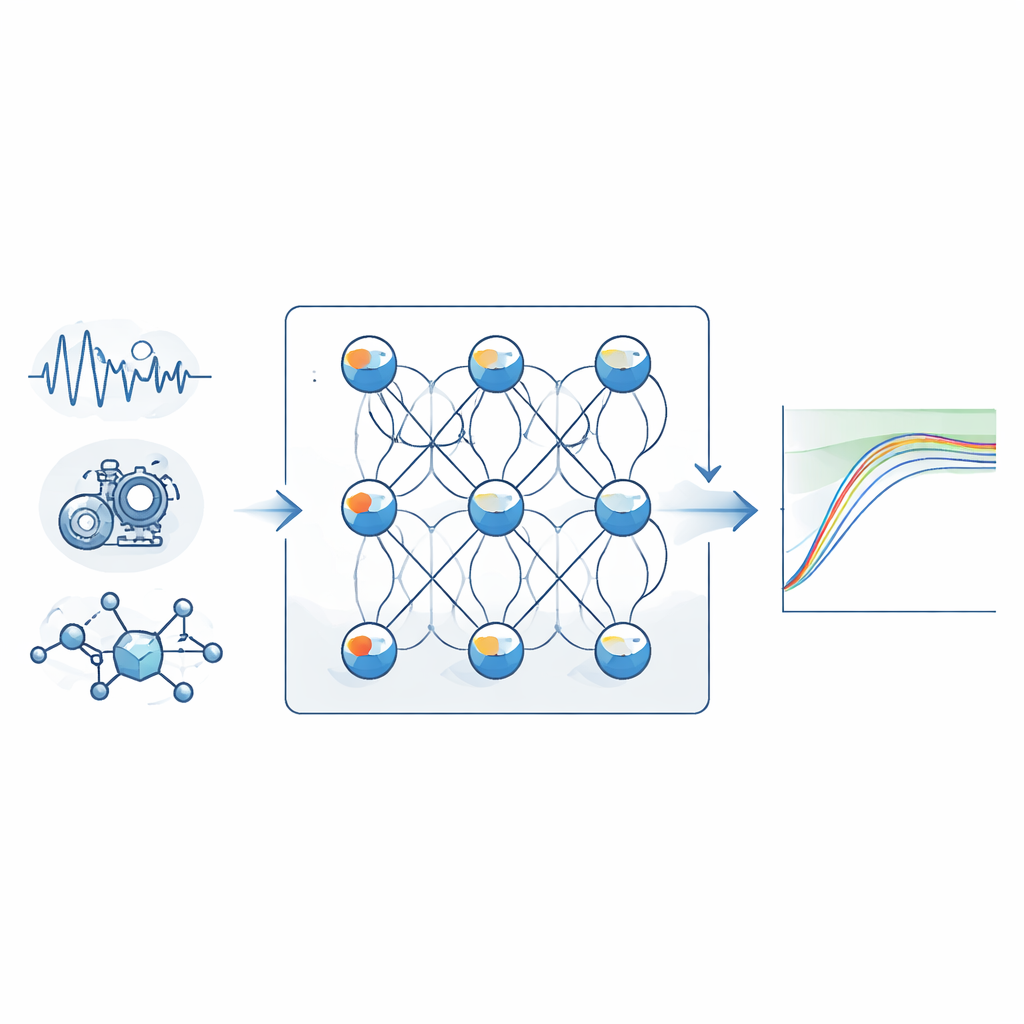

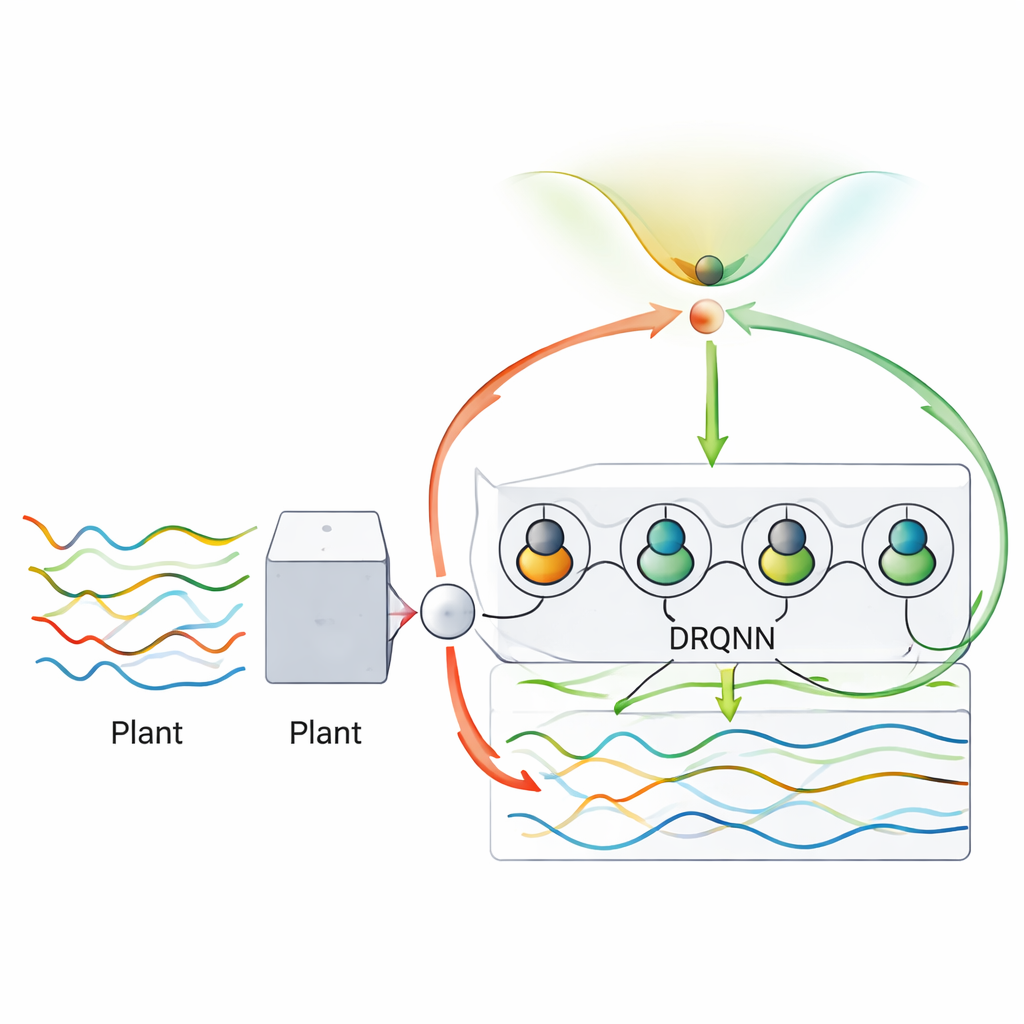

De auteurs stellen een diagonaal recurrent kwantum-neuraal netwerk voor met Lyapunov-stabiliteit, afgekort DRQNN-LS. In essentie lijkt dit netwerk nog steeds op een vertrouwd drielaagsschema: invoer, een verborgen laag en een uitvoer. Maar twee innovaties maken het bijzonder. Ten eerste gedragen de verborgen eenheden zich als vereenvoudigde qubits, waarvan de interne toestanden worden beschreven met faseachtige grootheden in plaats van gewone reële waarden. Deze door kwantum geïnspireerde representatie laat elke eenheid rijkere informatie compact coderen, waardoor het netwerk complexere relaties beter kan benaderen. Ten tweede, in plaats van een wirwar van terugkoppelingsverbindingen voedt elke verborgen neuron alleen zichzelf terug. Deze ‘diagonale’ terugkoppeling behoudt het benodigde geheugen om tijdsvariërende patronen te volgen en reduceert tegelijkertijd drastisch het aantal te tunen verbindingen.

Het leerproces stabiel en beheersbaar houden

Een belangrijke uitdaging bij het trainen van elk recurrent netwerk is het leerproces stabiel houden: als de gewichten te agressief veranderen, kan de output exploderen of gaan oscilleren; veranderen ze te traag, dan duurt training eindeloos en kan het vastlopen. Hier leunen de auteurs op Lyapunov-stabiliteitstheorie, een wiskundig kader dat oorspronkelijk is ontwikkeld om de veiligheid van fysieke systemen te analyseren. Ze construeren een speciale energieachtige functie die de modelleerfout en de grootte van de netwerkparameters combineert. Door zorgvuldig af te leiden hoe deze functie in de tijd verandert, verkrijgen ze automatische regels voor het bijwerken van de gewichten en interne parameters zodat de totale “energie” alleen maar kan afnemen. Dit levert adaptieve leersnelheden op die vanzelf versnellen of vertragen en daarmee convergentie garanderen zonder handmatige afstemming.

Het nieuwe netwerk op de proef stellen

Om te laten zien dat DRQNN-LS meer is dan een fraai idee op papier, testen de auteurs het op drie heel verschillende taken. Ten eerste modelleren ze een wiskundig niet-lineair systeem met bekend gedrag en controleren ze hoe nauwkeurig het netwerk de uitvoer kan volgen. Ten tweede pakken ze de chaotische Henon-kaart aan, een klassiek benchmarkvoorbeeld waarbij kleine verschillen in begincondities tot sterk uiteenlopende trajecten kunnen leiden. Ten derde passen ze de methode toe op echte data van een kleine gelijkstroommotor, een lawaaierig, praktisch apparaat waarvan de interne werking niet volledig bekend is. In elk geval vergelijken ze de nieuwe aanpak met verschillende bestaande neurale modellen, waaronder klassieke diagonale recurrente netwerken en eerdere kwantum-geïnspireerde versies getraind met eenvoudigere gradientgebaseerde regels.

Betere nauwkeurigheid, robuustheid en ruisbestendigheid

In alle drie de voorbeelden produceert DRQNN-LS consequent lagere voorspelfouten en een betere aansluiting op de echte signalen dan de concurrerende methoden, zelfs wanneer de data opzettelijk met aanzienlijke ruis zijn vervuild. Hoewel het nieuwe model per stap iets meer rekenwerk vereist — omdat het recurrente kwantumgeïnspireerde toestanden bijhoudt en de Lyapunov-gebaseerde update evalueert — blijven de uitvoeringstijden klein genoeg voor realtime gebruik op moderne processors. De resultaten suggereren dat het combineren van een gestroomlijnde recurrente structuur, kwantumachtige neuronale toestanden en wiskundig gegarandeerd stabiel leren een krachtig en praktisch instrument oplevert om niet-lineaire dynamica in de echte wereld te begrijpen en te voorspellen.

Wat dit betekent voor de toekomst

Voor niet-specialisten is de kernboodschap dat we leren slimmere, betrouwbaardere digitale tweelingen van complexe fysieke systemen te bouwen. DRQNN-LS biedt een manier voor een machine om het gedrag van een complex proces direct uit data te leren, terwijl wordt gegarandeerd dat dat leerproces niet ‘ontploft’ of onvoorspelbaar dwaalt. Die combinatie van flexibiliteit en stabiliteit kan waardevol blijken in sectoren variërend van industriële besturing en robotica tot energiesystemen en mogelijk zelfs biologische of medische modellering, waar niet-lineair gedrag en lawaaierige metingen de norm zijn.

Bronvermelding: Khalil, H., Elshazly, O. & Shaheen, O. Stable approach based diagonal recurrent quantum neural networks for identification of nonlinear systems. Sci Rep 16, 8274 (2026). https://doi.org/10.1038/s41598-026-37973-2

Trefwoorden: identificatie van niet-lineaire systemen, kwantum-neuraal netwerk, recurrent neuraal netwerk, Lyapunov-stabiliteit, modellering van chaotische dynamica