Clear Sky Science · nl

Een deep learning-framework voor borstkankerdetectie met Swin Transformer en Dual-Attention Multi-scale Fusion Network

Waarom dit belangrijk is voor patiënten en artsen

Borstkanker is een van de meest voorkomende vormen van kanker bij vrouwen en mammogrammen zijn het belangrijkste hulpmiddel om de ziekte vroeg op te sporen. Het beoordelen van deze röntgenbeelden is echter lastig, zelfs voor specialisten, en kleine waarschuwingssignalen kunnen over het hoofd worden gezien. Deze studie presenteert een nieuw systeem voor kunstmatige intelligentie (AI) dat is ontwikkeld om radiologen betrouwbaarder te helpen bij het opsporen van borstkanker door twee krachtige manieren van "kijken" naar mammogrammen te combineren: één die het grote geheel ziet en één die inzoomt op zeer kleine details.

De uitdaging van zowel het bos als de bomen zien

Moderne AI-systemen ondersteunen al bij het lezen van medische beelden, maar de meeste vertrouwen op één type model. Convolutionele neurale netwerken zijn goed in het herkennen van lokale patronen, zoals scherpe randen of kleine heldere vlekjes. Vision transformers, een nieuwere modelklasse, blinken uit in het begrijpen van relaties over het hele beeld. Mammogrammen vragen echter om beide vaardigheden tegelijk: kanker kan zich manifesteren als piepkleine calciumspikkels of subtiele vervormingen, maar de betekenis ervan hangt af van hoe die signalen in de algehele borststructuur passen. Tegelijkertijd zijn echte mammografiedatasets relatief klein en vaak ongebalanceerd, met veel minder kankergevallen dan normale onderzoeken, waardoor AI-systemen makkelijk overfitten of bevooroordeeld raken.

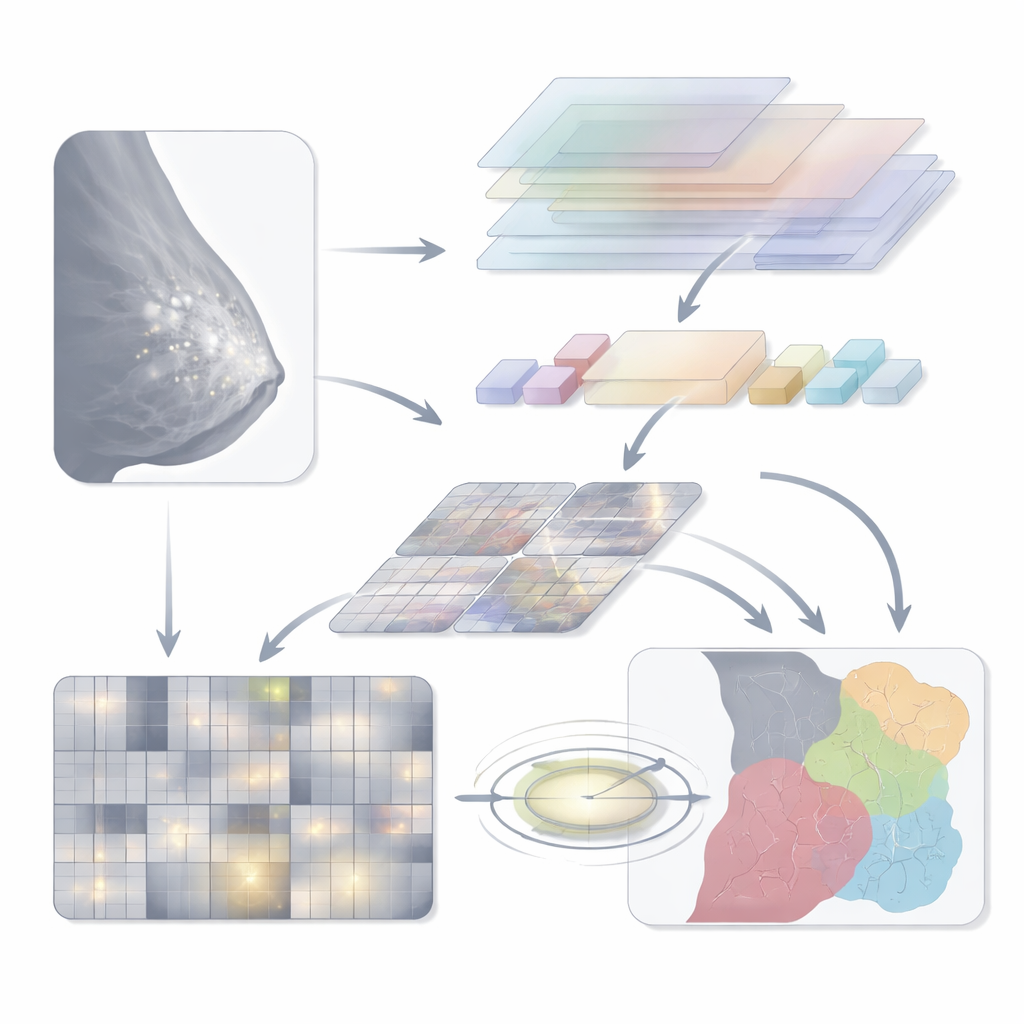

Een tweesporige AI die breed kijkt en diep inzoomt

De auteurs introduceren een hybride model dat ze Swin‑DAMFN noemen, expliciet gebouwd om globale en lokale visie te combineren. De ene tak is gebaseerd op de Swin Transformer, die het mammogram in vensters verdeelt en een attentiemechanisme gebruikt om context op lange afstand vast te leggen — hoe verschillende delen van de borst zich tot elkaar verhouden. De tweede tak is een aangepast convolutioneel netwerk, het Dual‑Attention Multi‑scale Fusion Network (DAMFN). Deze tak is afgestemd op het oppikken van extreem fijne details zoals microcalcificaties en lichte weefselverstoringen. Binnen DAMFN analyseren gespecialiseerde blokken het beeld op meerdere schalen en richtingen, en gebruiken attentie‑modules om regio's te benadrukken die klinisch het meest informatief lijken, terwijl achtergrondweefsel wordt onderdrukt.

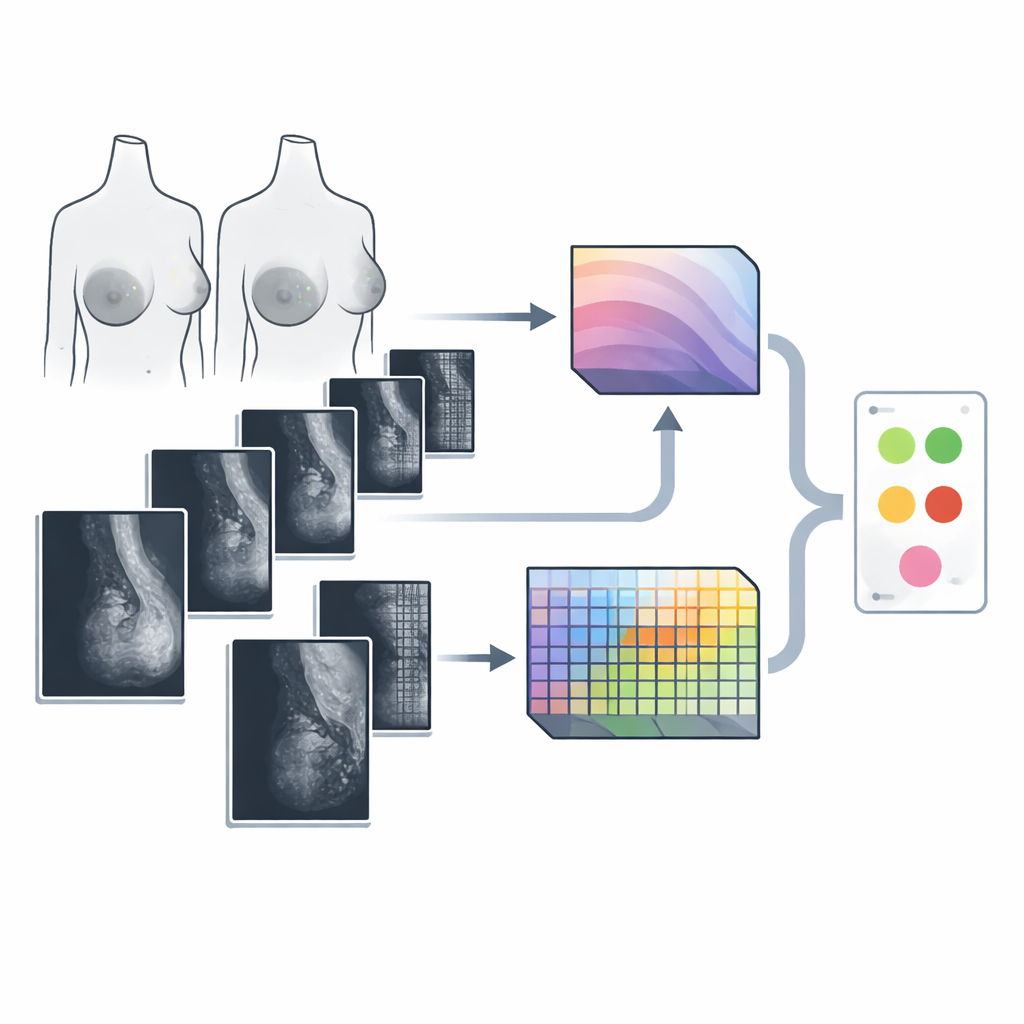

Het systeem trainen met meer en rijkere beelden

Aangezien echte mammografiedatasets beperkt zijn en scheef verdeeld naar niet‑kankergevallen, versterkten de onderzoekers de trainingsdata op twee aanvullende manieren. Ten eerste gebruikten ze een type generatief model, een conditionele GAN, om realistische mammogrampatches te synthetiseren, vooral voor ondervertegenwoordigde kwaadaardige categorieën. Deze gegenereerde beelden helpen de klassen te balanceren en stellen het model bloot aan meer variaties in ziektebeeld. Ten tweede pasten ze fotometrische veranderingen toe — kleine, willekeurige aanpassingen in helderheid, contrast en scherpte — op zowel echte als synthetische beelden. Dit dwingt de AI zich te richten op echte anatomische patronen in plaats van oppervlakkige belichting of ruis, wat de generaliseerbaarheid naar nieuwe scans verbetert.

Hoe de onderdelen samenwerken tijdens diagnose

Tijdens de analyse wordt een voorbewerkte mammogram gelijktijdig aan beide takken gevoed. De Swin Transformer produceert een compacte samenvatting van de globale structuur, terwijl DAMFN een rijk kaartbeeld van lokale kenmerken oplevert. Deze worden vervolgens in grootte uitgelijnd en samengevoegd tot één representatie. Een lichtgewicht "triplet attention"-blok verfijnt deze fusie door kanalen en ruimtelijke dimensies kruisgewijs te controleren, waardoor de focus van het model wordt gericht op gebieden die het meest waarschijnlijk ziekte bevatten. Uiteindelijk genereert een eenvoudige classificatiekop een gemiddelde van de informatie en levert een voorspelling over meerdere klassen, zoals normaal weefsel, goedaardige bevindingen of verschillende typen kwaadaardige laesies.

Wat de resultaten in de praktijk betekenen

Het team testte Swin‑DAMFN op twee veelgebruikte openbare datasets, CBIS‑DDSM en MIAS, en vergeleek het met vele populaire deep learning‑modellen. Hun systeem behaalde ongeveer 99% nauwkeurigheid op CBIS‑DDSM en bijna 99% op MIAS, met even hoge sensitiviteit (het vermogen om kankers te detecteren) en specificiteit (het vermijden van valse alarmen). Zorgvuldige ablatietests toonden aan dat elk onderdeel — de dubbele takken, de attentie‑gebaseerde fusie en de data‑augmentatiestrategie — bijdroeg aan deze verbeteringen. Hoewel de auteurs opmerken dat breder testen op diverse ziekenhuisdata nog nodig is, suggereren de bevindingen dat hybride AI‑systemen zoals Swin‑DAMFN waardevolle assistenten kunnen worden bij borstkankerscreening, radiologen kunnen helpen gevaarlijke laesies eerder en consistenter te detecteren en tegelijkertijd werklast en onzekerheid te verminderen.

Bronvermelding: Aldawsari, M.A., Aldosari, S.J., Ismail, A. et al. A deep learning framework for breast cancer diagnosis using Swin Transformer and Dual-Attention Multi-scale Fusion Network. Sci Rep 16, 8941 (2026). https://doi.org/10.1038/s41598-026-37969-y

Trefwoorden: borstkanker, mammografie, deep learning, transformermodellen, AI voor medische beeldvorming