Clear Sky Science · nl

Realtime objectdetectie voor onbemande luchtvaartuigen op basis van vision transformer en edge computing

Slimmere ogen in de lucht

Onbemande luchtvaartuigen — drones — worden snel alledaagse hulpmiddelen voor taken zoals het inspecteren van bruggen, het monitoren van verkeer en het zoeken naar vermiste personen. Maar om echt te helpen bij deze tijdkritische taken moet een drone meer doen dan alleen de wereld filmen; hij moet kleine objecten in realtime herkennen terwijl hij vliegt op een beperkte batterij en een kleine boordcomputer. Dit artikel presenteert een nieuwe manier om drones scherpere, snellere "ogen" te geven door een geavanceerde AI-techniek, de vision transformer, te combineren met slim gebruik van nabijgelegen edge-servers, zodat kleine objecten zoals voetgangers, fietsen en auto's snel en betrouwbaar vanuit de lucht kunnen worden gedetecteerd.

Waarom drones moeite hebben met kleine details

Vanuit grote hoogte kunnen mensen en voertuigen in een videoframe krimpen tot slechts enkele tientallen pixels. Traditionele neurale netwerksystemen die op drones worden gebruikt zijn ontworpen om snel te draaien op energiezuinige chips, maar ze missen vaak deze kleine objecten of falen bij veranderingen in verlichting of kijkhoek. Nieuwere vision transformer-modellen, geleend uit de wereld van taalverwerking, zijn veel beter in het gelijktijdig begrijpen van de hele scène en het ontrafelen van kleine details uit rommelige achtergronden. Het probleem is dat ze doorgaans enorme rekenkracht vragen, ver boven wat een vliegend platform kan dragen. De auteurs willen deze kloof dichten: de scherpe visie van de transformer behouden, maar hem genoeg versmallen om realtime op een drone te draaien, en extra werk naar een nabijgelegen edge-server uitbesteden wanneer de omstandigheden het toelaten.

Een gesplitst brein: drone en edge werken samen

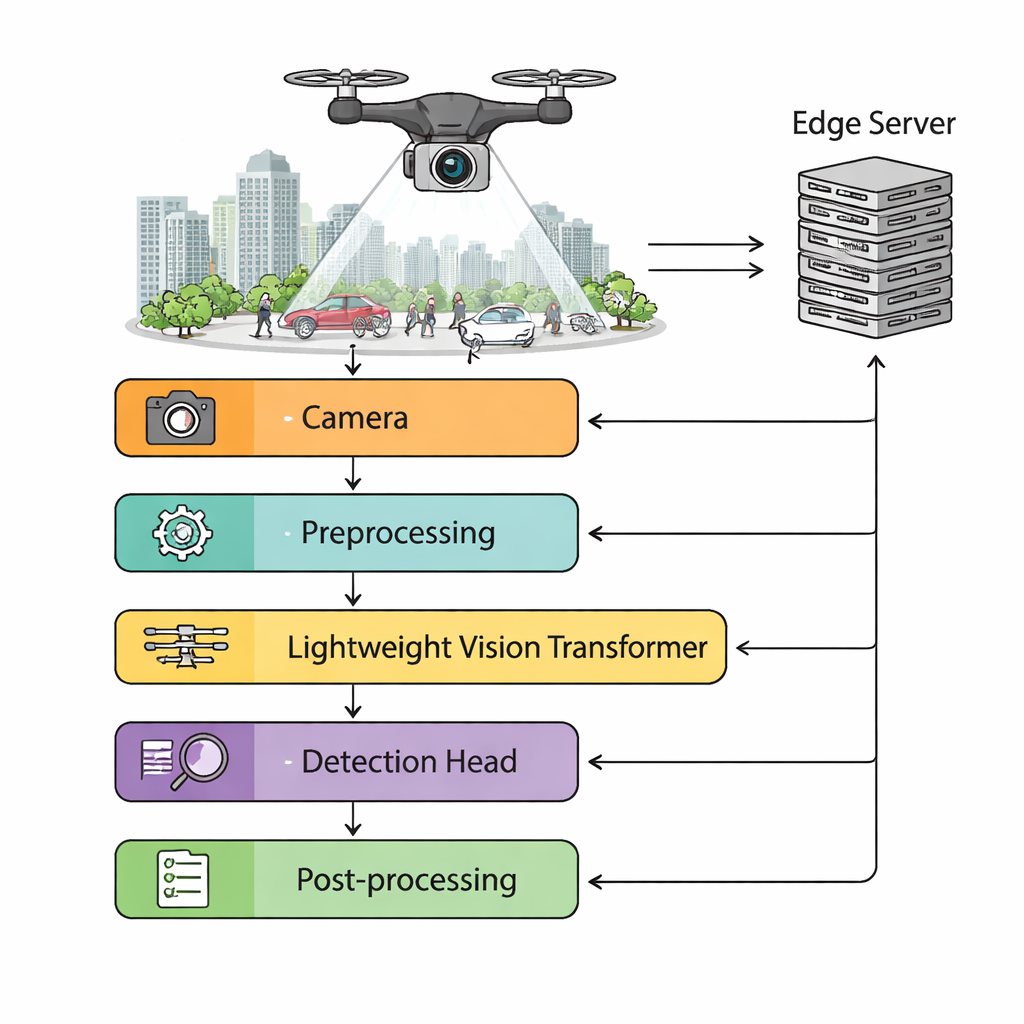

Het voorgestelde raamwerk verdeelt het werk tussen de drone en een grondgebonden edge-computer. De camera van de drone streamt video in hoge definitie naar een onboard voorverwerkingsmodule die wankele beelden stabiliseert, de helderheid aanpast en dynamisch afbeeldingen schaalt afhankelijk van de beschikbare rekenkracht. Een lichtgewicht vision transformer haalt rijke kenmerken uit elk frame en voedt een detectiekop die voorspelt waar objecten zich bevinden en wat ze zijn. Een scheduler bewaakt de draadloze netwerklatentie, het batterijniveau en de verwerkingsbelasting. Wanneer de verbinding met de grond snel en stabiel is, kunnen zwaardere taken — zoals het verwerken van batches frames of het draaien van extra modellen ter nauwkeurigheidsverbetering — naar de edge-server worden verschoven. Wanneer de verbinding verslechtert, schakelt het systeem automatisch over op volledig autonome boordverwerking zodat de drone nooit 'blind' hoeft te vliegen.

Het model trimmen zonder het zicht te verliezen

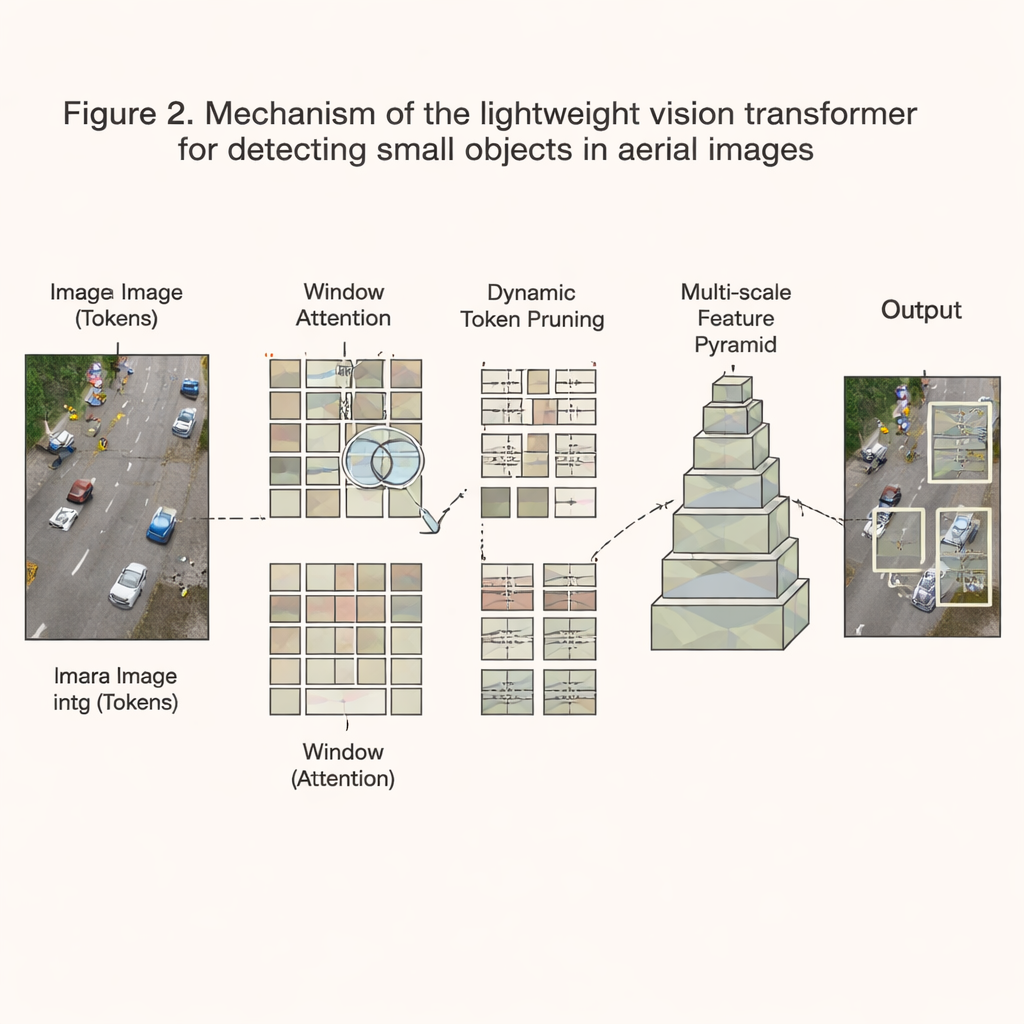

Om de transformer klein en snel genoeg te maken, herontwerpen de auteurs de interne werking. In plaats van elk deel van het beeld alles met elkaar te laten vergelijken — een proces dat explosief groeit met de resolutie — beperken ze de aandacht tot lokale vensters die over het beeld schuiven, waardoor de rekencostes tot meer beheersbare niveaus dalen. Daarnaast evalueert een dynamisch pruning-schema constant welke gebieden van het beeld nuttige informatie bevatten en welke grotendeels lege achtergrond zijn. Tokens die als niet-informatief worden beoordeeld worden vroegtijdig verwijderd, wat tijd en geheugen bespaart, terwijl complexe, rommelige scènes meer details behouden. Het model bouwt ook een multi-schaal piramide van kenmerken zodat zowel kleine voetgangers als grotere voertuigen in hetzelfde frame gedetecteerd kunnen worden. Gecombineerd met zorgvuldige quantisatie (minder bits per getal), channel pruning en low-level softwareoptimalisaties verminderen deze wijzigingen de benodigde berekeningen met ongeveer twee derde, terwijl meer dan 94% van de oorspronkelijke nauwkeurigheid behouden blijft.

Het systeem op de proef stellen

Het team evalueert hun ontwerp op een grote luchtvaartdataset samengesteld uit openbare drone-benchmarks en duizenden nieuw verzamelde beelden boven steden, buitenwijken en landelijke gebieden in verschillende seizoenen en lichtomstandigheden. Op een populaire embedded computer die in drones wordt gebruikt, de NVIDIA Jetson Xavier NX, draait hun systeem ongeveer 39 frames per seconde — snel genoeg voor realtime gebruik — en behaalt het hogere nauwkeurigheid dan veelgebruikte lichtgewicht detectors zoals YOLO-varianten. Met name is het aanzienlijk beter in het detecteren van kleine objecten, met ruwweg een winst van zeven procentpunt in gemiddelde precisie ten opzichte van conventionele convolutionele netwerken. Weeklange veldproeven op een commercieel droneplatform tonen aan dat het systeem prestaties behoudt ondanks cameravibratie, veranderende belichting en fluctuerende draadloze connectiviteit, en dat het soepel kan schakelen tussen edge-ondersteunde en volledig boordgebaseerde modi tijdens echte vluchten.

Wat dit betekent voor missies met drones in de praktijk

Simpel gezegd laat dit werk zien dat het mogelijk is drones scherper en betrouwbaarder te laten zien zonder er een datacenter-waardige computer aan vast te maken. Door de vision transformer slank te herontwerpen, selectief te focussen op de meest informatieve delen van elk beeld en de drone te koppelen aan een nabijgelegen edge-server wanneer mogelijk, leveren de auteurs een detector die meer ziet, minder mist en toch realtime draait binnen strakke energie- en geheugengrenzen. Dit maakt taken zoals zoek- en reddingsacties, schade-inspecties en infrastructuurinspecties veiliger en effectiever, omdat drones beter kleine, cruciale details kunnen oppikken — zoals een gestrande persoon of een beschadigde kabel — precies op momenten waarop elke seconde telt.

Bronvermelding: Zhu, W., Chen, K. Real-time object detection for unmanned aerial vehicles based on vision transformer and edge computing. Sci Rep 16, 6814 (2026). https://doi.org/10.1038/s41598-026-37938-5

Trefwoorden: drones, objectdetectie, edge computing, vision transformer, realtime beeldvorming