Clear Sky Science · nl

Een lichtgewicht hybride netwerk voor perceptieverbetering bij infraroodbeeld superresolutie

Scherper warmtezicht voor alledaagse technologie

Infraroodcamera’s laten ons warmte “zien” in het donker, door mist heen of binnenin machines—maar de beelden die ze produceren zijn vaak wazig en weinig gedetailleerd. Dit artikel introduceert een nieuwe manier om die vage thermische beelden te verscherpen met behulp van kunstmatige intelligentie, zodat beveiligingscamera’s, medische scanners en industriële inspectie-instrumenten duidelijkere, betrouwbaardere informatie kunnen tonen zonder zwaardere of duurdere hardware.

Waarom infraroodbeelden moeilijk scherp te krijgen zijn

In tegenstelling tot smartphonecamera’s leggen infraroodsensoren onzichtbare warmtestraling vast in plaats van zichtbaar licht. Dat maakt ze onmisbaar in beveiliging, defensie, geneeskunde en apparaatbewaking, waar ze ’s nachts mensen kunnen detecteren, ontstekingen kunnen aanwijzen of oververhitte onderdelen kunnen onthullen. Infraroodsensoren hebben echter doorgaans een lage resolutie omdat hoogwaardige detectoren kostbaar en energie-intensief zijn. Softwarematige methoden, superresolutie genoemd, proberen een grove, laagresolutie afbeelding om te zetten in een scherpere. Traditionele neurale netwerken met convoluties zijn goed in het oppikken van lokale patronen zoals kleine randen, maar hebben moeite om te begrijpen hoe verschillende delen van de afbeelding zich over lange afstanden tot elkaar verhouden. Nieuwere op transformers gebaseerde netwerken kunnen dat bredere contextbegrip wel vastleggen, maar zijn zwaar, traag en missen vaak fijne details zoals dunne lijnen en texturen—juist de eigenschappen die belangrijk zijn voor kleine doelwitten in infraroodsituaties.

Het samenvoegen van twee manieren van waarnemen

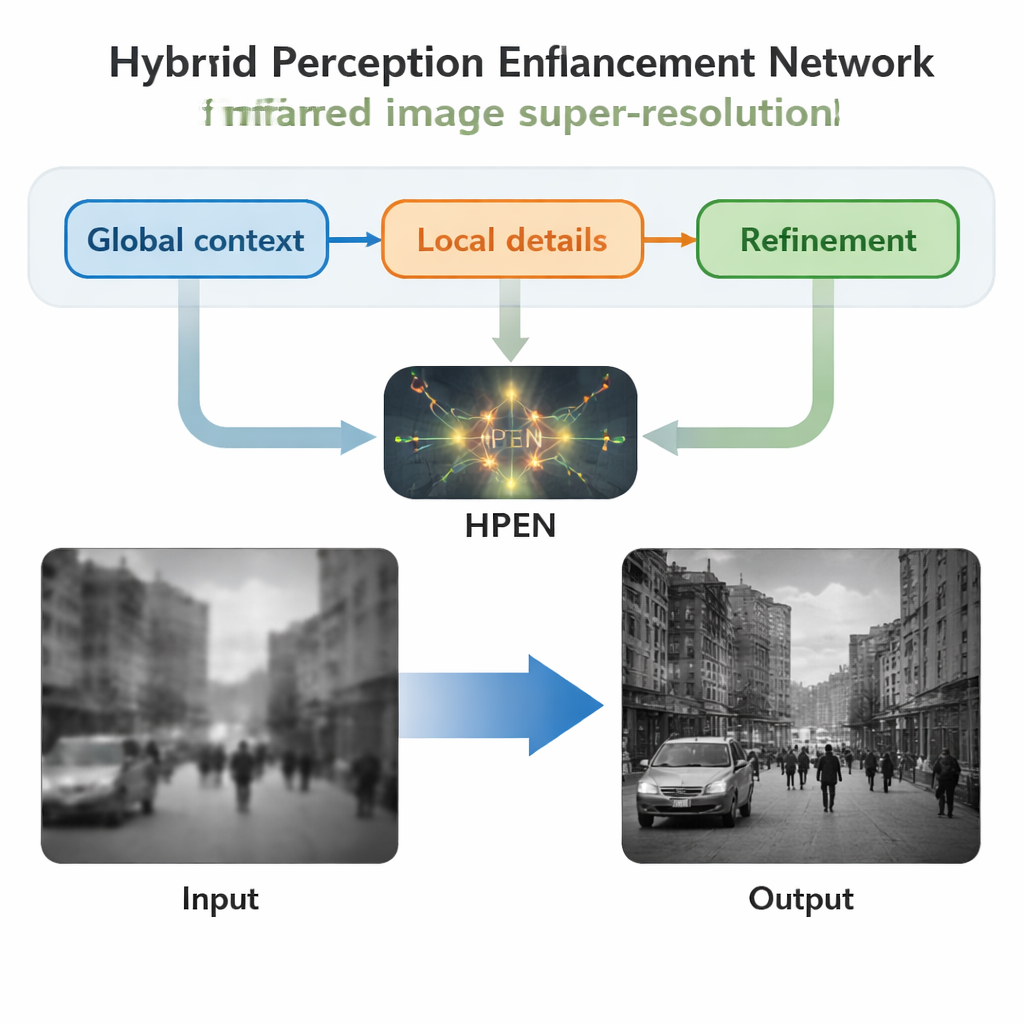

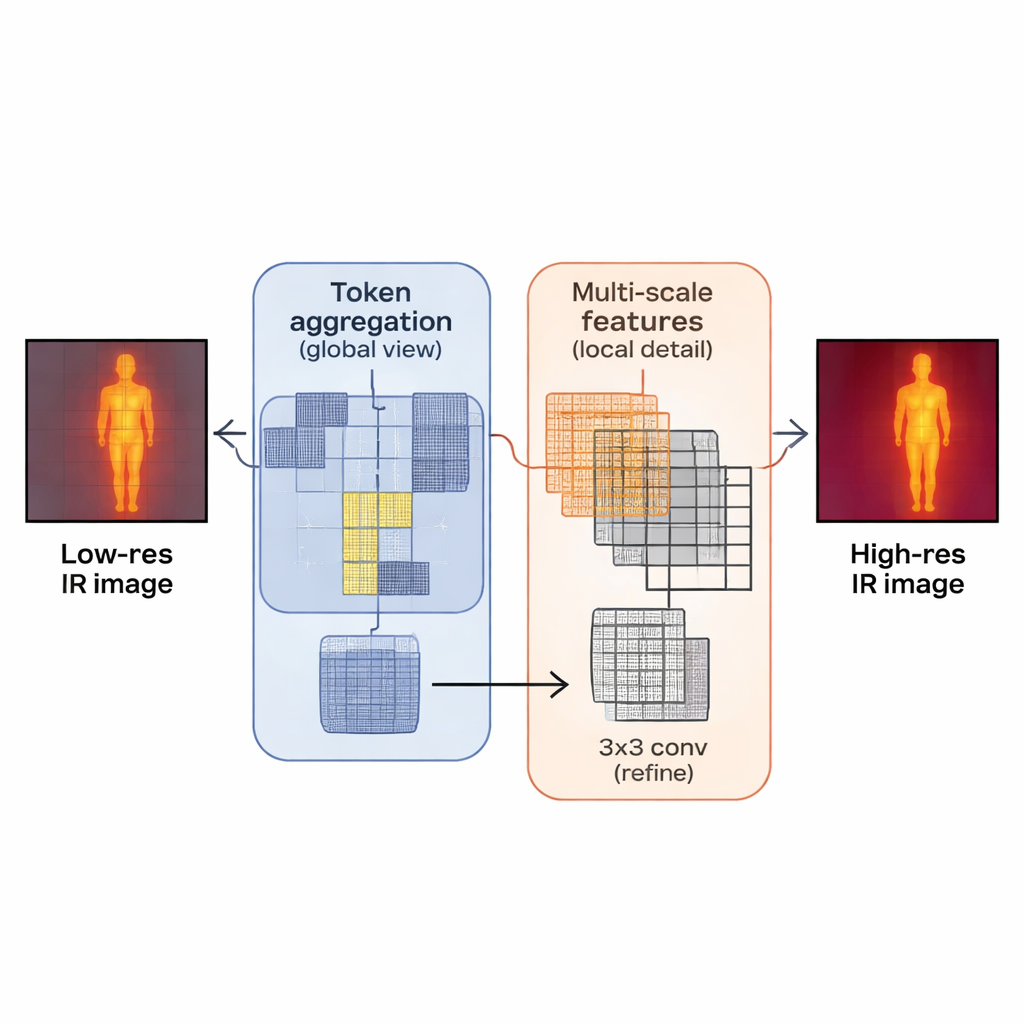

De auteurs stellen een nieuw model voor, het Hybrid Perception Enhancement Network (HPEN), specifiek ontworpen om detail en efficiëntie voor infraroodbeelden in balans te brengen. De centrale bouwsteen, het Hybrid Perception Enhancement Block, combineert drie ideeën achtereenvolgens. Ten eerste groepeert een fase van “tokenaggregatie” vergelijkbare beeldpatches zodat het netwerk op globaal niveau over de scène kan redeneren, vergelijkbaar met het clusteren van gerelateerde regio’s voordat wordt bepaald wat ze betekenen. Ten tweede gebruikt een fase met “multiscale features” parallelle verwerkingspaden om zowel kleine, fijne structuren als iets grotere buurten te bekijken, waardoor het netwerk randen, texturen en bredere vormen tegelijkertijd kan bijhouden. Ten slotte verfijnt een eenvoudige 3×3-filter de features en maakt ze schoon, waardoor de gladmakende bijwerkingen die grote, globale operaties kunnen introduceren worden tegengegaan.

Binnenin de nieuwe verscherpingsmotor

Als je naar het volledige HPEN-systeem kijkt, begint het proces met een lichte verwerking van de laagresolutie infraroodafbeelding om basispatronen te extraheren. Die informatie wordt vervolgens door een serie van de hybride blokken geleid, waarbij elk blok het begrip van de scène verdiept door het combineren van langstrekkende relaties met kleinschalige details. Een shortcut-verbinding laat de oorspronkelijke grove informatie deze diepere lagen passeren, zodat het netwerk zijn inspanningen kan richten op het reconstrueren van de ontbrekende hoogfrequente inhoud—dingen als scherpe randen en kleine hete plekken. In de laatste fase schaalt een compact upsampling-module de features terug naar de doelresolutie en zet ze om in een verscherpte infraroodafbeelding van hetzelfde formaat als een hoogwaardige referentie. Door het ontwerp is het systeem opzettelijk lichtgewicht, met een laag aantal bewerkingen en geheugenverbruik zodat het praktisch inzetbaar is op gangbare grafische processors.

Hoe goed de methode in de praktijk werkt

Om HPEN te testen hebben de auteurs het getraind en geëvalueerd op meerdere openbare infrarooddatasets met stadsgezichten, vegetatie, voertuigen, voetgangers en nachtelijke omstandigheden. Ze vergeleken het met veel recente “lichtgewicht” superresolutiemethoden die zowel nauwkeurig als efficiënt willen zijn. HPEN presteerde consequent gelijk aan of iets beter dan deze rivalen op standaard kwaliteitsmaatstaven die meten hoe dicht de verscherpte afbeelding bij een hoge-resolutie referentie ligt. Het was vooral sterk bij de moeilijkere viermaal vergrotingsinstelling, waar het vergroten van een zeer kleine afbeelding naar een veel groter formaat vaak artefacten onthult. Ondanks deze nauwkeurigheid gebruikte HPEN aanzienlijk minder berekeningen, veel minder grafische-kaartgeheugen en bood het snellere verwerkingstijd dan sterke transformer-gebaseerde concurrenten. Aanvullende testen die naar gepercipieerde, mensachtige beeldkwaliteit keken toonden dat HPEN’s resultaten er het meest leken op echte hoge-resolutie infraroodbeelden, met minder uitgewassen randen en beter behouden texturen.

Wat dit betekent voor toepassingen in de echte wereld

Voor een niet-specialist is de kernboodschap dat HPEN een slimmer manier biedt om de “zoom” van thermische camera’s te verbeteren zonder de hardware te wijzigen. Door zorgvuldig globale context (het hele tafereel begrijpen) te combineren met lokale details (kleine randen en texturen behouden) in een efficiënt pakket, produceert de methode scherpere, informatiefere infraroodbeelden terwijl de rekenkosten onder controle blijven. Dit kan helpen dat bewakingssystemen mensen of voertuigen duidelijker in het donker detecteren, industriële inspecteurs fijne scheurtjes of hete plekken op apparatuur beter zien, en artsen helderdere thermische patronen geven bij niet-invasieve screening—allemaal met bestaande sensoren die plotseling meer zien dan voorheen.

Bronvermelding: Liu, Z., Tian, J., Liu, C. et al. A lightweight hybrid perception enhancement network for infrared image super-resolution. Sci Rep 16, 6572 (2026). https://doi.org/10.1038/s41598-026-37763-w

Trefwoorden: infraroodbeeldvorming, superresolutie, deep learning, beeldverbetering, computer vision