Clear Sky Science · nl

Adaptief reinforcement-learningkader voor duurzame optimalisatie van microgrids in droge stedelijke omgevingen

De lichten aanhouden in een woestijnstad

Stel je voor dat je een moderne stad beheert waar de zomerdagen regelmatig boven de 40°C uitkomen, airconditioners onafgebroken draaien en de elektriciteitslijnen onder zware belasting staan. Dat is het dagelijks leven in plaatsen zoals Riyad, Saoedi-Arabië. Dit artikel onderzoekt hoe een nieuw soort slim regelsysteem, geïnspireerd op de manier waarop computers leren complexe videospellen te spelen, zonne‑panelen, windturbines, batterijen, dieselgeneratoren en het hoofdnet kan coördineren om zo’n stad goedkoper en met minder vervuiling van stroom te voorzien.

Waarom kleine netwerken ertoe doen

In plaats van alleen te vertrouwen op enorme elektriciteitscentrales ver weg, stappen veel steden over op "microgrids" — kleine, lokale netwerken die verschillende energiebronnen combineren en zelfs stroom met buren kunnen delen. In hete, droge regio’s is dit extra belangrijk: de vraag naar koeling schiet op en neer met het weer, zonne‑energie komt in pieken overdag en wind kan zwak of onvoorspelbaar zijn. Traditionele regelsystemen volgen vaak vaste regels of schema’s. Ze reageren niet goed op plotselinge veranderingen, zoals een piek in airconditioninggebruik of een stofdag die de zon verduistert. Het gevolg is verspilde schone energie, meer brandstofverbruik van dieselgeneratoren en hogere rekeningen.

Een lerend brein voor het elektriciteitssysteem

De onderzoekers bouwden een gedetailleerd computermodel van vijf onderling verbonden microgrids die typische gebouwen en wijken in Riyad representeren — grote en kleine woningen, gemengde blokken en commerciële gebieden. Elk microgrid had zijn eigen mix van zonnepanelen, kleine windturbines, dieselback‑up en batterijopslag, plus een koppeling naar het bredere elektriciteitsnet. Met gebouw‑energiesoftware (EnergyPlus) genereerden ze uur‑voor‑uurdata voor een heel jaar: hoeveel stroom mensen verbruikten, hoe warm het was, hoe sterk de zon scheen en hoe hard de wind blies. Daarbovenop voegden ze een reinforcement‑learning "agent" toe — een softwarebrein dat de staat van het systeem observeert (vraag, batterijladingsniveau, beschikbare zon en wind, generatorstatus) en beslist wat de volgende actie is: batterijen laden of ontladen, dieselgeneratoren in‑ of uitschakelen, stroom importeren of exporteren en energie tussen microgrids delen.

Hoe het systeem leert betere keuzes te maken

Reinforcement learning werkt via trial‑and‑error. In de simulatie probeert de agent uur na uur verschillende regelacties en ontvangt een beloning of straf op basis van wat er gebeurt. De beloning combineert drie eenvoudige ideeën: kosten laag houden, de stroomvoorziening garanderen en het vermijden van verspilling of het negeren van hernieuwbare energie. Als zijn beslissingen leiden tot duur dieselgebruik, stroomtekorten of ongebruikte zonne‑energie, krijgt de agent een straf. Als het lukt om vraag te dekken met meer zon en wind, minder emissies en stabiele werking, wordt hij beloond. Over tienduizenden trainingsronden ontdekt de agent geleidelijk strategieën die deze doelstellingen in balans brengen. Eenmaal getraind kan hij in realtime beslissingen nemen in slechts een paar duizendsten van een seconde.

Wat er gebeurt als de woestijn terugvecht

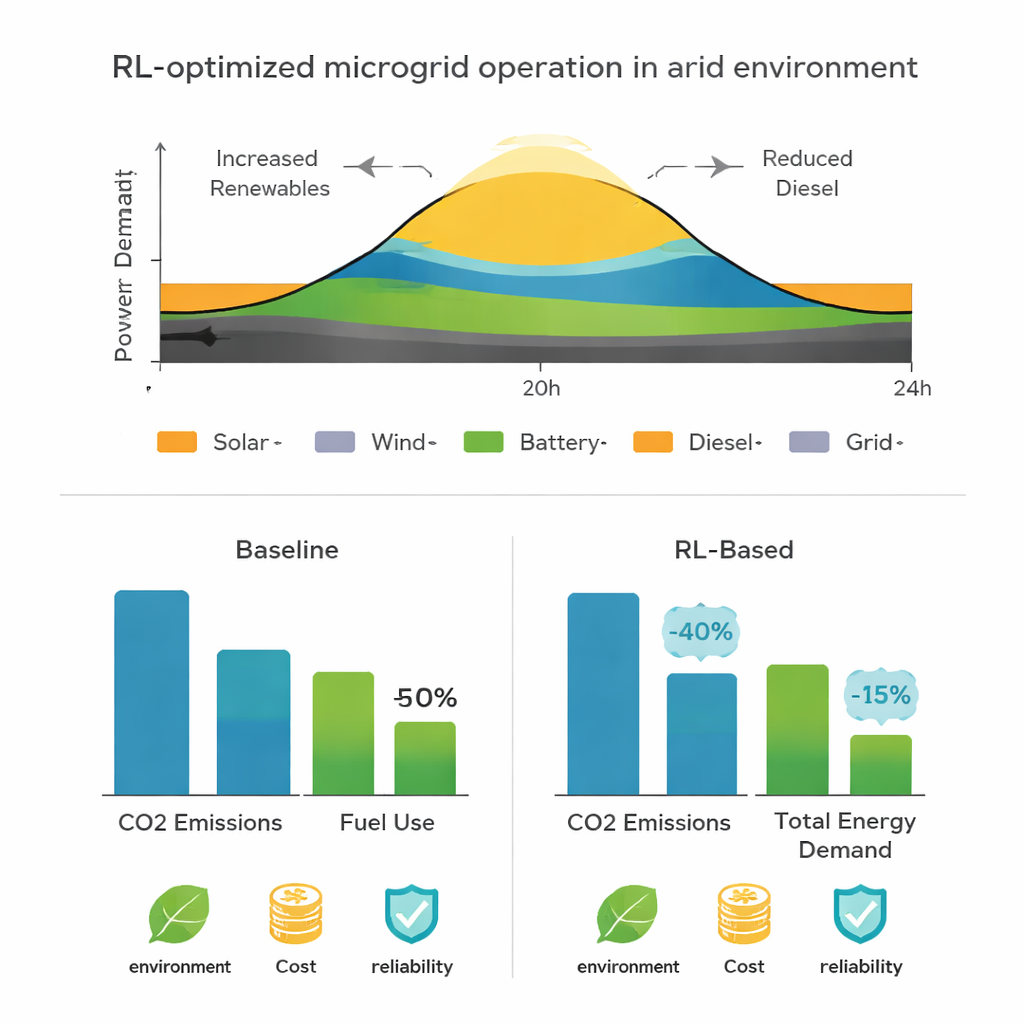

Om te testen of deze aanpak echt zou helpen in een zwaar klimaat, voerden het team proeven uit onder realistische en stressvolle omstandigheden. Het model reproduseerde de seizoensschommelingen van Riyad, met zware koeling in de zomer en mildere lasten in de winter. De op leren gebaseerde controller volgde zowel het uur‑ als het jaarverbruik nauwkeurig (verklaarde ongeveer 90–94% van de variatie), wat cruciaal is om pieken te voorspellen. Het verminderde energieverliezen over een typische dag en verschool meer van de levering naar zon en wind, waarbij batterijen werden gebruikt om tekorten glad te strijken. Toen de onderzoekers gebeurtenissen simulateerden zoals een zandstorm die plotseling zonne‑energie reduceerde of een hittegolf die de vraag scherp deed stijgen, reageerde het systeem door batterijen te ontladen, dieselgebruik te coördineren en overtollige energie tussen microgrids te delen — allemaal zonder gebruikers af te sluiten.

Schonere lucht en lagere rekeningen

Bovenop het garanderen van de stroomvoorziening onderzocht de studie de milieueffecten met een levenscyclusanalyse gericht op de dagelijkse operatie. Vergeleken met een traditioneel, regelgestuurd systeem sneed het adaptieve systeem de CO2‑emissies met ongeveer 14%, verminderde het verzurende vervuiling met ruwweg 14% en verlaagde het totale energieverbruik met ongeveer 10%. Deze winst komt voornamelijk doordat dieselgeneratoren minder vaak draaien en lokaal hernieuwbare energie en opslag beter worden benut. Simpel gezegd maakte het geven van een lerend brein aan het microgrid het mogelijk om meer nuttig werk uit elke eenheid schone energie te halen, minder op brandstof te vertrouwen en betrouwbaar te blijven zelfs wanneer het woestijnklimaat zich misdraagt.

Bronvermelding: Mohamed, M.A.S., Almazam, K., Alzahrani, M. et al. Adaptive reinforcement learning framework for sustainable microgrid optimization in arid urban environments. Sci Rep 16, 7356 (2026). https://doi.org/10.1038/s41598-026-37752-z

Trefwoorden: microgrids, reinforcement learning, hernieuwbare energie, energiebewaking, droge steden