Clear Sky Science · nl

Algoritme voor het samenvoegen van infrarood- en zichtbare beelden op basis van NSCT en verbeterde FT-saliencydetectie

Zien in het donker en door rommel heen

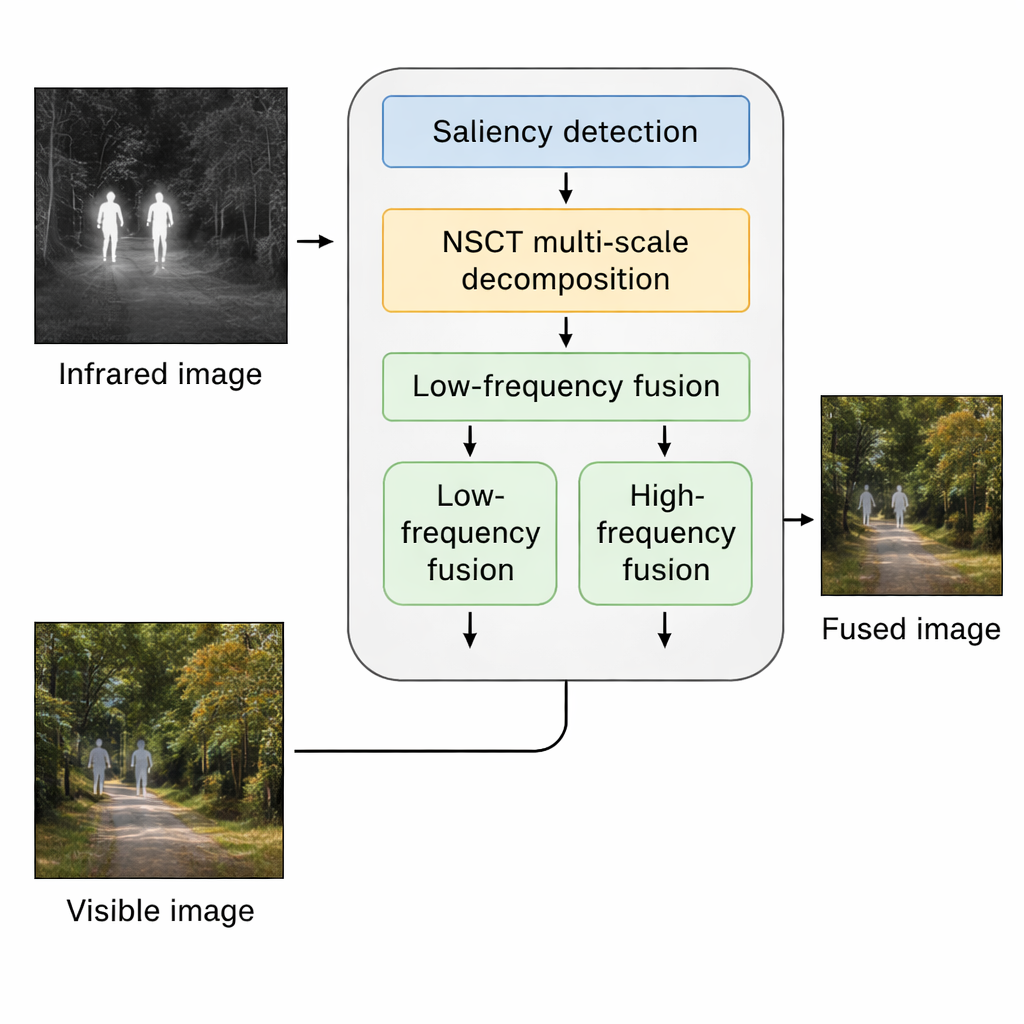

Moderne camera’s geven ons scherpe, kleurrijke beelden van de wereld, maar ze hebben moeite in mist, duisternis of bij fel tegenlicht—juist wanneer we betrouwbare waarneming het meest nodig hebben voor autorijden, bewaking, zoek‑en‑redding of drones. Infraroodsensoren, die warmte vastleggen in plaats van kleur, excelleren onder deze zware omstandigheden maar leveren vaak wazige, weinig gedetailleerde beelden op. Dit artikel presenteert een manier om infrarood‑ en zichtbaar‑lichtbeelden intelligent te combineren zodat het uiteindelijke beeld zowel scherpe details als duidelijk uitgelichte personen of objecten toont, zelfs in lastige scènes.

Waarom twee ogen beter zijn dan één

Zichtbare‑lichtcamera’s leggen fijne texturen en rijke achtergronden vast, maar hun prestaties kelderen ’s nachts of in zware schaduwen en doelobjecten kunnen opgaan in gelijkkleurige omgevingen. Infraroodcamera’s doen het omgekeerde: ze detecteren warme lichamen en warmte uitstralende objecten tegen donkere achtergronden, dag en nacht, maar verliezen veel subtiele structuur in gebouwen, bomen en wegen. Het samenvoegen van deze twee beeldtypen kan in principe het beste van beide werelden bieden. Veel bestaande fusie‑methoden vervagen echter contrast, doen objectranden verloren gaan of laten ruispatronen uit het infraroodbeeld de nuttige details uit het zichtbare beeld overheersen.

De kernidee: laat de belangrijke delen opvallen

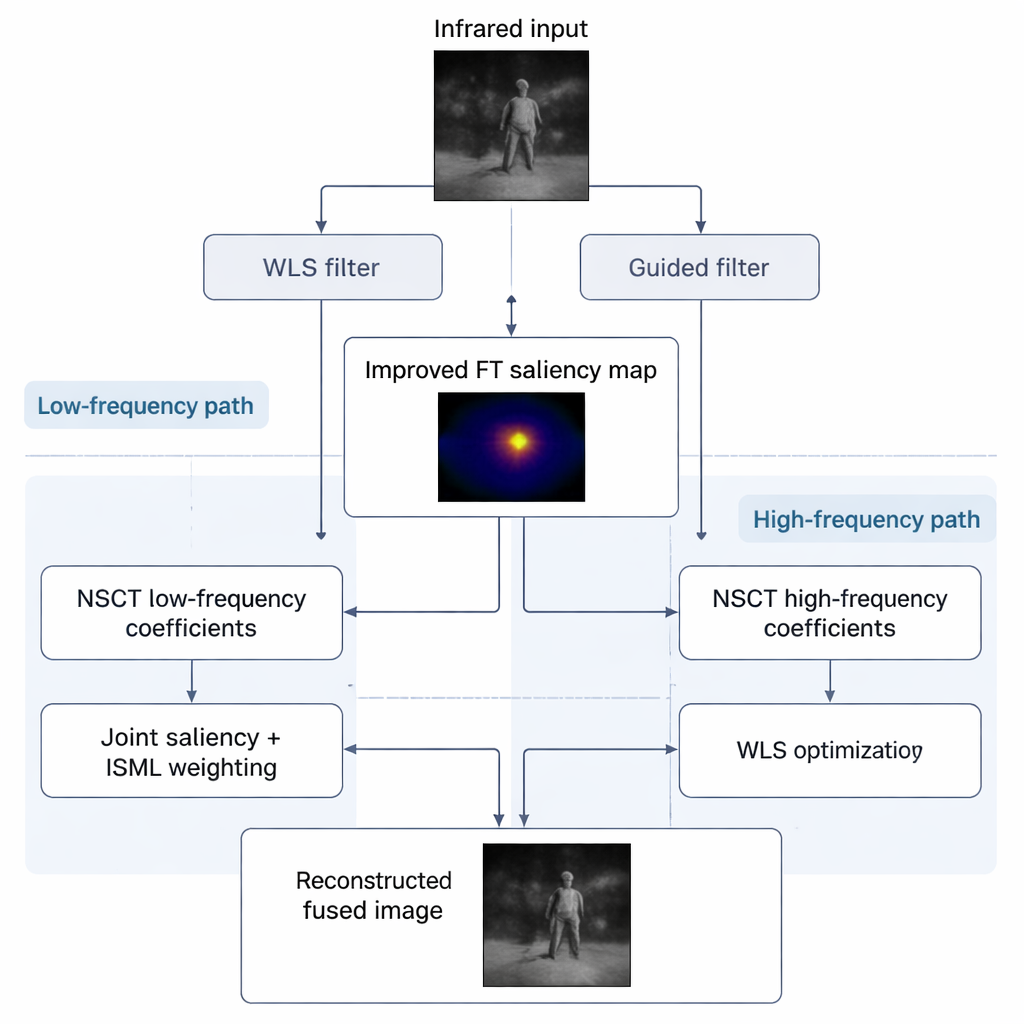

De auteurs benaderen fusie als een probleem van conflictresolutie tussen de twee beeldtypen. Ze richten zich op drie terugkerende kwesties: bepalen welke regio’s echt belangrijk zijn ("salient"), het balanceren van de algemene helderheid tussen warme infrarooddoelen en heldere zichtbare achtergronden, en het behouden van delicate texturen terwijl infraroodruis wordt onderdrukt. Om dit aan te pakken verfijnen ze een populaire techniek genaamd frequency‑tuned saliency detection, die probeert het menselijke visuele systeem na te bootsen door regio’s te markeren die automatisch onze aandacht trekken. In plaats van te vertrouwen op een eenvoudige vervaging gebruiken ze een paar slimmere filters—één die gladt maar randen behoudt, en een andere die het contrast versterkt—om een schonere, scherpere kaart te maken van waar de interessante infrarooddoelen zich bevinden.

Grove vormen en fijne details uit elkaar halen

Als het algoritme eenmaal weet waar de belangrijkste infrarooddoelen liggen, splitst het zowel de infrarood‑ als de zichtbare beelden in lagen die grove structuren van fijne details scheiden met behulp van een wiskundig hulpmiddel genaamd de Non‑Subsampled Contourlet Transform. De laagfrequente lagen bevatten brede helderheidspatronen, zoals lucht, wegen of muren, terwijl de hoogfrequente lagen randen, texturen en kleine kenmerken vastleggen. Voor de grove lagen mengt de methode informatie met behulp van zowel de verbeterde infraroodsaliency‑kaart als een Laplaciaanse maat voor scherpte van lokale structuren. Dit helpt te voorkomen dat beelden uitgewassen raken doordat ofwel de warme objecten de scène overheersen ofwel de zichtbare achtergrond belangrijke doelen verdringt.

Texturen scherp houden, ruis onder controle

De hoogfrequente lagen vereisen een andere strategie, omdat daar zowel nuttige textuur als storende ruis aanwezig is. Hier kiest de methode eerst per regio welke sensor sterker lokaal detail biedt. Vervolgens verfijnt ze die initiële keuze met een gewogen kleinste‑kwadraten‑procedure die de voorkeur geeft aan de schonere, informatiever zichtbare texturen, terwijl zinvolle infraroodpatronen nog steeds worden doorgelaten. Het resultaat is een gefuseerd beeld waarin takken, gebouwranden en wegmarkeringen er scherp uitzien, maar gespetterde infraroodartefacten verminderd zijn.

Beter beeld, betere machinale beslissingen

Het team testte hun aanpak op verschillende openbare datasets en hun eigen beelden bij weinig licht, en vergeleek het met traditionele technieken en moderne deep‑learningmethoden. Menselijke beoordeling toonde aan dat hun gefuseerde beelden helderdere achtergronden, hoger contrast en duidelijkere doelen hadden, vooral in schemerige gangen, straten ’s nachts en rommelige buitenomgevingen. Objectieve maten voor informatiedichtheid, scherpte en contrast gaven meestal de voorkeur aan de nieuwe methode of toonden dat deze goed in balans was over de verschillende meetwaarden. Cruciaal is dat, wanneer deze gefuseerde beelden werden gevoerd aan een populair objectdetectiesysteem (YOLOv5s), de detectie‑nauwkeurigheid, precisie en recall allemaal merkbaar verbeterden. In gewone woorden: het algoritme maakt niet alleen fraaiere beelden; het helpt ook geautomatiseerde systemen betrouwbaarder mensen en objecten te vinden. Dit suggereert dat slimere fusie van infrarood‑ en zichtbare beelden een sleutelrol kan spelen in veiliger autonoom rijden, effectievere bewaking en betrouwbaardere robots die in het donker of in visueel complexe omgevingen opereren.

Bronvermelding: Fan, X., Kong, F., Shi, H. et al. Infrared and visible image fusion algorithm based on NSCT and improved FT saliency detection. Sci Rep 16, 7144 (2026). https://doi.org/10.1038/s41598-026-37670-0

Trefwoorden: infrarood-zichtbare fusie, beeldsalientie, multi-sensor imaging, nachtzicht, computer vision