Clear Sky Science · nl

Cognitieve modellen vergemakkelijken realtime afleiding van latente motieven

Waarom het raden van verborgen doelen ertoe doet

Dagelijks lees je stilletjes de intenties van mensen om je heen — of een automobilist van plan is naar jouw rijstrook te wisselen, of een fietser zal stoppen, of een collega probeert te helpen of te concurreren. Deze beslissingen in een fractie van een seconde berusten op het interpreteren van verborgen motieven uit zichtbare bewegingen. Hedendaagse kunstmatige intelligentie kan zeer nauwkeurig voorspellen, maar fungeert vaak als een “black box” die niet kan uitleggen waarom een beslissing is genomen. Deze studie onderzoekt of psychologische modellen van menselijk gedrag AI een menselijker gevoel voor andermans motieven kunnen geven, waardoor die sneller, nauwkeuriger en makkelijker te vertrouwen wordt.

Een eenvoudig spel van achtervolgen en ontwijken

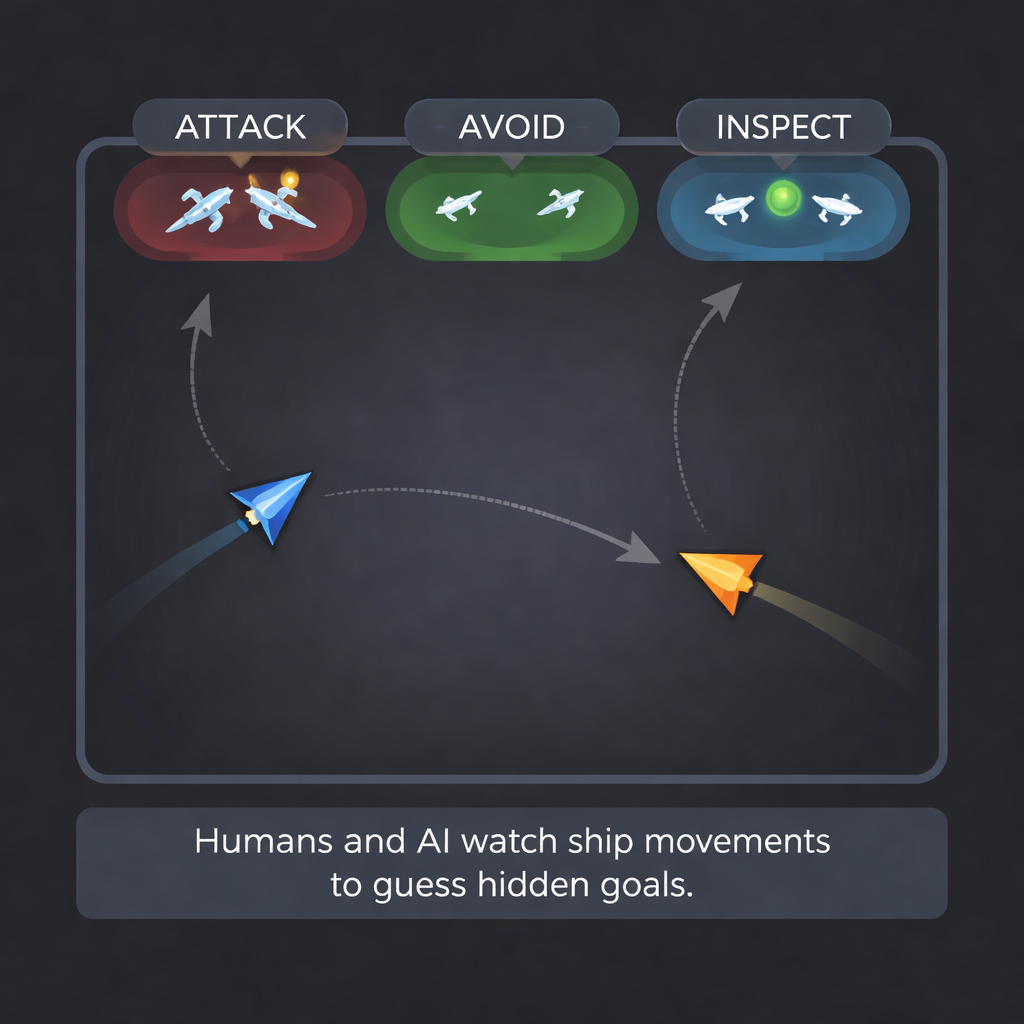

Om dit te onderzoeken bouwden de onderzoekers een uitgekleed videospel. In elke ronde van 10 seconden stuurde een menselijke speler een driehoekig “schip” met een joystick, terwijl een computerbestuurd schip volgens één van meerdere patronen bewoog. De mens kreeg in het geheim één van drie doelen toegewezen: Aanvallen (botsen met het andere schip), Ontwijken (ver van het andere schip blijven) of Inspecteren (in de buurt blijven zonder te botsen). Het computerschip kon agressief, schuw, nieuwsgierig, defensief of gewoon rondzwerven gedragen. Deze combinaties creëerden situaties waarin de bewegingen van de schepen elkaar opstelden of tegenwerkten — bijvoorbeeld een aanvallende mens die een schuw computer schip achterna zit dat steeds probeert te vluchten.

Hoe goed mensen verborgen doelen lezen meten

De eerste stap was te achterhalen hoe goed mensen zelf motieven uit beweging kunnen aflezen. Het team nam gameplay van de acht best presterende piloten en maakte van elke ronde een korte video. Nieuwe vrijwilligers keken deze clips en moesten het doel van de menselijke speler raden — aanvallen, ontwijken of inspecteren — na slechts 1, 4, 7 of 10 seconden beweging gezien te hebben. Over meerdere groepen, inclusief deelnemers met en zonder autisme-diagnose, identificeerden mensen het doel ongeveer tweederde van de keren correct. De nauwkeurigheid nam toe naarmate ze meer van de ronde zagen, en de prestaties waren vergelijkbaar tussen de groepen, wat een solide menselijke referentie geeft voor vergelijking.

Een psychologisch blauwdruk voor beweging

In plaats van ruwe video-achtige data direct in een neuraal netwerk te voeren, bouwden de auteurs een cognitief model om de krachten vast te leggen die iemands beweging zouden kunnen aansturen. Hun “global-local objective pursuit” (GLOP) model gaat ervan uit dat een speler meerdere trekken tegelijk afweegt: een voorkeursafstand tot de tegenstander bewaren (te dichtbij voelt gevaarlijk, te ver mist kansen), op gunstige posities op het scherm blijven in plaats van opgesloten in een hoek, en het tempo en de richting van het andere schip matchen of anticiperen. Deze factoren worden gecombineerd tot een enkele “motivationale” bewegingsrichting, met extra termen om te reflecteren hoe vloeiend mensen bewegen en hoeveel willekeur er in hun besturing zit.

AI leren geesten lezen uit beweging

Om dit model in realtime bruikbaar te maken, simuleerden de onderzoekers 100.000 spelrondes met veel verschillende instellingen van de GLOP-parameters. Ze trainden vervolgens een recurrent neuraal netwerk om reeksen schipposities binnen te krijgen en snel de verborgen parameters te schatten — zoals voorkeursafstand of hoe sterk iemand geeft om globale positie. Dit netwerk kon meerdere sleutelparameters zeer nauwkeurig terugvinden na slechts enkele seconden beweging. Daarna trainden ze een set classificerende netwerken om het doel van de speler op drie verschillende manieren te raden: direct uit ruwe positiedata, uit eenvoudige samenvattende statistieken (zoals gemiddelde afstand en naderen versus vermijden), of uit de door het cognitieve model afgeleide parameters. Ten slotte bouwden ze “ensemble”-classifiers die deze bronnen combineerden.

De menselijke referentie verslaan

Alle AI-classifiers evenaarden of overtroffen de menselijke prestaties, maar de manier waarop informatie voorbewerk werd, deed ertoe. Netwerken die alleen op ruwe beweging of alleen op modelparameters vertrouwden, presteerden vergelijkbaar met mensen, rond de 66% nauwkeurigheid. Classifiers die eenvoudige samenvattende statistieken kregen deden het beter, en de beste resultaten kwamen van het combineren van die statistieken met de parameters van het cognitieve model, met ongeveer 72% nauwkeurigheid. Deze modelgeïnformeerde systemen trainden ook sneller en stabieler dan die welke alleen ruwe data kregen. Wanneer de nauwkeurigheid moment voor moment tijdens elke ronde werd bijgehouden, kon de AI zijn gok over het verborgen doel van een speler bijwerken in minder dan de tijd tussen beeldverversingen, en zo feitelijk intentie in realtime afleiden.

Wat dit betekent voor alledaagse AI

Voor een leek is de conclusie dat het verweven van psychologische theorie met AI machines kan helpen niet alleen te begrijpen wat mensen doen, maar waarom ze het doen. Door rommelige bewegingen te vertalen naar een kleine set interpreteerbare motieven — zoals hoe dichtbij iemand wil zijn of hoe iemand veiligheid tegen kansen afweegt — wordt het systeem zowel nauwkeuriger als makkelijker te verklaren. In toekomstige toepassingen zoals zelfrijdende auto’s of mens–AI teams kan dit soort “cognitieve frontend” AI helpen de intenties van andere agenten eerder en betrouwbaarder te anticiperen, mogelijk botsingen en misverstanden te voorkomen en tegelijk mensvriendelijke verklaringen te bieden zoals “de andere bestuurder probeert waarschijnlijk in te voegen, niet alleen te driften.”

Bronvermelding: Fitch, A.K., Kvam, P.D. Cognitive models facilitate real-time inference of latent motives. Sci Rep 16, 6444 (2026). https://doi.org/10.1038/s41598-026-37587-8

Trefwoorden: theory of mind, cognitieve modellering, intentie-afleiding, mens–AI interactie, verklaarbare AI