Clear Sky Science · nl

Een nieuwe reinforcement-learningbenadering voor kortetermijnvoorspelling van verbruik en prijzen op energiemarkten

Waarom het voorspellen van morgen’s elektriciteitsgebruik ertoe doet

Elke keer dat u een lichtschakelaar omzet, werkt een uitgebreid netwerk van energiecentrales, markten en computers achter de schermen om stroom beschikbaar en betaalbaar te houden. Als netbeheerders nauwkeurig kunnen voorspellen hoeveel elektriciteit mensen de komende uren zullen gebruiken en hoe de prijzen zich zullen bewegen, kunnen ze black-outs vermijden, verspilling verminderen en iedereen geld besparen. Dit artikel onderzoekt een nieuwe methode om die kortetermijnvoorspellingen te maken met technieken die oorspronkelijk zijn ontwikkeld om te leren spelletjes te spelen en robots te besturen.

Slimmere schattingen voor een veranderende energiewereld

De vraag naar elektriciteit en de prijzen kunnen van uur tot uur sterk schommelen. Hittegolven, koudeperiodes, feestdagen en brandstofkosten duwen het systeem alle kanten op. Traditionele voorspellingsinstrumenten, zoals eenvoudige trendlijnen of zelfs standaard machine-learningmodellen, behandelen het probleem vaak als een eenmalige aanpassing aan historische data. Ze hebben moeite wanneer omstandigheden snel veranderen of wanneer veel factoren op complexe manieren met elkaar interageren. De auteurs betogen dat moderne netten, vooral met een groeiend aandeel hernieuwbare energie, voorspellingsinstrumenten nodig hebben die zich ter plaatse kunnen aanpassen en direct leren van hun successen en fouten.

Een lerende agent op de energiemarkt

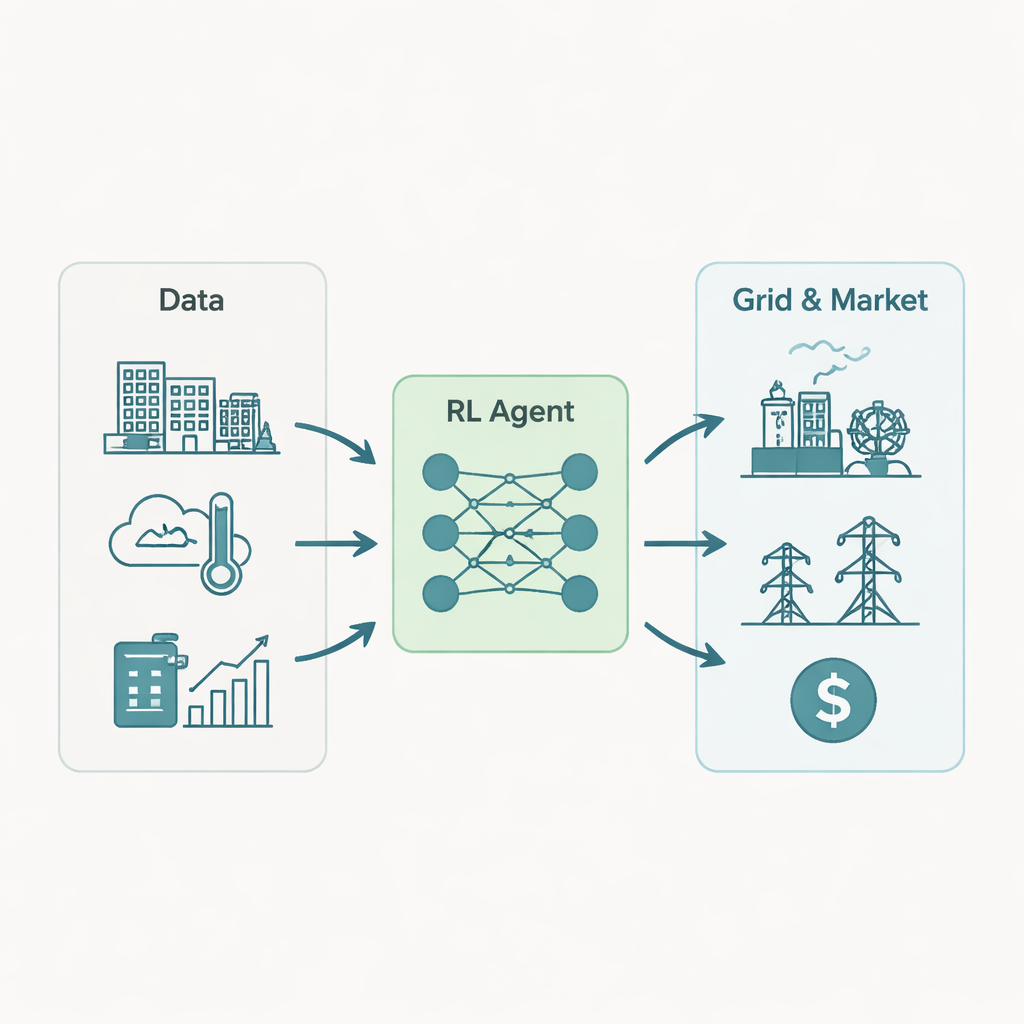

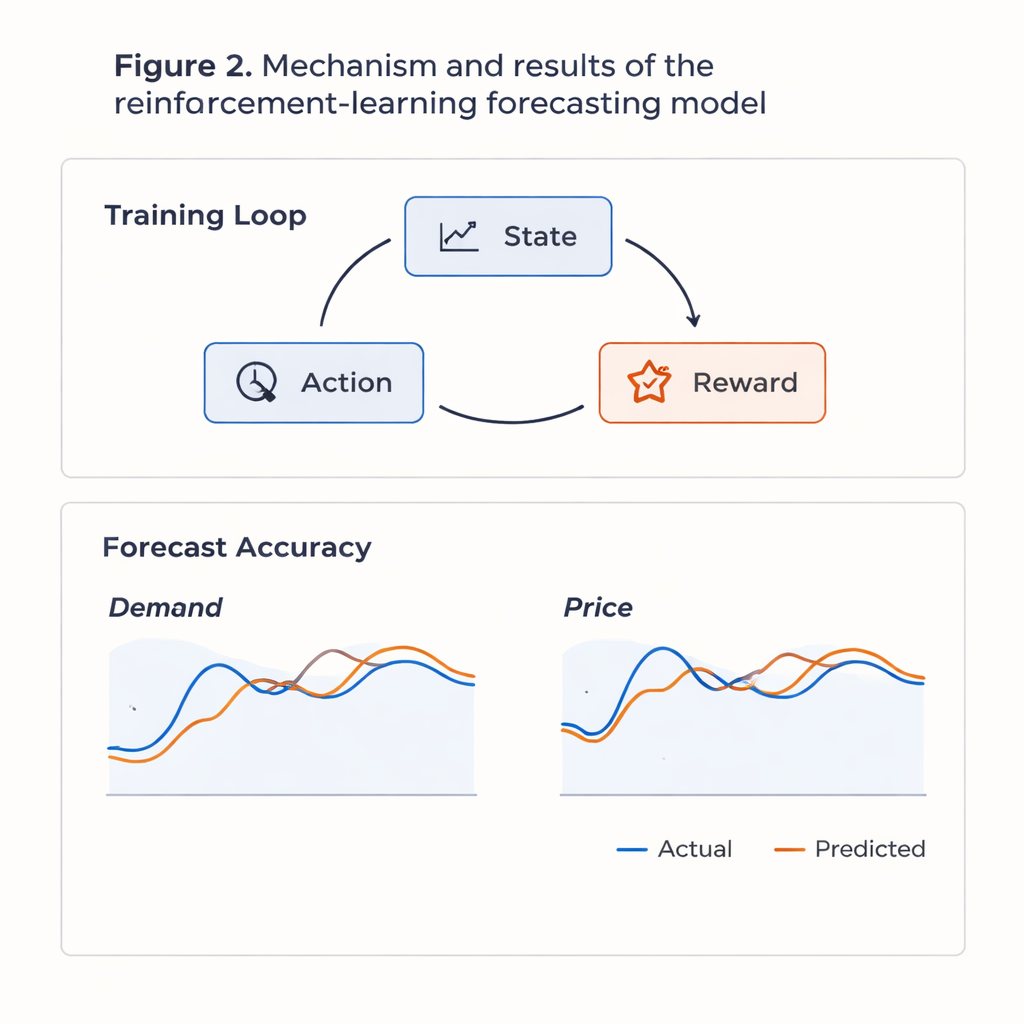

De onderzoekers beschouwen voorspelling als een beslissingsspel. Elk uur ziet een computer “agent” de huidige situatie: recente elektriciteitsvraag, eerdere prijzen, temperatuur, luchtvochtigheid, dag van de week, feestdagen en brandstofkosten. Vervolgens kiest het een actie: zijn beste schatting voor de elektriciteitsvraag en prijs in het volgende uur. Zodra de werkelijke waarden bekend zijn, ontvangt de agent een score op basis van hoe ver hij ernaast zat—grote fouten worden bestraft, kleine fouten beloond. In de loop van de tijd zoekt het systeem naar een strategie die zijn langetermijnscore maximaliseert, niet alleen de nauwkeurigheid van een enkel voorspeld uur. Om met de vele invoervariabelen om te gaan, gebruiken de auteurs een deep reinforcement learning-opzet gebaseerd op een Deep Q‑Network, een type neuraal netwerk dat inschat hoe waardevol elke mogelijke actie in elke situatie is.

Van ruwe data naar betrouwbare voorspellingen

Om hun benadering te testen, gebruikte het team data uit de praktijk van de PJM Interconnection, een grote Amerikaanse energiemarkt die delen van het Midwesten en de oostkust omvat. Ze gebruikten ongeveer drie jaar aan uurlijkse gegevens (2021–2023), inclusief marktprijzen, elektriciteitsvraag, weerswaarnemingen en brandstofprijsindices. Voor de training schonken ze de data, vulden de zeldzame ontbrekende waarden aan, verwijderden ongebruikelijke uitschieters en schaaldeden alles naar vergelijkbare bereiken. Ze gebruikten ook statistische technieken om de grote set invoerkenmerken te comprimeren terwijl ze het merendeel van de nuttige variatie behielden. De lerende agent werd vervolgens getraind met herhaalde doorgangen over deze geschiedenis, waarbij hij geleidelijk verschuift van willekeurig proberen en fout, naar het benutten van de patronen die hij had ontdekt.

Hoe goed presteerde de lerende agent

In vergelijking met veelgebruikte voorspellingsmethoden—waaronder ARIMA (een traditioneel tijdreeksmodel), LSTM-neurale netwerken en het populaire XGBoost-algoritme—kwam het reinforcement-learning systeem als winnaar uit de bus. Op afgeschermde testgegevens die het model nooit eerder had gezien, verminderde het de gemiddelde procentuele fouten in vraag en prijs met ongeveer 15–20 procent vergeleken met deze baseline-methoden. De voorspellingen volgden zowel de dagelijkse winter- als zomercycli nauw en volgden algemene prijsschommelingen, hoewel het model nog moeite had met de scherpste, zeldzame prijsuitbarstingen en ongebruikelijk gedrag tijdens feestdagen. Analyse van de geleerde strategie toonde aan dat de agent impliciet een economisch zinvol patroon ontdekte: na het waarnemen van zeer hoge prijzen neigde hij te verwachten dat de vraag het volgende uur iets lager zou zijn, wat reële vraagrespons imiteert zonder dat dit expliciet werd aangegeven.

Wat dit betekent voor alledaags energiegebruik

Voor niet‑specialisten is de kernboodschap dat deze op leren gebaseerde aanpak netbeheerders kan helpen energiesystemen soepeler en goedkoper te laten draaien. Nauwkeurigere kortetermijnvoorspellingen stellen producenten en marktoperatoren in staat centrales efficiënter in te plannen, hernieuwbare bronnen met minder verrassingen te integreren en het risico op plotselinge prijsstijgingen of tekorten te verkleinen. Hoewel de methode veel data en rekenkracht vraagt en nog verfijning nodig heeft voor extreme gebeurtenissen, wijst ze op een toekomst waarin elektriciteitsmarkten worden gestuurd door adaptieve, zichzelf verbeterende tools die continu leren van het steeds veranderende gedrag van consumenten, het weer en brandstofkosten.

Bronvermelding: Wu, Y., Ma, Y. & Aliev, H. A novel reinforcement learning-based approach for short-term load and price forecasting in energy markets. Sci Rep 16, 5141 (2026). https://doi.org/10.1038/s41598-026-37366-5

Trefwoorden: voorspelling slimme netten, voorspelling elektriciteitsprijzen, reinforcement learning, voorspelling energievraag, deep Q-netwerk