Clear Sky Science · nl

De bemiddelende rol van blootstelling aan kunstmatige intelligentie bij adverse childhood experiences: gerelateerde risico's voor de geestelijke gezondheid onder studenten

Waarom de vroege levensfase en slimme hulpmiddelen ertoe doen

Veel studenten dragen onzichtbare littekens van moeilijke jeugdjaren—zoals mishandeling, verwaarlozing of opgroeien in een problematisch gezin. Tegelijkertijd behoren zij tot de grootste gebruikers van kunstmatige intelligentie: van chatbots voor studiehulp tot AI-metgezellen voor gesprekken in de late uren. Deze studie stelt een actuele vraag: wanneer studenten met pijnlijke vroege ervaringen zich op AI richten, verlicht dat hun last—of voegt het juist stilletjes toe aan hun psychische belasting?

Opgroeien met ontbering

De onderzoekers richtten zich op “adverse childhood experiences”, oftewel ACEs—gebeurtenissen zoals geweld, emotionele of fysieke verwaarlozing en ernstige gezinsproblemen vóór het 18e levensjaar. Eerder onderzoek heeft aangetoond dat hoe meer van deze gebeurtenissen iemand meemaakt, hoe groter het risico op angst, depressie en zelfs zelfmoordpogingen later in het leven. In wereldwijde enquêtes rapporteert een groot deel van de volwassenen, en een nog groter aandeel jongeren, minstens één dergelijke tegenslag. In China, waar deze studie plaatsvond, suggereert eerder onderzoek dat meer dan de helft van de studenten ten minste één ACE heeft meegemaakt. Dit zijn geen zeldzame uitzonderingen, maar een veelvoorkomende achtergrond van jongvolwassenheid.

Studenten, enquêtes en schermtijd

Om te onderzoeken hoe AI in dit plaatje past, ondervroeg het team 2.736 studenten van drie universiteiten in de provincie Jiangxi, China, in 2025. Studenten beantwoordden gedetailleerde vragen over hun jeugdervaringen, huidige niveaus van stress, angst, depressie, eenzaamheid, slaapkwaliteit en suïcidale gedachten. Ze rapporteerden ook hoeveel tijd ze dagelijks besteedden aan AI voor drie doeleinden: leren of werk (zoals het schrijven van papers of programmeerhulp), sociale interactie (chatten of zoeken naar gezelschap bij AI) en ontspanning (gamen of creatief spelen met AI). De onderzoekers gebruikten vervolgens statistische technieken om studenten met en zonder ACEs eerlijk te vergelijken, waardoor de twee groepen vergelijkbaar werden in leeftijd, geslacht, studie en andere achtergrondfactoren.

Zware lasten en digitale coping

De resultaten bevestigden een sobere constatering: studenten die in hun jeugd tegenspoed hadden meegemaakt, vertoonden hogere niveaus van eenzaamheid, stress, angst, depressie en suïcidale gedachten, en ze sliepen slechter dan hun leeftijdsgenoten. Maar de studie ging verder door de rol van AI te onderzoeken. Ze vonden dat AI-gebruik voor sociale interactie—niet voor studie of werk—werd gekoppeld aan slechtere geestelijke gezondheid. Studenten die meer tijd besteedden aan het chatten met AI of het zoeken naar virtueel gezelschap, voelden zich vaker depressief, angstiger, gestresster, eenzamer en rapporteerden vaker suïcidale gedachten. AI die voornamelijk voor leren of werk werd gebruikt, liet geen duidelijke relatie met geestelijke gezondheid zien, en AI voor ontspanning werd alleen geassocieerd met angst, niet met de andere problemen.

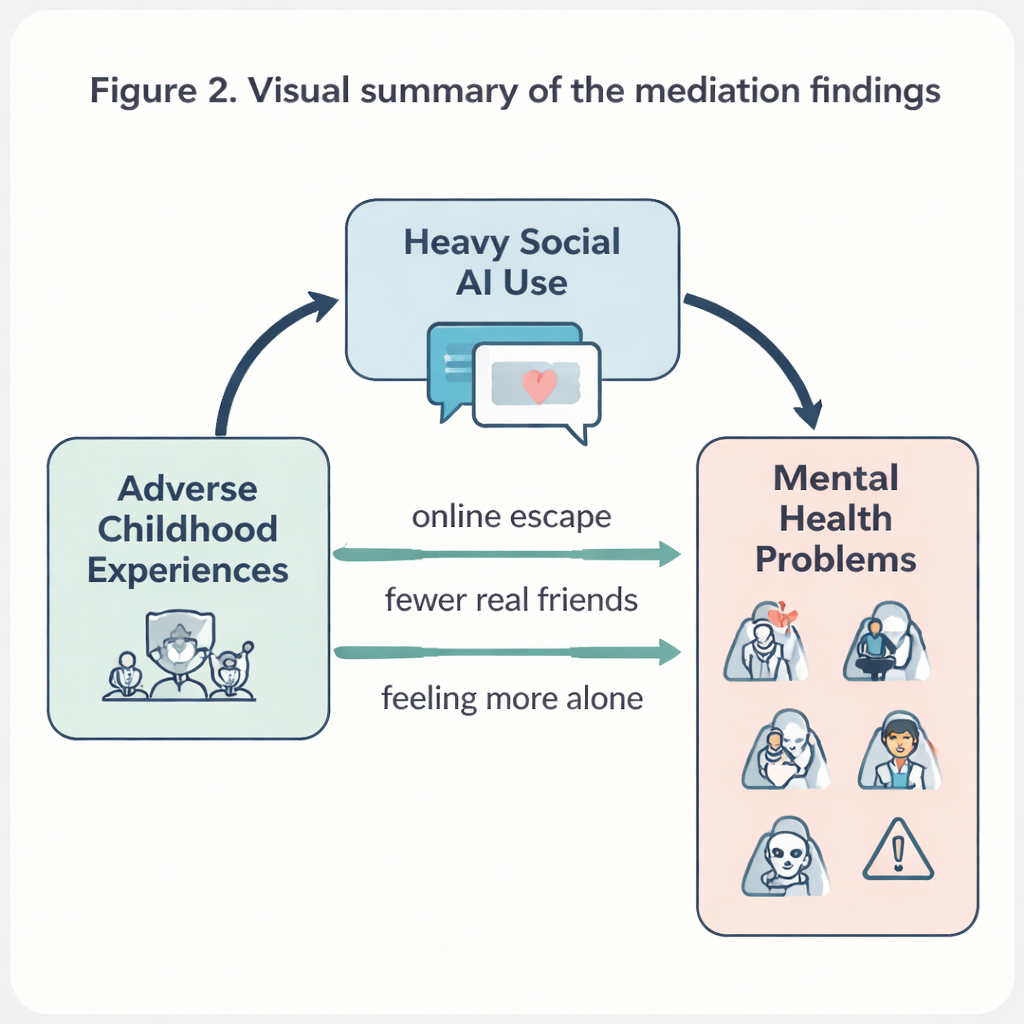

Wanneer online troost de pijn verdiept

Met een methode die mediatie-analyse wordt genoemd, onderzochten de onderzoekers of sociaal AI-gebruik fungeert als een soort brug die een deel van de impact van vroege tegenspoed op de huidige geestelijke gezondheid draagt. Ze vonden dat dit zo is—maar slechts gedeeltelijk. Voor studenten met ACEs verklaarde zwaarder sociaal AI-gebruik een klein maar betekenisvol deel van hun verhoogde eenzaamheid, stress, angst, depressie en suïcidale gedachten. Met andere woorden: pijnlijke jeugdervaringen hadden nog steeds een sterke directe invloed op de geestelijke gezondheid, maar sommige studenten leken ook te copen door zich tot AI-gezelschap te wenden, wat in plaats van genezing gekoppeld was aan slechtere gevoelens. Het patroon suggereert een cyclus: vroeg leed bemoeilijkt het sociale leven, studenten trekken zich terug in veiligere AI-gesprekken, en deze digitale ontsnapping kan isolement vergroten in plaats van verminderen.

Wat dit betekent voor studenten en hulpverleners

Voor een algemeen publiek is de conclusie niet dat AI per se “slecht” is, maar dat de manier waarop we het gebruiken ertoe doet, vooral voor jongeren die al risico lopen. In deze studie rapporteerde bijna drie op de tien studenten adverse childhood experiences, en die studenten hadden meer kans emotioneel te worstelen. Sociale AI leek hun problemen licht te versterken in plaats van te verlichten. De auteurs pleiten ervoor dat geestelijke gezondheidsprogramma’s aandacht besteden aan patronen van AI-gebruik, studenten helpen echte ondersteuning in de echte wereld op te bouwen en hen te begeleiden naar gezondere manieren om digitale middelen te gebruiken. Doordacht ontworpen therapeutische AI kan nog steeds voordelen bieden. Maar alledaagse chatbots, gebruikt als vervanging van menselijke verbinding, kunnen stilletjes de eenzaamheid en het leed verdiepen bij degenen die al het meest gekwetst zijn.

Bronvermelding: Wang, Y., Lv, M., Huang, R. et al. Mediation role of artificial intelligence exposure in adverse childhood experiences: related mental health risks among college students. Sci Rep 16, 6278 (2026). https://doi.org/10.1038/s41598-026-37352-x

Trefwoorden: adverse childhood experiences, geestelijke gezondheid van studenten, sociale AI-gebruik, eenzaamheid en angst, digitale coping