Clear Sky Science · nl

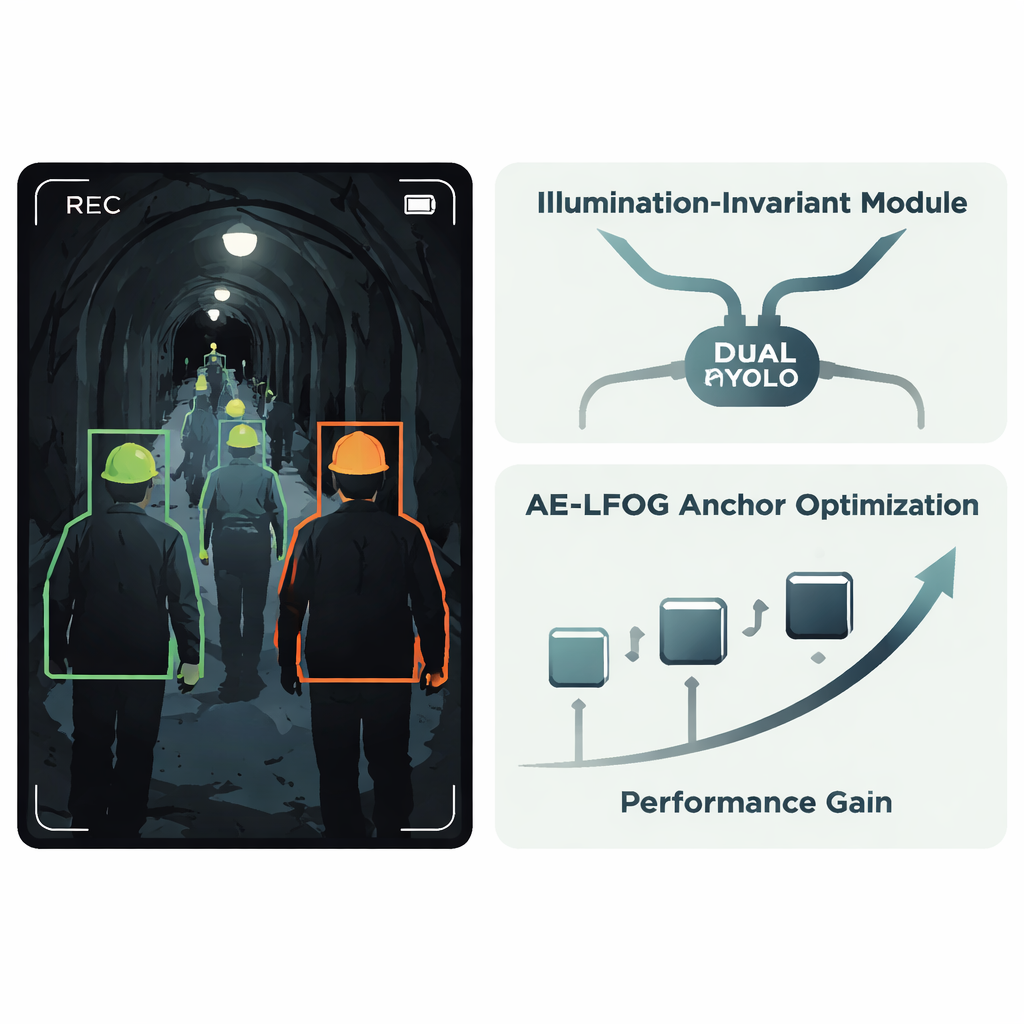

AE-LFOG-YOLO: robuuste veiligheidshelm‑detectie via adaptieve anchors en verlichting‑invariante learning

Waarom slimme helmcontroles ertoe doen

Op grote bouwprojecten en in ondergrondse tunnels kan een eenvoudige veiligheidshelm het verschil betekenen tussen een nipte gebeurtenis en een levensveranderend letsel. Toch vergeten mensen op drukke bouwplaatsen vaak een helm te dragen of doen dat expres niet, en menselijke toezichthouders kunnen niet elk hoekje altijd in de gaten houden. Deze studie onderzoekt hoe je een geautomatiseerd camerasysteem kunt bouwen dat betrouwbaar ziet wie wel en wie geen helm draagt, ook wanneer de tunnel donker is, verblind wordt door lampen of vol staat met arbeiders op verschillende afstanden van de camera.

Uitdagingen van zien onder harde tunnelverlichting

Tunnelbouwlocaties zijn visueel extreme omgevingen. Fel schijnende lampen veroorzaken schittering, terwijl diepe schaduwen details verbergen. Mensen bewegen naar en van de camera, waardoor helmen in zeer uiteenlopende maten lijken voor te komen. Standaard AI‑detectoren falen vaak onder deze omstandigheden: ze missen helmen in donkere zones, verwarren andere ronde objecten met helmen of hebben moeite met zeer kleine of verre personen. Veel bestaande systemen proberen dit op te lossen door beelden eerst op te helderen of te reinigen vóór detectie, of door enkele onderdelen van populaire YOLO‑modellen aan te passen. Omdat die maatregelen meestal losse toevoegingen zijn in plaats van onderdeel van één leerproces, laten ze prestatiepotentieel liggen en zijn ze minder robuust wanneer verlichting of scène‑opstelling verandert.

Een nieuwe manier om camera’s te leren slechte verlichting te negeren

De auteurs stellen een verbeterd systeem voor, AE‑LFOG‑YOLO, gebouwd op de veelgebruikte YOLOv8‑detector. Het eerste kernidee is een Illumination‑Invariant Module, een klein onderdeel in het netwerk dat leert “wat het licht doet” te scheiden van “hoe de objecten echt eruitzien.” Het splitst binnenkomende feature‑maps in een deel dat vooral lichtpatronen weerspiegelt en een deel dat stabielere vorm- en textuurkenmerken vastlegt, zoals de gebogen rand van een helm. Door speciale gating‑operaties en een tak die zich richt op randen en hoeken te gebruiken, dempt de module helderheidsschommelingen en benadrukt hij stabiele geometrie. Omdat dit binnen de detector gebeurt in plaats van in een aparte voorverwerkingsstap, kan het hele systeem end‑to‑end worden getraind om zich op de helmen zelf te concentreren in plaats van misleid te worden door plekken met schittering of duisternis.

Het model zijn eigen kijkgewoonten laten ontwikkelen

Het tweede hoofdidee richt zich op hoe de detector raadt waar objecten kunnen verschijnen. Veel detectoren starten met een vaste set “anchor boxes” die waarschijnlijke objectgroottes en -vormen suggereren; deze worden meestal één keer uit de trainingsdata gekozen en daarna niet meer aangepast. In tunnels kan de schijnbare grootte van een helm echter sterk veranderen door afstand en kijkhoek. AE‑LFOG‑YOLO vervangt statische anchors door een dynamisch proces genaamd Adaptive Evolutionary – Light Field Optimized Generation. Aan het einde van elke trainingsronde perturbeert het systeem de anchor boxes lichtjes, beoordeelt hoe goed ze overeenkomen met echte helmen van alle groottes en controleert ook of hun afmetingen logisch zijn gegeven basale camera‑optiek—hoe groot een echte helm op de sensor zou moeten lijken bij typische werkafstanden. Anchor‑sets met betere scores overleven naar de volgende ronde. Na verloop van tijd “evolueren” er anchors die zowel bij de data passen als rekening houden met hoe camera’s de wereld daadwerkelijk afbeelden.

Training aanpassen aan echte beeldkwaliteit

Buiten het veranderen van wat het model zoekt, passen de auteurs ook aan hoe het leert. Ze introduceren een trainingsstrategie die meer nadruk legt op het precies lokaliseren van helmen wanneer de beeldkwaliteit slecht is, en meer aandacht voor correcte classificatie helm versus geen helm wanneer de omstandigheden goed zijn. Een op fysica gebaseerd scoremechanisme, wederom afgeleid van camerabeeldprincipes, vertelt het systeem hoe betrouwbaar de beelden in elke fase zijn. Als verlichting of focus slecht is, vergroot het trainingsproces automatisch het belang van het correct bepalen van de begrenzingshokjes; als de omstandigheden verbeteren, verschuift het gewicht naar classificatie. Dit creëert een feedbacklus waarin het model zijn prioriteiten continu aanpast aan de fysieke omgeving die het in echte tunnels zal tegenkomen.

Wat de tests in de praktijk laten zien

De onderzoekers testen hun benadering op een echte tunnel veiligheid‑helm dataset en vergelijken die met verschillende geavanceerde YOLO‑gebaseerde methoden. AE‑LFOG‑YOLO detecteert helmen met zeer hoge nauwkeurigheid, identificeert ongeveer 95 procent van de helmen bij een standaard overlapdrempel en overtreft de eenvoudige YOLOv8‑baseline zowel in precisie als in recall. Het draait snel genoeg voor realtime gebruik en blijkt vooral sterk wanneer de verlichting zwaar wordt gemanipuleerd om extreme duisternis of overbelichting te simuleren. Onder deze zware omstandigheden behoudt het nieuwe model een hogere confidentie, detecteert het meer kleine en verre arbeiders en werkt het over een helderheidsbereik dat meer dan een derde groter is dan dat van de baseline, wat betekent dat het betrouwbaarder blijft in een veel groter scala aan reële scènes.

Hoe dit bijdraagt aan veiligere werkomstandigheden

Voor niet‑specialisten is de conclusie helder: door een AI‑systeem te leren begrijpen niet alleen pixels maar ook de fysica van hoe camera’s zien in moeilijke omgevingen, levert dit werk een slimmer en betrouwbaarder waakzaam systeem aan de tunnelwand. AE‑LFOG‑YOLO kan misleidende verlichting beter negeren en zich aanpassen aan veranderende gezichtsvelden, waardoor gemiste detecties en valse alarmen afnemen. Inzet over meerdere maanden op een operationele rail‑transitlijn heeft al aangetoond dat het veiligheidsteams kan ondersteunen bij het toezien op het dragen van helmen door arbeiders, en biedt een praktische stap naar veiligere, nauwer gecontroleerde bouwplaatsen.

Bronvermelding: Liu, S., Wang, J. AE-LFOG-YOLO: robust safety helmet detection via adaptive anchors and illumination invariant learning. Sci Rep 16, 6402 (2026). https://doi.org/10.1038/s41598-026-37326-z

Trefwoorden: veiligheidshelm detectie, tunnelbouw, computer vision, laaglicht beeldvorming, YOLOv8