Clear Sky Science · nl

Wanneer LLM’s ZigBee spreken: verkennen van lage-latentie en redeneermodellen voor het genereren van netwerkverkeer

Smart homes hebben geloofwaardige oefenomgevingen nodig

Terwijl onze huizen volstromen met slimme lampen, stekkers en sensoren, wordt het onzichtbare verkeer tussen deze apparaten zowel een gemak als een potentieel zwak punt. Ingenieurs die deze systemen bouwen en beveiligen hebben veilige manieren nodig om te "oefenen" hoe netwerken zich onder realistische omstandigheden gedragen, inclusief zeldzame storingen en cyberaanvallen. Dit artikel onderzoekt of moderne AI-taalmodellen—dezelfde soort die voor chatbots worden gebruikt—kunnen worden hergebruikt om realistisch smart‑home netwerkverkeer te genereren, waardoor onderzoekers een krachtig nieuw testplatform krijgen zonder alle mogelijke scenario’s uit echte huizen te hoeven opnemen.

Van menselijke taal naar apparaatgesprekken

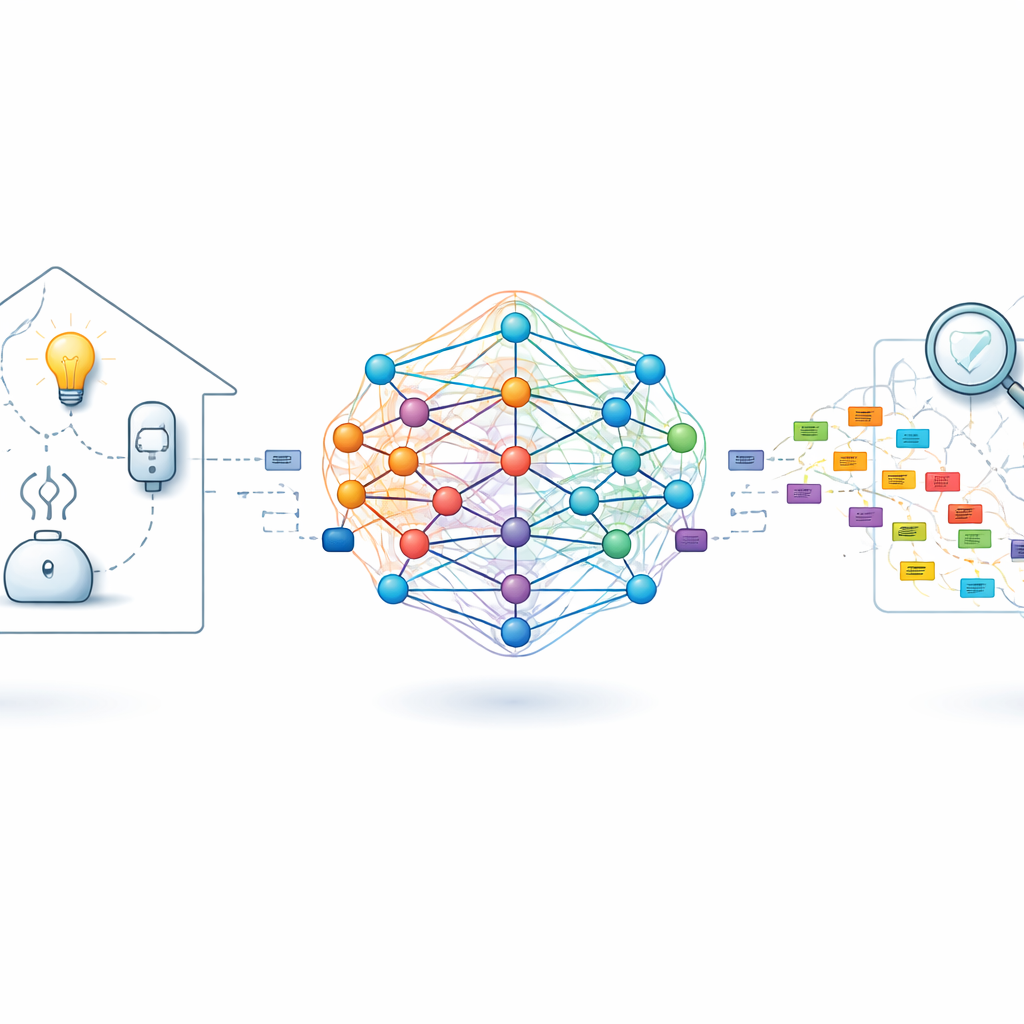

De studie richt zich op ZigBee, een populair draadloos protocol dat wordt gebruikt in slimme lampen, stekkers en bewegingssensoren. In plaats van gewoon tekst te genereren, voeren de auteurs voorbeeld‑ZigBee‑pakketjes—tijdgestempelde registraties van wie met wie praatte en welke protocolvelden werden gebruikt—into grote taalmodellen (LLM’s) van OpenAI, in het bijzonder GPT‑4.1 en GPT‑5. Deze modellen behandelen elk pakket als een gestructureerde "zin" en leren patronen in hoe apparaten en het centrale hub met elkaar communiceren in de tijd. Het doel is niet alleen om basisstatistieken zoals gemiddelde pakketgrootte na te bootsen, maar om nieuw verkeer te produceren dat zich houdt aan ZigBee’s strikte regels, geldige apparaatsadressen gebruikt en realistische timing- en vraag‑antwoordpatronen behoudt.

Twee experimenten: eenrichtingsverkeer en volledige dialoog

Om dit idee te testen, ontwerpen de onderzoekers twee hoofdexperimenten met een grote, echte smart‑home dataset genaamd ZigBeeNet, die ongeveer 25 miljoen pakketjes bevat verzameld van 15 apparaten over 20 dagen. In het eerste experiment bestuderen ze eenrichtingscommunicatie van een enkele slimme lamp naar de hub, waarbij het LLM alleen de eerste tien minuten van echt verkeer als voorbeelden wordt getoond. In het tweede experiment gaan ze naar een realistischere setting waarin de lamp en hub berichten in beide richtingen uitwisselen, inclusief broadcasts van de hub. In beide gevallen wordt een kleine set voorbeeldpakketjes in de prompt aan het model getoond (few‑shot learning) en wordt het model gevraagd langere stukken volledig nieuw verkeer te produceren die teruggezet kunnen worden naar standaard packet capture‑bestanden en kunnen worden geanalyseerd met gangbare netwerktools.

Het model sturen met regels en menselijke controles

Omdat een verkeerd veld of een tijdstempel buiten volgorde de illusie van realisme kan doorbreken, bouwen het team een zorgvuldig prompting‑ en feedbacksysteem. Eerst filteren en exporteren ze de echte pakketjes, daarna formuleren ze prompts die toegestane apparaatsadressen, berichttypes en tijdformaten specificeren. In een initiële fase beoordeelt een menselijke expert de output van het model en zoekt naar problemen zoals ongeldige adressen, onmogelijke sequentienummers of tijdsgaten. In plaats van pakketjes handmatig te corrigeren, vertalen ze deze bevindingen naar strengere promptregels—bijvoorbeeld het verbieden dat een apparaat naar zichzelf verzendt of het eisen dat het aantal pakketten binnen een realistisch bereik blijft. Zodra de regels stabiel zijn, worden de prompts "bevroren" en onveranderd hergebruikt zodat latere experimenten volledig automatisch en reproduceerbaar zijn.

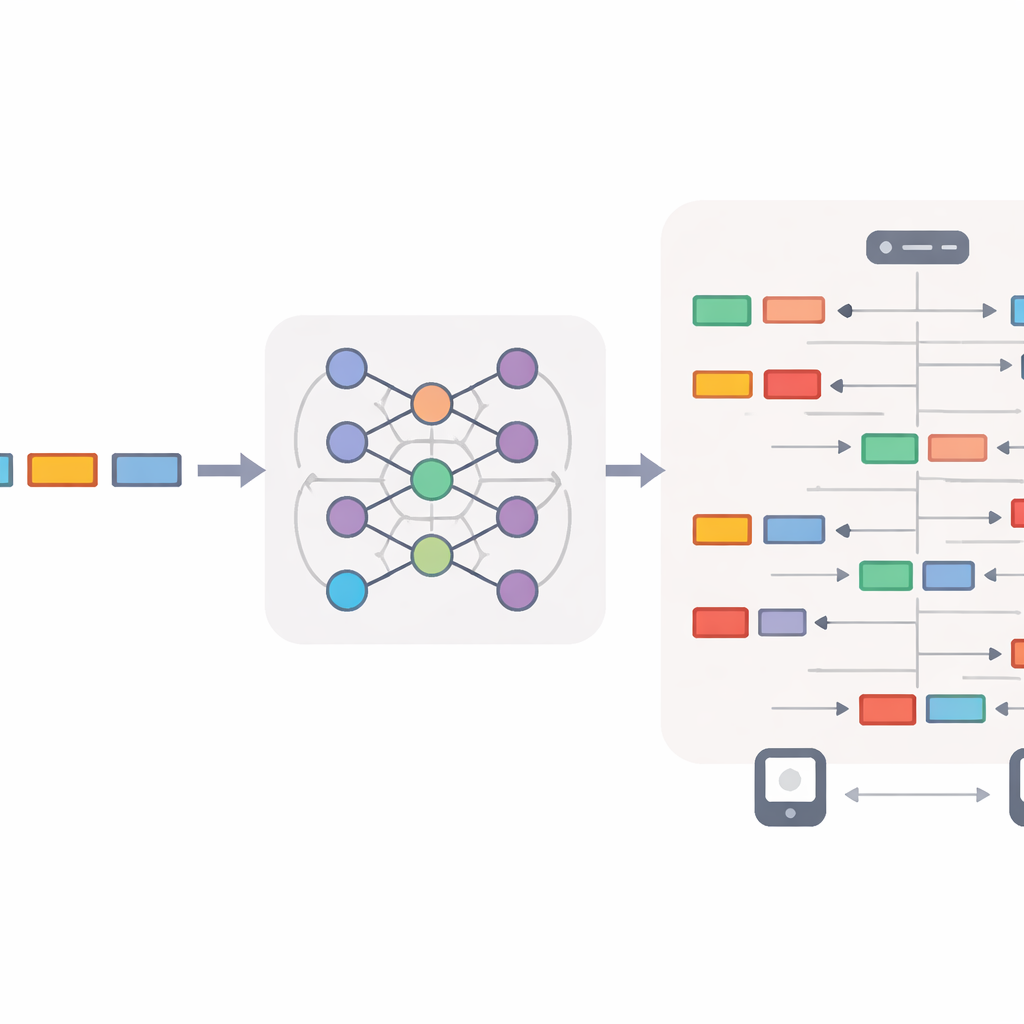

LLM’s versus oudere generators

Om te bepalen of LLM’s echt meerwaarde bieden, vergelijken de auteurs GPT‑4.1 en GPT‑5 met twee klassieke deep‑learningbenaderingen: recurrente neurale netwerken (RNN’s) en generative adversarial networks (GAN’s), beide aangepast om ZigBee‑achtige sequenties te genereren. Ze evalueren alle modellen op veel dimensies: hoe goed inter‑arrival tijden overeenkomen met echt verkeer, of pakketten correct gedecodeerd worden in standaardtools, of protocolregels en apparaatsrollen worden gerespecteerd, hoe vaak pakketten zich herhalen en hoe vaak ze exact trainingsvoorbeelden kopiëren. De resultaten tonen dat beide GPT‑modellen vrijwel perfect decodeerbaar en protocolconform verkeer produceren met geringe afwijking van echte tijdspatronen, terwijl RNN’s moeite hebben met langetermijnvolgorde en GAN’s vaak onrealistisch dicht of semantisch ongeldig verkeer maken, vooral bij tweerichtingscommunicatie en langere duur.

Wanneer meer "nadenken" niet helpt

De studie onderzoekt ook een verrassende vraag: verbetert het geven van meer interne "denktijd" aan het redeneervriendelijke GPT‑5 de netwerkrealiteit? Door GPT‑5’s verborgen redeneervermogen van laag naar hoog te verhogen, vinden de auteurs dat meer inspanning het model trager en omslachtiger maakt, maar de overeenkomst met werkelijkheid niet verbetert en soms schaadt. GPT‑4.1, een snellere niet‑redeneermachine, evenaart of overtreft consequent GPT‑5 op belangrijke kwaliteitsmaatstaven terwijl het minder rekenmiddelen verbruikt. Over langere simulaties van 30 minuten behouden beide LLM’s correct ZigBee‑gedrag, maar klassieke RNN‑ en GAN‑baselines driften sterk weg in timing en protocolcorrectheid.

Wat dit betekent voor veiligere smart homes

Voor niet‑specialisten is de belangrijkste boodschap dat moderne taalmodellen niet alleen menselijke gesprekken kunnen leren, maar ook de "taal" van smart‑home apparaten, en op aanvraag geloofwaardig, regelsvolgend verkeer kunnen genereren. Het werk laat zien dat een relatief snel, lage‑latentie model zoals GPT‑4.1 al kan dienen als een hoog‑fideliteits traffic generator voor testen en beveiligingsevaluatie, wat mogelijk de noodzaak vermindert om gevoelige echte‑werelddata vast te leggen. Het benadrukt ook dat complexer en zwaarder redeneren niet altijd beter is: voor strak gestructureerde technische taken kunnen eenvoudigere, efficiëntere modellen slimmer zijn. Nu de auteurs hun code en data vrijgeven, kan deze aanpak onderzoekers wereldwijd helpen smart‑home systemen stress‑testen, inbraakdetectie verbeteren en nieuwe netwerkontwerpen verkennen in een veilige, synthetische omgeving.

Bronvermelding: Keleşoğlu, N., Sobczak, Ł. & Domańska, J. When LLMs speak ZigBee: exploring low-latency and reasoning models for network traffic generation. Sci Rep 16, 8036 (2026). https://doi.org/10.1038/s41598-026-37246-y

Trefwoorden: smart home IoT, generatie van ZigBee-verkeer, grote taalmodellen, netwerkbeveiligingstesten, synthetische netwerkdata