Clear Sky Science · nl

Interpretatieverschuiving in uitlegbare AI bij labelruis

Waarom AI-uitleg stilletjes fout kan gaan

Veel mensen vertrouwen tegenwoordig op kunstmatige intelligentie niet alleen voor antwoorden, maar ook voor verklaringen: waarom werd een lening afgewezen? Waarom markeerde een systeem een patiënt als hoog risico? Deze studie laat zien dat zelfs wanneer de nauwkeurigheid van een AI-model er geruststellend stabiel uitziet, het verhaal dat het vertelt over waarom het een beslissing nam dramatisch kan verschuiven als de trainingsgegevens fouten bevatten. Die verborgen verschuiving in verklaringen — door de auteurs “interpretatieverschuiving” genoemd — kan professionals misleiden die op AI vertrouwen om belangrijke keuzes te rechtvaardigen.

Wanneer schone data rommelige labels ontmoeten

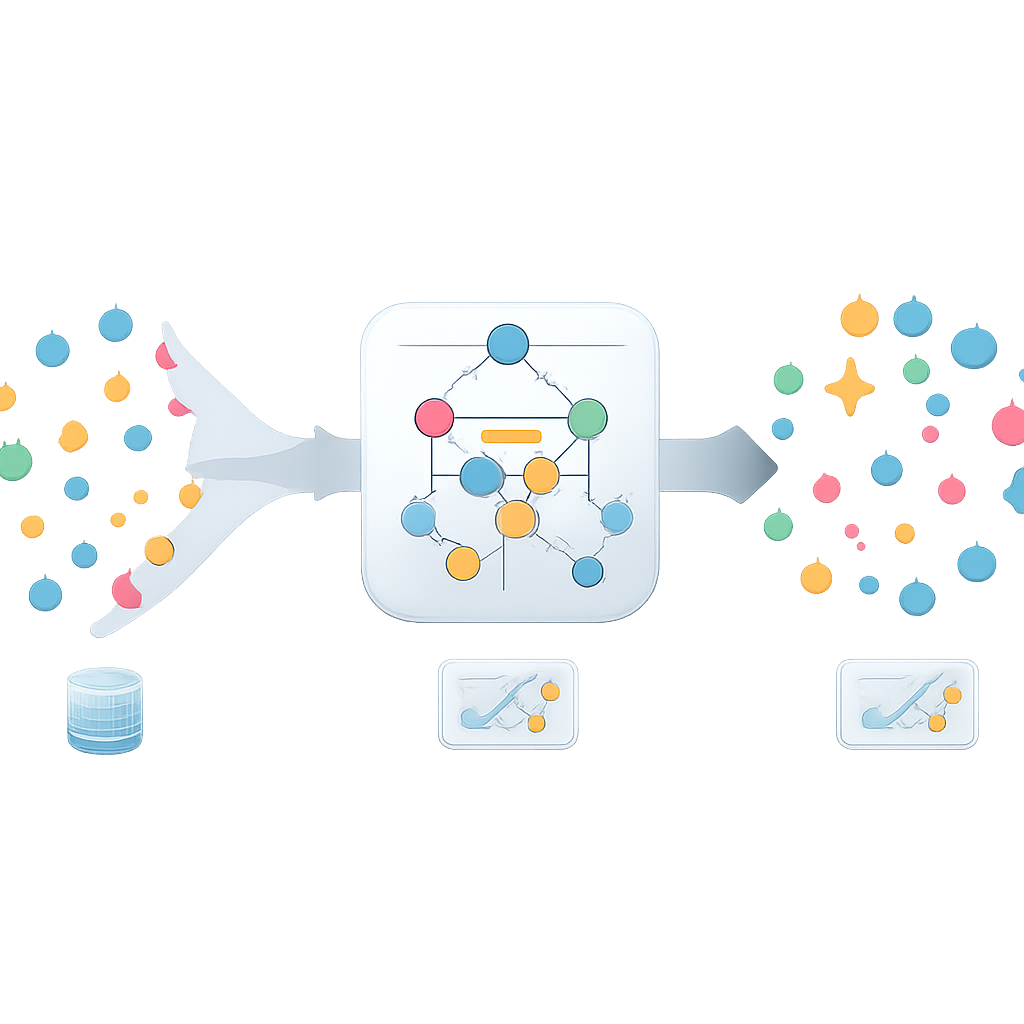

De meeste moderne AI-systemen zijn “black boxes” en geven voorspellingen zonder duidelijke reden. Om AI transparanter te maken, grijpen veel toepassingen naar regelgebaseerde modellen die lijken op menselijk als-dan-redeneren: bijvoorbeeld „als de bloeddruk hoog is en de leeftijd boven de 60, dan is het risico hoog.” Deze regels zijn vooral aantrekkelijk in gevoelige domeinen zoals gezondheidszorg, recht en financiën, waar gebruikers de logica moeten kunnen inspecteren en vertrouwen. Maar data uit de praktijk zijn zelden perfect. Een veelvoorkomend probleem is labelruis — gevallen waarin het veronderstelde “juiste antwoord” in de trainingsgegevens onjuist is, zoals een verkeerd geregistreerde diagnose of een foutief gelabeld klantresultaat. Hoewel bekend is dat labelruis de voorspellingskwaliteit schaadt, was het effect op de stabiliteit van AI-verklaringen nog niet systematisch onderzocht.

Testen hoe verklaringen standhouden onder ruis

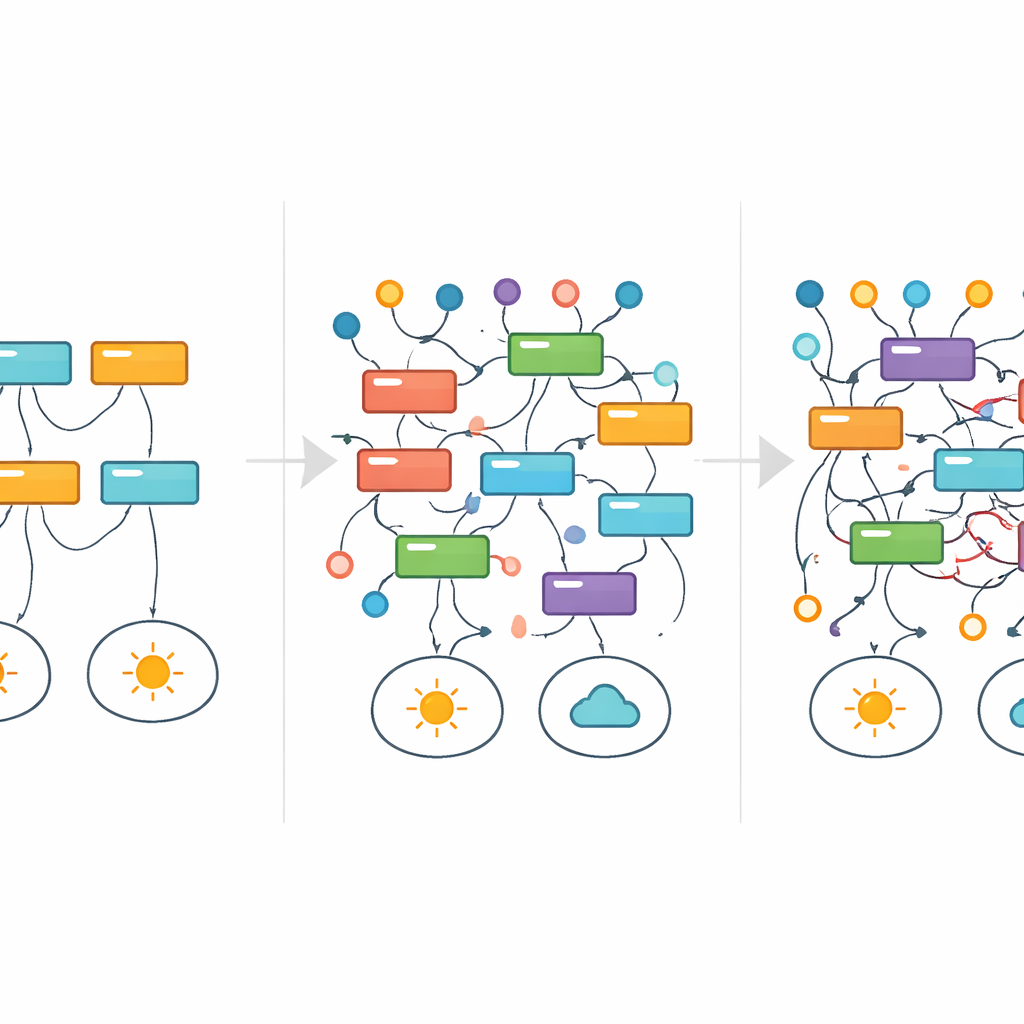

De auteurs evalueerden hoe robuust regelgebaseerde verklaringen blijven wanneer labels geleidelijk worden gecorrumpeerd. Ze gebruikten vier verschillende datasets uit de gezondheidszorg, bankwezen, leverziekten en zelfs getaltheorie, allemaal opgezet als ja–nee-voorspellingstaken. Drie regel-leermethoden werden vergeleken: twee populaire, snelle algoritmen (IREP en RIPPER) en een meer computationeel intensieve benadering genaamd Human Knowledge Models (HKM), die expliciet gericht is op het produceren van zeer eenvoudige, mensachtige regels. Voor elke methode trainden de onderzoekers herhaaldelijk modellen terwijl ze willekeurig een groeiend deel van de trainingslabels omkeerden — van vrijwel foutvrije data tot bijna volledige onzin. Ze volgden twee dingen parallel: hoe goed de modellen nog voorspelden op een schone testset, en hoeveel de geleerde regels veranderden vergeleken met die uit ruisvrije data.

Nauwkeurigheid stabiel, logica in beweging

Op het eerste gezicht kunnen de resultaten gebruikers in een vals gevoel van veiligheid wiegen. Bij matige ruisniveaus, vooral met de HKM-methode, leek de voorspellende prestatie relatief stabiel wanneer gemeten met de gebruikelijke F1-score. Toch vertelde een nadere blik op de regels een ander verhaal. Met een similariteitsmaat die verzamelingen regels vergelijkt, vonden de auteurs dat zelfs bescheiden hoeveelheden labelruis snel de overlap tussen de oorspronkelijke en de met ruis verkregen verklaringen uitholden. Met andere woorden: het model kan nog steeds in veel gevallen gelijk hebben, maar om steeds andere redenen. Complexere regelsets bleken bijzonder kwetsbaar: naarmate het aantal voorwaarden in een regel toenam, konden kleine veranderingen in de data die regels gemakkelijker doen versplinteren of vervangen, waardoor het verlies aan interpretatiestabiliteit versnelde.

Regels volgen terwijl ze verschijnen en verdwijnen

Om te visualiseren hoe individuele verklaringen standhouden of falen naarmate de ruis toeneemt, leenden de onderzoekers een instrument uit de geneeskunde: survivalanalyse. In plaats van de overleving van patiënten in de tijd te volgen, hielden ze bij hoe lang een bepaalde regel bleef verschijnen onder de beste modellen terwijl de labelruis toenam. In plaats van geleidelijk weg te vagen, flikkerden veel regels in en uit — een teken dat volledig verschillende verklaringen dominant kunnen worden op verschillende ruisniveaus, zelfs voor dezelfde onderliggende taak. In een eenvoudige dataset over deelbaarheid van getallen, bijvoorbeeld, werden schone en wiskundig correcte regels geleidelijk vervangen door bredere benaderingen en uiteindelijk door ingewikkelde, schijnbaar willekeurige patronen die nog steeds bij de gecorrumpeerde labels pasten. Gedurende een groot deel van dit proces gaven de gangbare prestatiemaatstaven geen duidelijk signaal dat er iets mis was.

Wat dit betekent voor mensen die op AI vertrouwen

De kernboodschap is dat “betrouwbare” AI niet alleen aan nauwkeurigheid kan worden afgemeten. Zelfs modellen die hun logica in mensleesbare regels presenteren, kunnen stilletjes hun redenering veranderen wanneer de labels waarvan ze leren onvolmaakt zijn — en dat is precies de situatie in de meeste databases uit de praktijk. De auteurs stellen dat ontwikkelaars en toezichthouders de stabiliteit van verklaringen als een eis van gelijk niveau moeten behandelen, naast nauwkeurigheid en eerlijkheid. Nieuwe metriek die rechtstreeks meet hoe consistent de verklaringen van een model onder ruis blijven, en hulpmiddelen die gebruikers waarschuwen voor interpretatieverschuiving, zullen essentieel zijn als we AI-systemen willen die net zo betrouwbaar zijn in hun verhalen over de wereld als in hun voorspellingen.

Bronvermelding: Raikovskaia, A., Rakhimzhanov, N. & Pianykh, O.S. Interpretation drift in explainable AI under label noise. Sci Rep 16, 8528 (2026). https://doi.org/10.1038/s41598-026-37070-4

Trefwoorden: uitlegbare AI, labelruis, modelinterpretatie, regelgebaseerde modellen, interpretatieverschuiving