Clear Sky Science · nl

Evaluatie van kwetsbaarheden in gait-systemen via PPO- en GAN-gegenereerde aanvallen

Waarom het misleiden van een looppatroon ertoe doet

De meesten van ons herkennen vrienden en familie aan hun manier van lopen, zelfs van een afstand. Computers kunnen nu iets vergelijkbaars: "gaitherkennings"systemen analyseren iemands manier van lopen om die persoon zonder vingerafdrukken of gezichtsdoorscans te identificeren. Deze hulpmiddelen worden steeds vaker ingezet voor beveiliging en toezicht. Deze studie stelt een verontrustende vraag: hoe eenvoudig is het om zulke systemen te misleiden met kleine, zorgvuldig ontworpen veranderingen die mensen niet opvallen — maar waarmee machines wel worden bedrogen? Het antwoord heeft grote consequenties voor privacy, veiligheid en hoeveel vertrouwen we kunnen stellen in kunstmatige intelligentie in situaties met hoge inzet.

Hoe computers ons loopgedrag lezen

Moderne gaitherkenning berust op deep learning, dezelfde familie technieken als die achter gezichtsherkenning en zelfrijdende auto’s. In plaats van naar één momentopname te kijken, combineren deze systemen veel frames van een lopend persoon tot één "gait energy image", een soort vervaagde silhouet die vastlegt hoe lichaamsdelen bewegen over een volledige stapcyclus. Een speciaal ontworpen neurale net leert vervolgens het looppatroon van de ene persoon te onderscheiden van dat van een ander, zelfs wanneer kleding of meegevoerde voorwerpen veranderen. In tests op twee belangrijke onderzoeksdatasets met loopvideo’s (de CASIA-B en OU-ISIR datasets) identificeerde het basismodel van de auteurs mensen in meer dan 97% van de gevallen correct — een sterke prestatie die kan suggereren dat de technologie klaar is voor gebruik in de echte wereld.

De onzichtbare stickers die slimme camera’s voor de gek houden

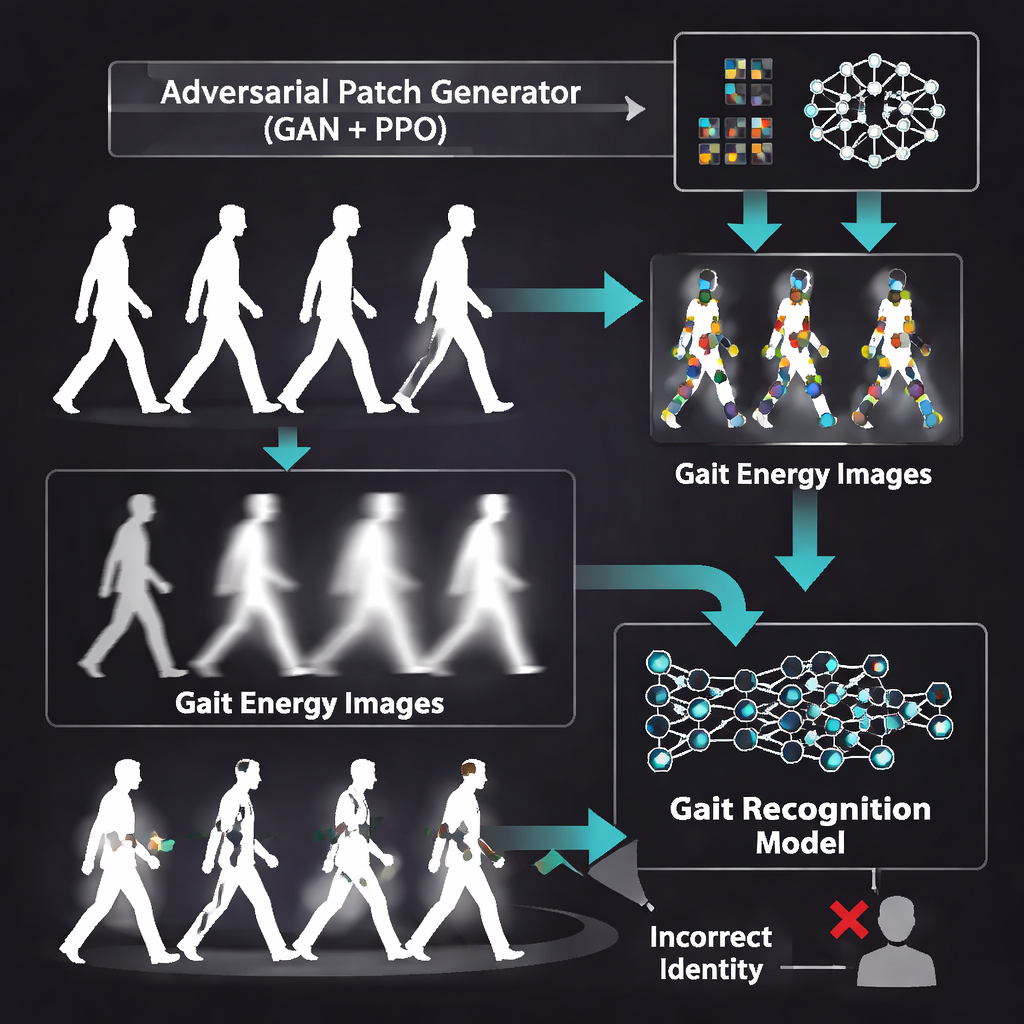

De kern van het artikel is niet het bouwen van een beter identificatiesysteem, maar het opzettelijk doorbreken daarvan om zwakheden bloot te leggen. De onderzoekers genereren kleine "adversariële patches" — vierkante gebieden met gewijzigde pixels die onschuldig lijken, maar wiskundig zijn afgestemd om het neurale netwerk te verwarren. Om deze patches te creëren gebruiken ze een Generative Adversarial Network (GAN), een vorm van AI die leert realistisch ogende beelden te produceren door te concurreren met een ingebouwde criticus. De GAN wordt direct getraind op gait energy images zodat de output natuurlijk in de spookachtige silhouetten opgaat. Deze patches zijn zo ontworpen dat ze subtiel genoeg zijn dat een mens die vluchtig naar het looppatroon kijkt waarschijnlijk niets bijzonders zou opmerken.

Een leeragent de zwakke plekken laten vinden

Waar een patch wordt geplaatst kan net zo belangrijk zijn als hoe die eruitziet. Om de meest schadelijke locaties te ontdekken, zetten de auteurs een methode uit het versterkend leren in die Proximal Policy Optimization (PPO) heet. Ze behandelen elke gait-afbeelding als een roosterachtige omgeving en laten een software-"agent" de patch verplaatsen — omhoog, omlaag, links of rechts — terwijl hij observeert hoeveel vertrouwen het herkenningssysteem verliest. Wanneer een positie ertoe leidt dat het model de persoon verkeerd identificeert, krijgt de agent een beloning; wanneer het faalt, wordt hij gestraft. Na vele episodes leert de agent een strategie voor het plaatsen van patches in bijzonder kwetsbare regio’s van de gait-afbeelding, vaak nabij bewegende lichaamsdelen waarop het model het meest steunt.

Wat er gebeurt als de aanval losgelaten wordt

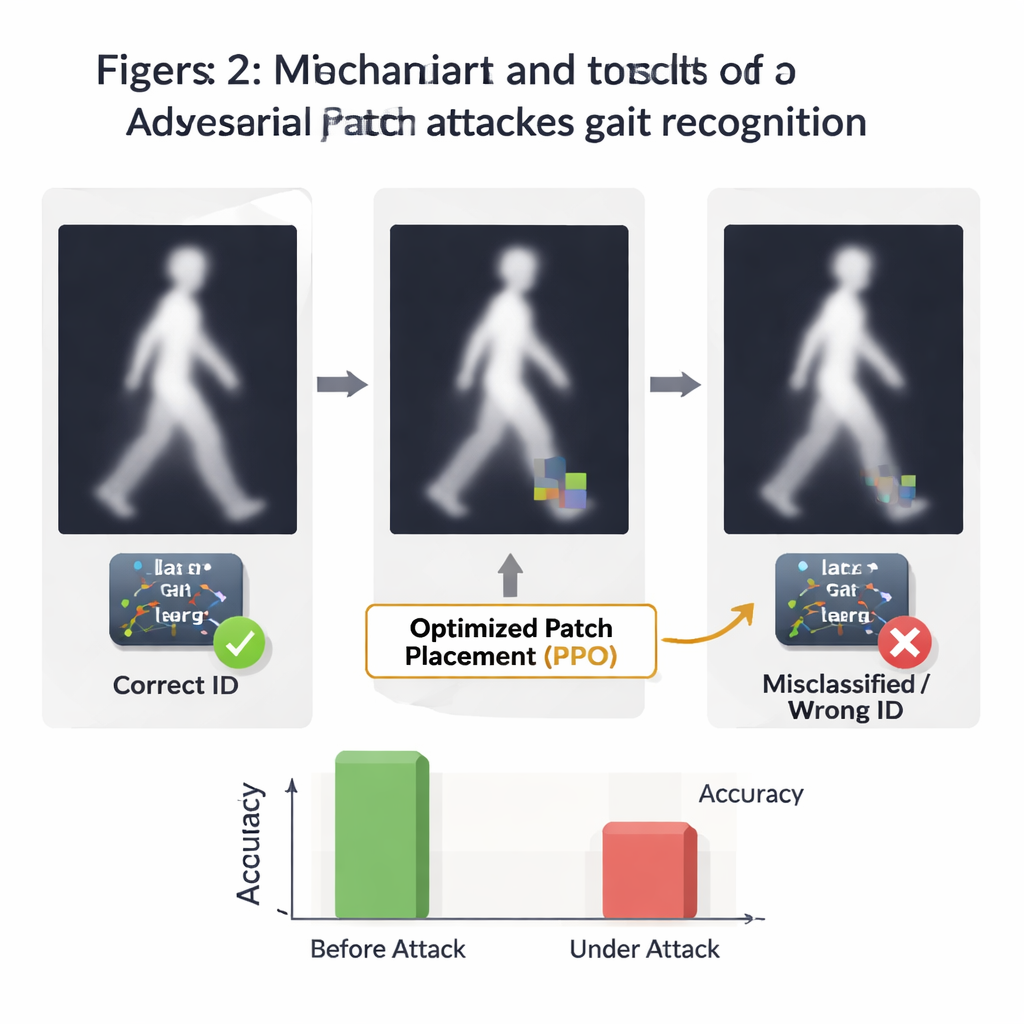

Nadat zowel de patchgenerator als de plaatsingsstrategie zijn getraind, valt het team hun eigen hoogpresterende gaitherkenner aan. Onder normale omstandigheden toont het systeem uitstekende nauwkeurigheid, weinig valse alarmen en een sterke scheiding tussen correcte en incorrecte matches. Zodra adversariële patches worden toegevoegd, daalt de prestatie echter scherp. Afhankelijk van hoe agressief de patch over de afbeelding mag bewegen, stijgt het succespercentage van de aanvallen tot boven de 60%, en kan het aandeel correct geïdentificeerde personen dalen tot bijna een derde van het oorspronkelijke niveau. Curven die ooit bijna perfecte discriminatie tussen echte gebruikers en indringers lieten zien, zakken richting de lijn van willekeurig raden, wat onthult hoe gemakkelijk het model van koers kan worden gebracht zonder zichtbare vervormingen.

Wat dit betekent voor alledaagse beveiliging

Voor niet-specialisten is de conclusie duidelijk: een gaitherkenningssysteem dat in het lab zeer nauwkeurig lijkt, kan verrassend kwetsbaar blijken tegen slimme, door machines ontworpen manipulatie. De studie toont dat het combineren van generatieve beeldhulpmiddelen met trial-and-error leren kleine, bijna onzichtbare veranderingen kan opleveren die ernstige identificatiefouten veroorzaken. In plaats van een handleiding voor misbruik in de echte wereld, is het werk bedoeld als waarschuwing en als testkader. Het geeft systeemontwerpers een manier om te onderzoeken en te meten hoe kwetsbaar hun modellen zijn, en benadrukt de noodzaak om verdedigingsmaatregelen tegen dergelijke aanvallen te ontwikkelen voordat gaitherkenning breed wordt vertrouwd voor surveillance, toegangsbewaking of andere kritieke toepassingen.

Bronvermelding: Saoudi, E.M., Jaafari, J. & Jai Andaloussi, S. Evaluating gait system vulnerabilities through PPO and GAN-generated adversarial attacks. Sci Rep 16, 6039 (2026). https://doi.org/10.1038/s41598-026-37011-1

Trefwoorden: gaitherkenning, biometrische beveiliging, adversariële aanvallen, deep learning, versterkend leren