Clear Sky Science · nl

Een op self‑attention gebaseerd deep‑learningkader voor nauwkeurige en efficiënte detectie van tandheelkundige aandoeningen in OPG‑radiografieën

Waarom slimere tandheelkundige scans ertoe doen

De meesten van ons denken alleen aan tandheelkundige röntgenfoto’s wanneer we in de stoel bij de tandarts zitten, maar deze beelden bevatten stilletjes levensveranderende informatie. Tandbederf, tandvleesaandoeningen en ontbrekende tanden treffen miljarden mensen, toch zijn vroege waarschuwingssignalen gemakkelijk te missen, zelfs voor getrainde experts die naar drukke panoramische scans kijken. Deze studie onderzoekt hoe een nieuwe generatie kunstmatige intelligentie deze brede “glimlachvormige” beelden snel en nauwkeurig kan lezen, zodat tandartsen problemen eerder kunnen signaleren en de kans op pijnlijke en kostbare behandelingen later verkleind wordt.

De toenemende last in onze mond

Mondziekten behoren nu tot de meest voorkomende gezondheidsproblemen ter wereld en treffen naar schatting 3,5 miljard mensen. Cariës, tandvleesontsteking, verharde tandplak (calculus) en ontbrekende tanden zijn niet alleen cosmetische problemen; ze kunnen chronische pijn, infecties en moeite met eten veroorzaken en zijn gekoppeld aan bredere gezondheidsrisico’s. Jongeren worden steeds vaker getroffen, en tandverlies bij ouderen kan de levenskwaliteit sterk verminderen. Traditionele controles — bekijken, voelen en röntgenbeelden met het oog beoordelen — blijven de belangrijkste verdedigingslinie, maar ze hangen sterk af van de ervaring van de behandelaar en kunnen kleine of vroegstadige schade die in complexe beelden verborgen is, over het hoofd zien.

Panoramische röntgenbeelden omzetten in data

De onderzoekers concentreren zich op een veelvoorkomend type tandheelkundig beeld, het orthopantomogram of OPG — een enkele brede röntgenfoto die alle tanden en beide kaken tegelijk toont. Omdat OPG’s routinematig in veel klinieken worden gemaakt en een beperkte stralingsdosis gebruiken, zijn ze een ideaal doel voor automatisering. Het team verzamelde meer dan 5.000 beelden die vier veelvoorkomende aandoeningen vertegenwoordigen: cariës, calculus, gingivitis en hypodontie (ontbrekende tanden). Voordat ze een computer leerden deze problemen te herkennen, prepareerden ze de beelden zorgvuldig — ze standaardiseerden formaat en helderheid, reduceerden ruis en gebruikten een apart model om alles behalve de tandboog weg te snijden, zodat de AI zich op tanden en tandvlees zou richten in plaats van op afleidende achtergrondanatomie.

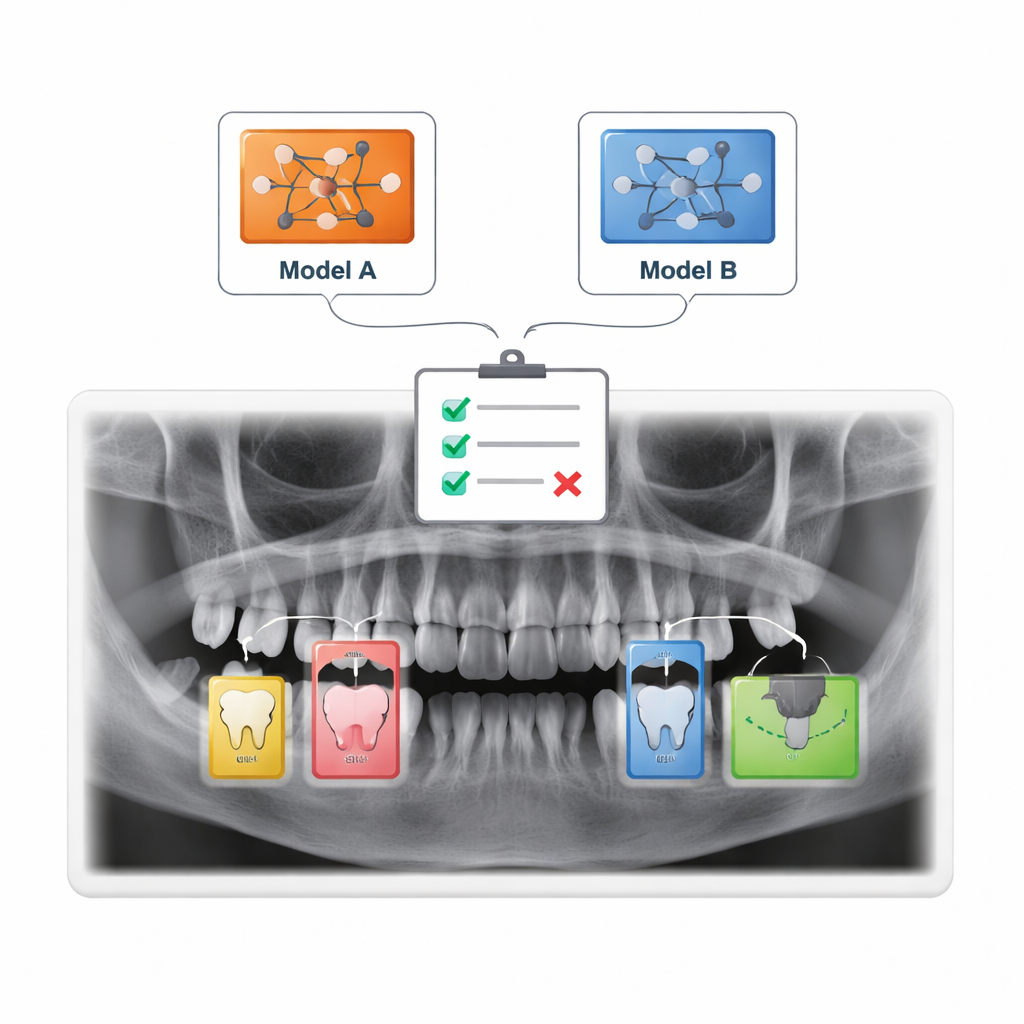

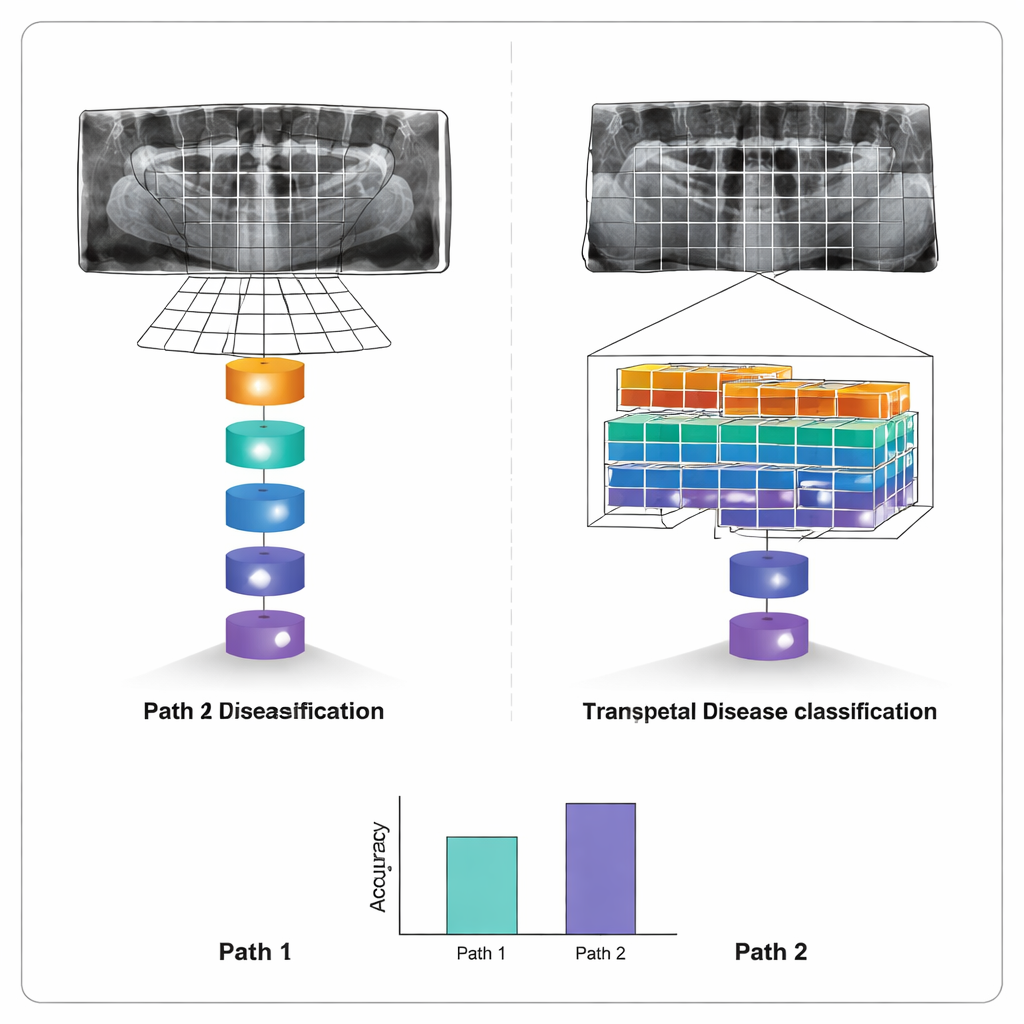

Twee rivaliserende AI’s: globaal overzicht versus vensteraanpak

Om de röntgenfoto’s te lezen, vergelijkt de studie twee “transformer” modellen, een klasse AI die recentelijk taal- en beeldanalyse heeft veranderd. De eerste, een Vision Transformer genoemd, knipt elke röntgenfoto in veel kleine stukjes en analyseert ze vervolgens samen, waarbij het leert hoe ver uit elkaar liggende delen van de mond zich tot elkaar verhouden. De tweede, bekend als een Swin Transformer, verdeelt het beeld ook in stukken maar concentreert zich op lokale vensters die over de afbeelding schuiven, waarmee het een hiërarchie opbouwt van fijne details naar bredere patronen. Beide modellen werden getraind op dezelfde dataset en geëvalueerd met gebruikelijke maatstaven voor diagnostische prestaties, inclusief hoe vaak ze terecht zieke en gezonde beelden signaleren.

Hoe goed de machines tanden diagnosticeren

Na training bleken beide systemen opmerkelijk capabel. De Vision Transformer classificeerde ongeveer 96% van de testbeelden correct, met vergelijkbaar hoge precisie en recall — wat betekent dat hij zelden valse alarmen gaf en nauwelijks ziekte miste. De Swin Transformer presteerde slechts iets minder goed, met ongeveer 95% nauwkeurigheid, maar gebruikte door zijn vensterontwerp rekenkracht efficiënter. Het grootste voordeel van de Vision Transformer deed zich voor bij het opsporen van kleine cariës, waarbij zijn vermogen om de hele mond in één keer te overzien hielp om kleine, laagcontrasterende afwijkingen op te merken. Het bijsnijden van beelden om te focussen op de tandboog verbeterde de resultaten verder, en bevestigde dat het verwijderen van irrelevante regio’s de modellen betrouwbaarder maakt.

Wat dit betekent voor toekomstige tandartsbezoeken

Voor patiënten is de boodschap niet dat computers tandartsen zullen vervangen, maar dat ze kunnen fungeren als een extra paar scherpzinnige ogen. Dit werk toont aan dat moderne AI een panoramische tandheelkundige röntgenfoto in enkele seconden kan scannen en nauwkeurig kan indelen in veelvoorkomende ziektecategorieën, waarbij gebieden worden gemarkeerd die een nadere blik verdienen. Hoewel de studie is gebaseerd op één samengestelde dataset en nog grotere, realistische proeven nodig heeft, suggereert het dat systemen op basis van transformers op een dag kunnen helpen diagnoses te standaardiseren, gemiste problemen te verminderen en geavanceerde tandheelkundige zorg toegankelijker te maken — vooral in drukke of middelenarme klinieken.

Bronvermelding: Bhoopalan, R., Mirdula, S., Kannusamy, P. et al. A self attention based deep learning framework for accurate and efficient dental disease detection in OPG radiographs. Sci Rep 16, 5914 (2026). https://doi.org/10.1038/s41598-026-36672-2

Trefwoorden: dental AI, panoramische röntgenfoto, detectie van tandbederf, deep learning, mondgezondheid