Clear Sky Science · nl

Een geautomatiseerd kader voor koranonderwijs voor slechthorenden met lichaamshoudingclassificatie en integratie van Arabische gebarentaal

Een heilige tekst openen voor stille stemmen

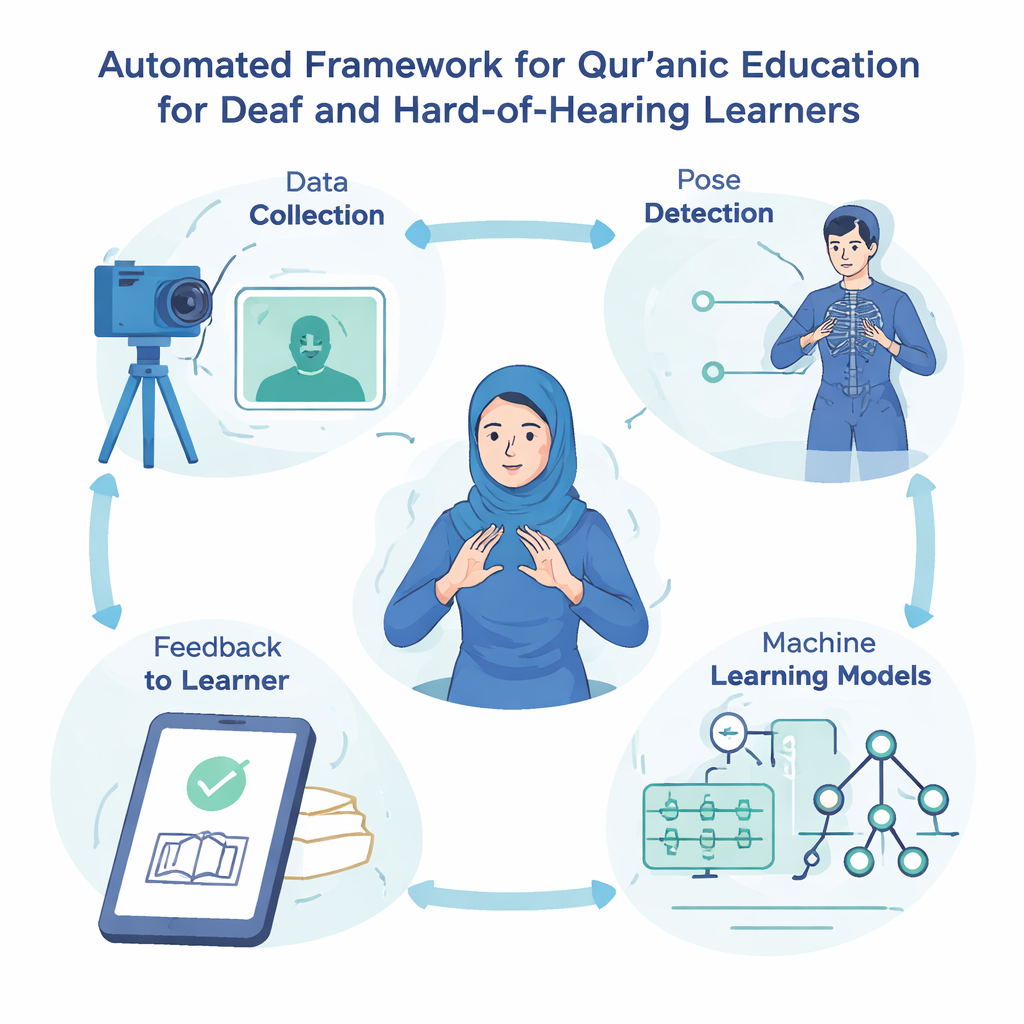

Voor veel dove en slechthorende moslims kan het leren reciteren van de Koran erg moeilijk zijn, omdat traditioneel onderwijs afhankelijk is van luisteren en herhalen. Deze studie introduceert een technologiegestuurde leermethode die Arabische gebaren herkent en koppelt aan verzen uit een korte hoofdstuk van de Koran. Door lichaamsbewegingen te veranderen in een brug tussen gebaar en schrift, streeft het ernaar religieus leren inclusiever te maken voor miljoenen mensen die voornamelijk via gebarentaal communiceren.

Waarom slechthorende leerlingen worden buitengesloten

Dove moslims vertrouwen vaak op gebaren en tekens om te communiceren, terwijl het meeste koranonderwijs rond geluid is opgebouwd — leraren reciteren hardop, studenten imiteren de melodie en uitspraak. Families beheersen mogelijk de gebarentaal niet goed en gekwalificeerde gebarentolken zijn schaars, vooral voor religieus materiaal. Daardoor hebben veel dove gelovigen moeite om hetzelfde niveau van spiritueel onderwijs te bereiken als hun horende leeftijdsgenoten. Recente vooruitgang in computer vision en kunstmatige intelligentie, die hand- en lichaamsbewegingen uit camerabeelden kunnen herkennen, biedt een manier om dit te veranderen door gebarentaal om te zetten in iets dat een computer in realtime kan begrijpen en op kan reageren.

Gebaren omzetten in leerbare eenheden

De onderzoekers concentreerden zich op Sūrat al-Ikhlāṣ, een kort maar theologisch rijk hoofdstuk dat veel moslims al vroeg in het leven uit het hoofd leren. In samenwerking met instellingen die dove gebruikers in Egypte bedienen, namen ze 2.054 afbeeldingen op van Arabische gebarentaalgebaren die corresponderen met individuele koranwoorden uit dit hoofdstuk. Om verwarring over betekenis en uitspraak te voorkomen, werd elk gebaar gelabeld met zowel Arabisch schrift als een gestandaardiseerd transliteratiesysteem dat veel wordt gebruikt in academische islamstudies. Deze zorgvuldige labeling zorgt ervoor dat het systeem elk teken koppelt aan de juiste koranterm, terwijl het flexibel genoeg blijft om in de toekomst uit te breiden naar andere hoofdstukken.

Hoe de computer leert gebedshoudingen te zien

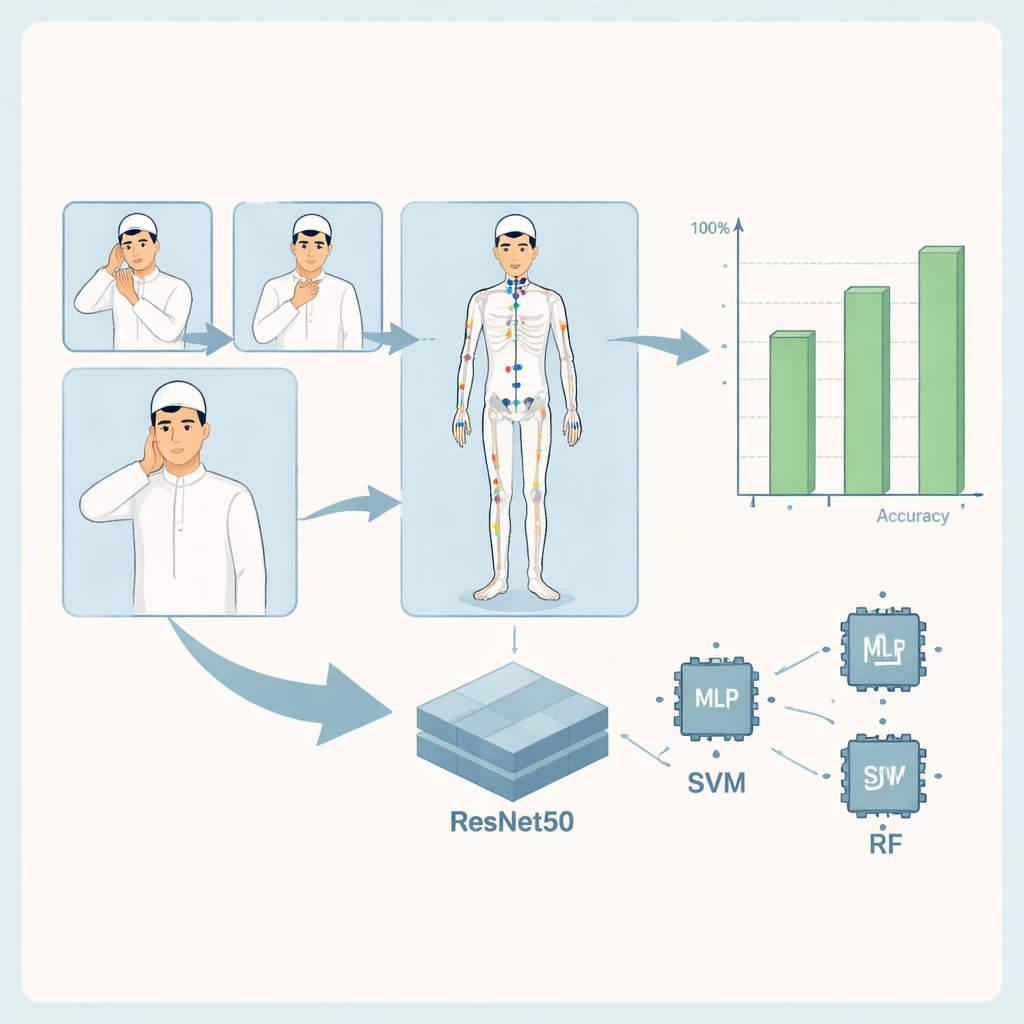

In het hart van het systeem zit een visuele pijplijn die eerst de lichaamshouding van de gebarentaalgebruiker detecteert en vervolgens classificeert welk koranwoord wordt weergegeven. Alle afbeeldingen worden herschaald en opgeschoond naar een standaardformaat. Een softwarepakket genaamd MediaPipe identificeert 33 sleutelpunten op het lichaam — zoals schouders, ellebogen en polsen — en volgt hun posities. Deze coördinaten vormen een compacte beschrijving van elke houding, die vervolgens wordt ingevoerd in drie soorten machine-learningmodellen: een aangepaste multi-layer perceptron (een eenvoudig neuraal netwerk), een support vector machine en een random forest bestaande uit veel kleine beslissingsbomen. Parallel daaraan analyseert een krachtiger deep-learningmodel, ResNet50, de volledige afbeelding om gedetailleerde visuele patronen te leren die met elk woord geassocieerd zijn.

Opmerkelijk nauwkeurige herkenning van korangebaren

Om het systeem te testen, splitsten de auteurs hun dataset in trainings-, validatie- en testsets en evalueerden ze hoe nauwkeurig elk model de gebaren herkende. Alle benaderingen presteerden sterk, waarbij de op houding gebaseerde modellen de meeste gebaren correct identificeerden over 14–16 koranwoordklassen. Het random forest-model behaalde bijvoorbeeld voor veel woorden bijna perfecte scores, met slechts enkele verwarringen tussen visueel vergelijkbare gebaren. Het gecombineerde ResNet50-model, dat direct naar de afbeeldingen kijkt en tegelijkertijd profiteert van houdingsinformatie, bereikte bijna foutloze prestaties op de testgegevens: elk gebaar werd correct geclassificeerd en standaardmaatregelen zoals nauwkeurigheid, precisie, recall en een discriminatiescore genaamd ROC–AUC bereikten hun maximale waarden. Deze resultaten suggereren dat zelfs relatief kleine beeldverzamelingen, mits zorgvuldig voorbereid, zeer nauwkeurige herkenning van religieuze gebarentaal kunnen ondersteunen.

Belofte, beperkingen en de weg vooruit

Hoewel de prestatiecijfers indrukwekkend zijn, benadrukken de auteurs dat ze alleen gelden voor de gecontroleerde omstandigheden van hun studie: één hoofdstuk, een beperkt aantal gebarenmakers en stilstaande beelden in plaats van continue bewegende gebaren. Gebruik in de praktijk vereist grotere, meer gevarieerde datasets, betere dekking van bewegingen van het onderlichaam en zorgvuldige tests met gebarenmakers uit verschillende regio’s. Niettemin toont het werk aan dat moderne vision- en leertechnieken korangebaren betrouwbaar kunnen herkennen en directe feedback kunnen geven, bijvoorbeeld door een vinkje of een corrigerende animatie te tonen wanneer een leerling een gebaar uitvoert. In praktische termen betekent dit dat een dove student koranverzen kan oefenen in gebaar voor een eenvoudige camera en begeleiding kan ontvangen zonder een live tolk — een belangrijke stap om heilige kennis toegankelijker te maken voor iedereen.

Bronvermelding: AbdElghfar, H., Youness, H.A., Wahba, M. et al. An automated framework for qur’anic education of the hearing-impaired using body pose classification and Arabic sign language integration. Sci Rep 16, 5939 (2026). https://doi.org/10.1038/s41598-026-36578-z

Trefwoorden: Koranonderwijs, Arabische gebarentaal, slechthorende leerlingen, houdingherkenning, hulpmiddelentechnologie