Clear Sky Science · nl

Wetenschappelijke rapporten multi-relational dual attention graph transformer voor fijnmazige sentimentanalyse

Waarom kleine aanwijzingen in recensies ertoe doen

Online recensies zitten vol gemengde gevoelens: een restaurant kan “geweldig eten maar trage service” hebben, of een telefoon kan een “prachtig scherm maar verschrikkelijke batterijduur” hebben. Bedrijven en onderzoekers willen dat computers dit soort gedetailleerde meningen begrijpen, niet alleen of een hele recensie positief of negatief is. Dit artikel introduceert een nieuw kunstmatig-intelligentie-model dat inzoomt op specifieke delen van een zin—zoals “service” of “batterijduur”—en precies vaststelt hoe mensen over elk onderdeel denken, zelfs wanneer de aanwijzingen verspreid en subtiel zijn.

Voorbij één-maat-voor-iedereen sentiment

Traditionele sentimentanalyse behandelt een zin of recensie als één blok tekst en bepaalt of het geheel positief of negatief is. Dat werkt voor eenvoudige opmerkingen, maar faalt wanneer mensen het ene aspect prijzen en het andere bekritiseren in één adem. Het vakgebied Aspect-Based Sentiment Analysis lost dit op door te vragen: wat is het sentiment ten opzichte van elk specifiek doel, zoals “service”, “sfeer” of “personeel” in een restaurantrecensie. Vroegere methoden vertrouwden op handgemaakte regels of eenvoudige machine learning die woorden telde, en gingen daarna over op neurale netwerken die tekst sequentieel lezen, zoals van links naar rechts. Deze sequentiële modellen verbeterden de nauwkeurigheid maar misten nog steeds langafstandskoppelingen en subtiele signalen, vooral wanneer de belangrijke woorden ver uit elkaar staan of verbonden zijn door tegenstellingwoorden zoals “maar” en “hoewel”.

Zinnen omzetten in verbonden kaarten

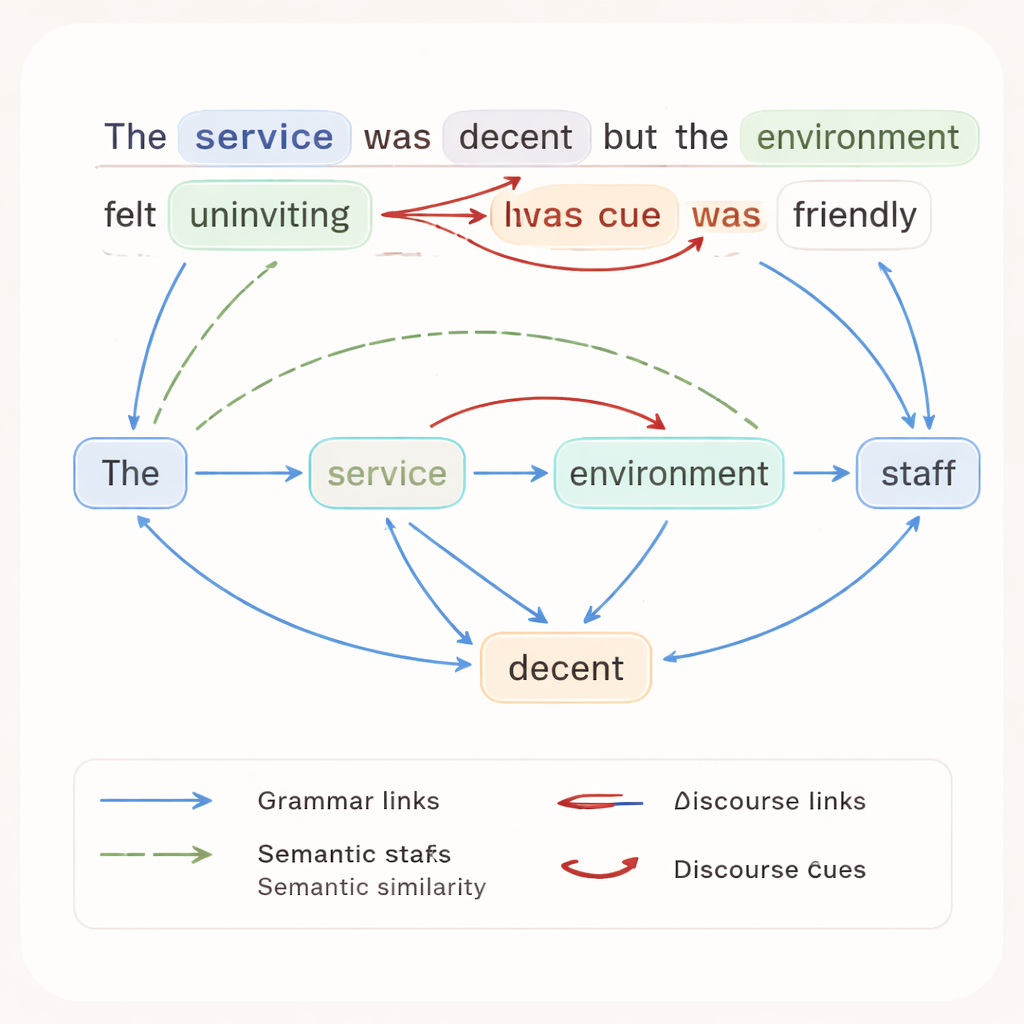

De auteurs stellen dat om fijnmazige meningen echt te begrijpen, een computer een zin als een netwerk moet zien in plaats van als een rechte lijn. In hun benadering wordt elk woord een knoop in een graaf, en verschillende typen relaties worden randen. Een reeks randen legt grammatica vast, zoals welk woord onderwerp of lijdend voorwerp is. Een andere reeks koppelt woorden die qua betekenis op elkaar lijken, zelfs als ze niet naast elkaar staan. Een derde reeks markeert discoursaanwijzingen—woorden als “maar”, “echter” of “hoewel” die vaak een verandering in sentiment aangeven. In een zin als “De service was redelijk maar de sfeer voelde onaantrekkelijk hoewel het personeel vriendelijk was” toont deze graaf hoe lof en kritiek rond verschillende aspecten zijn verweven.

Een dubbele spotlight op context en aspecten

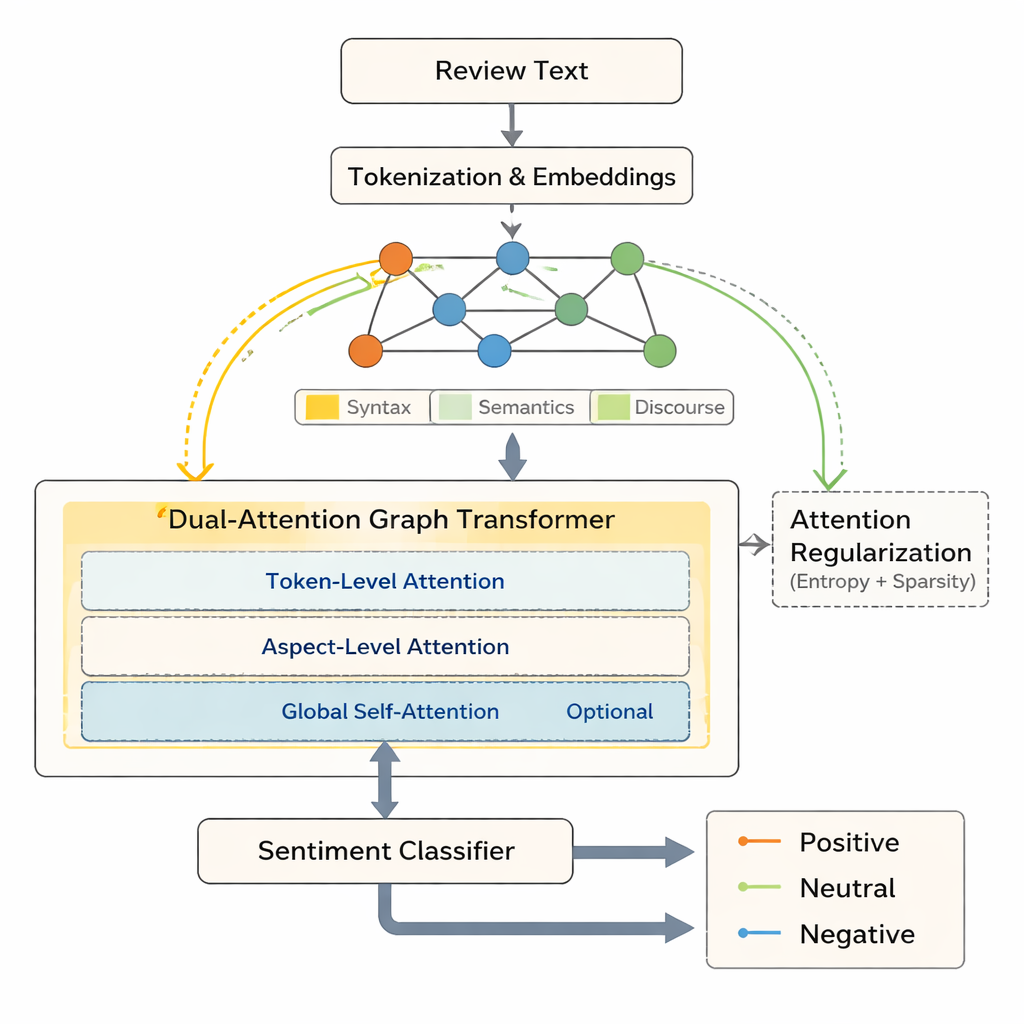

Uitbouwend op deze graafvisie presenteert het artikel de Multi-Relational Dual-Attention Graph Transformer (MRDAGT). Dit model gebruikt een Transformer-achtige aandachtmechaniek aangepast aan grafen. Eén aandachtkop kijkt breed naar hoe alle woorden in de zin zich tot elkaar verhouden en verzamelt nuttige lokale context. Een tweede aandachtkop richt zich specifiek op het te beschouwen aspect—bijvoorbeeld “service” of “sfeer”—en verhoogt de invloed van woorden die meningen over dat doel vormgeven, zoals “redelijk” of “onaantrekkelijk”. Wanneer er meerdere aspecten in één zin zijn, helpt een optionele globale aandachtslaag het model hun interacties te wegen. In feite schijnt het systeem twee gecoördineerde spotlights: één op de algemene zinsstructuur en één direct op het aspect waarvan het sentiment wordt beoordeeld.

Machine-aandacht selectiever en uitlegbaarer maken

Een belangrijk punt bij moderne AI is dat aandachtgewichten—de getallen die aangeven op welke woorden het model zich richtte—te verspreid kunnen zijn, waardoor beslissingen moeilijk te interpreteren zijn. MRDAGT pakt dit aan met twee regulariserende krachten. Een entropiestraf ontmoedigt te vlakke aandacht en zet het model ertoe aan zich scherper te concentreren op een paar belangrijke woorden. Tegelijkertijd duwt een L1-sparsiteitsterm veel aandachtverbindingen richting nul en snoeit zwakke, ruisende connecties weg. Samen creëren deze krachten “gefocuste sparsiteit”: het model plaatst heldere, hoge gewichten op echt relevante woord–aspect-paren terwijl afleidingen worden genegeerd. Experimenten op drie benchmarkdatasets—formeel laptopreviews, complexe meerzinnige recensies en informele Twitter-berichten—tonen dat MRDAGT consequent sterke bestaande systemen met ongeveer één tot twee procentpunten in nauwkeurigheid verslaat, terwijl het ook schonere, beter interpreteerbare aandachtskaarten produceert.

Wat dit betekent voor opinieanalyse in de praktijk

Voor niet-specialisten is de conclusie dat dit model een preciezere, betrouwbaardere manier biedt om meningen uit rommelige, reële tekst te halen. In plaats van alleen te zeggen dat een recensie “voornamelijk positief” is, kan MRDAGT afzonderlijk rapporteren dat klanten de snelheid van een apparaat waarderen maar de batterij vervelend vinden, of dat eters het personeel van een café waarderen maar klagen over lawaai. Omdat de aandachtspatronen van het model overeenkomen met menselijke intuïtie—met focus op tegenstellingwoorden, sentimentadjectieven en aspecttermen—is het voor analisten gemakkelijker te zien waarom het model een bepaald oordeel gaf. De auteurs suggereren dat deze benadering betere productontwerpbeslissingen, scherper socialemediatoezicht en toekomstige uitbreidingen naar meerdere talen en zelfs multimodale data zoals audio en afbeeldingen kan ondersteunen, terwijl het redeneringsproces relatief transparant blijft.

Bronvermelding: Anilkumar, A.P., Kim, SK. & Yoon, YC. Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis. Sci Rep 16, 7236 (2026). https://doi.org/10.1038/s41598-026-36490-6

Trefwoorden: aspectgebaseerde sentimentanalyse, graf-neurale netwerken, transformer-aandacht, meningsextractie, natuurlijke taalverwerking