Clear Sky Science · nl

Een collaboratief multi-attentie netwerk voor realtime detectie van kleine objecten in UAV-beelden

Waarom het opsporen van piepkleine details vanuit de lucht belangrijk is

Naarmate drones gemeengoed worden voor verkeersmonitoring, hulpverlening bij rampen en beveiliging, moeten ze betrouwbaar zeer kleine objecten herkennen—zoals auto’s, fietsen of mensen—die van grote hoogte worden waargenomen. In zulke luchtbeelden zijn doelen slechts enkele pixels breed en gaan ze makkelijk verloren in schaduwen, schittering en drukke achtergronden. Dit artikel introduceert een nieuw computervisie-systeem, het Collaborative Multi-Attention Network (CMA-Net), dat is ontworpen om zulke kleine objecten in dronebeelden snel en nauwkeurig te detecteren, genoeg voor realtime gebruik.

Uitdagingen bij het zien van kleine dingen van boven

Het detecteren van kleine objecten in dronebeelden is moeilijker dan in gewone straatfoto’s. Doordat drones hoog vliegen en scènes vanuit wisselende hoeken bekijken, lijken voertuigen en mensen klein en onscherp, en kan de verlichting snel veranderen. Traditionele tweestapsdetectors kunnen zeer nauwkeurig zijn maar zijn vaak te traag voor realtimetoepassingen op vliegende platforms met beperkte rekenkracht en bandbreedte. Snellere éénstapsmethoden draaien wel realtime maar missen vaak kleine doelen omdat hun details geleidelijk vervagen bij verwerking door meerdere lagen. De auteurs stellen dat betere detectie van kleine objecten slimme manieren vereist om informatie over schalen heen te combineren en rekenkundige aandacht te richten op de meest informatieve delen van een beeld.

Het bouwen van een slimmer feature-ladder

CMA-Net begint met een veelgebruikte beeldverwerkingsbackbone, ResNet-50, en voegt vervolgens een Efficient Bi-directional Feature Pyramid Network (E-BiFPN) toe. Deze structuur bouwt een soort ladder van featuremaps op verschillende groottes, waardoor het systeem fijne details uit vroege lagen kan mengen met meer abstracte context uit diepere lagen. In tegenstelling tot eerdere ontwerpen snoeit E-BiFPN onnodige hoge-niveau lagen weg en voegt het een speciaal lichtgewicht verwerkingsblok toe dat gebruikmaakt van gedeeltelijke convoluties om de rekencapaciteit te verlagen. Een gewogen fusieschema leert vervolgens hoeveel vertrouwen aan ondiepe versus diepe features op elke schaal moet worden gegeven, zodat kwetsbare informatie over piepkleine auto’s of voetgangers wordt versterkt terwijl ruis uit de achtergrond wordt verminderd.

Het netwerk leren waar te kijken

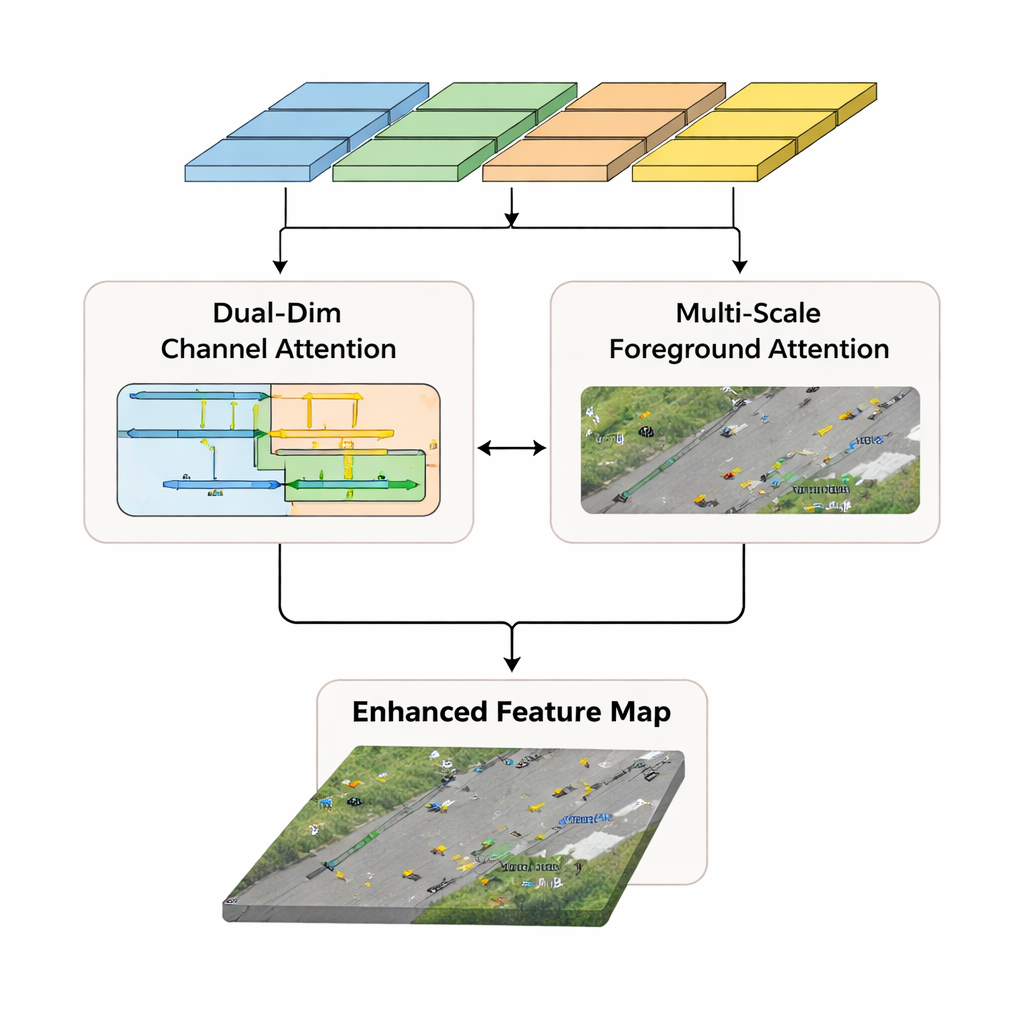

Buiten het herschikken van features gebruikt CMA-Net attentiemechanismen die nabootsen hoe mensen zich op relevante delen van een scène concentreren. Een Dual-Dimensional Channel Attention (DDCA)-module analyseert features afzonderlijk langs de breedte en hoogte van het beeld, in plaats van alles samen te persen tot één globale samenvatting. Dit ontwerp helpt het netwerk langafstandspatronen in zowel horizontale als verticale richting vast te leggen en behoudt locatie-informatie die cruciaal is wanneer kleine objecten opgaan in complexe omgevingen. Parallel daaraan koppelt een Multi-Scale Foreground Attention (MSFA)-module grote, gemakkelijk herkenbare objecten in diepere lagen aan kleinere in ondiepere lagen. Door informatie van drie schalen te bemonsteren en te versmelten, leert MSFA voorgrondgebieden te accentueren waar voertuigen waarschijnlijk zijn en verwarrende achtergrondtexturen te onderdrukken.

Van verbeterde features naar snelle besluitvorming

De uitkomsten van de DDCA- en MSFA-takken worden samengevoegd tot rijke, voor kleine objecten geschikte featuremaps die naar een "anchor-free" detectiekop worden gestuurd. In plaats van te vertrouwen op een dicht raster van vooraf ingestelde kaders, voorspelt deze kop direct zowel de categorie als de positie van objecten, wat de berekeningen vereenvoudigt en het trainen flexibeler maakt. De auteurs evalueerden CMA-Net op twee veeleisende publieke dronedatasets, UAVDT en Stanford Drone, die drukke wegen, uiteenlopend weer en dag–nachtcondities bevatten. CMA-Net behaalde nauwkeurigheidsscores van 67,2% en 62,0% op deze datasets terwijl het met 64 frames per seconde draaide, wat betekent dat het video realtime kan verwerken en beter presteert dan veel populaire detectors, waaronder enkele leden van de YOLO-familie en complexere modellen op basis van transformers.

Wat dit betekent voor drones in de praktijk

Voor niet-specialisten is de kernboodschap dat CMA-Net de mogelijkheid van een drone om kleine, moeilijk waarneembare objecten te signaleren aanzienlijk verbetert zonder de snelheid te verminderen. Door informatie zorgvuldig over meerdere schalen te versmelten en de aandacht van het netwerk zowel over afbeeldingskanalen als tussen voorgrond en achtergrond te sturen, voorkomt de methode dat piepkleine voertuigen en mensen over het hoofd worden gezien. Deze combinatie van nauwkeurigheid en snelheid maakt de aanpak veelbelovend voor praktische toepassingen zoals intelligente verkeersmonitoring, menigtenobservatie en hulpverlening, waar het missen van een klein object of te traag reageren ernstige gevolgen kan hebben.

Bronvermelding: Yang, J., Yue, X. & Wu, L. A collaborative multi-attention network for real-time small object detection in UAV imagery. Sci Rep 16, 5852 (2026). https://doi.org/10.1038/s41598-026-36440-2

Trefwoorden: dronevisie, detectie van kleine objecten, realtime bewaking, attentienetwerken, verkeersmonitoring