Clear Sky Science · nl

Een diep sentimentmodel dat ALBERT-gestuurde context en EHO-geoptimaliseerde architectuur combineert

Waarom slimmer sentimentlezen ertoe doet

Elke dag delen miljoenen mensen meningen over producten, diensten, politiek en gebeurtenissen op het internet. Deze stroom tekst omzetten in betrouwbare inzichten is cruciaal voor bedrijven, overheden en wetenschappers. Toch is onze online taal rommelig: sarcastische grappen, straattaal, typefouten en zeldzame emoties kunnen computers gemakkelijk verwarren. Dit artikel introduceert een nieuw sentimentanalyzesysteem dat zulke emoties nauwkeuriger wil lezen, terwijl het minder rekenkracht gebruikt dan veel huidige kunstmatige-intelligentie-modellen.

Van eenvoudige woordtelling naar contextbewust lezen

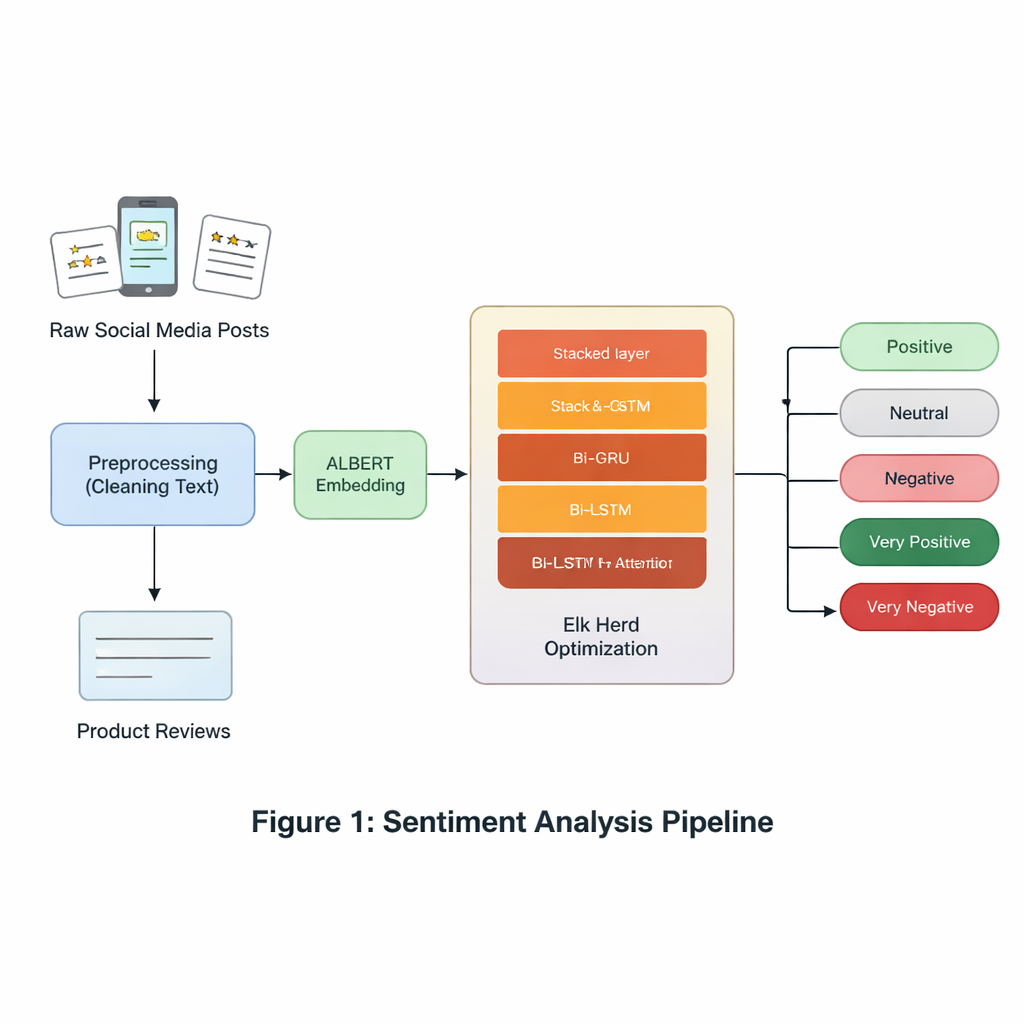

Vroege tools voor sentimentanalyse behandelden tekst als een zak losse woorden en telden hoe vaak termen zoals “goed” of “verschrikkelijk” voorkwamen. Deze aanpak negeerde woordvolgorde en subtiele context, zoals dat “niet slecht” dichter bij “best goed” ligt. Deep-learningmethoden verbeterden dit door tekst als reeksen te verwerken, maar ze vereisten vaak enorme gelabelde datasets en veel rekenkracht. Transformermodellen zoals BERT verhoogden de nauwkeurigheid nog verder, maar hun grote omvang maakt ze duur om in echte toepassingen te draaien, bijvoorbeeld in klantenserviceplatforms of systemen voor socialemediamonitoring. De auteurs van dit artikel beantwoorden die uitdaging door meerdere lichtere maar krachtige componenten te combineren in één gestroomlijnd systeem.

Een slanker brein voor tekstbegrip

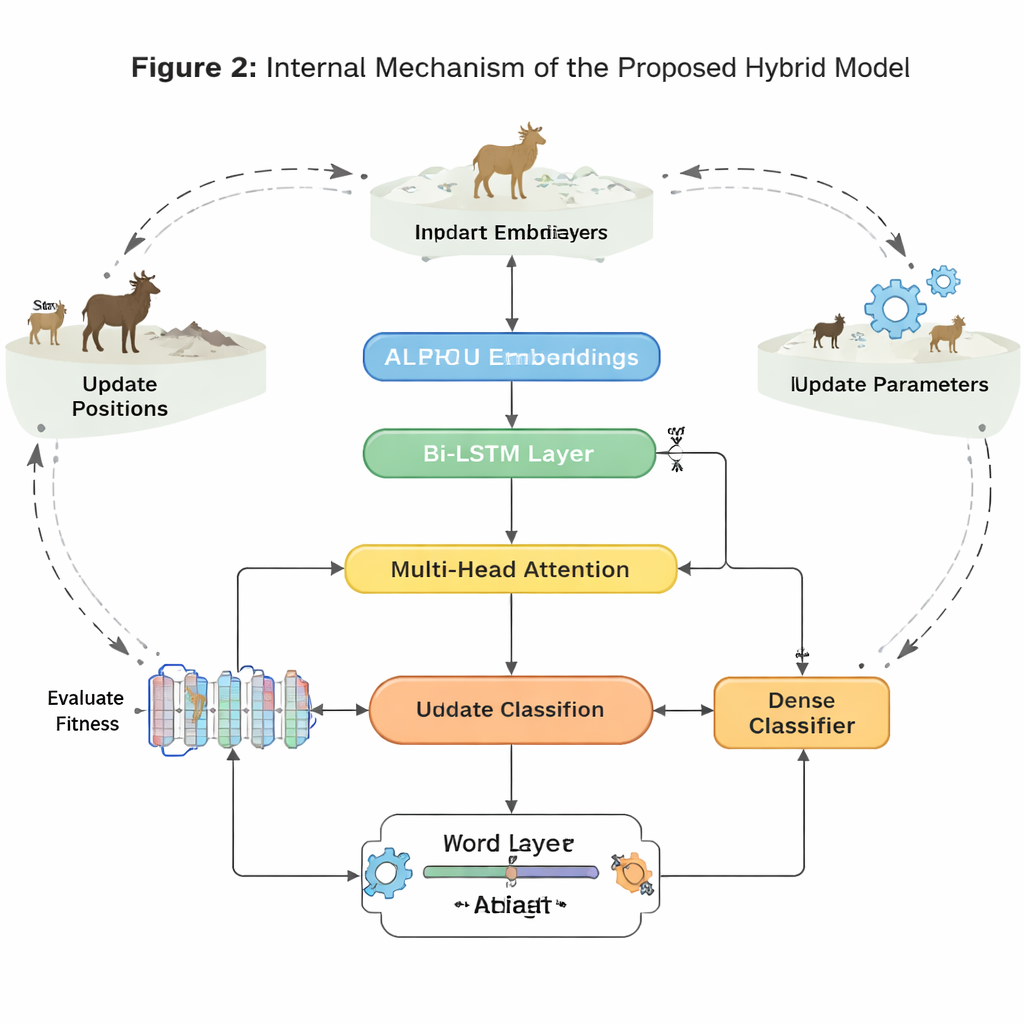

Centraal in het model staat ALBERT, een compacte neef van het BERT-taalmodel. ALBERT zet elk woord in een zin om in een contextbewuste numerieke representatie, waarmee wordt vastgelegd hoe betekenissen verschuiven afhankelijk van naburige woorden. In tegenstelling tot grotere modellen vermindert ALBERT het geheugenverbruik door parameters tussen lagen te delen en de woordenschat te comprimeren. Daardoor is het eenvoudiger te draaien op standaardhardware zonder veel begrip in te leveren. Deze op ALBERT gebaseerde woordrepresentaties vormen de input voor een reeks gespecialiseerde lagen die zich richten op hoe sentimenten zich door een zin heen ontvouwen.

Twee geheugensystemen die samenwerken

Om te volgen hoe betekenis van woord tot woord verandert, gebruikt het systeem twee typen recurrente netwerken: GRU’s (Gated Recurrent Units) en LSTM’s (Long Short-Term Memory-units), elk zowel in voorwaartse als achterwaartse richting uitgevoerd. GRU’s zijn efficiënt in het volgen van korte frasen met minder parameters, terwijl LSTM’s beter informatie over langere tekststroken kunnen vasthouden. Door een bidirectionele GRU-laag bovenop een bidirectionele LSTM-laag te stapelen en een attentiemechanisme toe te voegen, kan het model de meest sentimentrijke delen van een zin benadrukken—zoals de frase “behalve de batterijduur” in een verder positieve recensie. Dit hybride ontwerp streeft ernaar zowel snelle toonverschuivingen als langdurige context vast te leggen die het algemene sentiment kunnen keren.

Natuurgeïnspireerde afstemming voor lastige gevallen

Buiten de architectuur pakken de auteurs een belangrijke praktische uitdaging aan: sentimentdatasets zijn vaak onevenwichtig en luidruchtig. Emoties zoals walging of verrassing, en neutrale uitspraken, komen minder vaak voor dan duidelijk positieve of negatieve, waardoor veel modellen ze negeren. Om dit tegen te gaan gebruikt het artikel Elk Herd Optimization, een natuurgeïnspireerde zoekstrategie gemodelleerd op hoe elanden zich bewegen, concurreren en groepen vormen. Nadat het neurale netwerk interne sentimentvectoren produceert, verfijnt deze optimalisatiestap hoe die vectoren elke klasse representeren, vooral de zeldzame, door iteratief een ‘fitheid’-score te verbeteren. Dit proces helpt het model ondiepe oplossingen te vermijden en verbetert het vermogen subtiele of ondervertegenwoordigde emoties te onderscheiden.

Het model op de proef gesteld

De auteurs evalueren hun systeem op zes veelgebruikte datasets, waaronder Twitter-berichten, restaurant- en laptoprecensies, en een vijfniveaus-filmanalysedataset die zeer positieve en zeer negatieve meningen onderscheidt van meer gematigde. Over deze verschillende bronnen presteert de nieuwe aanpak consequent beter dan meerdere geavanceerde grafgebaseerde en transformergebaseerde concurrenten, zowel in nauwkeurigheid als in F1-score, een maat die juiste treffers en gemiste gevallen in balans brengt. De winst is vooral sterk op de vijfklassenfilmtaken en op ondervertegenwoordigde sentimentklassen, wat laat zien dat de methode zowel fijnmazige emoties als scheve data aankan. Een ablatiestudie, waarbij componenten één voor één worden verwijderd, bevestigt dat ALBERT, het gecombineerde GRU–LSTM-ontwerp, attentie en eland-geïnspireerde optimalisatie elk bijdragen aan de algehele prestatie.

Wat dit betekent voor dagelijkse toepassingen

Voor niet-specialisten is de belangrijkste conclusie dat dit onderzoek een efficiëntere en betrouwbaardere manier biedt om grote hoeveelheden online opinie te interpreteren. Door een compact taalmodel te mengen met complementaire geheugenslagen en een biologisch geïnspireerde afstap, leest het systeem impliciete informatie nauwkeuriger, vooral wanneer sentimenten subtiel zijn of de data scheef verdeeld. Dit maakt het veelbelovend voor praktische toepassingen zoals het volgen van klanttevredenheid, het monitoren van publieke gezondheidsattitudes of het peilen van reacties op beleid en gebeurtenissen, waar zowel precisie als rekencost belangrijk zijn.

Bronvermelding: Oqaibi, H., Sharma, S. A deep sentiment model combining ALBERT-driven context and EHO-optimized architecture. Sci Rep 16, 5784 (2026). https://doi.org/10.1038/s41598-026-36389-2

Trefwoorden: sentimentanalyse, ALBERT, deep learning, tekstclassificatie, metaheuristische optimalisatie