Clear Sky Science · nl

Meta-leren voor few-shot open taakherkenning

Waarom AI leren met heel weinig voorbeelden ertoe doet

Moderne AI-systemen kunnen gezichten, dieren en alledaagse voorwerpen met opmerkelijke nauwkeurigheid herkennen—maar meestal pas nadat ze miljoenen gelabelde beelden hebben gezien. In veel echte situaties, zoals het stellen van een diagnose bij een zeldzame ziekte of het opsporen van een nieuw type defect op een productielijn, hebben we eenvoudigweg niet zoveel data. Dit artikel onderzoekt hoe je AI-modellen kunt trainen die nieuwe visuele taken kunnen leren uit slechts een handvol voorbeelden, zelfs wanneer die taken behoorlijk verschillen van wat het model tijdens training heeft gezien. Het introduceert een methode genaamd Open-MAML die bedoeld is om dit soort flexibele, data-arme leren betrouwbaarder en voorspelbaarder te maken.

Van vaste klaslokaloefeningen naar open-eindige verrassingsopgaven

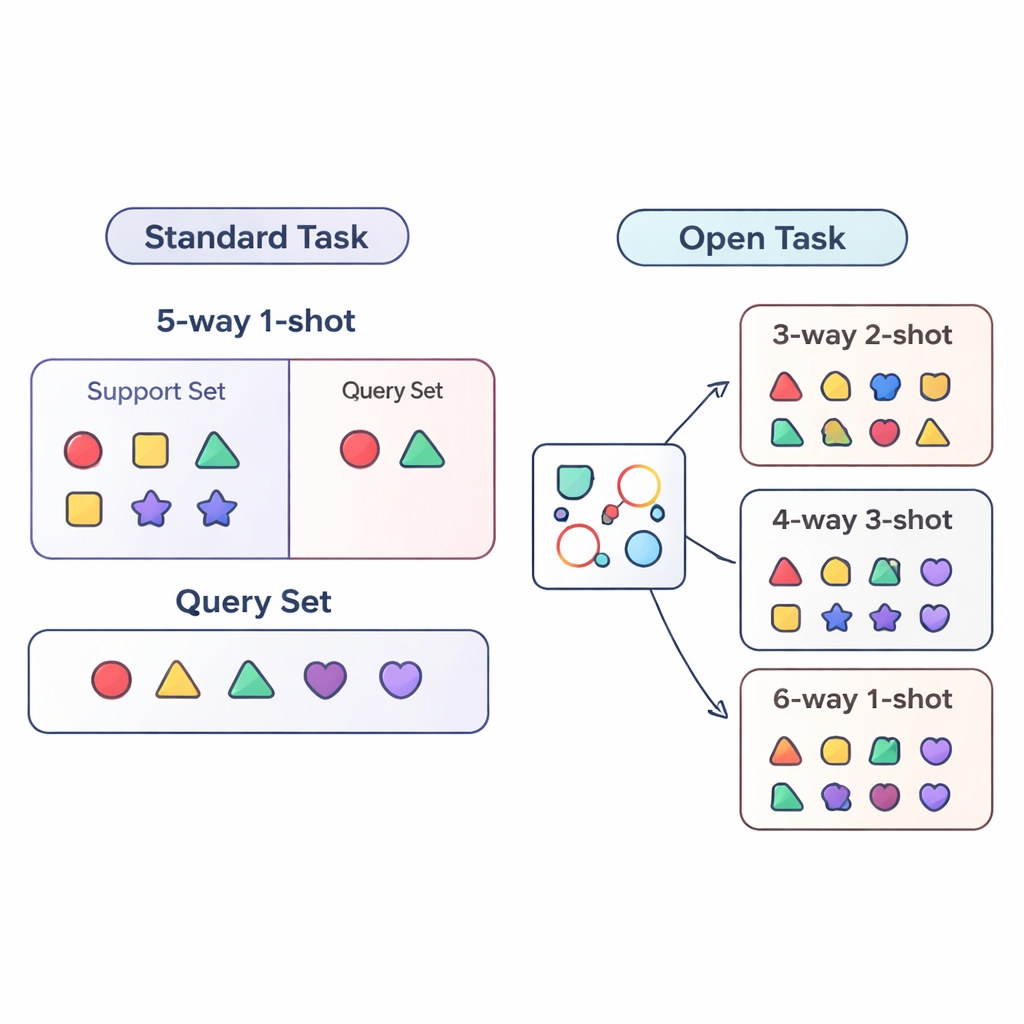

Het merendeel van het onderzoek naar "few-shot learning" evalueert AI-systemen onder strikt gecontroleerde omstandigheden. Het model wordt getraind en getest op zeer vergelijkbare taken, bijvoorbeeld altijd moeten onderscheiden tussen precies vijf categorieën (zogenaamde "5-way") met één voorbeeld per categorie ("1-shot"). Dat is vergelijkbaar met een student die alleen wordt geoefend op vijf-vraag-quizzen met één oefenvoorbeeld per vraagtype. In de echte wereld is het veel rommeliger: het aantal categorieën kan veranderen en de hoeveelheid gelabelde data per categorie kan in de loop van de tijd toenemen of afnemen. De auteurs noemen deze realistischere situatie de open-task setting, waarbij modellen taken moeten aankunnen met aantallen klassen en voorbeelden die verschillen van alles wat ze tijdens training zagen.

Hernieuwen van hoe we few-shot-lezers testen

Om deze open-task wereld systematisch te bestuderen, stelt het artikel drie evaluatieregimes voor. In het cross-way-regime verandert alleen het aantal klassen: het model kan op vijf klassen zijn getraind maar worden getest op drie of vijftien. In het cross-shot-regime varieert het aantal voorbeelden per klasse, van één gelabelde afbeelding tot meerdere. Het moeilijkste geval is cross-way–cross-shot, waarbij zowel het aantal klassen als de hoeveelheid data per klasse samen veranderen. De auteurs onderzoeken ook wat er gebeurt wanneer de visuele stijl van de data verschuift, door te trainen op een algemeen objectdataset en te testen op een fijnmazig vogeldataset. Deze opstellingen zijn ontworpen om aan het licht te brengen of een methode echt kan generaliseren buiten een enkel, vast trainingsrecept.

Hoe Open-MAML zich onderweg aanpast

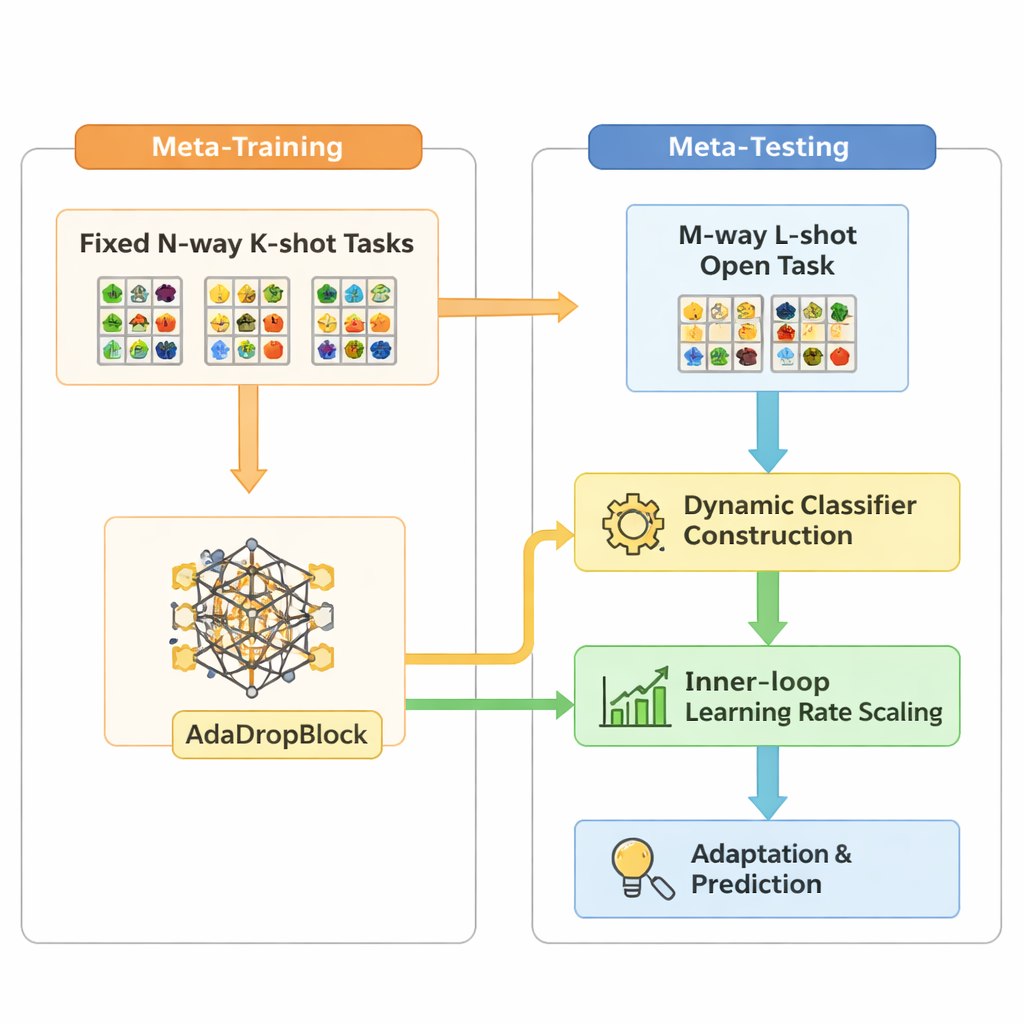

Open-MAML bouwt voort op een populaire meta-lerenstrategie genaamd Model-Agnostic Meta-Learning (MAML), die een model zodanig traint dat het snel kan aanpassen aan een nieuwe taak met een paar gradientstappen. Standaard MAML gaat er echter van uit dat het aantal categorieën tijdens testtijd overeenkomt met de training en gebruikt een vaste eindclassificatielaag. Open-MAML introduceert drie belangrijke aanpassingen om deze beperking te doorbreken. Ten eerste gebruikt het dynamische classificatorconstructie: wanneer een nieuwe taak meer klassen heeft dan voorheen, creëert het extra outputunits door het gemiddelde van de bestaande te kopiëren, waardoor het model een neutraal maar redelijk startpunt krijgt. Ten tweede past het de innerlijke leersnelheid aan op basis van hoeveel klassen en voorbeelden de taak heeft, zodat de aanpassing stabiel blijft, ongeacht of data schaars of overvloedig zijn. Ten derde voegt het een regularizer toe genaamd AdaDropBlock die tijdens training tijdelijk aaneengesloten regio’s in featuremaps verbergt, waardoor het model wordt aangemoedigd meer diverse visuele aanwijzingen te gebruiken in plaats van te overfitten op kleine, fragiele details.

Flexibel leren op de proef gesteld

De onderzoekers evalueren Open-MAML op standaard few-shot benchmarks en onder de nieuwe open-task scenario’s, en vergelijken het met meerdere bekende basismodellen. Deze omvatten modellen die per taak vanaf nul worden getraind, modellen die een sterk voorgetrachte feature-extractor gebruiken plus een fijn-afgestelde classificator, en metriek-gebaseerde methoden die afbeeldingen classificeren op basis van hun afstand tot klasse-"prototypes." Alle methoden gebruiken dezelfde backbone-netwerk zodat verschillen voortkomen uit de leermethode en niet uit de architectuur. Over tienduizenden testtaken behaalt Open-MAML consequent hogere nauwkeurigheid—typisch 1–7 procentpunten beter wanneer alleen het aantal klassen of voorbeelden verandert, en 3–6 punten beter wanneer beide variëren. De winst is nog duidelijker bij moeilijkere instellingen met meer klassen, meer shots, of een verschuiving naar het vogeldataset, wat erop wijst dat de adaptatiemechanismen daadwerkelijk helpen in complexe, onbekende omstandigheden.

Wat dit betekent voor AI-systemen in de praktijk

Voor een algemene lezer is de kernboodschap dat niet alle few-shot-lezers gelijk zijn zodra we het comfort van het lab verlaten. Een methode die uitblinkt op één vast benchmark kan struikelen wanneer het aantal categorieën of de hoeveelheid gelabelde data verandert. Open-MAML laat zien dat door expliciet rekening te houden met zulke structurele veranderingen—de classificator laten groeien of krimpen, de leersnelheid schalen met de taakgrootte, en feature-regularisatie op een taak-onafhankelijke manier—AI-systemen beter kunnen omgaan met de wisselende omstandigheden die ze in de praktijk zullen tegenkomen. In toepassingen zoals medische beeldvorming, satellietmonitoring of industriële inspectie, waar zowel de set van categorieën als de beschikbaarheid van labels voortdurend verandert, kan deze vorm van open-task-robuustheid few-shot learning veel bruikbaarder maken buiten zorgvuldig samengestelde onderzoeksbenchmarks.

Bronvermelding: Han, X., Shi, D., Wang, Z. et al. Meta-learning for few-shot open task recognition. Sci Rep 16, 5624 (2026). https://doi.org/10.1038/s41598-026-36291-x

Trefwoorden: few-shot learning, meta-learning, open-task recognition, image classification, generalization