Clear Sky Science · nl

Hiërarchische NBV-beslissing op basis van wederzijdse informatie voor actieve semantische visuele SLAM in dynamische omgevingen

Robots die vooruit kunnen denken

Nu robots de fabrieken verlaten en huizen, ziekenhuizen en kantoren binnengaan, moeten ze zich verplaatsen in ruimtes vol mensen en andere bewegende objecten. Dit artikel introduceert een nieuwe manier voor een robot om "vooruit te denken" over waar hij naar moet kijken en hoe hij zich moet verplaatsen, zodat hij een betrouwbare kaart van zijn omgeving kan opbouwen—zelfs wanneer die omgeving niet stil blijft staan. Het werk is relevant voor iedereen die geïnteresseerd is in veiligere servicrobots, slimmere bezorgrobots of toekomstige thuishulpen die ruimte moeten delen met mensen in plaats van met lege gangen.

Waarom bewegende mensen robots verwarren

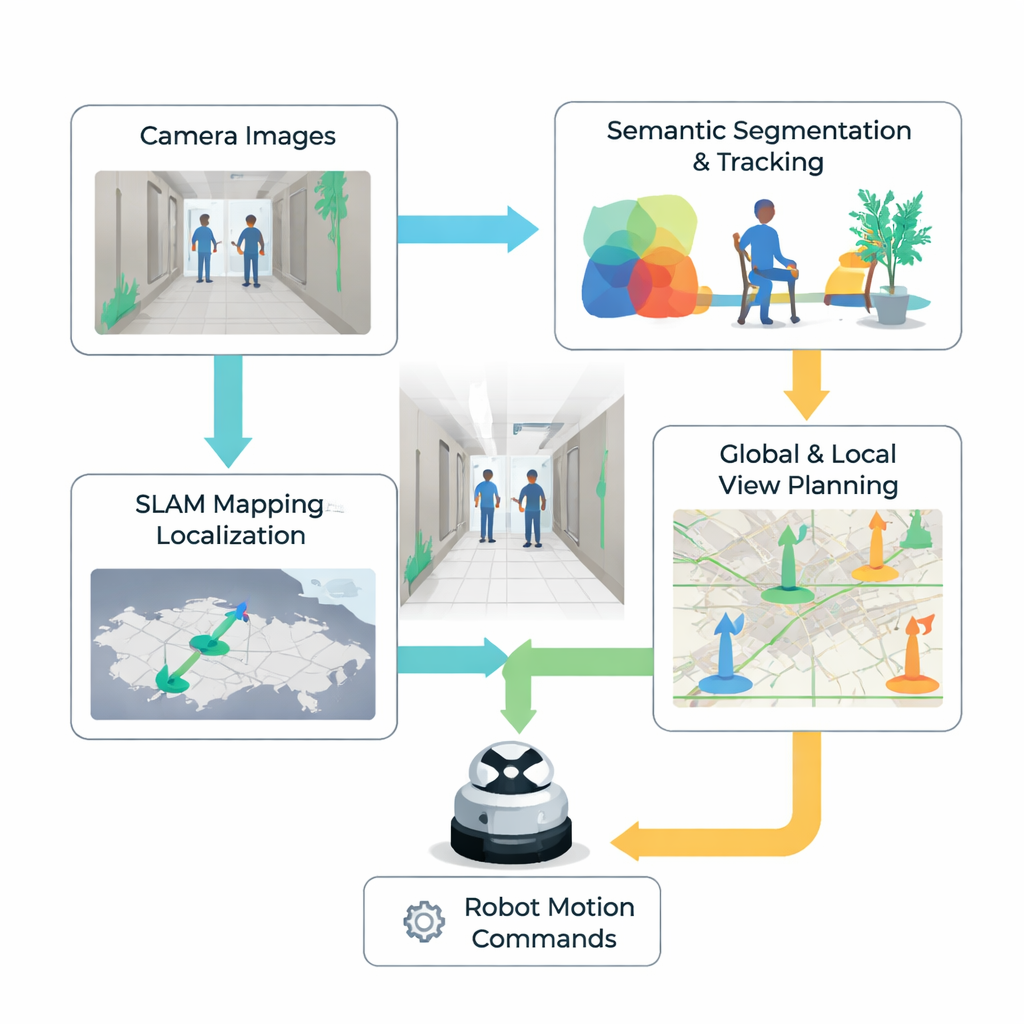

Veel robots gebruiken visuele SLAM om autonoom te navigeren: een camera helpt tegelijkertijd een kaart op te bouwen en de positie te schatten. Dat werkt goed in statische omgevingen, maar loopt snel vast wanneer mensen voorbij lopen, het zicht blokkeren of objecten dragen. Eén veelgebruikte oplossing is semantische visie, zodat de robot mensen, auto’s en stoelen kan herkennen en deze simpelweg negeert bij het kaartbouwen. Dat schept echter een nieuw probleem voor actieve robots die hun eigen routes kiezen: als ze te veel visuele aanwijzingen weggooien, kunnen ze helemaal de draad kwijt raken. Het beperkte gezichtsveld van de camera maakt het nog lastiger, omdat één passerend persoon dichtbij het grootste deel van het nuttige landschap uit het zicht kan houden.

Een tweelaagse strategie om te kiezen waar je als volgende kijkt

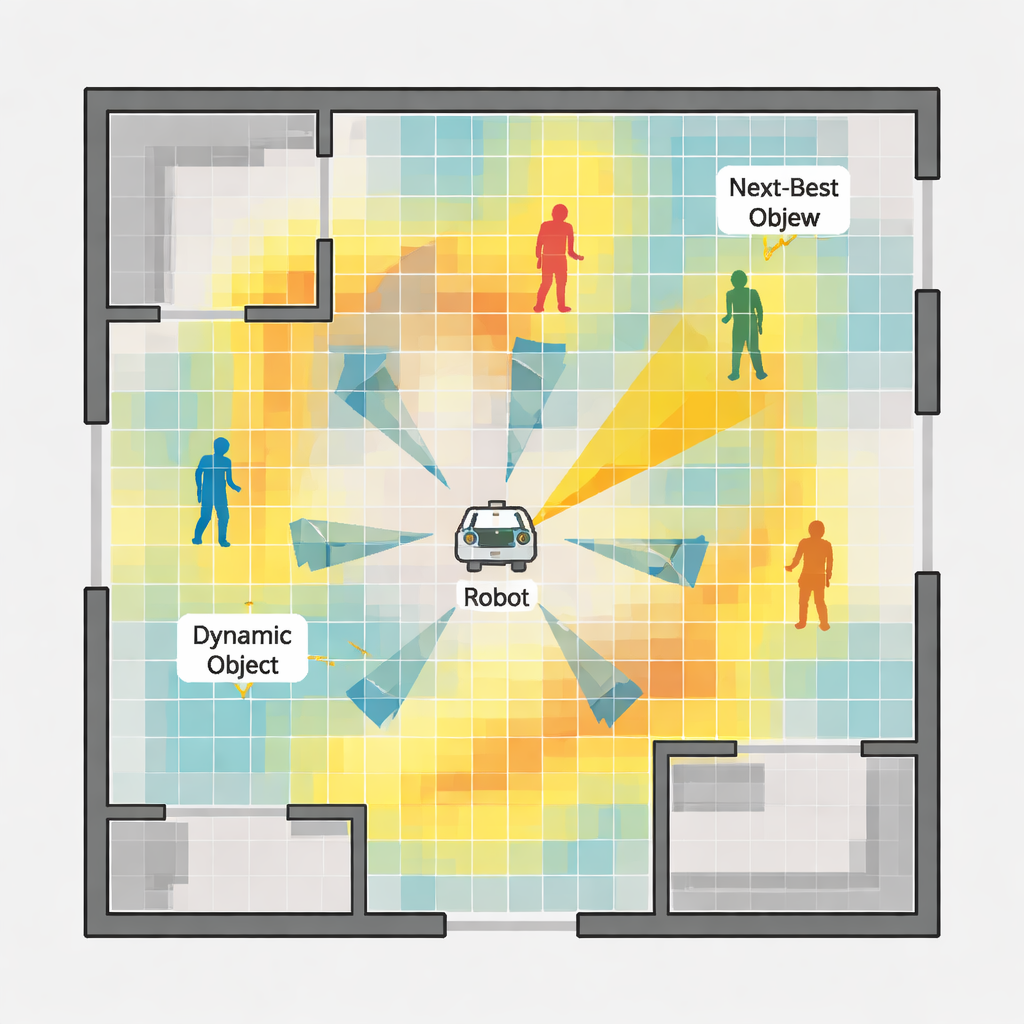

De auteurs stellen een hiërarchisch beslissysteem voor dat een robot helpt zijn volgende gezichtspunten op een beter geïnformeerde manier te kiezen. Op het hogere niveau houdt de robot een vogelvluchtrooster bij van vrije, bezette en onbekende gebieden. Hij evalueert mogelijke verre gezichtspunten door in te schatten hoeveel elk punt de onzekerheid in deze kaart zou verminderen, een concept uit de informatietheorie. De robot geeft de voorkeur aan plekken die grote onontdekte gebieden onthullen en neemt daarbij ook in aanmerking hoe ver hij moet reizen en hoeveel hij de camera moet draaien. Zodra een veelbelovend gebied is gekozen, neemt een lager niveau het over om precies te verfijnen hoe de robot zich binnen die buurt moet bewegen en richten, zodat hij met zijn smalle camerazicht daadwerkelijk voldoende nuttige details kan zien.

Zien wat stabiel is en ontwijken wat dat niet is

Centraal in het lokale beslissingsproces staat een "feature probability map" die uit elke camerabeeld wordt opgebouwd. Eerst detecteert het systeem visuele landmerken—hoeken en patronen in de scène—die waarschijnlijk stabiel blijven en nuttig zijn voor het volgen van beweging. Vervolgens gebruikt het een moderne objectdetector om mogelijk bewegende objecten, zoals mensen, te vinden en volgt deze over frames heen. Door te analyseren hoe deze objecten bewegen, schat het systeem niet alleen waar ze nu zijn, maar ook waar ze waarschijnlijk op korte termijn zullen zijn. Deze twee informatiebronnen worden samengevoegd in een warmtekaart over het beeld: heldere regio’s geven een hoge kans aan op het zien van betrouwbare landmerken, terwijl donkere regio’s plekken markeren die weinig features bevatten of waarschijnlijk door bewegende objecten worden bedekt. De robot gebruikt deze kaart om te bepalen welke kleine beweging—links draaien, rechts draaien of vooruit bewegen—hem de volgende keer het duidelijkste en meest stabiele zicht zal geven.

Testen in virtuele werelden en de echte wereld

De onderzoekers testten hun aanpak in twee gesimuleerde binnenscenario’s van verschillende grootte en complexiteit, elk bevolkt met zwervende virtuele voetgangers, en daarna op een fysieke robot die door een echte binnenruimte reed. Ze vergeleken hun methode met verschillende gevestigde verkenningsstrategieën die hoofdzakelijk gericht zijn op het afdekken van ruimte of het verkorten van reistijd. In de simulaties leverde het nieuwe systeem kaarten met minder vervorming en behaalde het een betere positienauwkeurigheid, terwijl het in ongeveer dezelfde of kortere tijd verkende. Het raakte ook minder snel de positie kwijt of kwam ongemakkelijk dicht bij bewegende mensen. In het experiment in de echte wereld draaide de methode in realtime op een standaard robotcomputer, wat bevestigt dat het praktisch inzetbaar is buiten het lab.

Wat dit betekent voor alledaagse robots

In eenvoudige bewoordingen leert dit werk een robot kieskeurig te zijn over waar hij kijkt en waar hij naartoe gaat wanneer mensen in de buurt zijn. Door scene-understanding, bewegingsvoorspelling en een maat voor informatiewinst te combineren, kan de robot zichzelf naar kijkhoeken sturen die zowel informatief als veilig zijn, in plaats van simpelweg naar de dichtstbijzijnde onontdekte hoek te lopen. Dat maakt zijn interne kaart betrouwbaarder en zijn bewegingen voorspelbaarder—belangrijke ingrediënten voor robots die drukke ruimtes met mensen moeten delen. Er blijven uitdagingen bestaan—zoals plotselinge grote menigten die de camera blokkeren—maar de aanpak is een stap richting thuis- en servicrobots die gracieux met de rommelige, dynamische aard van het echte leven kunnen omgaan.

Bronvermelding: Yang, Z., Sang, A.W.Y., Muthugala, M.A.V.J. et al. Mutual information-based hierarchical NBV decision for active semantic visual SLAM under dynamic environments. Sci Rep 16, 5847 (2026). https://doi.org/10.1038/s41598-026-36259-x

Trefwoorden: actieve SLAM, robotnavigatie, dynamische omgevingen, semantische mapping, next-best view