Clear Sky Science · nl

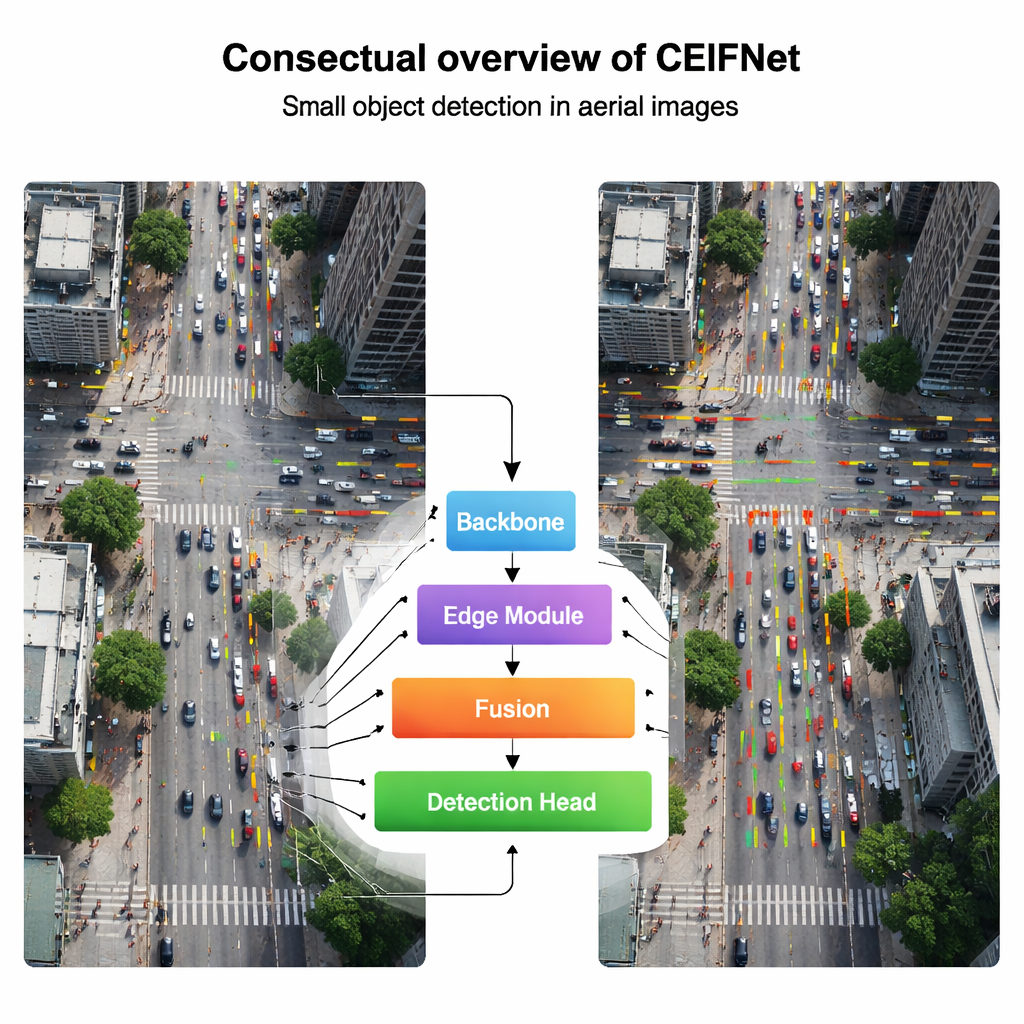

Cross-stage edge information fusion network voor detectie van kleine objecten in luchtbeelden

Waarom het belangrijk is kleine details vanuit de lucht te zien

Van verkeersmonitoring en hulp bij rampen tot gewasbeheer: steeds meer van onze wereld wordt vanuit de lucht door drones in de gaten gehouden. Veel van de zaken die we het meest willen zien in deze luchtbeelden—mensen, auto’s of dieren—verschijnen echter als slechts enkele pixels breed. Dit artikel introduceert een nieuw computerzichtsysteem, CEIFNet, dat specifiek is ontworpen om deze piepkleine objecten nauwkeuriger en sneller te vinden, zelfs wanneer ze zich bevinden te midden van drukke stadsstraten, velden of nachtelijk ruis.

Kleine dingen zien in een groot beeld

Standaard objectdetectiesystemen zijn vooral ontwikkeld voor foto’s op ooghoogte, waar een auto of persoon meestal een zichtbaar deel van het beeld vult. In dronebeelden hangt de camera daarentegen vaak honderden meters boven de grond, waardoor elk doelobject minuscuul wordt en gemakkelijk vervaagt of verloren gaat als het beeld wordt verkleind in een neuraal netwerk. De auteurs leggen uit dat populaire one-shot detectors zoals de YOLO-familie goed werken voor alledaagse scènes maar moeite hebben wanneer objecten zowel erg klein als sterk variërend in grootte zijn. Herhaaldelijk downsamplen, bedoeld om het hele tafereel te begrijpen, heeft de neiging de zwakke signalen van deze kleine doelen uit te wissen.

Close-up detail vermengen met het grote geheel

Om dit aan te pakken combineert CEIFNet twee aanvullende manieren van kijken. Het ene pad gebruikt klassieke convolutionele filters, die goed zijn in het vastleggen van scherpe lokale patronen zoals hoeken en texturen. Het andere pad gebruikt een Transformer-achtige aandachtmechaniek, die uitblinkt in het relateren van verre delen van het beeld en het begrijpen van de scène als geheel. Binnen het kernbouwblok, een cross-stage transformer block genoemd, worden binnenkomende beeldkenmerken gesplitst: de meeste kanalen gaan door een lichtgewicht convolutioneel pad, terwijl een kleiner deel door een aandachtspad gaat dat redeneringen over langeafstandsrelaties uitvoert. Deze worden vervolgens opnieuw gecombineerd, waardoor het netwerk zowel fijne details als globale context krijgt zonder de rekenkosten te laten ontploffen.

Randen gebruiken als kaart voor piepkleine doelen

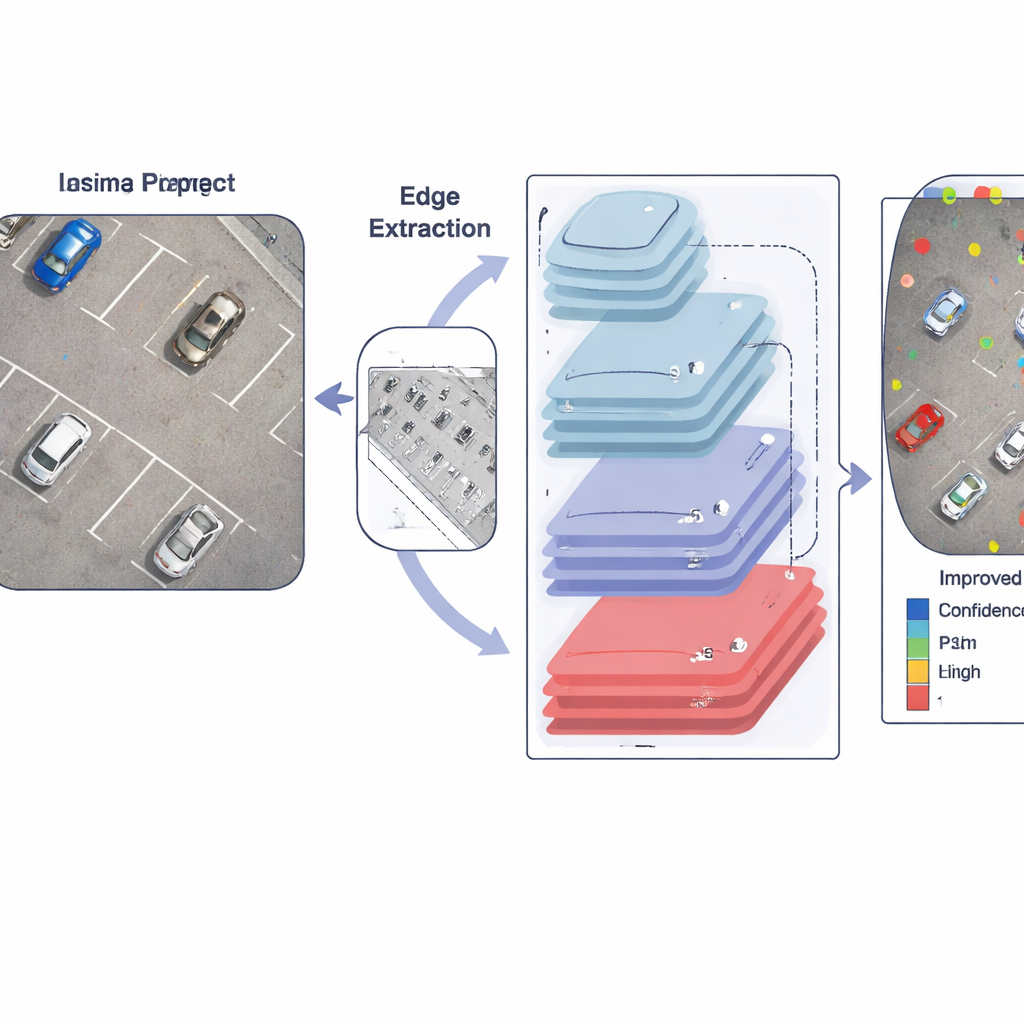

Een belangrijk inzicht van het artikel is dat objectgrenzen—randen—in het bijzonder waardevol zijn wanneer doelen slechts enkele pixels groot zijn. In plaats van uitsluitend te vertrouwen op geleerde filters injecteren de auteurs bewust randinformatie in het netwerk. Een speciaal module past eerst een Sobel-operator toe, een eenvoudige maar robuuste randdetector, om te benadrukken waar helderheid scherp verandert, bijvoorbeeld rond de omtrekken van auto’s of mensen. Deze randkaarten worden vervolgens in meerdere groottes gepoold om aan te sluiten bij verschillende functieschalen en via een cross-channel module gefuseerd. Terwijl het beeld dieper het netwerk instroomt, worden deze verscherpte randaanwijzingen herhaaldelijk gevoed naar latere lagen, wat het model helpt bij te houden waar kleine objecten beginnen en eindigen ondanks de gebruikelijke vervaging en verkleining.

Aanpassen aan grootte, positie en complexiteit van de scène

Aan de uitgang gebruikt CEIFNet een dynamische detectiekop die zijn gedrag kan aanpassen aan wat hij ziet. In plaats van vaste filters past deze laatste fase drie vormen van aandacht tegelijk toe: hij kan de voorkeur geven aan bepaalde objectgroottes, zich concentreren op de meest veelbelovende locaties in het beeld en de meest informatieve featurekanalen benadrukken. Samen met een feature-pyramid-structuur die een extra fijnmazige laag behoudt, maakt dit het systeem responsiever voor kleine, dicht opeengepakte doelen in realistische dronebeelden, van drukke kruispunten tot volgeparkeerde parkeerplaatsen en thermische infraroodbeelden ’s nachts.

De winst bewijzen in echte dronescenario’s

De onderzoekers testten CEIFNet op twee veeleisende dronedatasets: VisDrone2019, bestaande uit daglicht stedelijke en suburbane scènes, en HIT-UAV, een thermische-infraroodverzameling waar veel doelen zwak en klein zijn. Op beide detecteerde het nieuwe systeem objecten nauwkeuriger dan een sterke YOLO-gebaseerde baseline en een reeks andere moderne detectors, terwijl het nog steeds snel genoeg draaide voor realtime gebruik op een krachtige grafische kaart. Zorgvuldig uitgevoerde ablatietests toonden aan dat elk onderdeel—het hybride blok, de randmodule, de extra fijne laag en de dynamische kop—bijdroeg aan de algehele verbetering.

Wat dit betekent voor alledaagse technologie

Voor niet-specialisten is de conclusie dat CEIFNet een slimmer manier biedt voor drones om "de kleine dingen op te merken" in grote, complexe scènes. Door randinformatie te behouden, lokale details te mengen met globale context en zijn aandacht dynamisch aan te passen, kan het netwerk kleine objecten herkennen die andere systemen missen of verkeerd plaatsen. Dit maakt bewaking vanuit de lucht betrouwbaarder voor taken zoals verkeersveiligheid, zoek- en reddingsacties en precisielandbouw, en wijst de weg naar toekomstige systemen die betrouwbare informatie kunnen halen uit steeds hogere en bredere vergezichten van onze wereld.

Bronvermelding: Xiao, J., Li, C., Chen, H. et al. Cross-stage edge information fusion network for small object detection in aerial images. Sci Rep 16, 7639 (2026). https://doi.org/10.1038/s41598-026-36251-5

Trefwoorden: detectie van objecten vanuit de lucht, kleine objecten, dronebeeldvorming, rand-gebaseerde visie, deep learning