Clear Sky Science · nl

Diepe atrous-context convolutie generatieve adversariële netwerk met hoek-sleutelpuntafgeleide kenmerken voor notenclassificatie

Slimmer sorteren van alledaagse noten

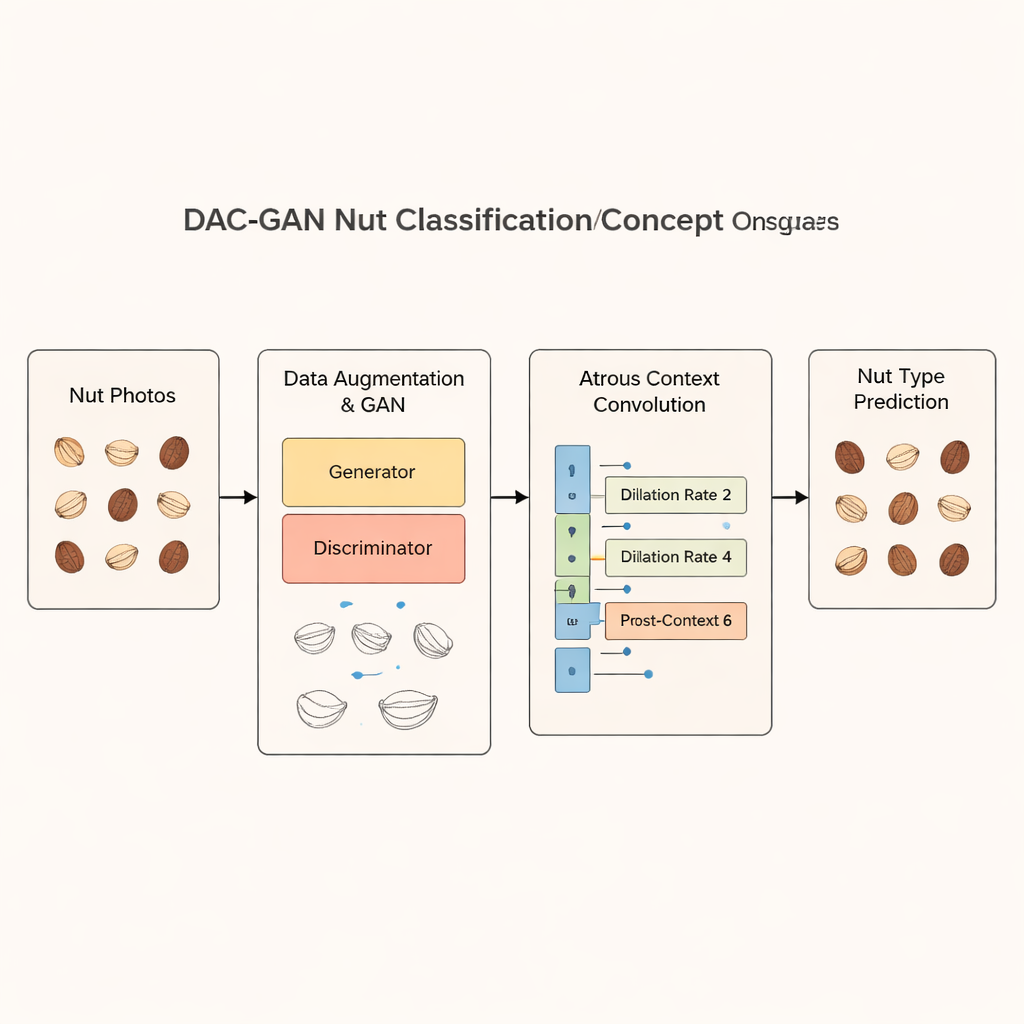

Van snackmixen tot notenboters: miljarden noten passeren elk jaar fabrieken en moeten allemaal worden gesorteerd op soort en kwaliteit. Vandaag de dag gebeurt dat vaak met machines die nog steeds moeite hebben wanneer noten op elkaar lijken of foto’s onder verschillende belichting zijn genomen. Deze studie introduceert een krachtig kunstmatig-intelligentiesysteem genaamd DAC‑GAN dat acht veelvoorkomende notensoorten bijna foutloos van elkaar kan onderscheiden, wat snellere, goedkopere en betrouwbaardere sortering voor de voedingsindustrie belooft.

Waarom noten herkennen moeilijk is

Op het eerste gezicht lijken een cashew en een pindas eenvoudig te onderscheiden. Maar in echte productielijnen kunnen noten gekanteld, gebroken, overlappend of slecht verlicht zijn. Traditionele computerprogramma’s vertrouwen op simpele handmatige kenmerken, zoals kleur of gemiddelde vorm, die snel falen wanneer de omstandigheden veranderen. Deep learning heeft vooruitgang gebracht door computers patronen rechtstreeks uit beelden te laten leren, maar deze methoden vragen meestal erg grote, zorgvuldig gebalanceerde datasets. Voor noten zijn vaak maar enkele duizenden gelabelde foto’s beschikbaar, en sommige soorten kunnen verwarrend op elkaar lijken, wat leidt tot fouten en bevooroordeelde voorspellingen.

Meer en betere trainingsbeelden maken

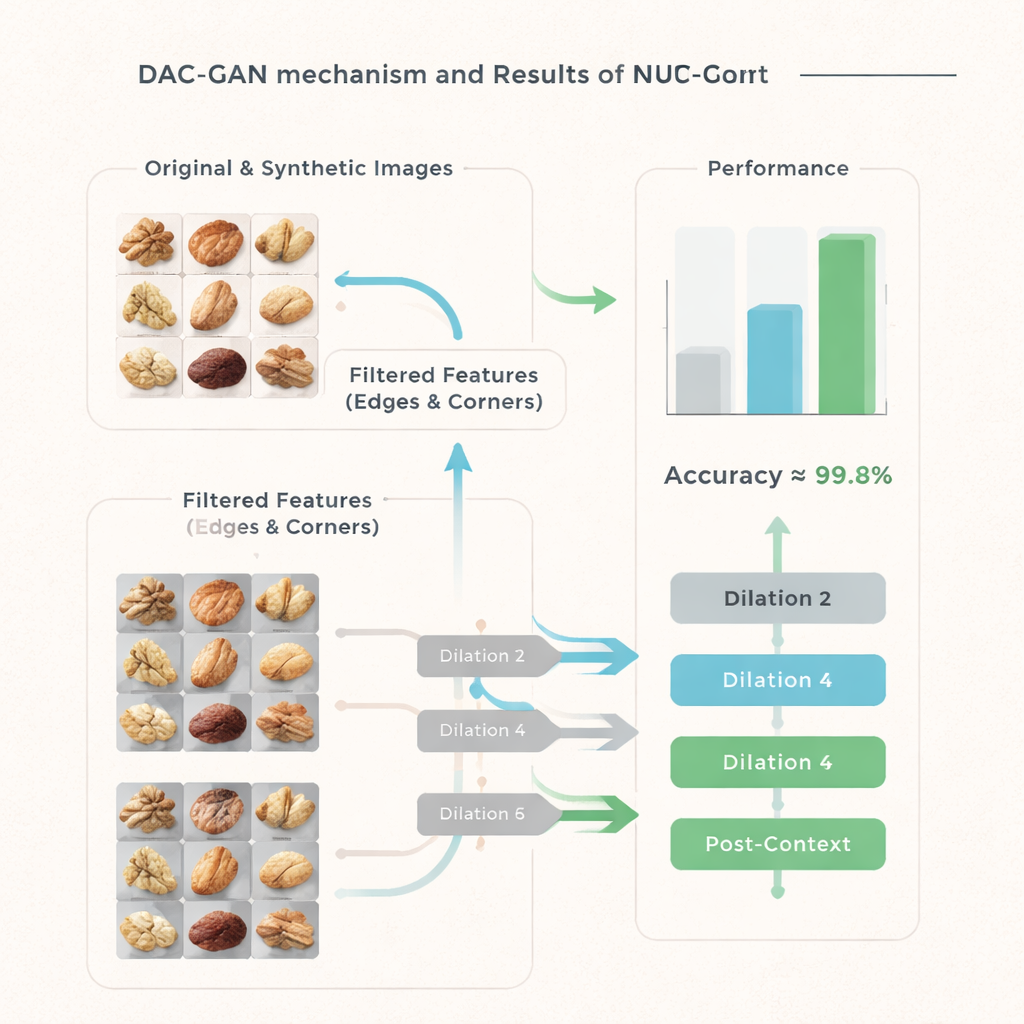

De onderzoekers beginnen met een openbare “Common Nut”-afbeeldingsverzameling, met 4.000 foto’s gelijk verdeeld over acht notensoorten: paranoot, cashew, kastanje, pinda, pecan, pistache, macadamia en walnoot. Om een robuust model te trainen hebben ze veel meer voorbeelden nodig dan dit. DAC‑GAN pakt het probleem aan met een speciaal soort neurale netwerk, een generatief adversariëel netwerk (GAN). Een deel van de GAN, de generator, leert realistische notenafbeeldingen te maken uit willekeurige ruis, terwijl een ander deel, de discriminator, leert echt van nep te onderscheiden. Terwijl die twee tegen elkaar spelen, wordt de generator goed genoeg om hoogwaardige, levensechte synthetische noten te produceren. Door deze kunstmatige afbeeldingen te combineren met standaard flips en rotaties vergroot het team de dataset tot meer dan 70.000 beelden, terwijl elke notenklasse perfect in balans blijft.

Het model leren te focussen op notendetails

Meer beelden toevoegen is niet voldoende; het model moet ook op de juiste visuele aanwijzingen letten. DAC‑GAN introduceert een filtratiestap die notenfoto’s naar grijswaarden converteert en vervolgens sterke omtrekken, randen en onderscheidende hoekpunten extraheert. Deze “hoek-sleutelpuntafgeleide kenmerken” vangen waar de vorm van een noot buigt of waar de oppervlaktestructuur verandert—details die vaak een soort van een andere onderscheiden. Extra filters benadrukken algemene kernomtrekken en interne patronen. In plaats van ruwe foto’s in de classifier te stoppen, werkt het systeem op deze verscherpte kenmerkbeelden, die geometrie en textuur benadrukken en storende achtergrond- en kleurvariaties naar de achtergrond schuiven.

De hele noot in meerdere schalen bekijken

De kern van DAC‑GAN is een verfijnde versie van een techniek die atrous-, of gedilateerde, convolutie wordt genoemd. Gewone convolutionele lagen in diepe netwerken zien slechts kleine stukjes tegelijk. Atrous-convolutie spreidt de bemonsteringspunten uit zodat het model een breder beeld kan opnemen zonder resolutie te verliezen. De auteurs voegen “pre‑context” en “post‑context” blokken rond deze kernoperatie toe, die het hele beeld samenvatten en die samenvatting terugvoeren naar de laag. Door drie van zulke convoluties met verschillende dilatatiegraden uit te voeren leert het netwerk zowel kleine groeven op het oppervlak van een noot als de algemene silhouet vast te leggen, en combineert het deze gezichtspunten tot een rijke, contextbewuste representatie voordat het een beslissing neemt.

Hoe goed werkt het?

Het team zet DAC‑GAN door een uitgebreide reeks tests. Ze vergelijken het met veel bekende neurale netwerken, van klassieke modellen zoals VGG en ResNet tot nieuwere transformer-gebaseerde ontwerpen, zowel met als zonder synthetische data. Over nauwkeurigheid, precisie, recall en een gecombineerde F1-score presteert DAC‑GAN consequent beter dan alle alternatieven met een ruime marge. Op de apart gehouden testset van echte notenfoto’s identificeert het in 99,83% van de gevallen correct het notentype, met slechts 25 fouten op 800 monsters. Zelfs de meest competitieve concurrerende modellen blijven enkele procentpunten achter, en gedetailleerde statistieken tonen aan dat het voordeel van DAC‑GAN niet door toeval komt maar statistisch zeer robuust is.

Wat dit betekent voor voedsel en daarbuiten

Voor niet‑specialisten is de conclusie simpel: door slim extra trainingsbeelden te genereren en het netwerk te leren letten op randen, hoeken en multi-schaalcontext verandert DAC‑GAN een visueel subtiel probleem in een dat het bijna perfect kan oplossen. In praktische termen kan deze aanpak leiden tot geautomatiseerde notensorteermachines die grote volumes met zeer weinig fouten verwerken, de kwaliteitscontrole verbeteren en handarbeid verminderen. Omdat de methode algemeen toepasbaar is, kan ze ook worden aangepast aan andere voedingsproducten—or zelfs industriële onderdelen—die op basis van fijne visuele details onder imperfecte beeldomstandigheden moeten worden onderscheiden.

Bronvermelding: Devi, M.S., Jaiganesh, M., Priya, S. et al. Deep atrous context convolution generative adversarial network with corner key point extracted feature for nuts classification. Sci Rep 16, 6409 (2026). https://doi.org/10.1038/s41598-026-36238-2

Trefwoorden: notenclassificatie, deep learning, beeldaugmentatie, voedsel sorteren, computer vision