Clear Sky Science · nl

Veiligheid en doeltreffendheid van privacy‑beschermende modellen voor het maken van begrijpelijke samenvattingen van hersen‑MRI‑rapporten

Waarom uw scanrapport zo verwarrend kan overkomen

Steeds meer patiënten kunnen hun eigen testresultaten online bekijken, inclusief gedetailleerde radiologierapporten van hersenscans. Maar deze documenten zijn geschreven voor artsen, niet voor patiënten, en zitten vol onbekende termen die eerder zorgen dan geruststelling kunnen veroorzaken. Deze studie onderzoekt of moderne kunstmatige intelligentie (AI)-programma’s veilige, begrijpelijke samenvattingen in gewone taal kunnen maken van echte spoed‑hersen‑MRI‑rapporten — geschreven in het Frans voor mensen met hoofdpijn — zonder gevoelige medische gegevens naar externe commerciële servers te sturen.

Van doktersjargon naar alledaagse taal

De onderzoekers richtten zich op zogenaamde ‘lay summaries’: korte toelichtingen die de medische feiten behouden maar ze in gewone taal vertalen en de bevindingen direct koppelen aan de klachten van de patiënt. Ze gebruikten drie grote taalmodellen (LLM’s) — Llama 3.3, Athene V2 en Mistral Small — die volledig op computers binnen een Frans universitair ziekenhuis draaiden, zodat geen enkel rapport het beveiligde ziekenhuisnetwerk verliet. Elk AI‑systeem kreeg dezelfde opdracht: schrijf een samenvatting van 4–6 zinnen in het Frans voor een patiënt, behandel alle belangrijke punten, leg moeilijke termen uit en verbind de scanbevindingen met de hoofdpijn van de persoon.

Hoe artsen nauwkeurigheid en veiligheid beoordeelden

Uit bijna 600 hersen‑MRI‑rapporten die in 2022 voor spoedpatiënten met hoofdpijn waren geschreven, selecteerde het team willekeurig 105. Drie ervaren neuroradiologen lazen elk origineel rapport naast drie anonieme door AI gemaakte samenvattingen (één van elk model). Zij beoordeelden deze op medische juistheid, volledigheid, bruikbaarheid om patiënten te informeren en of de tekst goed genoeg was om rechtstreeks in het online patiëntportaal te tonen. Gemiddeld waren de beoordelingen hoog: artsen vonden de samenvattingen grotendeels accuraat en volledig en vaak geschikt voor klinisch gebruik. Toch bevatte ongeveer één op de vijf samenvattingen minstens één probleem, zoals een onjuiste verklaring van een afkorting, een enigszins foutieve anatomische beschrijving, houterige formuleringen of een verzonnen detail dat niet in het oorspronkelijke rapport stond.

Wat niet‑artsen daadwerkelijk begrepen

Om te onderzoeken of deze samenvattingen echt hielpen voor leken, rekruteerden de onderzoekers 11 niet‑artsen die werkzaam zijn in medische informatica en regelmatig met gezondheidsgegevens werken maar niet als arts zijn opgeleid. Deze groep beoordeelde 30 MRI‑rapporten, sommige in originele vorm en sommige met een toegevoegde AI‑samenvatting. Ze gaven scores voor hoe goed ze vonden dat ze elk rapport begrepen, hoe zeker ze waren dat ze de resultaten aan vrienden of familie konden uitleggen en hoe angstig ze zouden zijn als het rapport van henzelf was. Ze beantwoordden ook eenvoudige ja‑of‑nee vragen: is er iets afwijkends in dit rapport, en is er een bevinding die redelijkerwijs de hoofdpijn van de patiënt zou kunnen verklaren?

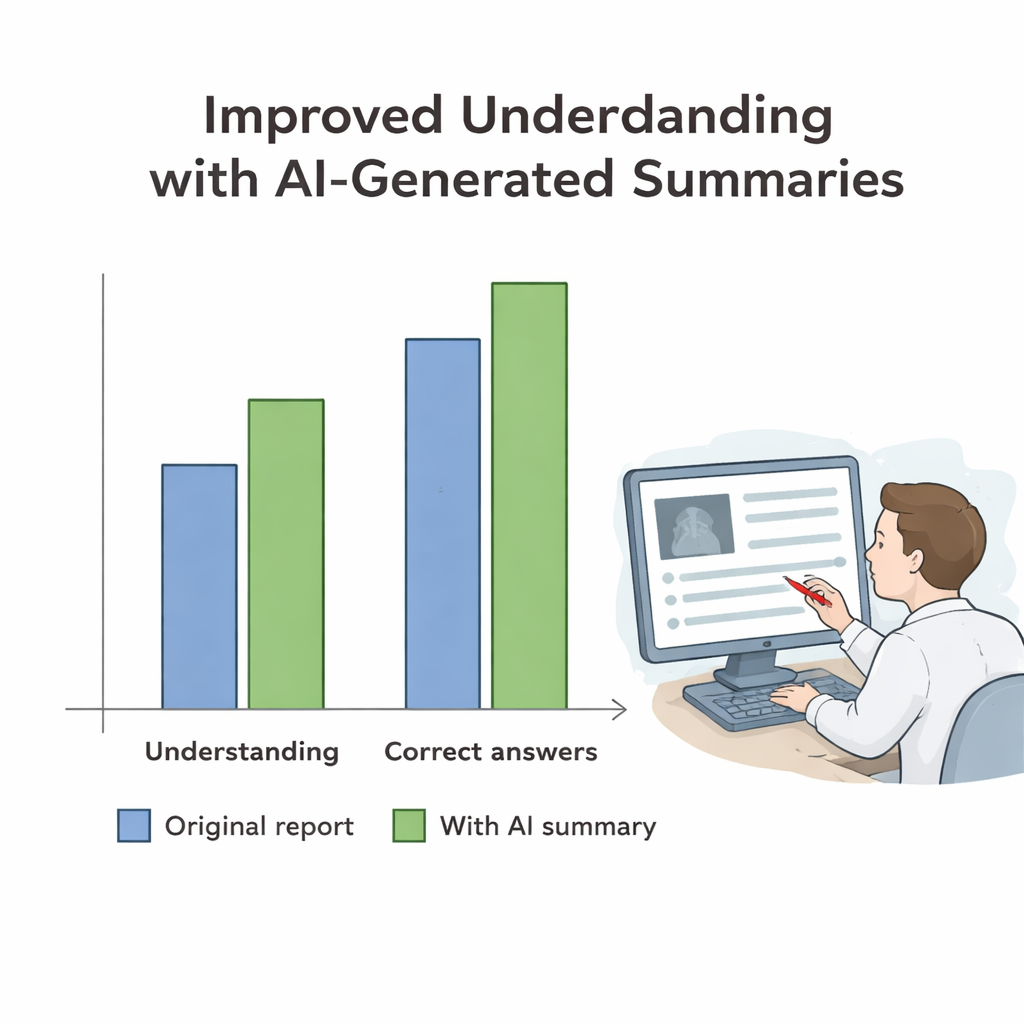

Heldere rapporten, bescheiden maar reële begripstoename

Het toevoegen van door AI gegenereerde samenvattingen verhoogde sterk hoe goed deelnemers vonden dat ze de rapporten begrepen, waarbij de gemiddelde zelfgerapporteerde begripsniveaus van ‘matig’ naar ‘hoog’ stegen. Hun vertrouwen om de resultaten met anderen te bespreken nam ook toe, terwijl de gerapporteerde angst licht afnam. Wat betreft objectief begrip was het effect bescheidener maar nog steeds betekenisvol. Deelnemers werden beter in het herkennen wanneer een scan afwijkend was en in het identificeren van bevindingen die de hoofdpijn daadwerkelijk zouden kunnen verklaren, met verbeteringen geconcentreerd in rapporten die echte afwijkingen bevatten. Bij normale scans zaten mensen al vrijwel perfect in het herkennen dat er niets ernstigs was gevonden, zodat de samenvattingen daar weinig extra voordeel boden.

Waarom menselijke controle nog steeds belangrijk is

Hoewel deze privacy‑beschermende AI‑hulpmiddelen de ervaren duidelijkheid aanzienlijk verbeterden en kleine maar belangrijke winst in feitelijk begrip opleverden, waren ze niet foutloos. Ongeveer 20% van de samenvattingen bevatte medische of taalfouten, vaak gerelateerd aan lastige medische afkortingen of aan Engelse en Chinese woorden die in Franse zinnen leken te glijden. Omdat zelfs kleine fouten patiënten kunnen misleiden, pleiten de auteurs ervoor AI te gebruiken in een ‘human‑in‑the‑loop’ opzet: het model stelt een patiëntvriendelijke samenvatting op en een radioloog controleert en corrigeert deze snel voordat deze de patiënt bereikt. Gebruikt op deze manier suggereert de studie dat on‑site AI ziekenhuizen kan helpen duidelijkere, meer geruststellende uitleg van hersen‑MRI‑resultaten te bieden, terwijl gevoelige gezondheidsgegevens veilig binnen de instelling blijven.

Bronvermelding: Le Guellec, B., Bentegeac, R., Shorten, L. et al. Safety and efficacy of privacy-preserving models to create Lay summaries of brain MRI reports. Sci Rep 16, 6316 (2026). https://doi.org/10.1038/s41598-026-36081-5

Trefwoorden: radiologierapporten, patiëntcommunicatie, hersen‑MRI, grote taalmodellen, medische privacy