Clear Sky Science · nl

Autonome navigatie in ongestructureerde buitenomgevingen met behulp van semantische segmentatie-gestuurde reinforcement learning

Robots die leren het bos te bewandelen

Stel je een kleine robot voor die zelfstandig een bospad kan bewandelen, slingerend tussen bomen en rotsen zonder gps of een mens met een joystick. Dit artikel beschrijft een systeem dat zulke robots leert paden in dicht bos te "zien" en van moment tot moment te beslissen hoe ze veilig vooruit moeten bewegen. Het werk is relevant voor toekomstige robots die kunnen helpen bij bosmonitoring, brandpreventie, zoek‑en‑reddingsoperaties en zelfs buitenbezorging op plekken waar satellietsignalen zwak of afwezig zijn.

Waarom bossen zo moeilijk zijn voor robots

Bossen behoren tot de lastigste omgevingen voor autonome machines. Paden kunnen smal en kronkelig zijn, de ondergrond is ongelijk, takken en struikgewas blokkeren vaak het zicht, en hoge bomen maken gps‑signalen onbetrouwbaar. Traditionele navigatiemethoden vertrouwen op nauwkeurige kaarten, sterke gps of dure lasersensoren en gaan vaak uit van heldere, gestructureerde ruimtes zoals stadsstraten of fabrieksvloeren. In het bos vallen die veronderstellingen weg: schaduwen, wisselende seizoenen en dichte begroeiing verwarren eenvoudige visiesystemen, terwijl regelgebaseerde besturing moeite heeft met alle rommelige, onverwachte situaties die op een echt pad ontstaan.

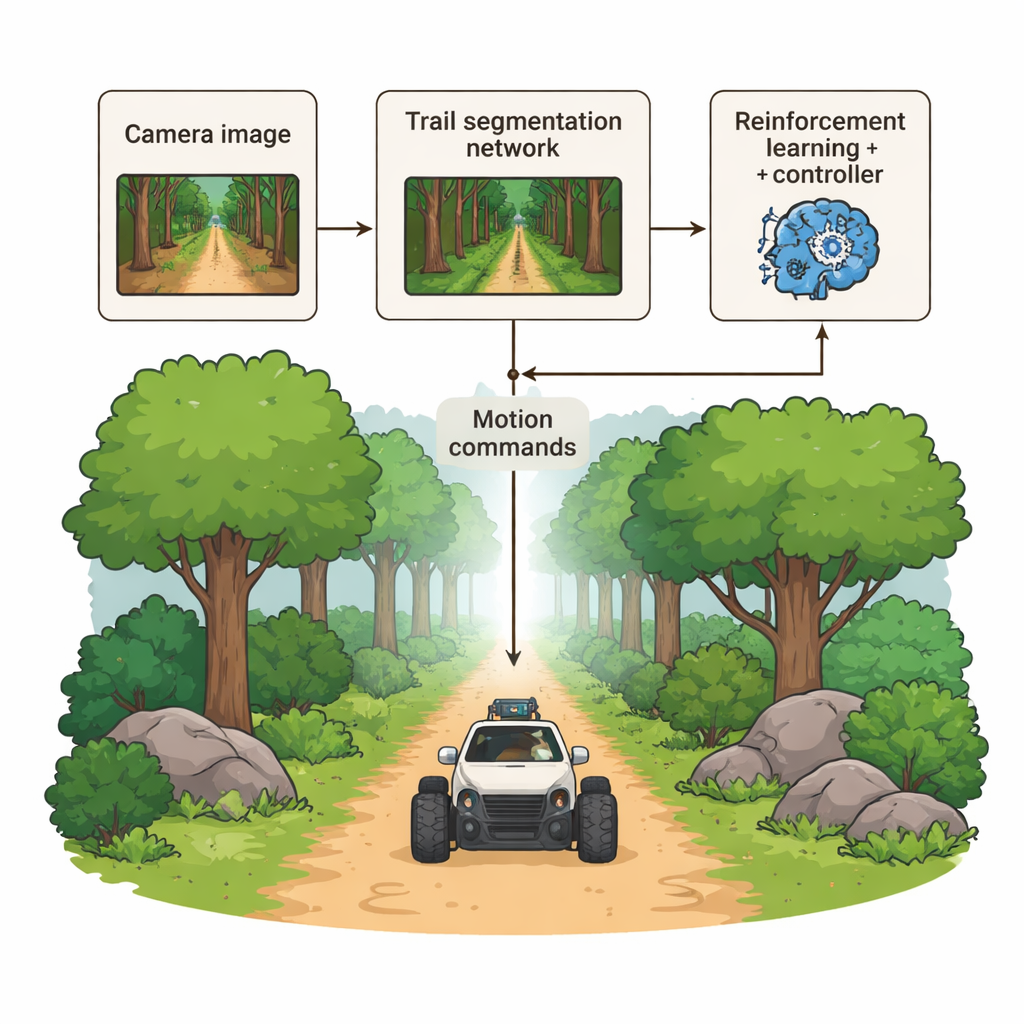

Drie hersenen die samenwerken

De auteurs stellen een hybride navigatiesysteem voor dat robots drie aanvullende "hersenen" geeft. Ten eerste bekijkt een diepziend visiemodule elke cameraafbeelding en markeert, bijna pixel voor pixel, welke delen tot het begaanbare pad behoren. Ten tweede gebruikt een op leren gebaseerde beslismodule reinforcement learning om vloeiende stuur‑ en snelheidscommando’s te kiezen, en beloont gedrag dat op het pad blijft, botsingen vermijdt en efficiënt het doel bereikt. Ten derde zet een klassiek regelmechanisme de voorspelde padvorm om in stabiele wielbewegingen, waarbij abrupte bewegingen worden uitgevlakt zodat het robotpad sierlijk in plaats van schokkerig blijft. In plaats van één ondoorzichtig end‑to‑end netwerk zijn deze modules afzonderlijk maar nauw verbonden, waardoor ingenieurs elk stadium kunnen begrijpen en debuggen.

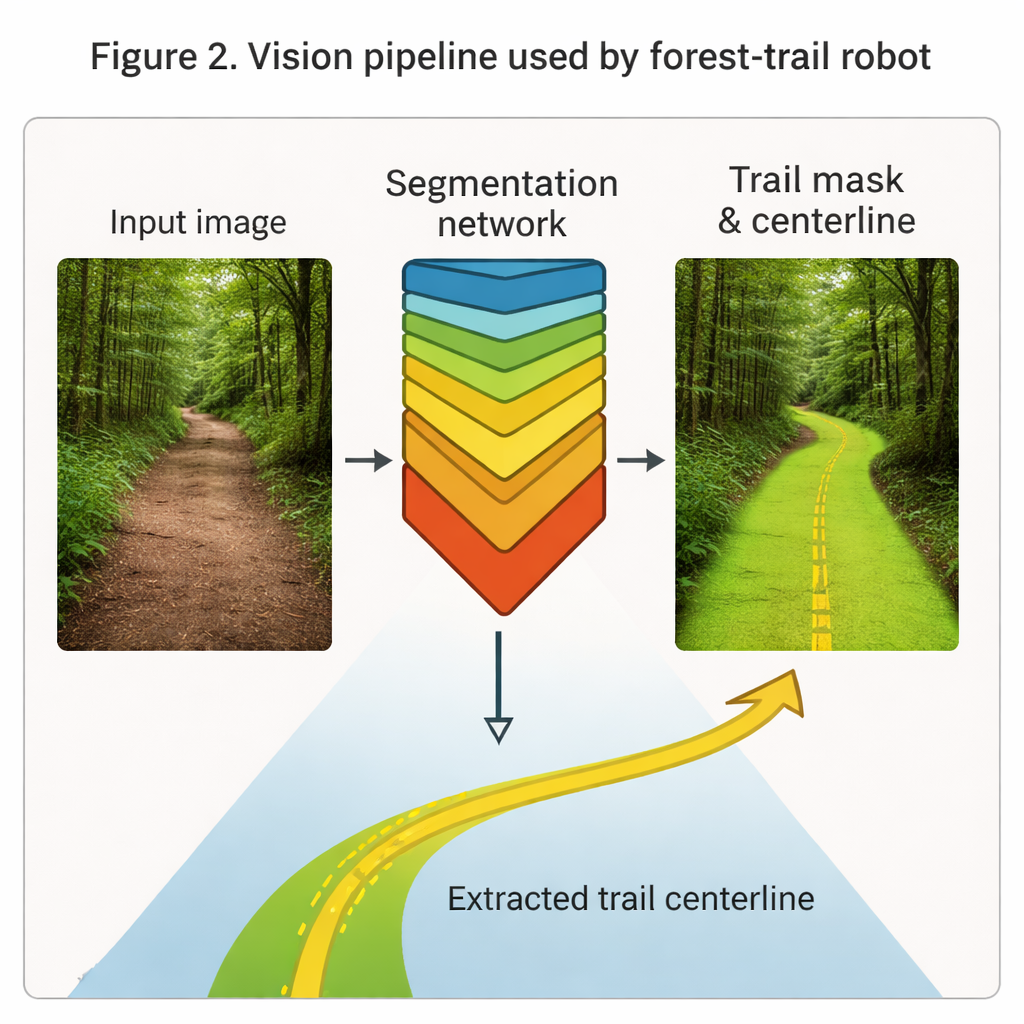

Het zicht trainen om paden te herkennen

In het hart van de "ogen" van de robot staat een diep netwerk bekend als Mask R‑CNN, hier afgestemd om bospaden in gewone kleurbeelden te benadrukken. Getraind op bijna 24.000 gelabelde frames van echte wandelbeelden opgenomen op menselijke hoogte onder verschillende licht-, weer‑ en padtypen, leert het systeem het padgebied in elk frame als een schoon masker te tonen. Uit dit masker extraheert het een dunne middenlijn die de richting en kromming van het pad voor zich vastlegt. In tests behaalt de visiemodule een hoge overlap met door mensen getekende labels en meer dan 90% pixelnauwkeurigheid, en tekent paden robuust af zelfs wanneer takken of schaduwen het pad gedeeltelijk verbergen. Deze geometrische aanwijzingen voeden zowel de leermodule als de stuurmodule als een compacte beschrijving van "waar het pad is."

Een robot trainen om goede keuzes te maken

Het tweede belangrijke onderdeel is de beslismodule, die een techniek gebruikt die reinforcement learning heet. In plaats van precies verteld te krijgen wat te doen, probeert de robot acties in een realistische gesimuleerde bosomgeving en krijgt beloningen voor goede uitkomsten en straffen voor slechte. Vooruit bewegen langs het pad is goed; afdwalen, botsen met obstakels of vastlopen is slecht. Over ongeveer 150.000 trainingsstappen ontdekt het systeem geleidelijk strategieën die het gecentreerd op het pad houden, bochten elegant verwerken en verstandig reageren wanneer takken of rotsen in het pad verschijnen. Om bewegingen soepel en veilig te houden, kunnen de geleerde acties worden gemengd met die van de klassieke controller, wat vooral helpt in scherpe bochten of bij ruisrijke omstandigheden.

Het systeem op de proef stellen

Om te beoordelen hoe goed deze combinatie werkt, bouwden de onderzoekers drie gedetailleerde virtuele bossen: één met smalle, rommelige paden, een andere met steile, oneffen grond en grote obstakels, en een derde vol splitsingen, doodlopende wegen en afleidende valse paden. In 90 proeven op deze kaarten bereikte de robot zijn doel zonder botsing in ongeveer 87% van de episodes, met gemiddeld slechts 0,2 aanrijdingen per run en bleef doorgaans binnen ongeveer 30 centimeter van het midden van het pad. Hij voltooide routes ook snel en consistent. Wanneer de auteurs één module tegelijk verwijderden of vereenvoudigden, daalde de prestatie scherp—wat aantoont dat alle drie componenten nodig zijn. Vergeleken met andere recente systemen, inclusief die met laserscanners, bood deze alleen‑visie hybride aanpak de beste algehele combinatie van succespercentage, precisie en veiligheid.

Wat dit betekent voor robots in de echte wereld

Voor de niet‑specialist is de conclusie dat robots beter worden in het wandelen als voorzichtige, capabele padgebruikers. Door een sterk gevoel voor visuele context ("dit is het pad"), praktijkgebaseerde besluitvorming ("deze bewegingen werkten goed eerder") en een stabiek stuurmechanisme te combineren, stelt het voorgestelde systeem een kleine wielrobot in staat complexe bossen te navigeren zonder kaarten of gps. Hoewel het werk in simulatie is getest en nog uitdagingen kent zoals extreem licht en zeldzame padtypen, biedt het een praktisch stappenplan voor toekomstige veldrobots die veilig wilde omgevingen met mensen kunnen delen, ons helpen bossen te inspecteren, reddingsteams ondersteunen en natuurlijke hulpbronnen effectiever beheren.

Bronvermelding: Tibermacine, A., Tibermacine, I.E., Akrour, D. et al. Autonomous navigation in unstructured outdoor environments using semantic segmentation guided reinforcement learning. Sci Rep 16, 2633 (2026). https://doi.org/10.1038/s41598-026-36022-2

Trefwoorden: autonome navigatie, bosrobotica, computervisie, reinforcement learning, semantische segmentatie