Clear Sky Science · nl

Gebruik van kunstmatige intelligentie om chirurgische anatomie te identificeren tijdens laparoscopische nierdonatie – een validatie- en haalbaarheidsstudie

Slimmere technologie voor een ingrijpend cadeau

Laparoscopische donor-nefrectomie is de minimaal invasieve ingreep die wordt gebruikt wanneer een gezonde persoon een nier doneert — een onbaatzuchtige daad waarbij elke chirurgische fout extra moeilijk te aanvaarden is. Deze studie onderzoekt hoe kunstmatige intelligentie (AI) chirurgen kan helpen vitale structuren tijdens deze delicate ingreep duidelijker te zien, met als doel het risico voor donoren te verkleinen en de opleiding van toekomstige chirurgen te verbeteren.

Waarom nierdonatie extra zorg vereist

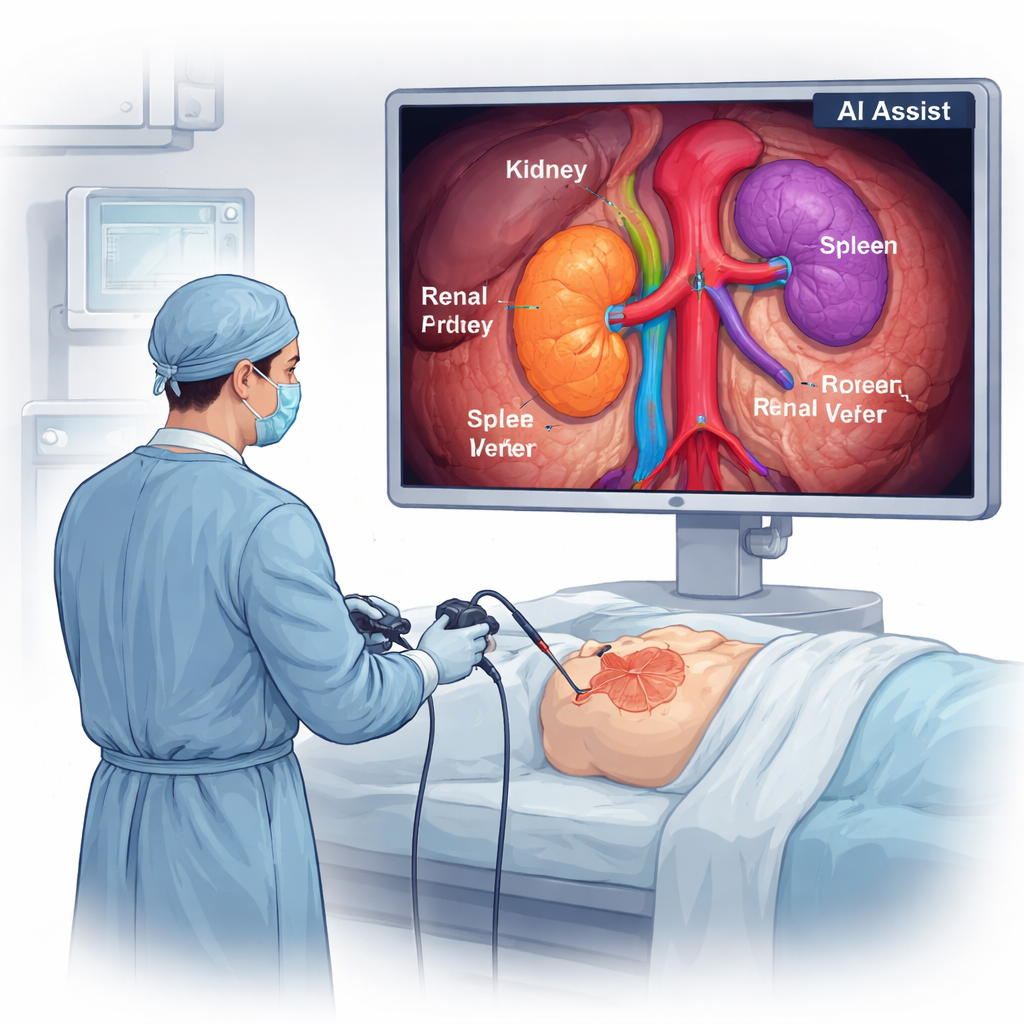

Levende nierdonoren zijn vaak volkomen gezonde mensen die alleen opereren om iemand anders te helpen. Hoewel laparoscopische technieken de donatie al veiliger hebben gemaakt en het herstel hebben versneld, houdt de operatie nog steeds in dat er wordt gewerkt in een krappe ruimte rond arteriën, venen en de ureter die niet beschadigd mogen worden. Chirurgen vertrouwen momenteel op hun eigen ogen en ervaring om deze structuren op een videoscherm te herkennen. Een AI-„co-piloot” die in realtime betrouwbaar belangrijke anatomie kan aanwijzen, zou kunnen helpen ongelukken te voorkomen, vooral bij minder ervaren chirurgen of in moeilijke gevallen.

Een computer leren in het lichaam te kijken

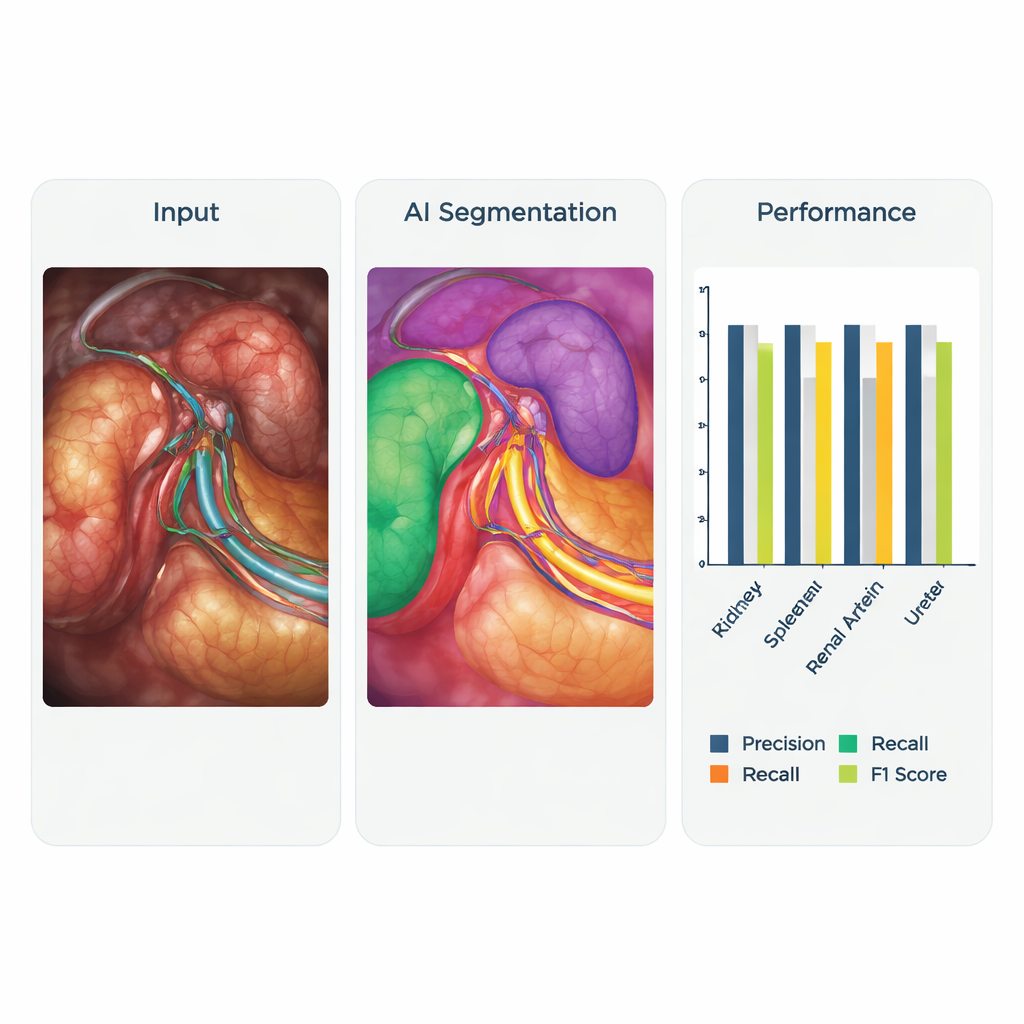

Het onderzoeksteam werkte samen met een medische technologieleverancier om een computer‑visiesysteem te bouwen dat belangrijke structuren kan herkennen tijdens een linker nierdonatie. Ze verzamelden videoregistraties van 30 operaties en concentreerden zich op momenten waarop het omringende vet was verwijderd, waardoor de nier, milt, hoofdvaten en ureter zichtbaar waren. Hieruit haalden ze duizenden stilstaande beelden. Elk beeld werd zorgvuldig pixel voor pixel gelabeld door een anatoom en vervolgens dubbelgecontroleerd door een ervaren transplantatiechirurg. Deze geannoteerde beelden dienden als 'antwoorden' voor het trainen van de AI. Het systeem is gebouwd op een modern deep‑learningmodel dat oorspronkelijk ontworpen is om objecten snel in beelden te detecteren en vervolgens aangepast om individuele organen en vaten in elk chirurgisch frame te omlijnen.

Hoe het systeem werd getraind en getest

De onderzoekers gebruikten 6.828 gelabelde afbeeldingen uit 16 operaties om de AI te leren en hielden nog eens 1.757 afbeeldingen uit vier verschillende operaties apart om te testen hoe goed het had geleerd. Ze gaven bewust extra gewicht aan de meest kritieke structuren — de nierarterie, nierader en ureter — zodat het model daar speciale aandacht aan zou besteden. Tijdens het trainen vergeleek het programma herhaaldelijk zijn schattingen met de expertlabels en paste zichzelf aan om fouten te verminderen. De centrale vraag was of de AI, wanneer een nieuw beeld werd getoond, de milt, nier, grote vaten en ureter correct kon markeren zonder ze te missen of de ene structuur met de andere te verwarren.

Hoe goed de AI‑co‑piloot presteerde

Bij tests liet het AI‑systeem bemoedigende nauwkeurigheid zien. Het blonk vooral uit in het herkennen van de milt en de hoofdvaten die de nier van bloed voorzien. Voor de linker nier, nierarterie en nierader bereikte het systeem een goede balans tussen het niet ten onrechte labelen van achtergrondweefsel en het niet over het hoofd zien van de te vinden structuren. Deze resultaten voldoen aan algemeen geaccepteerde drempels voor detectie in realtime tijdens chirurgie. De ureter — een dunne buis die urine van de nier afvoert — bleek moeilijker te detecteren, waarschijnlijk omdat hij smal, beweeglijk en qua kleur gelijk aan nabijgelegen weefsels is, en tevens minder vertegenwoordigd in de trainingsbeelden. Naast statische tests probeerde het team het systeem ook live in de operatiekamer en op video’s van een ander ziekenhuis in een ander land. De AI herkende nog steeds sleutelanatomie en signaleerde zelfs een ongewoon patroon van dubbele arteriën, wat suggereert dat het mogelijk generaliseert buiten het oorspronkelijke trainingscentrum.

Wat dit kan betekenen voor chirurgen en patiënten

Hoewel het systeem nog niet klaar is om te dienen als volledige realtime navigatietool, markeert dit werk een belangrijke eerste stap. Het betrouwbaar kunnen omlijnen van cruciale anatomie opent de deur naar meerdere toepassingen: on‑screen begeleiding tijdens lastige onderdelen van een operatie, automatische labeling van onderwijsbeelden voor trainees en meer objectieve manieren om chirurgische prestaties te beoordelen. Toekomstige verbeteringen vereisen meer diverse gegevens uit meerdere ziekenhuizen, betere aanpak van moeilijke structuren zoals de ureter en formele meting van hoe snel en consistent de AI frame voor frame werkt. Toch is de centrale boodschap duidelijk voor niet‑specialisten: AI kan nu al veel zien van wat een getrainde chirurg ziet, en met verdere verfijning zouden systemen als deze de veiligheid van nierdonatie nog verder kunnen vergroten.

Bronvermelding: Ong, C.S.H., Wong, H.P.N., Leung, M. et al. Utilising artificial intelligence to identify surgical anatomy during laparoscopic donor nephrectomy – a validation and feasibility study. Sci Rep 16, 7416 (2026). https://doi.org/10.1038/s41598-026-35999-0

Trefwoorden: nierdonatie, laparoscopische chirurgie, chirurgische kunstmatige intelligentie, computer vision in de geneeskunde, veiligheid bij orgaantransplantatie