Clear Sky Science · nl

Het begrijpen van het mentale gezondheidsdiscours op Reddit met transformers en verklaarbaarheid

Waarom online praten over gevoelens ertoe doet

Veel mensen die worstelen met angst, depressie, bipolaire stoornis of borderline persoonlijkheidsstoornis wenden zich tot internet voordat ze met een professional praten. Reddit, met zijn anonieme gemeenschappen, is uitgegroeid tot een belangrijk trefpunt om angsten te delen, om hulp te vragen en anderen te ondersteunen. Deze studie onderzoekt hoe duizenden van deze gesprekken eruitzien en hoe kunstmatige intelligentie ze kan ordenen en de woorden kan benadrukken die mensen het vaakst gebruiken wanneer ze over verschillende mentale gezondheidsproblemen spreken.

Een kijkje in steungemeenschappen

De onderzoekers richtten zich op vier grote Reddit-gemeenschappen gewijd aan angst, depressie, bipolaire stoornis en borderline persoonlijkheidsstoornis (vaak afgekort tot BPS). Elk bericht in hun dataset was eenvoudigweg gelabeld naar de gemeenschap waarvan het afkomstig was, niet naar een medische diagnose. Het team beschouwde deze gemeenschappen als “zorgruimtes”, waar mensen met vergelijkbare problemen samenkomen om hun hart te luchten, advies te zoeken en troost te bieden. Door te bestuderen hoe taal verschilt tussen deze ruimtes, hoopten ze te begrijpen hoe mensen hun ervaringen in hun eigen woorden beschrijven, buiten de kliniek om.

Computers leren gesprekken te sorteren

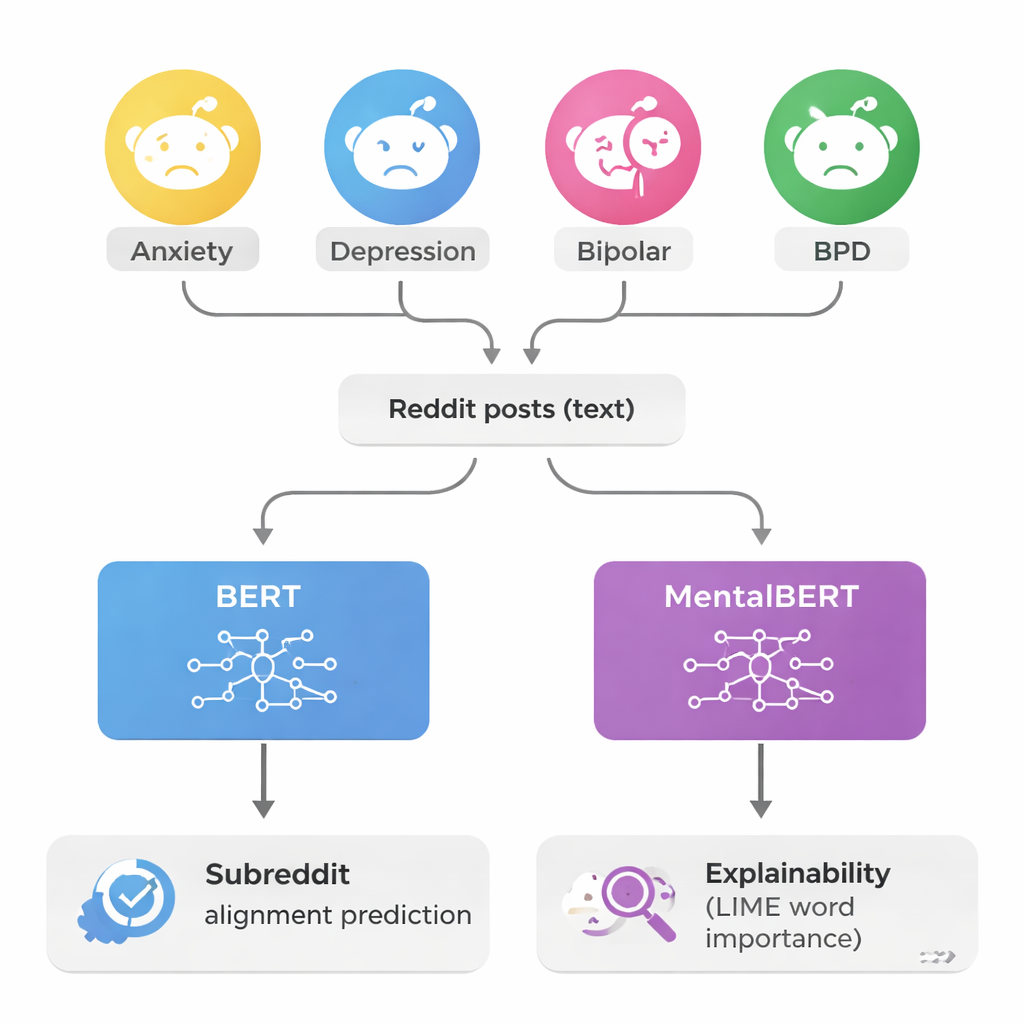

Om meer dan 150.000 berichten te analyseren, gebruikten de auteurs krachtige taalmodellen die transformers worden genoemd, specifiek BERT en een voor geestelijke gezondheid aangepaste versie genaamd MentalBERT. Deze modellen lazen elk bericht en probeerden te raden bij welke van de vier gemeenschappen het hoorde. Omdat sommige gemeenschappen veel meer berichten hadden dan andere, balanceerde het team de dataset zorgvuldig zodat elke groep even sterk vertegenwoordigd was. Dat maakte de taak moeilijker maar eerlijker, waardoor de modellen echt verschillen in woordkeuze moesten leren in plaats van simpelweg de meest voorkomende gemeenschappen te bevoordelen. Bij tests labelden de modellen berichten correct in ongeveer 82 procent van de gevallen—een grote sprong boven willekeurig raden, dat maar één kwart van de tijd goed zou zijn.

De zwarte doos van AI openen

Een belangrijke zorg bij technologie voor geestelijke gezondheid is dat computersystemen als mysterieuze “zwarte dozen” kunnen lijken, voorspellingen leverend zonder duidelijke redenen. Om dit aan te pakken, gebruikten de onderzoekers een methode genaamd LIME die onthult welke woorden het model naar een bepaalde beslissing duwden. Simpel gezegd verbergt of wijzigt LIME delen van een bericht en bekijkt hoe het antwoord van het model verandert. Als het weghalen van een woord als “paniek” plotseling de voorspelde gemeenschap verandert, wordt dat woord als belangrijk beoordeeld. Door dit proces duizenden keren op veel berichten te herhalen, stelde het team lijsten samen van de meest invloedrijke woorden voor elke gemeenschap en controleerde ze of deze woorden overeenkomen met wat clinici weten over elke aandoening.

Onderscheidende stemmen voor verschillende problemen

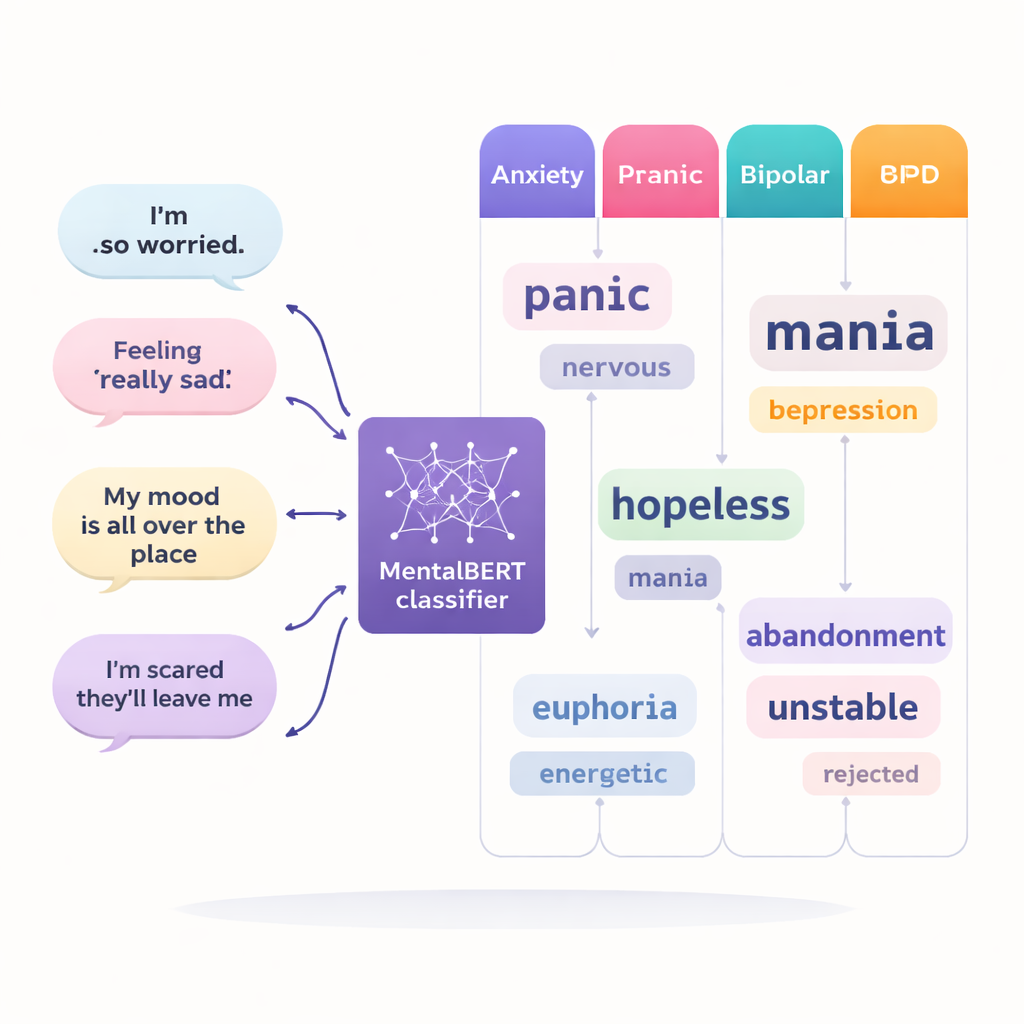

De verklaringen onthulden duidelijke taalpatronen. In angsgemeenschappen vielen woorden als “paniek”, “aanval” en “zorgen” op, vaak gekoppeld aan lichamelijke klachten en plotselinge vlagen van angst. Depressieberichten bevatten vaak termen als “hopeloos”, “waardeloos”, “leven” en “meer”, die diepe droefheid en het gevoel dat het niet beter zal worden weerspiegelen. In BPS-discussies verschoof de focus naar relaties en emoties, met sleutelwoorden zoals “verlating”, “relatie”, “binding” en “fp” (afkorting voor “favorite person”, een term die veel in deze groepen voorkomt). Bipolaire berichten benadrukten stemmingswisselingen en behandeltaal, met woorden als “manie”, “manisch”, “hypomanie”, “stemming” en medicijnnamen zoals “lithium” en “lamictal”. De modellen lieten ook zien waar aandoeningen in elkaar overlopen: angst- en depressieberichten kunnen bijvoorbeeld beide draaien om nood en negatieve gevoelens, waardoor ze gemakkelijker te verwarren zijn, net zoals bij een echte diagnose kan gebeuren.

Van online berichten naar impact in de echte wereld

Voor een niet-specialist is de kernboodschap dat computers betrouwbaar gesprekken over geestelijke gezondheid op thema kunnen sorteren en kunnen verklaren welke woorden hun keuzes sturen, maar dat ze nog steeds niemand kunnen en zouden moeten diagnosticeren. De modellen in deze studie fungeren meer als bibliothecarissen voor online steunzones: ze helpen controleren of discussies in een bepaalde gemeenschap echt overeenkomen met het aangegeven onderwerp. Dit kan moderators ondersteunen bij het relevant houden van gesprekken en onderzoekers of clinici helpen beter te begrijpen hoe mensen hun problemen buiten formele afspraken omschrijven. Met zorgvuldige menselijke toezicht en aandacht voor privacy en stigma kunnen dergelijke hulpmiddelen op termijn meer gastvrije en beter georganiseerde online ruimtes voor gesprekken over geestelijke gezondheid ondersteunen.

Bronvermelding: Sánchez Rodríguez, I., Bianchi, J., Pinelli, F. et al. Understanding mental health discourse on Reddit with transformers and explainability. Sci Rep 16, 6796 (2026). https://doi.org/10.1038/s41598-026-35918-3

Trefwoorden: geestelijke gezondheid, sociale media, Reddit, verklaarbare AI, tekstclassificatie