Clear Sky Science · nl

Hiërarchische contextuele informatie-aggregatie voor poliepsegmentatie

Waarom kleine gezwellen in de dikke darm ertoe doen

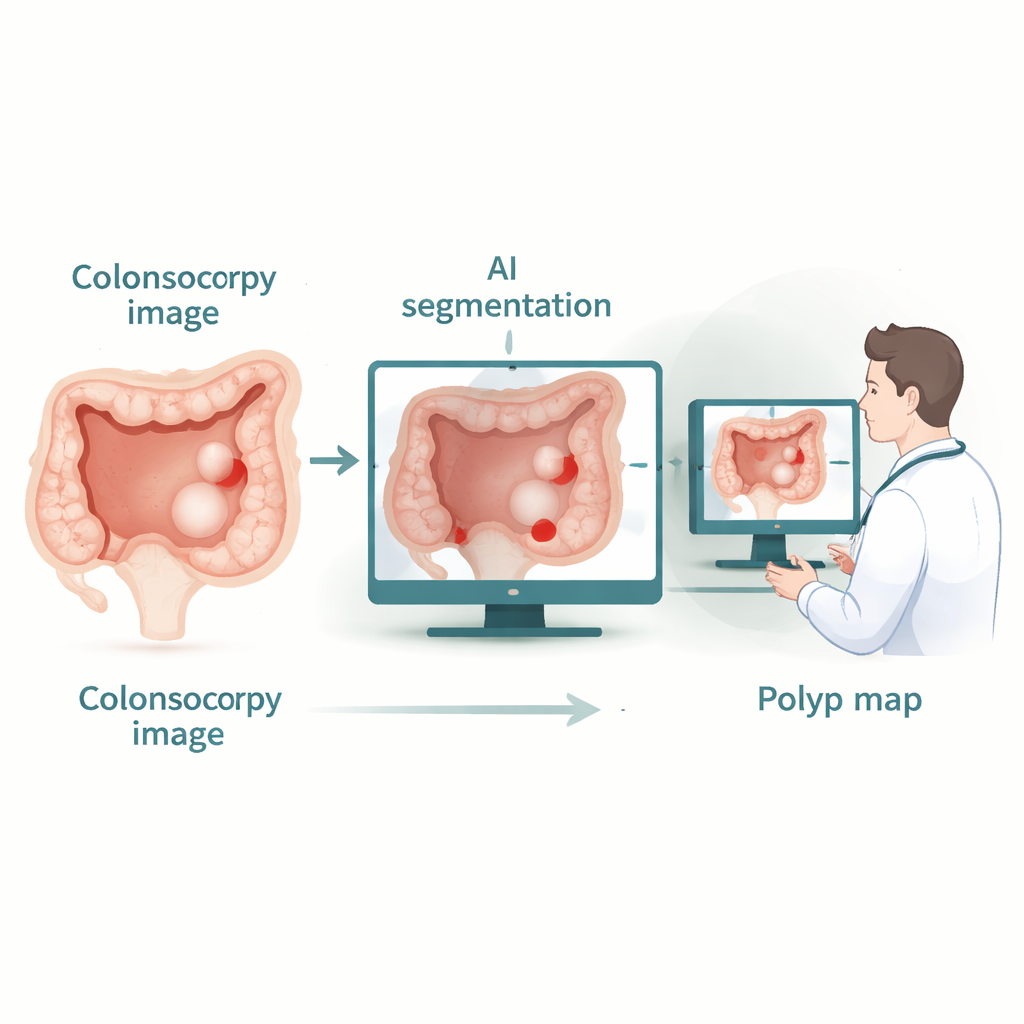

Darmkanker begint vaak als kleine, ogenschijnlijk onschuldige bultjes—poliepen—op het slijmvlies van de dikke darm. Tijdens een coloscopie proberen artsen deze gezwellen te vinden en te verwijderen voordat ze gevaarlijk worden. Maar mensen raken vermoeid, het zicht is niet altijd perfect, en onderzoeken tonen aan dat tot een kwart van de poliepen gemist kan worden. Dit artikel introduceert een nieuw kunstmatig-intelligentiesysteem (AI) dat ontworpen is om poliepen in coloscopiebeelden automatisch en met hoge precisie af te bakenen, met als doel een betrouwbare assistent te worden die artsen helpt meer te zien—en minder te missen.

Het bos en de bomen zien

Moderne AI-tools voor medische beelden vallen meestal in twee kampen. Het ene kamp, gebaseerd op klassieke convolutionele neurale netwerken, is erg goed in het herkennen van fijne lokale details, zoals subtiele randen of textuurveranderingen, maar heeft moeite te begrijpen hoe ver uit elkaar liggende beeldgebieden zich tot elkaar verhouden. Het andere kamp, gebaseerd op transformermodellen, blinkt uit in het vastleggen van ver-reikende relaties—het ‘grote geheel’ over een heel beeld zien—maar kan scherpte rond kleine structuren zoals dunne poliepranden verliezen en is soms duur in gebruik. Recente hybride systemen proberen beide benaderingen te combineren, maar neigen er vaak toe het convolutionele deel te bevoordelen en maken niet altijd optimaal gebruik van aandachtmechanismen, wat leidt tot vage randen en gemiste context.

Een nieuwe manier om aanwijzingen over schalen te combineren

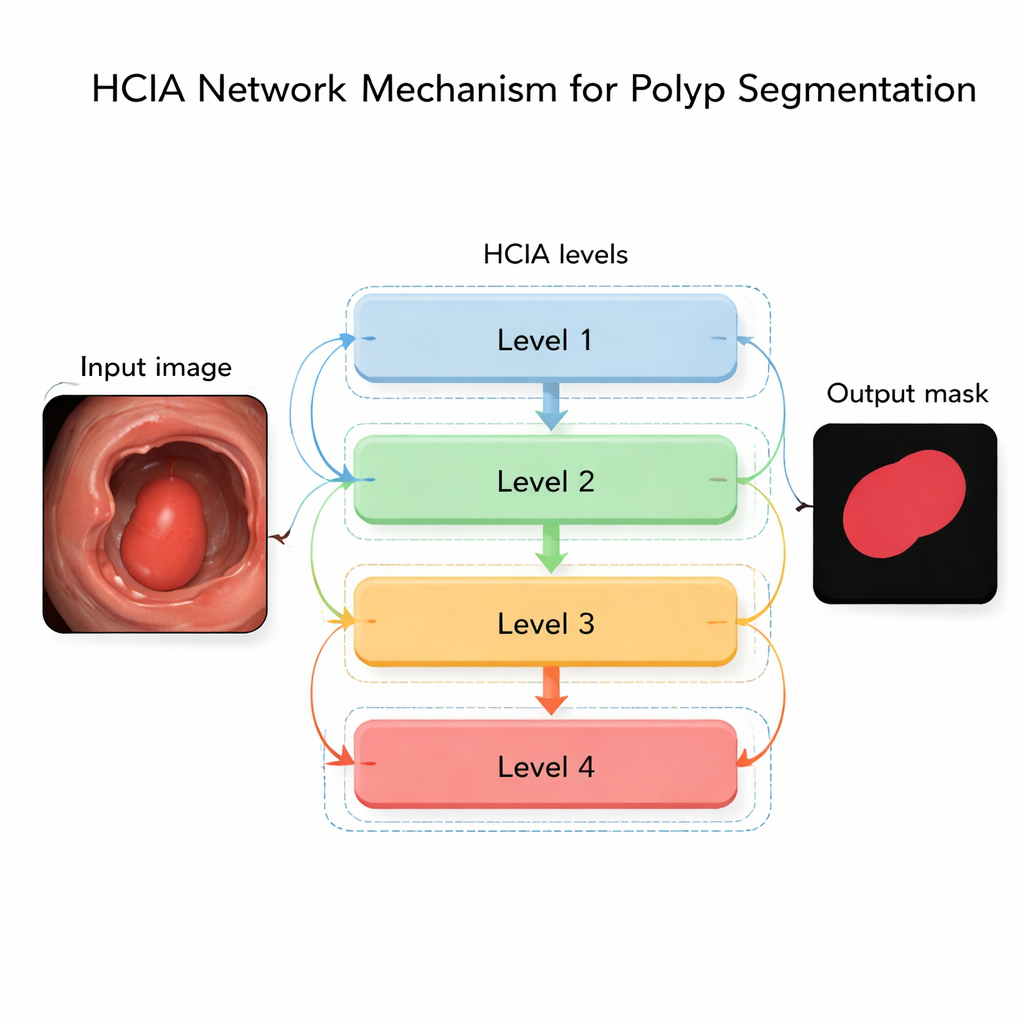

De auteurs stellen een netwerk voor dat de Hiërarchische Contextuele Informatie-Aggregatie (HCIA) heet om deze beperkingen te overwinnen. HCIA is gebouwd om een coloscopiebeeld gelijktijdig op meerdere detailniveaus te bekijken—van ruwe, uitgezoomde weergaven tot fijne, ingezoomde beelden—en om deze niveaus op een gestructureerde manier met elkaar te laten communiceren. Een kerncomponent, de Hiërarchische Aggregatiemodule (HAM), voegt informatie uit aangrenzende niveaus samen. Door ruwe context te mengen met fijnere details helpt HAM het systeem poliepen te onderscheiden van achtergrondweefsel met uiteenlopende kleuren, vormen en groottes, en verscherpt het de grenzen waar de poliep gezond weefsel raakt.

Slimme aandacht zonder zware rekencapaciteit

Het tweede cruciale onderdeel, de Interconnected Attention Module (IAM), pakt de uitdaging van globale context aan. In plaats van aandacht te berekenen op de gebruikelijke manier—waarbij elke pixel met elke andere pixel wordt vergeleken en de berekening snel kostbaar wordt—gebruikt IAM een gedeeld ‘geheugen’ dat samenvat wat het netwerk over alle niveaus heeft geleerd. Elk niveau raadpleegt dit geheugen om te beslissen welke delen van zijn kenmerken meer focus verdienen. Dit ontwerp stelt IAM in staat langeafstandsverbindingen over het hele beeld op te bouwen terwijl de rekenkosten beheersbaar blijven. Belangrijk is dat hetzelfde geheugen wordt gedeeld tussen de takken van het netwerk, wat een vorm van consistente, globale supervisie biedt en het model helpt zich op poliepen te concentreren ongeacht hun grootte of locatie.

Het systeem op de proef gesteld

Om te bepalen of het ontwerp van HCIA in de praktijk verschil maakt, testten de auteurs het op drie veelgebruikte poliepbeeldverzamelingen, elk met honderden tot duizend coloscopiefoto’s met door experts getekende poliepcontouren. Ze vergeleken HCIA met meer dan twintig toonaangevende AI-modellen, waaronder traditionele convolutionele netwerken en nieuwere transformer-gebaseerde hybriden. Op vrijwel alle maten—hoe goed de voorspelde poliepgebieden overlappen met de expertlabels, hoe nauwkeurig vormen worden vastgelegd en hoe goed structuren uitlijnen—bleek HCIA bovenaan te staan of gelijk te presteren aan de beste concurrenten. Het was vooral sterk bij tests over verschillende datasets heen, een veeleisende situatie die nabootst hoe een hulpmiddel moet presteren in ziekenhuizen met verschillende apparatuur en beeldomstandigheden. Gedetailleerde visuele vergelijkingen toonden dat HCIA onregelmatige poliepvormen en vage randen betrouwbaarder vastlegde dan concurrerende methoden.

Wat dit betekent voor patiënten en clinici

Voor niet-specialisten is de belangrijkste conclusie dat HCIA een AI-systeem is dat potentieel kankerverwekkende gezwellen in coloscopiebeelden nauwkeuriger afbakent en snel genoeg werkt voor realtime gebruik. Door scherpe lokale details te combineren met een sterk gevoel voor de algehele context, en dat efficiënt te doen, verkleint het de kans dat subtiele of eigenaardig gevormde poliepen onopgemerkt blijven. Hoewel het model nog verdere optimalisatie nodig heeft voor zeer lichte apparaten en nog geen gebruikmaakt van informatie uit videosequenties in de tijd, vormt het een betekenisvolle stap naar slimmere, betrouwbaardere computerondersteuning bij darmkankerscreening—en ondersteunt het artsen bij het eerder opsporen van gevaarlijke gezwellen voordat ze levensbedreigend worden.

Bronvermelding: Li, L., Yang, H., Zhang, J. et al. Hierarchical contextual information aggregation for polyp segmentation. Sci Rep 16, 5959 (2026). https://doi.org/10.1038/s41598-026-35703-2

Trefwoorden: colorectale poliepen, coloscopie AI, medische beeldsegmentatie, deep learning, vroegtijdige kankerdetectie