Clear Sky Science · nl

CRFusion: een nieuw LiDAR-camera fusienetwerk voor BEV-kaartconstructie

Slimmere digitale kaarten voor zelfrijdende auto’s

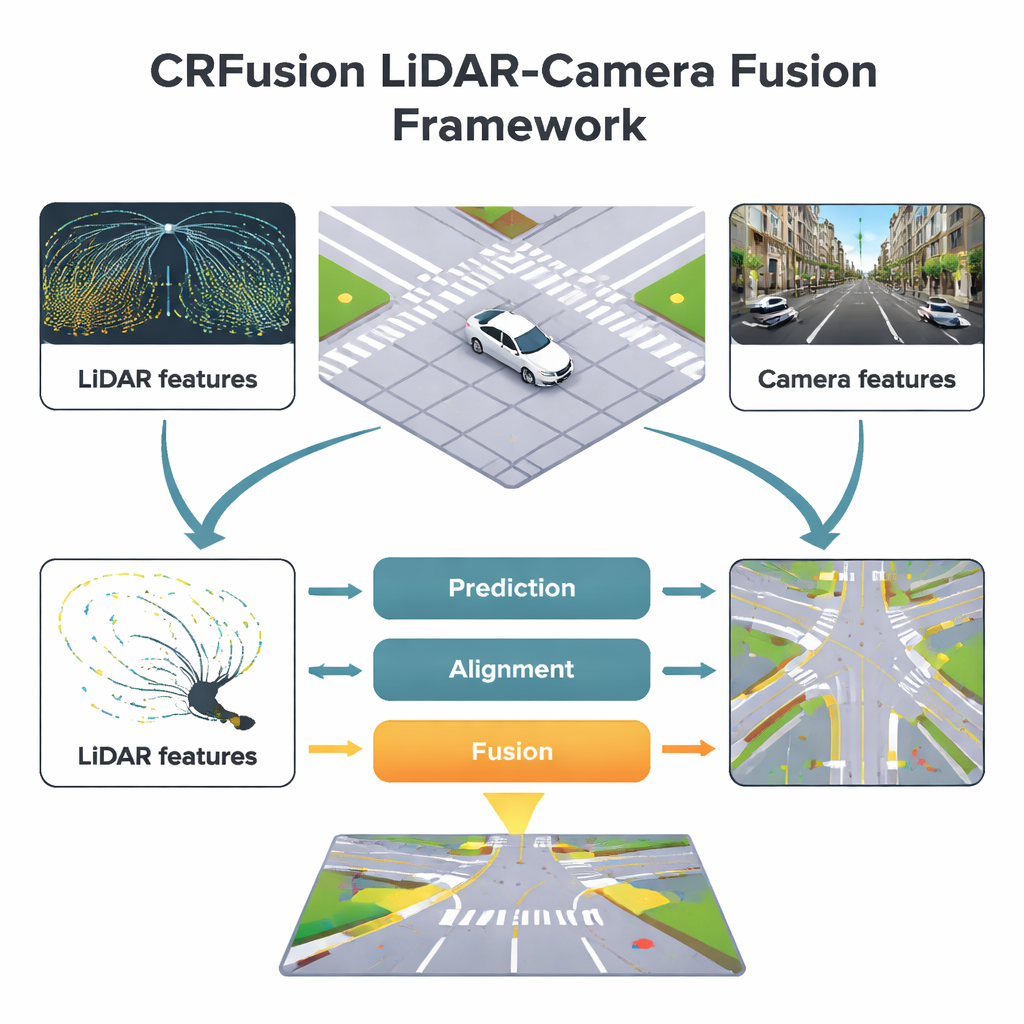

Voor een zelfrijdende auto is het begrijpen van de weg voor zich als het lezen van een continu veranderende kaart. Het voertuig moet precies weten waar rijstroken, zebrapaden en randlijnen zich bevinden, zelfs wanneer het donker is, regent of iets het zicht blokkeert. Dit artikel introduceert CRFusion, een nieuw systeem dat laserscanners en camera’s combineert om schonere, betrouwbaardere bovenaanzichten van stadsstraten te bouwen, waardoor autonome auto’s met meer vertrouwen in hun rijstroken blijven en mensen beter ontwijken.

Waarom twee “elektronische ogen” beter zijn dan één

Moderne zelfrijdende auto’s vertrouwen sterk op twee hoofd sensoren. Camera’s leggen rijke kleurbeelden vast, waardoor het eenvoudig is om rijstrookmarkeringen, verkeersborden en zebrapaden ver vooruit te zien. Laserscanners, of LiDAR, sturen lichtpulsen uit en meten hun terugkeer, waardoor ze een nauwkeurig 3D‑beeld van afstanden en vormen rond de auto opbouwen. Beide hebben zwaktes: camerabeelden kunnen worden misleid door slechte belichting of slecht weer, terwijl LiDAR-metingen schaars en onvolledig worden naarmate de afstand toeneemt. CRFusion is ontworpen om deze sterke en zwakke punten te verenigen in één bovenaanzicht (bird’s-eye view), een plattegrond waar elke pixel een klein stukje grond voorstelt dat is gelabeld als rijstrook, afscheiding of voetgangersoversteekplaats.

De gaten opvullen in verafzien

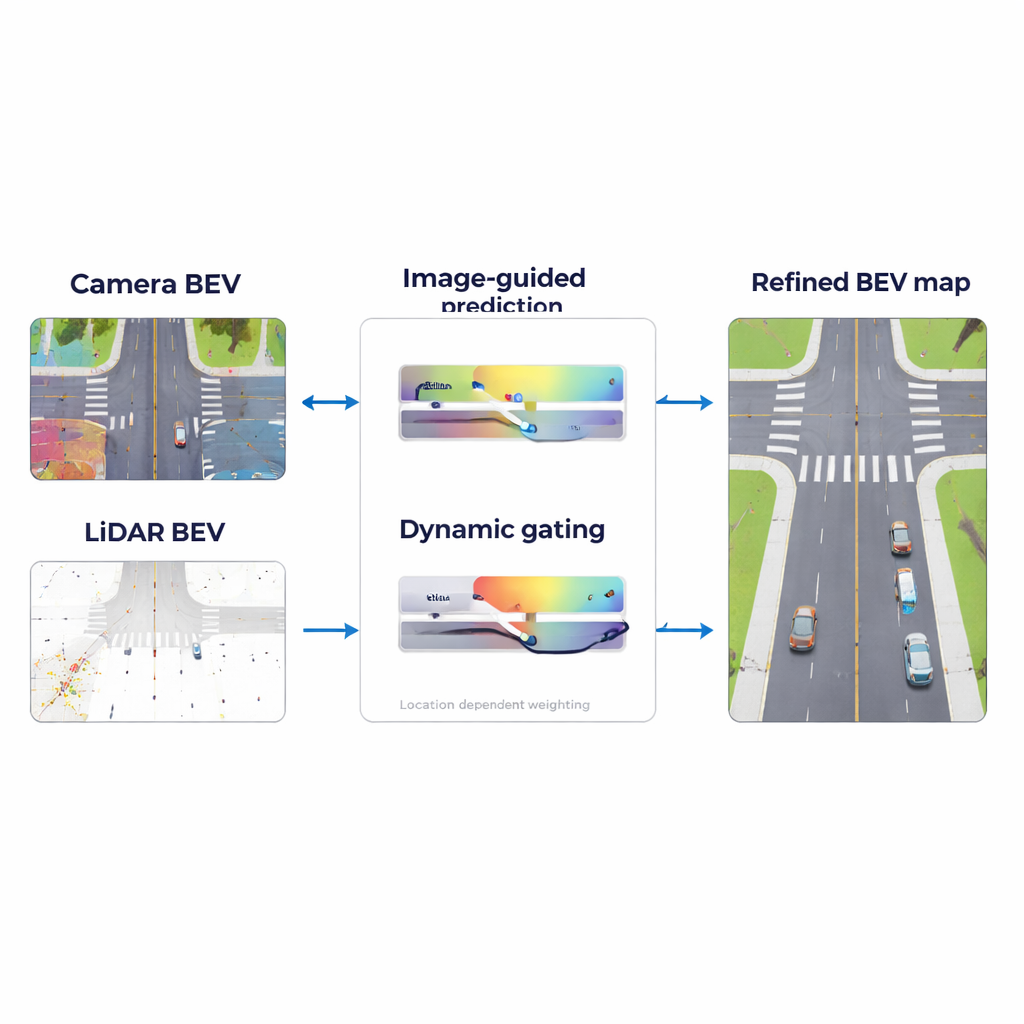

Een belangrijke uitdaging bij wegmapping is dat LiDAR vaak details mist die ver van de auto liggen, juist waar vooruit plannen het belangrijkst is. CRFusion pakt dit aan met een “LiDAR Range Predictor”. In eenvoudige bewoordingen bekijkt het systeem wat de camera ver langs de weg ziet en gebruikt die informatie om te voorspellen wat de LiDAR zou hebben gemeten als die dicht en volledig was geweest. Een mechanisme genaamd attention helpt het model te bepalen welke delen van het camerabeeld het beste de lege of onzekere gebieden in de LiDAR-gebaseerde kaart verklaren. Vervolgens verfijnt het deze voorspelling door nabijgelegen regio’s in de kaart te vergelijken, waardoor consistente patronen zoals doorlopende rijstroken worden versterkt en willekeurige ruis wordt verminderd.

Sensoren op één lijn krijgen

Zelfs wanneer zowel camera als LiDAR werken, komen ze niet perfect overeen. Kleine fouten in afstandsschattingen of sensorplaatsing kunnen ervoor zorgen dat rijstrookmarkeringen gezien door de camera licht verschoven lijken ten opzichte van LiDAR-metingen. CRFusion introduceert een uitlijningsstap die de top-down features van de camera zachtjes “vervormt” zodat ze beter aansluiten op het LiDAR‑beeld. Dit gebeurt met een lichte correctienetwerk dat voorspelt hoe elk punt in de camerakaart moet worden bijgestuurd. Daardoor beschrijven de twee sensorgezichten dezelfde fysieke wegposities, wat de latere fusie veel betrouwbaarder maakt.

Aanpassen aan dag, nacht en slecht weer

Nadat de twee sensorgezichten zijn uitgelijnd, moet het systeem nog beslissen hoeveel het elk op elke locatie vertrouwt. Een zonnige snelweg met duidelijke rijstrookmarkeringen is heel anders dan een regenachtige nacht in een drukke stad. CRFusion lost dit op met een “Dynamic Gated Fusion”-module die flexibele gewichten toekent aan de camera‑ en LiDAR‑features over de kaart. Waar LiDAR‑returns sterk zijn, zoals nabij wegkanten of vaste objecten, leunt het systeem meer op LiDAR. Waar visuele aanwijzingen duidelijker zijn, zoals heldere zebrapaden op afstand, vertrouwt het meer op de camera. Deze gewichten worden automatisch uit data geleerd, zodat de fusiemethode soepel kan verschuiven naargelang de omstandigheden veranderen.

De voordelen aantonen met echte data

De onderzoekers testten CRFusion op een veelgebruikt dataset voor autonoom rijden genaamd nuScenes, dat veel rijscènes bevat in verschillende steden, weersomstandigheden en tijdstippen van de dag. Vergeleken met toonaangevende eerdere methoden leverde CRFusion nauwkeurigere rijstrookgrenzen, afscheidingen en zebrapaden, vooral op middellange en lange afstanden tot 90 meter. Het verbeterde standaardkwaliteitsmaten voor zowel overlap met grondwaarheidskaarten als het vermogen om individuele rijstrooksegmenten te detecteren, en een “ablation”-studie toonde aan dat elk hoofdonderdeel — de langafstandsvoorspelling, het uitlijningsnetwerk en de dynamische fusie — zinvolle winst bijdroeg. Visuele voorbeelden lieten vloeiendere rijstrookcontinuïteit en duidelijkere zebrapaden zien, wat bevestigt dat de kaarten van het systeem meer op zorgvuldig getekende wegplannen lijken.

Wat dit betekent voor alledaags rijden

Voor niet‑specialisten is de belangrijkste conclusie dat CRFusion zelfrijdende auto’s helpt schonere, betrouwbaardere straatkaarten te bouwen door camera’s en LiDAR op een slimmere manier “met elkaar te laten praten”. Door ontbrekende LiDAR‑informatie te voorspellen vanuit camerabeelden, de twee sensorperspectieven op één lijn te brengen en te bepalen hoeveel vertrouwen aan elk gegeven moet worden op basis van de situatie, vermindert het systeem blinde vlekken en giswerk. Dit brengt autonome voertuigen een stap dichter bij het met hetzelfde vertrouwen omgaan met complexe, rommelige stadsstraten als een zorgvuldige menselijke bestuurder die goed gemarkeerde rijstroken en oversteekplaatsen volgt.

Bronvermelding: Guan, Y., Wang, T., Cheng, Q. et al. CRFusion: a novel LiDAR-camera fusion network for BEV map construction. Sci Rep 16, 5169 (2026). https://doi.org/10.1038/s41598-026-35551-0

Trefwoorden: autonoom rijden, LiDAR-camera fusie, HD semantische kaarten, bird’s-eye view perceptie, stedelijke wegmapping