Clear Sky Science · nl

Quantum denoising autoencoder verbetert de kwaliteit van retinafundusbeelden voor vroege screening op diabetische retinopathie

Heldere oogscans om het gezichtsvermogen te beschermen

Voor miljoenen mensen met diabetes kan een eenvoudige foto van de achterkant van het oog de vroegste waarschuwingssignalen van blindheid onthullen. Maar deze retinabeelden zijn vaak korrelig of wazig door cameraruizen, waardoor kleine, gezichtsbesparende details moeilijk te zien zijn. Dit artikel onderzoekt een ongewone bondgenoot in de strijd tegen blindheid: een nieuwe methode om beelden te zuiveren die hedendaagse deep learning combineert met toekomstige quantumcomputers om scherpere oogscans te produceren voor vroege screening op diabetische retinopathie.

Waarom kleine details in oogfoto’s ertoe doen

Diabetische retinopathie is een aandoening waarbij hoge bloedsuikerspiegel geleidelijk de fijne bloedvaatjes in het netvlies beschadigt. Artsen zoeken naar kleine uitstulpingen in vaatjes (microaneurysma’s), dun vertakkende capillairen en subtiele textuurveranderingen om de ziekte te ontdekken voordat het gezichtsvermogen verloren gaat. Deze tekenen zijn in een standaard fundusfoto vaak slechts enkele pixels breed. Helaas worden real‑world beelden die in screeningscentra worden gemaakt beïnvloed door vele soorten ruis: sensoronvolkomenheden, zwakke belichting en bewegingsonscherpte. Traditionele schoonmaakmethoden, zoals Gaussiaanse vervaging of mediancorrecties, kunnen een deel van deze ruis wegnemen—maar ze hebben de neiging precies die fragiele structuren weg te wassen waar artsen het meest om geven.

Beperkingen van de huidige slimme filters

In de afgelopen jaren zijn deep‑learningmethoden de werkpaarden geworden van medische beeldontruising. Convolutionele autoencoders, residual networks (ResNets) en gespecialiseerde denoising‑CNN’s kunnen leren hoe een “schoon” beeld er uit zou moeten zien en vervolgens de ruis uit nieuwe scans verwijderen. Deze modellen werken goed, maar ze hebben nadelen. Om complexe afbeeldingspatronen vast te leggen, hebben ze veel lagen en miljoenen parameters nodig, wat zware rekenkracht en veel trainingsdata vergt. In medische beeldvorming, waar gelabelde datasets relatief klein zijn, kunnen zulke grote modellen overfitten—trainingafbeeldingen memoriseren in plaats van generaliseren—en ze kunnen nog steeds dunne vaatjes of kleine laesies vervagen.

Quantumideeën in het beeld brengen

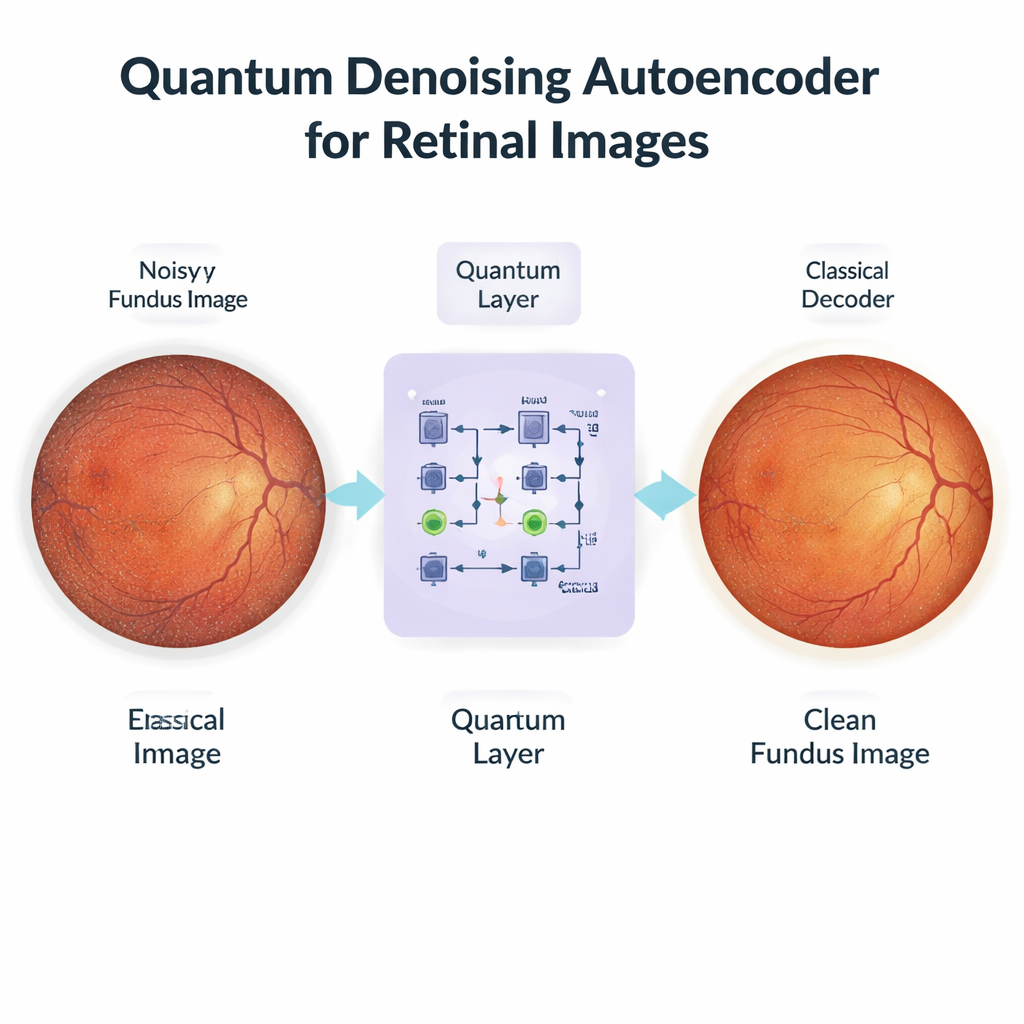

De auteurs stellen een hybride aanpak voor, de Quantum Denoising Autoencoder (QDAE). Op het eerste gezicht lijkt het op een standaard deep‑learningpipeline: een klassieke encoder comprimeert elke ruisige oogfoto tot een compacte set kenmerken, en een klassieke decoder reconstrueert later een opgeschoond beeld. De sleutelwijziging gebeurt in het midden. In plaats van kenmerken direct door een eenvoudige wiskundige bottleneck te sturen, zet QDAE ze om in quantumachtige toestanden en verwerkt ze met een kleine, geparametriseerde quantumcircuit voordat ze terug worden omgezet. In fysieke quantummachines zou superpositie toelaten dat veel kenmerkcombinaties tegelijk worden beschouwd, en verstrengeling zou verre delen van het beeld koppelen. Hoewel dit werk gesimuleerde circuits op een gewone GPU gebruikt, maakt dezelfde structuur het model in staat rijke, niet‑lineaire relaties tussen pixels te representeren met een relatief klein aantal te trainen parameters.

Schonere beelden, dunne vaatjes behouden

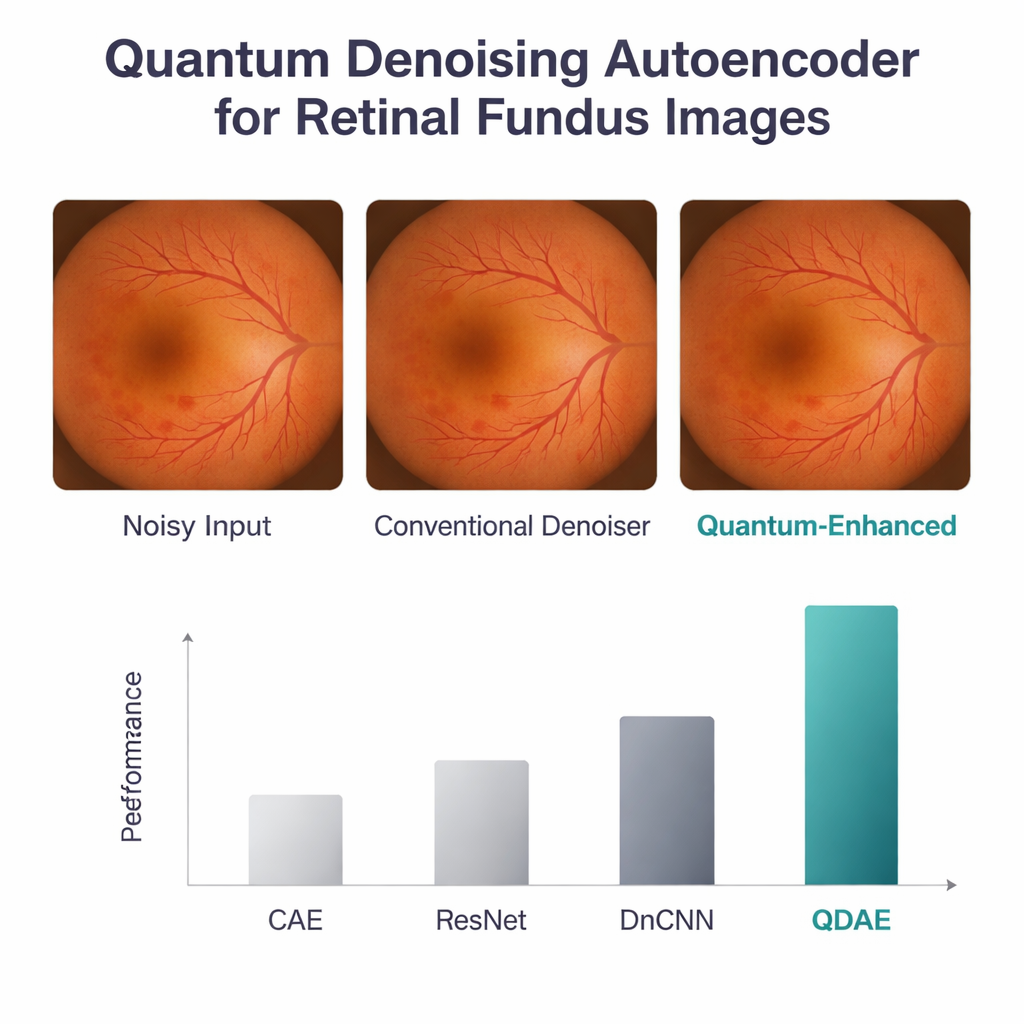

Om QDAE te testen gebruikten de onderzoekers een openbare dataset van retinabeelden, geschaald naar 224×224 pixels en kunstmatig aangetast met realistische Gaussiaanse en speckle‑ruis. Ze vergeleken hun methode met drie sterke basismodellen: een convolutionele autoencoder, een ResNet‑gebaseerd model en een populaire denoising‑CNN. Alle modellen werden op dezelfde data getraind en geëvalueerd met standaard beeldkwaliteitscores. Het quantumverrijkte model kwam op elk belangrijk meetpunt als winnaar uit de bus: het behaalde een peak signal‑to‑noise ratio van 38,8 dB en een structural similarity score van 0,96, ruim boven de klassieke netwerken. Het behield ook beter de oorspronkelijke intensiteits‑ en textuurpatronen in de beelden, inclusief de helderheid en het contrast van de papil, macula en het fijne vaatennetwerk. Hoewel de quantumstap een kleine vertraging toevoegde—ongeveer een halve seconde per afbeelding—bleven de totale rekenkosten vergelijkbaar met die van diepe CNN’s dankzij het gebruik van ondiepe circuits met slechts vier qubits en drie lagen.

Wat dit kan betekenen voor patiënten en klinieken

Voor iemand met diabetes komen de technische details neer op een eenvoudig voordeel: scherpere oogfoto’s die het makkelijker maken voor software en specialisten om de ziekte vroeg te ontdekken, wanneer behandeling nog gezichtsverlies kan voorkomen. De QDAE fungeert als een slimme voorreinigingsstap die kan worden ingeplugd in bestaande screeningssystemen, wat downstream‑tools helpt die laesies segmenteren of de ernst van de ziekte beoordelen. Omdat het quantumdeel momenteel wordt gesimuleerd, zouden ziekenhuizen geen speciale quantumhardware nodig hebben om het te proberen, maar het ontwerp is klaar voor toekomstige quantumapparaten naarmate die volwassen worden. De studie vereist nog bredere klinische testen op beelden uit veel verschillende klinieken en camera’s, maar biedt een intrigerende blik op hoe quantum‑geïnspireerde computing routinematige oogonderzoeken stilletjes zou kunnen verbeteren en uiteindelijk zou kunnen helpen het gezichtsvermogen te behouden.

Bronvermelding: Chilukuri, R., P, P., Gatla, R.K. et al. Quantum denoising autoencoder improves retinal fundus image quality for early diabetic retinopathy screening. Sci Rep 16, 5970 (2026). https://doi.org/10.1038/s41598-026-35540-3

Trefwoorden: diabetische retinopathie, retinale beeldvorming, beeldontruising, quantum machine learning, medische AI