Clear Sky Science · nl

Een nieuwe deep learning-benadering voor het classificeren van muggensoorten via een dual-head structuur en een calibratie-bewuste fusiearchitectuur

Waarom slimere mugidentificatie ertoe doet

Muggen zijn klein, maar verspreiden enkele van de gevaarlijkste ziekten ter wereld. Gezondheidsinstanties vertrouwen steeds vaker op smartphonefoto’s van gevangen insecten om bij te houden waar verschillende soorten opduiken. Het probleem is dat veel muggen verwarrend veel op elkaar lijken, en veldfoto’s vaak onscherp zijn, slecht verlicht of met uiteenlopende camera’s zijn gemaakt. Deze studie introduceert een nieuw AI-systeem dat op laboratoriumniveau onderscheid kan maken tussen sterk gelijkende muggensoorten en daarbij ook aangeeft hoe zeker het is van elke beslissing — een eigenschap die cruciaal is wanneer die beslissingen reële bestrijdingsacties sturen.

Van telefoontjes naar betrouwbare identificaties

De onderzoekers richten zich op beelden die lijken op wat een veldwerker of burgerwetenschapper zou maken: hele muggen gefotografeerd met smartphones tegen rommelige, realistische achtergronden. Hun doel is tweeledig. Ten eerste moet het systeem correct onderscheid maken tussen acht categorieën, waaronder meerdere ziekteoverdragende Aedes- en Culex-soorten en een groep "overig/ongekend". Ten tweede moet het de zekerheid van elke voorspelling zo aangeven dat die overeenkomt met de werkelijkheid, zodat functionarissen veilig drempels kunnen instellen — bijvoorbeeld beslissen wanneer een vervolgbezoek aan een buurt nodig is. Slecht gekalibreerde systemen klinken soms zeker maar zijn vaak fout wanneer ze in nieuwe locaties of met andere cameratypes worden gebruikt.

Twee visiepaden die samenwerken

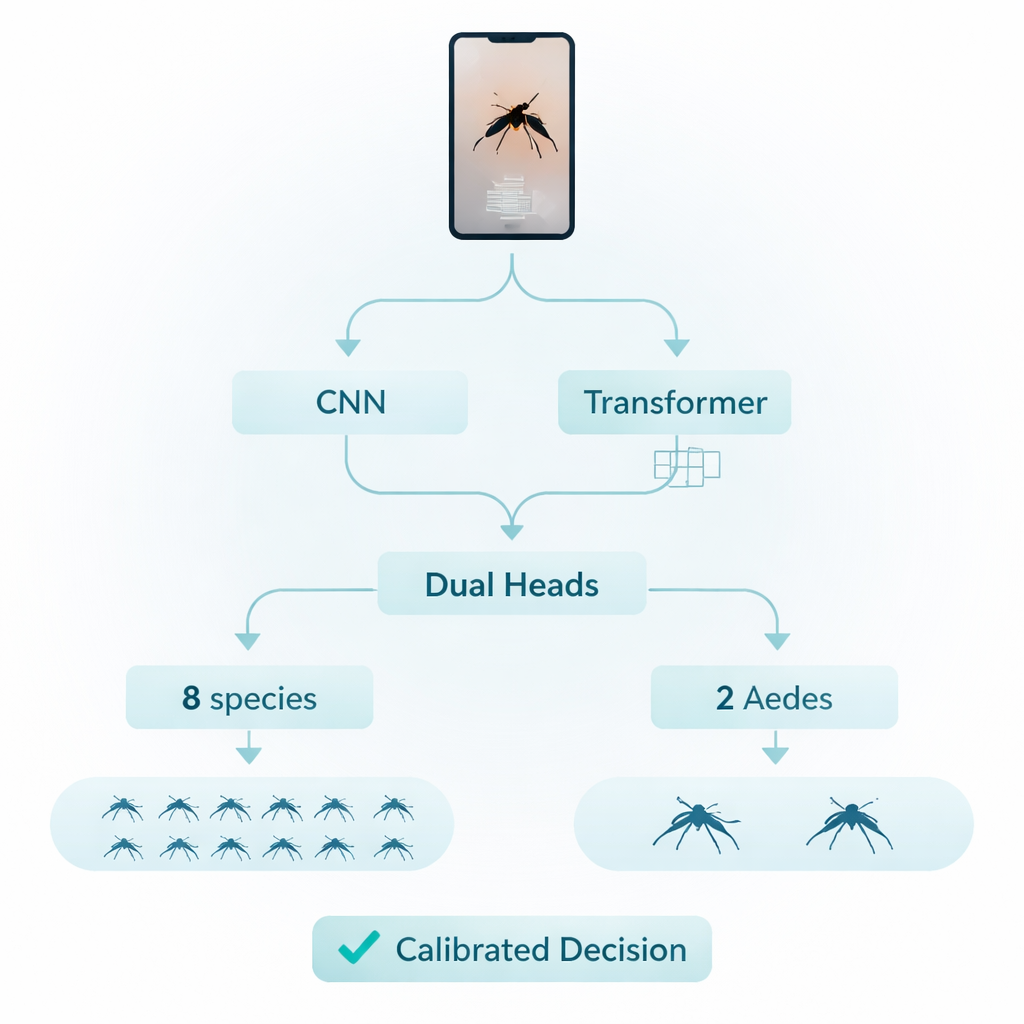

Om deze doelen te bereiken bouwen de onderzoekers een beeldanalyse-pijplijn die twee complementaire manieren van "zien" combineert. Het ene pad gebruikt conventionele convolutionele neurale netwerken (CNN’s), die uitblinken in het oppikken van lokale texturen zoals lichaamsschubben, strepen en vleugeladers. Het andere pad gebruikt een nieuwere opzet genaamd Transformer, die beter is in het vastleggen van de algemene rangschikking van lichaamsdelen over het beeld, zoals de verhoudingen tussen vleugels, thorax en abdomen. Beide paden verwerken tegelijkertijd dezelfde mugfoto en voeren hun beoordelingen vervolgens samen naar een gedeelde beslismodulen. Deze diverse opzet helpt het systeem betrouwbaar te blijven, zelfs wanneer foto’s variëren in houding, scherpte of apparaat.

Gelijktijdig leren van gedetailleerde en grove labels

Een belangrijke vernieuwing zit in hoe het systeem wordt getraind om over soorten te denken. In plaats van slechts één taak te leren, leert het er twee tegelijk. Eén "head" voorspelt alle acht categorieën in de hoofd-trainingsset. Een tweede "head" richt zich alleen op het onderscheiden van twee nauw verwante Aedes-soorten die van bijzonder belang zijn voor de volksgezondheid. Door deze fijne en grove onderscheidingen gezamenlijk te leren, verscherpt het model de scheidslijnen tussen gemakkelijk te verwarren look‑alikes, terwijl het nog steeds de bredere set herkent. Tijdens training brengen de auteurs ook bewust een herweging van de data aan zodat zeldzame soorten meer invloed krijgen en het systeem niet simpelweg de meest voorkomende muggen bevoordeelt.

Ruwe scores omzetten naar betrouwbare zekerheid

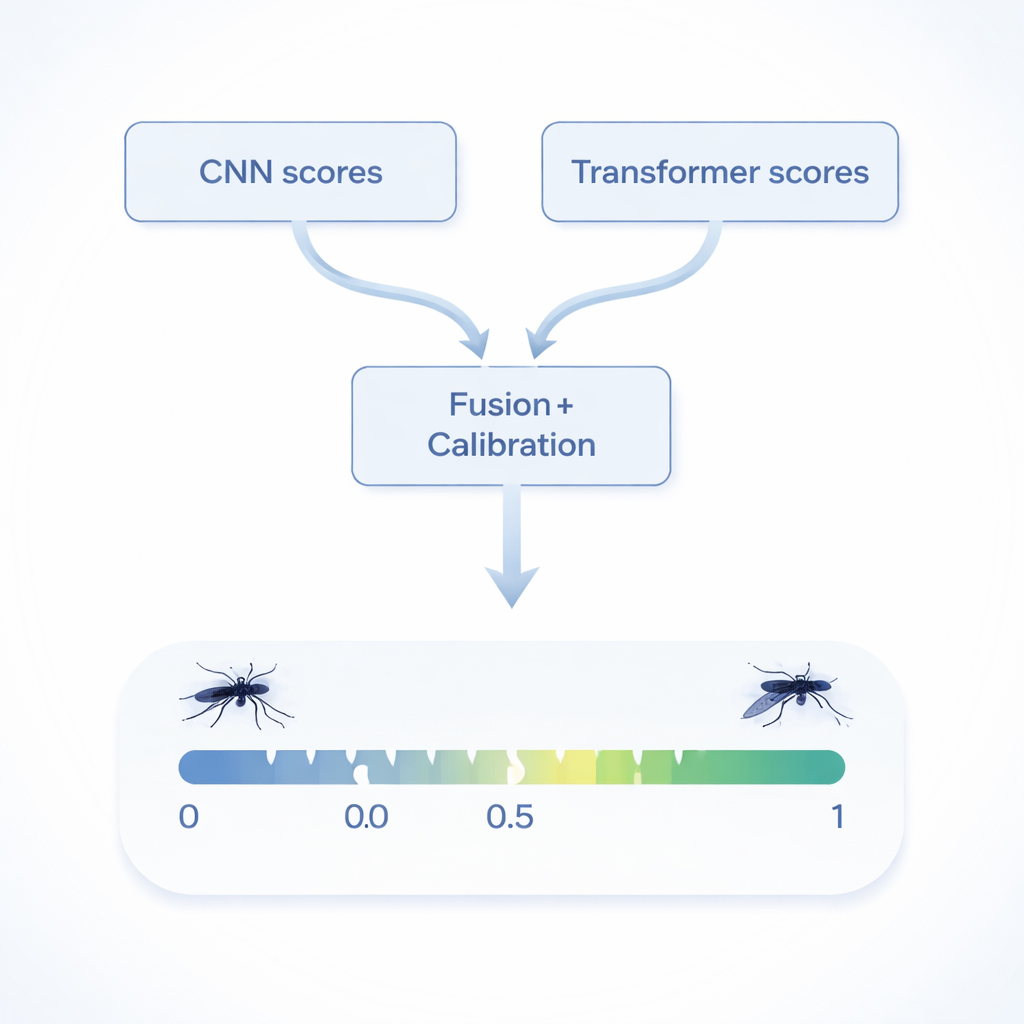

Een andere centrale vooruitgang is hoe het systeem informatie van zijn twee visiepaden en twee heads fuseert. In plaats van simpelweg hun gissingen te middelen, leert het model hoeveel het elke interne bron moet vertrouwen op basis van eerdere prestaties — een proces dat bekendstaat als calibrated stacking. Het geeft de gecombineerde score vervolgens een eenvoudige aanpassing via temperature scaling, die de scherpte van de betrouwbaarheidsniveaus fijntuned. Het team test elke afbeelding daarnaast meerdere keren met licht gewijzigde uitsneden en flips en middelen de uitkomsten om willekeurige variatie te verminderen. Samen zorgen deze stappen ervoor dat de uiteindelijke betrouwbaarheidscores nauw aansluiten bij de werkelijke foutpercentages, zelfs wanneer het systeem wordt toegepast op een volledig aparte dataset die het nog nooit heeft gezien.

Bijna perfecte nauwkeurigheid in lab en veld

Om te beoordelen hoe goed dit in de praktijk werkt, trainen en tunen de auteurs hun model op een grote acht-klasse smartphonebeeldverzameling en evalueren het vervolgens zowel op achtergehouden beelden uit die set als op een volledig aparte Aedes-dataset die strikt voor testen is gebruikt. Bij de oorspronkelijke achtklassenopgave bereikt hun methode circa 99,5 procent nauwkeurigheid, iets maar consistent beter dan sterke single-model baselines en eenvoudige ensembles. Op de niet-zien twee-soortentestset identificeert het systeem correct meer dan 99 procent van de beelden. Even belangrijk is dat de onzekerheid goed gekalibreerd is: wanneer het 90 procent zekerheid meldt, zit het slechts ongeveer één keer op tien fout — een eigenschap die veel eerdere mugherkenningssystemen niet maten of garandeerden.

Wat dit betekent voor de volksgezondheid

Voor niet-specialisten is de kernboodschap dat dit werk niet alleen een zeer nauwkeurige soortherkenner levert, maar ook een waarvan de zelfgerapporteerde zekerheid vertrouwd kan worden. Die combinatie stelt instanties in staat stabiele regels te hanteren — zoals "onderzoek elke locatie waar het model voor ten minste 80 procent zeker is dat het een gevaarlijke soort heeft gezien" — en te verwachten dat die regels vergelijkbaar presteren op verschillende telefoons, in verschillende regio’s en onder verschillende lichtomstandigheden. Hoewel uitdagingen blijven bestaan in extreme gevallen zoals zeer onscherpe of sterk bedekte insecten, biedt het voorgestelde systeem een praktisch, inzetbaar uitgangspunt voor grootschalige muggenbewaking en legt het de basis voor toekomstige tools die nieuwe soorten, nieuwe apparaten en zelfs aanvullende sensorische modi zoals geluid aankunnen.

Bronvermelding: Nazari, M.Z., Zarchi, M.S., Emadi, S. et al. A novel deep learning approach for mosquito species classification via a dual-head structure and calibration-aware fusion architecture. Sci Rep 16, 7208 (2026). https://doi.org/10.1038/s41598-026-35453-1

Trefwoorden: mugidentificatie, deep learning, vectorbewaking, gekalibreerde AI, beeldclassificatie