Clear Sky Science · nl

Bayesiaanse reinforcement learning voor adaptieve regeling van energie-terugwinning in arm van hydraulische graafmachines

Waarom slimmere graafmachines ertoe doen

Hydraulische graafmachines zijn de werkpaarden van de bouw en mijnbouw, maar ze verbruiken veel diesel en verspillen een groot deel van de energie die ze uit de motor putten. Elke verbetering in het energiegebruik kan zich vertalen naar lagere brandstofkosten voor aannemers en minder uitstoot voor iedereen. Deze studie onderzoekt een nieuwe manier om graafarmbewgingen "vooruit te laten denken" over veranderende grondomstandigheden en slijtage van de machine, zodat ze energie effectiever kunnen terugwinnen en hergebruiken, binnen strikte veiligheidsgrenzen.

Graven is zwaar voor de brandstof

Moderne graafmachines laten hun hydraulische systemen vaak op hoge, vaste drukken werken, ongeacht of ze door hard gesteente houwen of zacht los zand gladstrijken. Die eenheidsaanpak houdt machines betrouwbaar maar zet veel energie om in warmte, vooral bij lichte taken en wanneer de giek door zijn eigen gewicht daalt. Hoewel sommige nieuwere ontwerpen apparaten hebben die deze overtollige energie in hydraulische accumulatoren kunnen opvangen, vertrouwen de meeste machines nog op eenvoudige, vaste regels om te beslissen wanneer en hoe ze die gebruiken. Het resultaat is een brandstofverbruik dat tot 20% hoger kan liggen dan nodig en een grotere CO2-footprint op bouwplaatsen wereldwijd.

Een leersysteem voor de arm

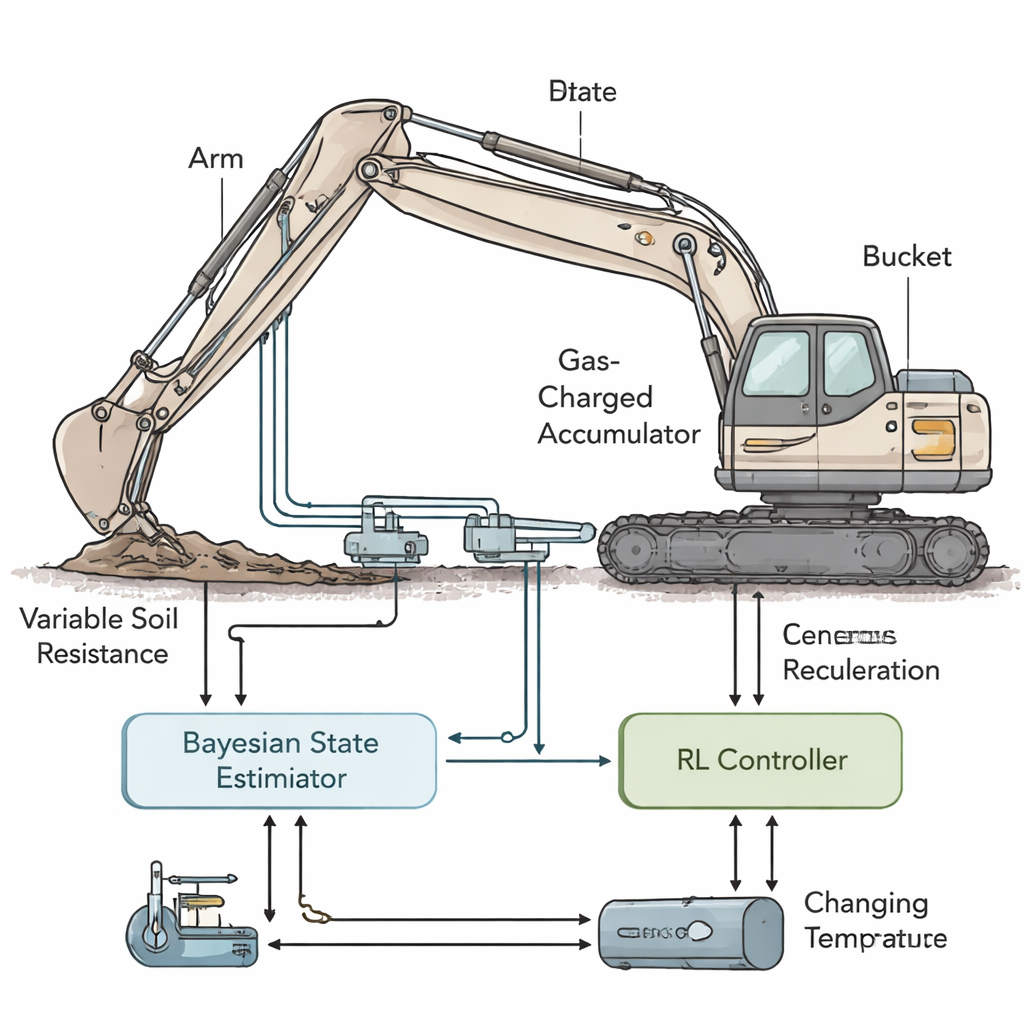

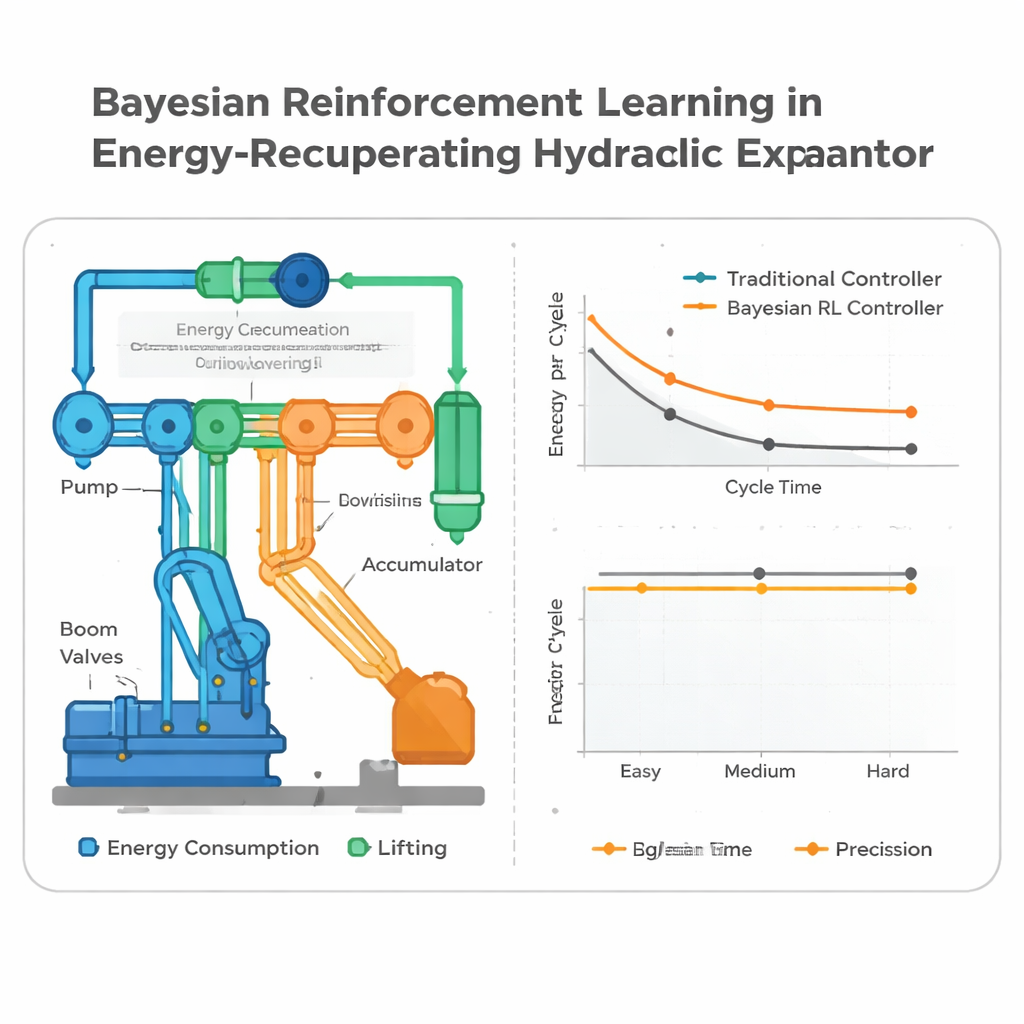

De auteurs bouwen een gedetailleerd virtueel model van een 21-ton graafarm, inclusief cilinders, pomp, kleppen en een met gas gevulde accumulator die energie opslaat wanneer de giek naar beneden beweegt en die later helpt bij het optillen van de last. Hun regelaar moet met veel onzekerheden uit de praktijk omgaan: grond die plots harder of zachter wordt, olie die bij temperatuur verandert in viscositeit, onderdelen die langzaam slijten en sensoren die ruisig of licht gebiased kunnen zijn. In plaats van aan te nemen dat alles bekend en constant is, behandelt het systeem de werkelijke staat van de machine als deels verborgen en werkt het continu zijn beste schatting bij met Bayesiaanse methoden. Een particle filter schat verborgen factoren zoals hoe weerstandbiedend de grond is en of de accumulator iets te vol of te leeg is ten opzichte van het ontwerppunt.

De machine veilig leren aanpassen

Bovenop deze toestandsestimator traint het team een reinforcement learning (RL) policy, een algoritme dat geleidelijk goede strategieën ontdekt door trial-and-error in simulatie. Op elk moment ontvangt de policy de huidige "belief" over de conditie van de machine en kiest continue commando’s voor pompdruk en klepopeningen. Een speciale veiligheidslaag controleert deze voorstellen vervolgens en knipt ze terug tot een strikt veilige marge: hydraulische drukken moeten overal tussen 5 en 35 megapascal blijven, de accumulator moet binnen zijn venster van 12–28 megapascal blijven en klepbewegingen zijn begrensd zodat ze het systeem niet rukken. Het leerproces beloont de regelaar voor het snel afronden van elke graafcyclus, het gebruik van zo weinig hydraulische energie mogelijk en het nauwkeurig houden van de bak op doel, terwijl acties die het systeem richting onveilige gebieden duwen worden bestraft.

Hoe goed de slimme regelaar presteert

De onderzoekers voeren uitgebreide co-simulaties uit op 100 updates per seconde en vergelijken hun Bayesiaanse RL-regelaar met twee meer traditionele opstellingen: één met vaste parameters en één die een vaardige operator nabootst die eenvoudige handmatige aanpassingen in druk en snelheid maakt. Alle regelaars krijgen dezelfde uitgewerkte 20-minutenklus, waarin de grond moeilijkheidsgraad in meerdere fasen verandert en de olie opwarmt van koel naar heet. De op leren gebaseerde regelaar volgt veranderingen in de grond binnen enkele seconden, verhoogt de druk wanneer de grond moeilijker wordt om de cyclustijden constant te houden, en verlaagt die wanneer het graven eenvoudiger wordt om energie te besparen en meer mogelijkheden te creëren om de accumulator te laden. Over veel gerandomiseerde runs bespaart hij per graafcyclus ongeveer 20–22% energie vergeleken met de vaste regelaar en ongeveer 14–18% vergeleken met de door een operator aangepaste regelaar, terwijl cyclustijden korter worden en de positie-nauwkeurigheid van de bak verbetert. Veiligheidsincidenten, zoals drukken die de limieten dreigen te overschrijden of veiligheidskleppen die langdurig openen, komen minder vaak voor hoewel het systeem harder op prestaties drukt.

Wat dit betekent voor echte machines

Voor een niet-specialistische lezer is de kernboodschap dat de graafarm zowel voorzichtig als zuinig kan leren zijn. Door voortdurend zijn begrip bij te werken van hoe moeilijk het is om te graven, hoe gezond de componenten zijn en hoeveel energie in de accumulator is opgeslagen, besluit de regelaar in realtime wanneer energie gespaard moet worden en wanneer er iets meer verbruik acceptabel is om de productiviteit te behouden. De studie is nog gebaseerd op simulatie in plaats van veldproeven en richt zich op één machinetype, maar laat zien dat het combineren van probabilistisch redeneren met op leren gebaseerde regeling zware uitrusting aanzienlijk efficiënter kan maken zonder veiligheid of snelheid op te offeren. Als vergelijkbare benaderingen naar echte graafmachines worden overgebracht, zouden ze aannemers kunnen helpen dezelfde hoeveelheid grond te verzetten met minder brandstof, minder slijtage en lagere emissies.

Bronvermelding: Hu, P., Wen, T., Zhang, D. et al. Bayesian reinforcement learning for adaptive control of energy recuperation in hydraulic excavator arms. Sci Rep 16, 6195 (2026). https://doi.org/10.1038/s41598-026-35391-y

Trefwoorden: hydraulische graafmachine, energieterugwinning, reinforcement learning, Bayesiaanse regeling, efficiëntie van zware machines