Clear Sky Science · nl

De rol van diagnostische waarde bij het beoordelen van robotcompetentie

Waarom foutjes van robots ons allemaal aangaan

Robots en AI-systemen verplaatsen zich snel van laboratoria naar fabrieken, ziekenhuizen en onze straten. Naarmate we meer op hen gaan vertrouwen, wordt één vraag cruciaal: hoe bepalen mensen of een robot werkelijk bekwaam is? Dit artikel onderzoekt hoe we een robot beoordelen die meestal goed presteert maar af en toe een verrassende fout maakt — of onverwacht succes boekt. De bevindingen helpen verklaren waarom onze "onderbuikgevoelens" over machines kunnen afwijken van wat we hardop zeggen, en waarom een enkele fout soms terzijde wordt geschoven en soms ons vertrouwen voorgoed verandert.

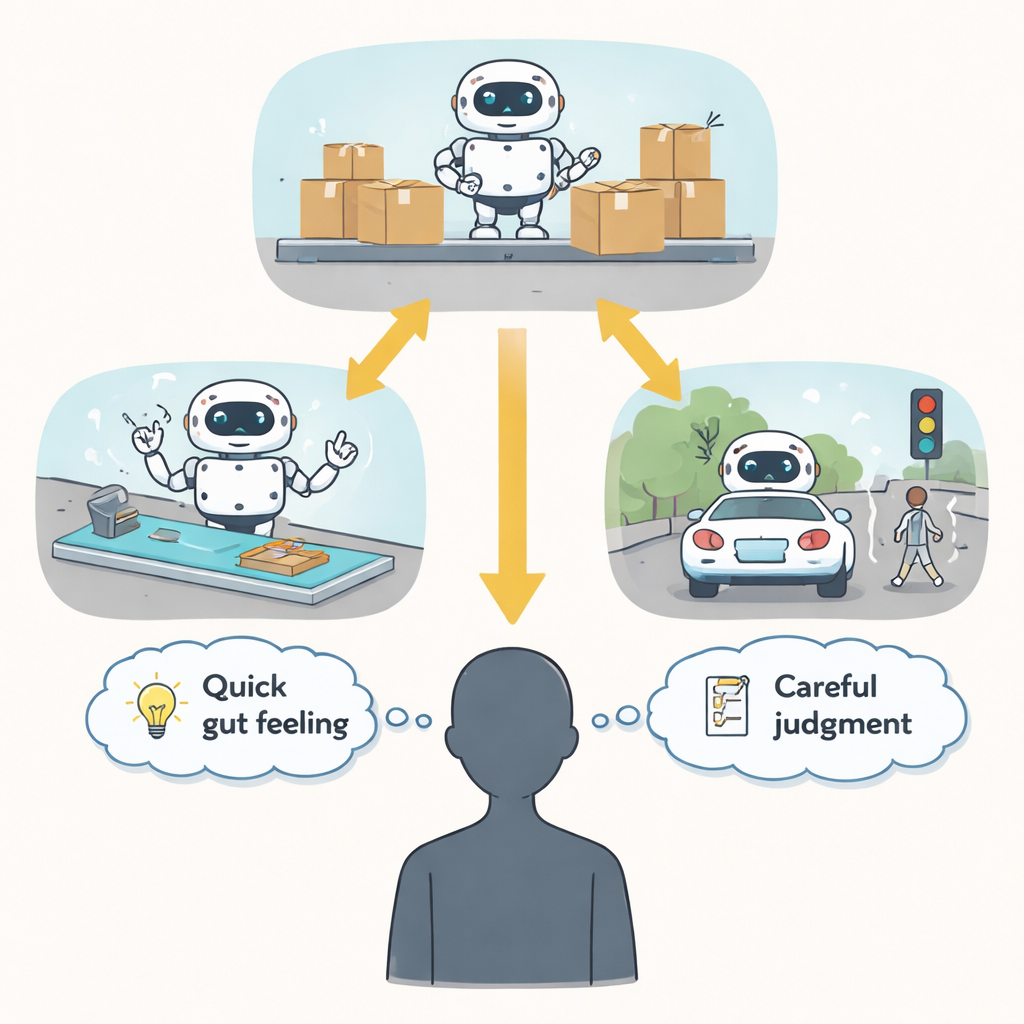

Twee manieren waarop ons denken machines beoordeelt

Psychologen maken onderscheid tussen twee soorten indrukken. Expliciete indrukken zijn de beoordelingen die we direct kunnen rapporteren wanneer we ernaar gevraagd worden, bijvoorbeeld het beoordelen van een robot op een competentieschaal van 1–7. Impliciete indrukken zijn meer automatisch en komen tot uiting in snelle reacties die mensen geven zonder expliciet te evalueren. Eerder onderzoek suggereerde dat expliciete indrukken snel veranderen bij nieuw gedrag, terwijl impliciete indrukken trager schuiven. Deze studie vraagt of dat verschil echt voortkomt uit verschillende mentale systemen — of dat het afhangt van hoe informatief, of diagnostisch, het nieuwe gedrag lijkt over de werkelijke capaciteiten van de robot.

Van fabriekshallen tot operatiekamers en snelwegen

In negen online-experimenten met in totaal meer dan 3.700 deelnemers toonden de onderzoekers mensen verschillende robots in realistische situaties: een industriële robot die zich door een druk magazijn beweegt, een chirurgische robot die precieze banen volgt, en een zelfrijdende auto die reageert op obstakels op de weg. Soms was de robot consequent vaardig of consequent onhandig. In andere gevallen was hij meestal bekwaam maar maakte één duidelijke fout, of meestal incompetenter maar had één opvallend succes. Na het bekijken van korte reeksen van deze prestaties werden de indrukken van deelnemers op twee manieren gemeten: via directe zelfrapportagevragen en via indirecte taken die snelle, automatische reacties opvingen.

Wanneer één afwijkende prestatie zwaar telt

In deze realistische scenario’s volgden de expliciete beoordelingen van deelnemers zowel het algemene prestatiepatroon als de zeldzame "oddball" proef. Een enkele fout tussen veel successen kon de expliciete scores merkbaar omlaag trekken, en een enkel succes tussen veel mislukkingen kon ze opkrikken. Impliciete indrukken vertelden echter een ander verhaal. Die reageerden sterk op het typische gedrag van de robot — of die meestal bekwaam was of niet — maar negeerden grotendeels die ene uitzondering. Deze dissociatie bleef bestaan zelfs toen de onderzoekers hun metingen zo herschikten dat de “expliciete” en “impliciete” taken er en aanvoelden als zo veel mogelijk hetzelfde, en alleen verschilden in of deelnemers bewust werd gevraagd de robot te beoordelen.

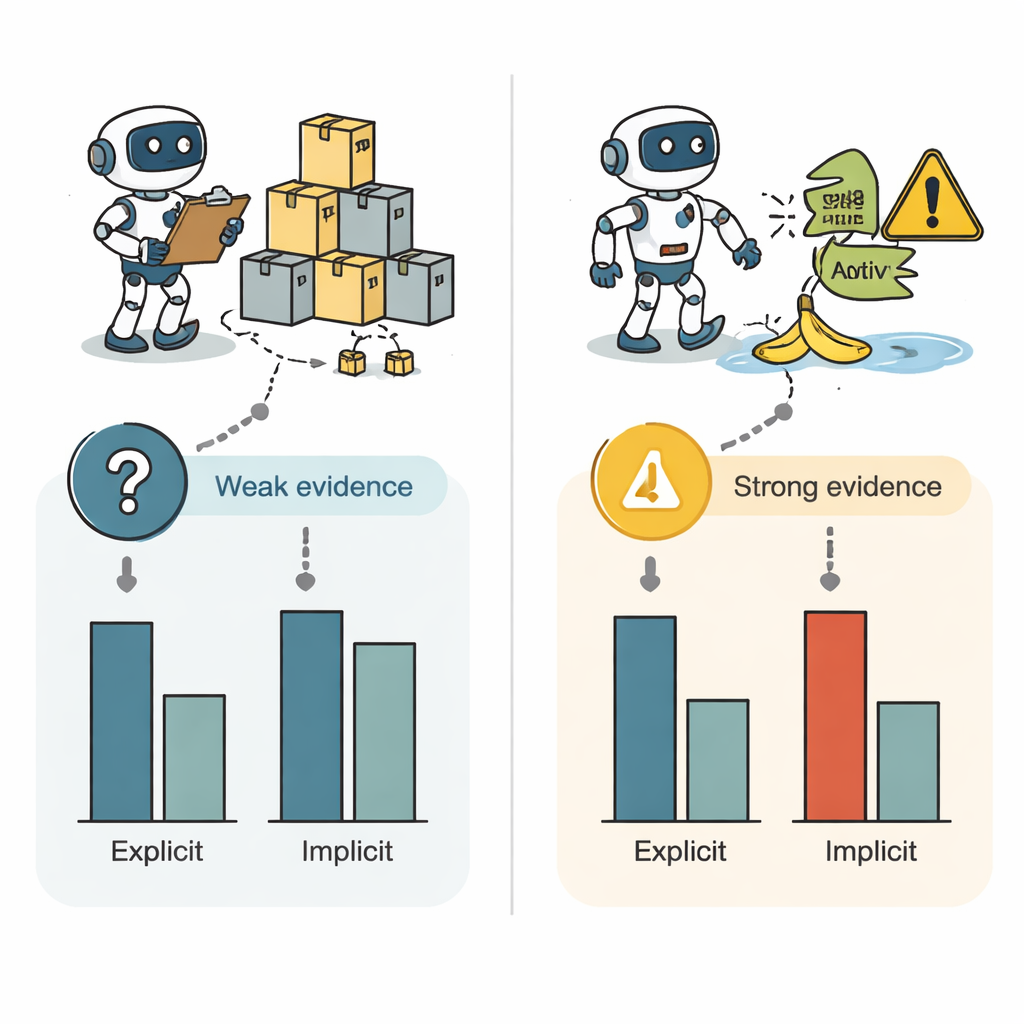

Wat een fout echt veelzeggend maakt

Het team testte vervolgens een kernidee: dat de impact van een afwijkende gebeurtenis afhangt van hoe diagnostisch die lijkt — of mensen denken dat het echt iets blijvends over de robot onthult. In nieuwe studies zagen deelnemers eerst meerdere foutloze runs van een robot, en later één of meer mislukkingen. Wanneer die latere mislukkingen werden gepresenteerd als belangrijk, recente tests, of wanneer meerdere fouten zich opstapelden tot het niveau van de eerdere successen, veranderden zowel expliciete als impliciete indrukken. Cruciaal is dat onder deze sterk-diagnostische omstandigheden zelfs een enkele fout genoeg was om automatische, impliciete indrukken te beïnvloeden. Wanneer hetzelfde soort misstap werd beschreven als verouderd, onbelangrijk of als een eenmalige flater, bewoog het impliciete oordeel nauwelijks, hoewel de expliciete beoordelingen nog steeds veranderden.

Waarom dit ertoe doet voor alledaags vertrouwen in AI

Gezamenlijk suggereren de bevindingen dat onze snelle, automatische indrukken van robotcompetentie niet blind zijn voor nieuwe informatie, maar dat ze sterkere of duidelijker betekenisvolle bewijzen eisen voordat ze veranderen. Onze mondelinge beoordelingen daarentegen reageren sterk zelfs op zwakke of dubbelzinnige gebeurtenissen, deels omdat we geneigd zijn elk stukje informatie te gebruiken wanneer ons om een oordeel wordt gevraagd. Voor ontwerpers, ingenieurs en beleidsmakers betekent dit dat het beheren van vertrouwen in robots niet alleen gaat over het verminderen van fouten, maar ook over hoe die fouten worden gekaderd en begrepen. Een enkele zwaarwegende fout — zoals een auto die niet stopt terwijl dat duidelijk nodig is — kan zowel ons onderbuikgevoel als onze uitgesproken mening herschikken, met directe gevolgen voor hoe bereid we zijn intelligente machines te accepteren en op hen te vertrouwen.

Bronvermelding: Surdel, N., Ferguson, M.J. The role of diagnosticity in judging robot competence. Sci Rep 16, 7578 (2026). https://doi.org/10.1038/s41598-026-35375-y

Trefwoorden: robotcompetentie, mens-robotinteractie, impliciete vooringenomenheid, vertrouwen in AI, diagnostische informatie