Clear Sky Science · nl

Verbeterde YOLOv11n voor detectie van kleine objecten in UAV-beelden: hogere nauwkeurigheid met minder parameters

Waarom het belangrijk is kleine dingen vanuit de lucht te zien

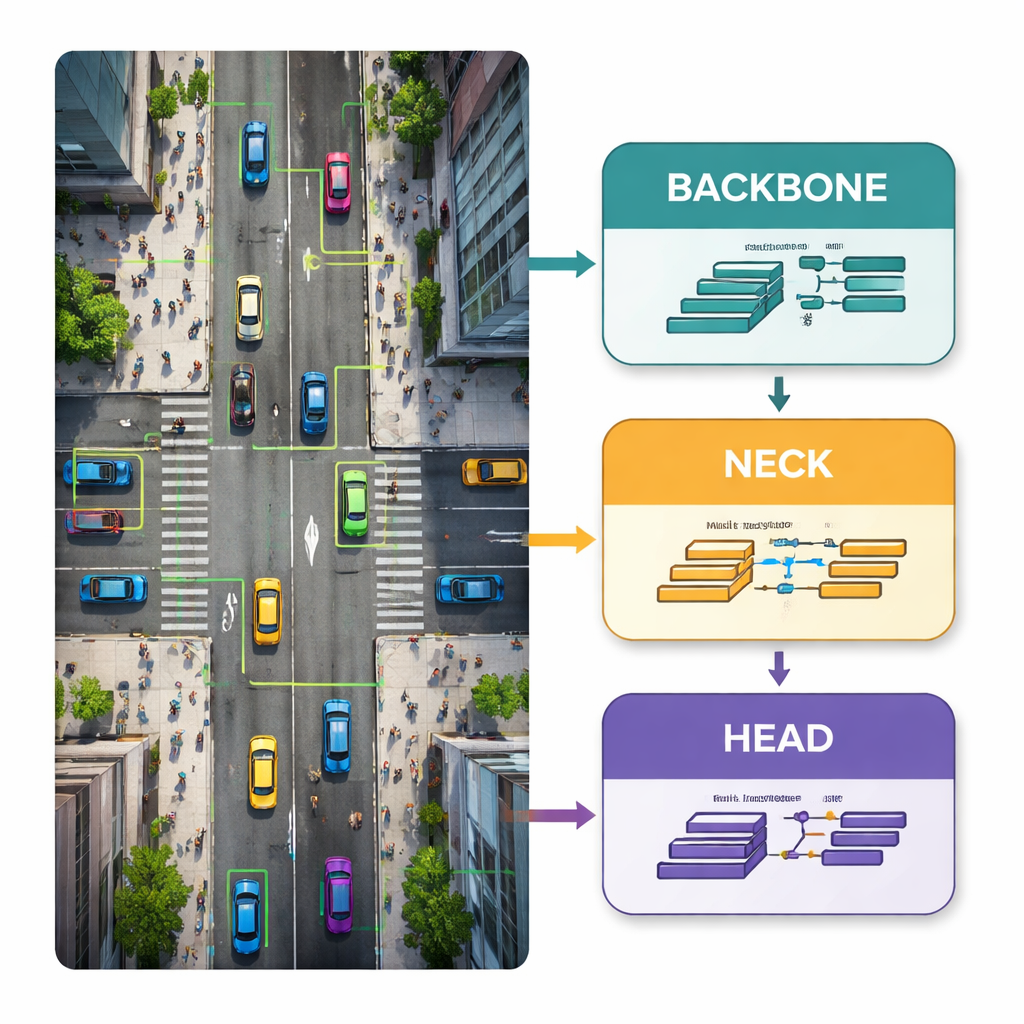

Kleine vliegende robots worden snel onderdeel van het dagelijks leven, van verkeersbewaking en noodhulp tot pakketbezorging. Er is echter een hardnekkig probleem: wanneer een drone van honderden meters hoogte naar beneden kijkt, krimpen mensen, auto’s en boten tot slechts een paar pixels. Standaard computervisie-systemen missen die stippen vaak of verwarren ze met achtergrondruis. Dit artikel presenteert een slimmere, compactere versie van een populair detectiesysteem, YOLOv11n, die speciaal is afgestemd op het vinden van deze kleine objecten in dronebeelden en toch efficiënt draait op lichte boordcomputers.

Meer zien in piepkleine, wazige details

Dronebeelden zijn een harde omgeving voor algoritmen. De meeste doelwitten zijn kleiner dan 32×32 pixels en veel zijn kleiner dan 16 pixels. Beweging, vibratie, veranderende belichting, nevel en drukke stedelijke achtergronden maken die kleine doelwitten nog moeilijker te onderscheiden. Tegelijk vertrouwen drones vaak op bescheiden processors en beperkte energie, waardoor zware modellen onpraktisch zijn. De auteurs vertrekken van YOLOv11n, een compact real-time detectiesysteem, en herontwerpen de interne componenten om meer bruikbare informatie uit kleine, laag-contrastgebieden te halen zonder het model op te blazen. Hun doel is eenvoudig maar veeleisend: aanzienlijk hogere nauwkeurigheid op kleine objecten, met evenveel of minder leerbare parameters en acceptabele snelheid op edge-hardware.

Leren van de scène op meerdere schalen

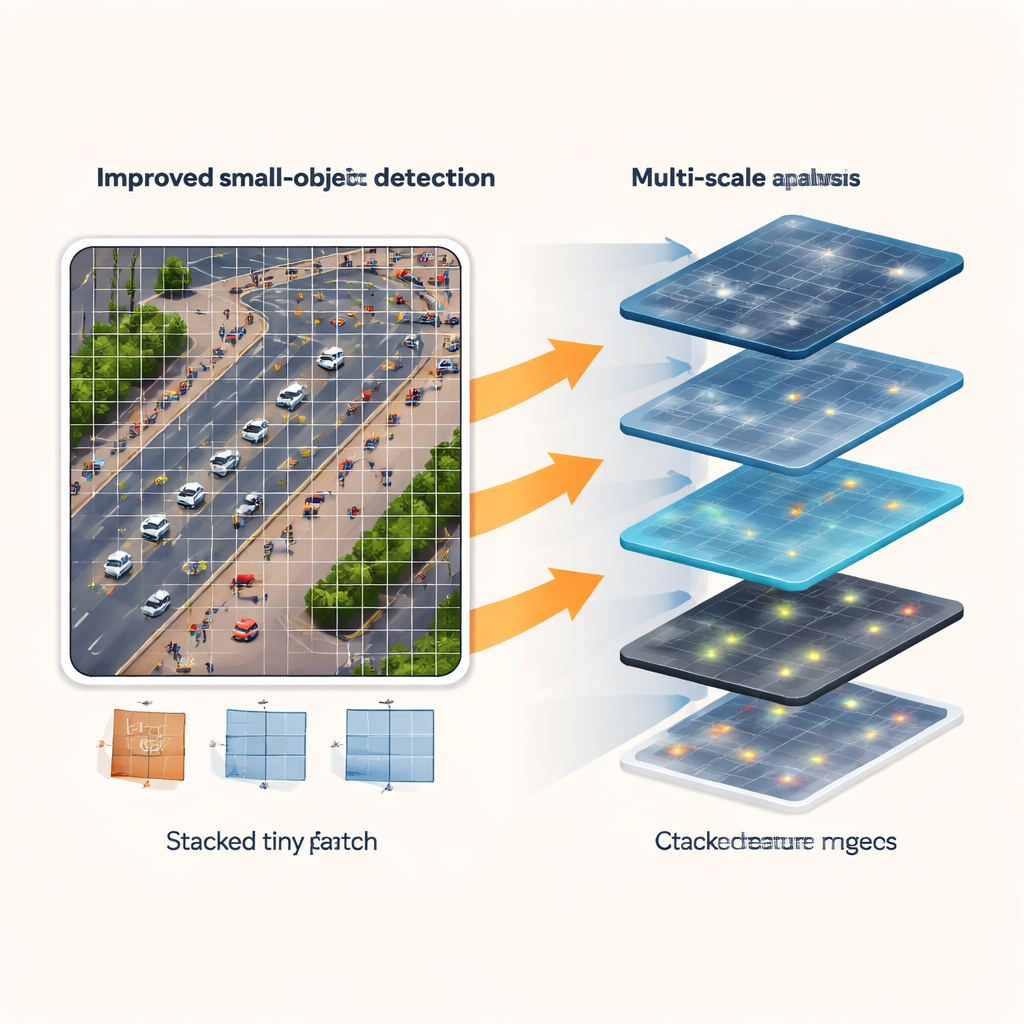

De eerste verbetering richt zich op hoe het netwerk de scène “ziet”. In plaats van door een enkel venster van vaste grootte te kijken, observeert de nieuwe Multiscale Edge-Feature Adaptive Selection (MSEAF)-module het beeld op meerdere schalen tegelijk. Grove aanzichten vangen de bredere opbouw van wegen, gebouwen en menigten, terwijl fijnere aanzichten individuele auto’s of mensen volgen. Een randversterkende stap legt de nadruk op grenzen en vormen die voor mensen gemakkelijk te zien zijn maar in piepkleine beeldpatches vaak wegvallen. Een slim fusie-mechanisme versterkt vervolgens de meest informatieve regio’s en onderdrukt achtergrondruis. Deze multischalige, randbewuste representatie geeft de rest van het netwerk een rijker startpunt om moeilijk waarneembare objecten te vinden.

Kleine objecten door de pijplijn heen levend houden

Traditionele YOLO-netwerken verkleinen herhaaldelijk featuremaps terwijl informatie van invoer naar uitvoer stroomt. Voor grote objecten is dat prima, maar voor piepkleine objecten kan het fataal zijn: na meerdere keren downsampling kan een voetganger nog maar één of twee pixels innemen in een interne map, of helemaal verdwijnen. Om dit te voorkomen, herschikken de auteurs het middelste “neck”-deel van het netwerk en voegen ze een nieuwe P2-detectiekop toe die op functies met hogere resolutie werkt. Aangepaste modules genaamd ScalCat en Scal3DC combineren nauwkeurig informatie uit verschillende lagen zodat fijne details uit ondiepe lagen en rijkere context uit diepere lagen elkaar versterken. Het resultaat is een detector die kleine auto’s en mensen over meerdere schalen bijhoudt, in plaats van ze op te offeren voor snelheid.

Scherpere beslissingen met minder knoppen

De laatste stap is het stroomlijnen van de predictiefase, bekend als de detection head. In het oorspronkelijke ontwerp waren diepere lagen met veel kanalen grotendeels toegewijd aan grote objecten, die relatief zeldzaam zijn in dronebeelden. De nieuwe Shared Re-parameterized Detection (SRepD)-kop egaliseert het aantal kanalen over schalen en gebruikt een slimme trainingstruc: tijdens het leren verkennen meerdere gespecialiseerde convolutietakken verschillende manieren om kenmerken te benadrukken; tijdens inferentie worden die takken wiskundig samengevoegd tot één enkele, eenvoudige convolutie. Dit gedeelde, opnieuw-geparameteriseerde ontwerp verbetert hoe goed kenmerken worden gefuseerd terwijl het daadwerkelijk het aantal parameters vermindert en de berekeningen beheersbaar houdt voor edge-apparaten.

Wat de cijfers zeggen in praktijktests

Het verbeterde model is getest op drie uitdagende openbare datasets: VisDrone2019 (gemengde stedelijke scènes), TinyPerson (uiterst kleine mensen over land en zee) en HazyDet (voertuigen in zware nevel gezien vanuit een drone). Op VisDrone2019 verhoogt het nieuwe ontwerp een belangrijke nauwkeurigheidsmaat (mAP50) en precisie met 4,6 procentpunt vergeleken met de originele YOLOv11n, terwijl het aantal parameters met ongeveer 8,5 procent wordt teruggebracht. Op TinyPerson zijn de verbeteringen nog groter—ongeveer 5,9 procentpunt in mAP50 en 5,6 in precisie—met een vergelijkbare verlaging van parameters, en het compacte model presteert zelfs beter dan een veel grotere YOLOv11s die vier keer zoveel parameters gebruikt. In wazige omstandigheden overstijgt de geüpgrade detector ook de baseline op nauwkeurigheid en robuustheidsmaten, en dat alles terwijl real-time snelheden worden gehandhaafd op een energiezuinige Huawei Atlas 200 DK edge-board.

Waarom dit belangrijk is voor dagelijks gebruik van drones

Voor niet-specialisten is de belangrijkste conclusie dat dit onderzoek laat zien dat drones zowel scherper kunnen zien als zuiniger met middelen kunnen omgaan. Door te heroverwegen waar en hoe het netwerk naar details zoekt, hoge-resolutie-informatie voor piepkleine doelwitten te behouden en de predictiemachines simpeler te maken, doorbreken de auteurs de gebruikelijke compromis tussen nauwkeurigheid en grootte. Het resulterende systeem is beter in het opsporen van kleine, verre mensen en voertuigen in drukke, nevelige of complexe scènes zonder zware hardware te vereisen. Dit soort vooruitgang brengt betrouwbare, real-time luchtmonitoring voor verkeersveiligheid, zoek‑ en reddingsoperaties en milieuobservatie dichter bij dagelijkse inzet.

Bronvermelding: Zhu, H., Xie, X. Enhanced YOLOv11n for small object detection in UAV imagery: higher accuracy with fewer parameters. Sci Rep 16, 5536 (2026). https://doi.org/10.1038/s41598-026-35301-2

Trefwoorden: objectdetectie met drones, herkenning van kleine objecten, YOLO neuronaal netwerk, analyse van luchtbeelden, edge-AI voor UAV's