Clear Sky Science · nl

Gefedereerde segmentatie van longnodules met een hybride transformer–U-Net architectuur

Waarom het opsporen van kleine vlekjes in de long belangrijk is

Longkanker is de dodelijkste kanker wereldwijd, maar de vroegste waarschuwingssignalen—kleine vlekjes die nodules worden genoemd op CT-scans—zijn gemakkelijk te missen. Radiologen moeten duizenden gedetailleerde beelden doorlopen, en het delen van patiëntgegevens tussen ziekenhuizen om slimmere computers te trainen wordt vaak geblokkeerd door strikte privacyregels. Deze studie introduceert een manier waarop ziekenhuizen kunnen samenwerken om een kunstmatig intelligentiesysteem (AI) te leren longnodules nauwkeurig te vinden, zonder ooit ruwe patiëntscans uit te wisselen.

Kennis delen zonder scans te delen

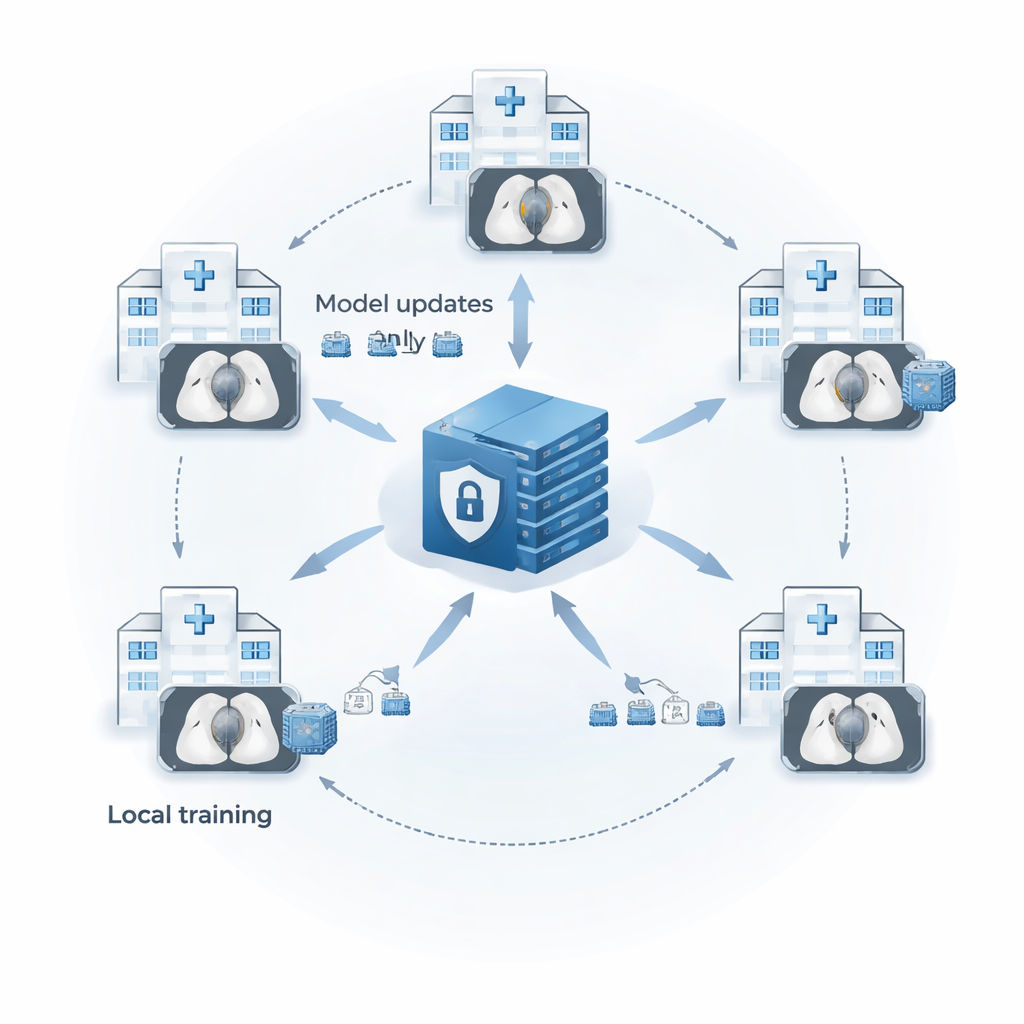

Moderne CT-scanners kunnen longdetails vastleggen tot fracties van een millimeter, maar die precisie creëert een stroom beelden die geen mens alleen kan beoordelen. Computerondersteunde hulpmiddelen kunnen helpen, maar ze hebben grote, diverse datasets nodig om te voorkomen dat ze ongebruikelijke nodules missen. Wetten zoals HIPAA en GDPR verbieden ziekenhuizen om patiëntgegevens eenvoudigweg op één plek te verzamelen. De auteurs gebruiken een strategie die federated learning heet om dit dilemma op te lossen. Elk ziekenhuis traint lokaal een kopie van hetzelfde model op zijn eigen CT-scans en stuurt daarna alleen de door het model geleerde parameters, niet de afbeeldingen zelf, naar een centrale server. De server gemiddeld deze parameters tot een verbeterd "globaal" model en stuurt dat terug, zodat alle locaties profiteren van elkaars ervaring terwijl patiëntgegevens in huis blijven.

De beelden opschonen vóórdat de AI leert

Het onderzoek richt zich op “solide” longnodules tussen 15 en 25 millimeter, die klinisch relevant zijn maar in elke CT-slice slechts een paar pixels innemen, waardoor ze gemakkelijk door computers over het hoofd gezien worden. Voordat er geleerd wordt, ondergaat elke CT-slice een tweeledige opschoningsprocedure. Ten eerste verheldert een contrastverbetermethode genaamd CLAHE zwakke nodules zonder ruis te versterken, waardoor subtiele vlekjes duidelijker naar voren komen. Ten tweede worden de beelden herschaald zodat alle pixelwaarden tussen 0 en 1 vallen, wat het model een consistente helderheidsschaal geeft over scans van verschillende apparaten en ziekenhuizen. Deze gestandaardiseerde preprocessing helpt de AI zich te richten op kleine, laag-contrast nodules in plaats van verward te raken door scannerafwijkingen.

Twee manieren van zien combineren: nabij detail en grootbeeldcontext

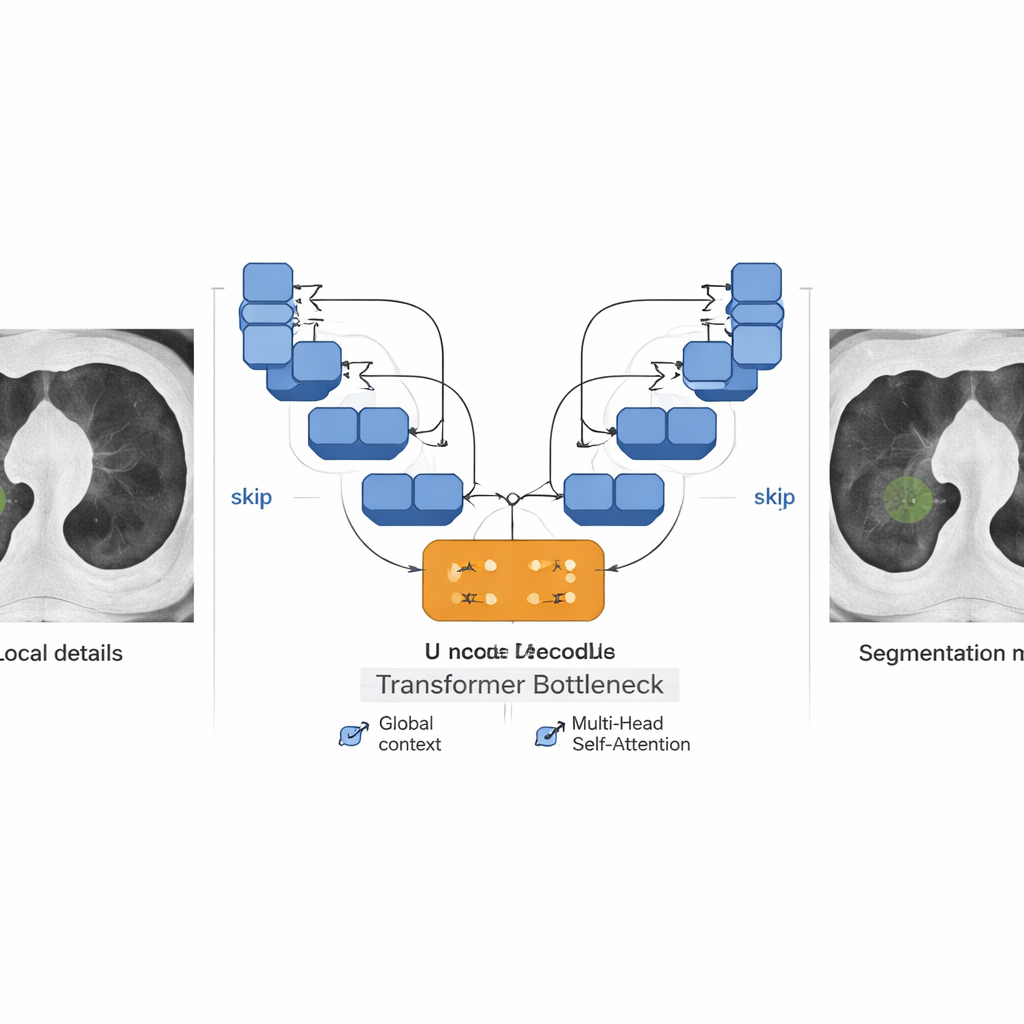

In het hart van het systeem staat een hybride netwerk dat twee krachtige ideeën uit moderne AI combineert: de U-Net, die uitblinkt in het markeren van objecten in beelden, en de Transformer, oorspronkelijk ontwikkeld voor taal maar nu veel gebruikt in vision-toepassingen. Het U-vormige deel van het model comprimeert eerst het beeld via lagen met kleine filters die goed zijn in lokale textuur—randen, korreltjes en fijne grenzen—en reconstrueert daarna een maskergrootte die aangeeft welke pixels bij een nodule horen. Residuele verbindingen en skip-links dragen fijne details door het netwerk zodat ze onderweg niet verloren gaan. In het midden van deze U-vorm bevindt zich een Transformer-"bottleneck" die beeldpatches behandelt als tokens in een zin, en met self-attention verre regio’s met elkaar verbindt. Dit stelt het model in staat zowel de kleine nodule als de bredere anatomische context te zien, wat cruciaal is wanneer nodules opgaan in nabije vaten of borststructuren.

Omgaan met zeldzame doelen en ongelijk verdeelde data

De auteurs pakken ook een groot probleem in medische beeldvorming aan: klasse-ongelijkheid. In long-CT is bijna elke pixel achtergrond; nodule-pixels zijn zeldzaam. Standaardtraining beloont modellen ertoe geneigd alles als achtergrond te labelen. Om dit tegen te gaan, combineert het team twee lossfuncties—Dice-loss, die overlap tussen voorspelde en echte nodules rechtstreeks beloont, en Focal-loss, die extra nadruk legt op moeilijk te classificeren pixels. Deze Dice–Focal mix moedigt het model aan aandacht te besteden aan kleine, moeilijk te detecteren nodules en precieze grenzen. In hun gefedereerde opzet met vijf gesimuleerde ziekenhuis-"clients" getraind op de openbare LUNA16-dataset behaalde het systeem Dice-scores tot 0,93 voor solide nodules en toonde het lage percentages gemiste nodules en valse alarmen. De prestatie bleef sterk bij de meeste clients ondanks verschillen in beeldkwaliteit en nodule-verschijning, hoewel nodules met vage of gemengde dichtheden uitdagend bleven.

Wat dit betekent voor toekomstige longscreening

Kort gezegd laat dit werk zien dat ziekenhuizen gezamenlijk een hoogwaardige AI voor nodule-detectie kunnen trainen zonder ooit patiëntscans over het netwerk te verzenden. Door zorgvuldige beeldopschoning, een model dat zowel details als context ziet, en een trainingsstrategie die is afgestemd op zeldzame doelen te combineren, maakt het raamwerk betrouwbare contouren van solide longnodules in een realistische multiziekenhuisomgeving. Hoewel er meer werk nodig is om zeer vage of deels solide nodules aan te pakken, wijst de studie op longkankerscreeningtools die zowel nauwkeurig als privacybewarend zijn—waardoor de voordelen van big-data AI naar patiënten worden gebracht zonder de vertrouwelijkheid van hun medische beelden in gevaar te brengen.

Bronvermelding: Turjya, S.M., Fawakherji, M. Federated lung nodule segmentation using a hybrid transformer–U-Net architecture. Sci Rep 16, 5228 (2026). https://doi.org/10.1038/s41598-026-35243-9

Trefwoorden: longkanker screening, medische beeldsegmentatie, federated learning, CT longnodules, privacybewarende AI