Clear Sky Science · nl

Beoordeling van door machine learning verkregen kerngegevensnauwkeurigheid in volledige kernreactor Monte Carlo-neutronicaberekeningen en efficiëntieanalyse van berekeningen

Waarom snellere reactorsimulaties ertoe doen

Kerncentrales vertrouwen op gedetailleerde computermodellen om te voorspellen hoe brandstof zich gedraagt over maanden en jaren van bedrijf. Deze modellen zijn cruciaal voor veiligheid, efficiëntie en het ontwerp van nieuwe reactoren, maar ze zijn berucht traag en geheugenintensief. Dit artikel onderzoekt of machine learning de enorme kerngegeventabellen die deze simulaties aandrijven kan verkleinen — waardoor de rekencost aanzienlijk daalt — zonder de fysieke nauwkeurigheid waarop ingenieurs vertrouwen op te offeren.

Het verkleinen van de gegevens achter de fysica

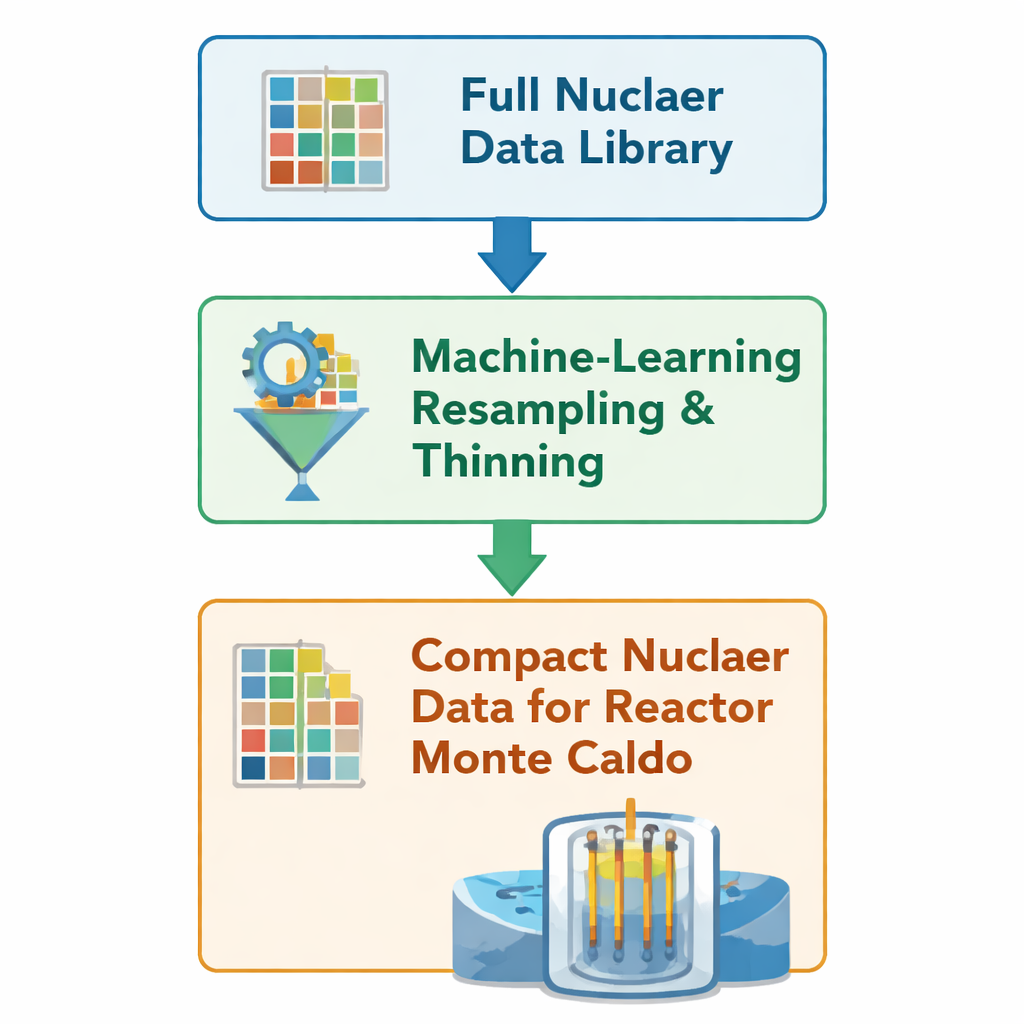

Elke keer dat een gesimuleerd neutron door een virtuele reactorkern beweegt, raadpleegt de code grote tabellen die beschrijven hoe waarschijnlijk het is dat het neutron verstrooit, geabsorbeerd wordt of een atoom splitst. Deze tabellen, kerngegevensbibliotheken genoemd, coderen waarschijnlijkheden over duizenden energiepunten voor vele isotopen in de brandstof en haar bijproducten. De auteurs bouwen voort op een eerdere machine-learningmethode die die tabellen 'verdunt': ze verwijdert redundante energiepunten terwijl scherpe kenmerken zoals reactiedrempels en resonantiepieken, waar waarschijnlijkheden snel veranderen, behouden blijven. In plaats van de gegevens opnieuw te genereren via een lange, traditionele verwerking, bewerkt de methode OpenMC’s native HDF5-bestanden direct en behoudt slechts ongeveer 10–50% van de oorspronkelijke gridpunten voor 23 bijzonder belangrijke nucliden.

De idee testen in volledige reactorkernen

Om te beoordelen of deze compactere gegevens in realistische omstandigheden nog betrouwbare resultaten opleveren, voert het team jaarlijkse simulaties uit van twee grote drukwaterreactoren: een European Pressurized Reactor (EPR) en een VVER‑1000, met de open-source Monte Carlo-code OpenMC. Voor elke kern voeren ze twee anders identieke campagnes uit: één met de volledige kerngegevensbibliotheek en één met de door machine verdunde versie. Alle geometrie-, bedrijfs- en numerieke instellingen blijven vast; alleen de tabellen met gegevens achter de fysica verschillen. Ze schakelen andere versnellingstechnieken in OpenMC uit zodat elke verandering in snelheid of geheugen direct kan worden toegeschreven aan de verminderde gegevens en niet aan wijzigingen in algoritmen of instellingen.

Snelheidswinst met strakke foutgrenzen

De winst is aanzienlijk. Voor de EPR‑case daalt de totale wandkloktijd met ongeveer 18%, en voor de VVER‑1000 krimpt de uitvoeringstijd met ruwweg 43%. Het geheugenverbruik verandert bescheidener: het piekgebruik daalt met ongeveer 4% in de EPR en stijgt met ongeveer 5% in de VVER‑1000, wat verschillen weerspiegelt in hoeveel tijd elk model besteedt aan het opzoeken van kerngegevens versus het volgen van de deeltjesbanen door de geometrie. Cruciaal is dat de belangrijkste kernniveau‑maten zeer dicht bij de oorspronkelijke waarden blijven. Over een volledig jaar in de VVER‑1000 wijkt de effectieve vermenigvuldigingsfactor — in wezen hoeveel neutronen elke splijting gemiddeld produceert — nooit meer af dan ongeveer 100 delen per miljoen, en doorgaans slechts enkele tientallen delen per miljoen. Voor sleutelreactiekanalen zoals splijting in uranium‑235 en uranium‑238 en neutronenvangst in xenon‑135 en samarium‑149 blijven de gemiddelde verschillen ruim onder een tiende procent.

Brandstofontwikkeling en vergifstoffen blijven op koers

Aangezien het langetermijngedrag van een reactor niet alleen afhangt van onmiddellijke reacties maar ook van hoe brandstof en splijtingsproducten zich opbouwen en opbranden, volgen de auteurs ook de veranderende voorraden van belangrijke isotopen. Ze bekijken de hoofd‑uraniumisotopen, een reeks plutoniumisotopen gefokt uit uranium‑238, en sterke 'vergif'nucliden die neutronen absorberen, vooral xenon‑135 en samarium‑149. Zelfs na een volledig jaar zijn de verschillen in deze voorraden tussen de volledige en gereduceerde gegevensgevallen klein: van de orde van enkele honderdsten van een procent voor xenon en samarium, en over het algemeen onder een tiende procent voor de plutoniumsoorten. Uranium‑235 en uranium‑238, die de energieproductie en neutronicabalans van de kern domineren, worden gereproduceerd tot veel fijner dan een honderdste procent. Waar relatieve fouten kortstondig meer dan één procent overschrijden voor sommige plutoniumisotopen, gebeurt dat vroeg in de cyclus wanneer hun absolute hoeveelheden nog extreem klein zijn, zodat het praktische effect op het reactor gedrag verwaarloosbaar is.

Wat dit betekent voor toekomstig reactormodelleren

Voor niet‑specialisten is de kernboodschap dat een zorgvuldig getrainde machine‑learningprocedure de nucleaire 'opzoektabellen' in geavanceerde reactorsimulaties drastisch kleiner en sneller in gebruik kan maken, terwijl het gesimuleerde reactorgedrag bijna ononderscheidbaar blijft van de traditionele aanpak. De studie toont dit aan voor twee industriële reactorkernen over een volledig jaar bedrijf, met foutmarges die klein zijn vergeleken met andere typische onzekerheden in reactoranalyse. De auteurs benadrukken dat hun conclusies momenteel gelden voor stationaire drukwaterreactoren met een specifieke gegevensbibliotheek en code-instellingen, en dat meer werk nodig is om andere reactortypen en transiënte condities te testen. Toch wijzen de resultaten op een veelbelovende weg naar snellere, efficiëntere high‑fidelity kernsimulaties, waardoor meer ontwerponderzoeken en veiligheidsanalyses mogelijk worden met beperkte rekenmiddelen.

Bronvermelding: Hashemi, A., Macián-Juan, R. & Ohlerich, M. Evaluating machine learned nuclear data precision in full core nuclear reactor Monte Carlo neutronics and computational efficiency analyses. Sci Rep 16, 1314 (2026). https://doi.org/10.1038/s41598-026-35227-9

Trefwoorden: simulatie van kernreactoren, machine learning, Monte Carlo-neutronica, kerngegevensbibliotheken, drukwaterreactoren