Clear Sky Science · nl

Aandachtsverbeterde MobileNetV2-modellen voor robuuste detectie en classificatie van bosbranden

Waarom snellere brandmeldingen ertoe doen

Wereldwijd worden bosbranden heter, groter en duurder om te bestrijden. Minuten kunnen het verschil betekenen tussen een kleine, beheersbare vlam en een regionale ramp die ecosystemen beschadigt, steden met rook vervult en miljarden dollars kost. Deze studie onderzoekt hoe compacte kunstmatige-intelligentiemodellen de allereerste tekenen van bosbranden in gewone beelden en video kunnen herkennen, snel genoeg om te draaien op drones, beveiligingscamera’s en energiezuinige sensoren verspreid over kwetsbare landschappen.

De bossen in de gaten houden met slimme camera’s

Traditionele brandwachttorens en menselijke operators die live videobeelden scannen hebben moeite om uitgestrekte bosgebieden bij te houden, zeker ’s nachts of bij rook en nevel. De auteurs pakken dit probleem aan door bosbranddetectie terug te brengen tot een eenvoudige ja-of-nee-vraag: bevat deze afbeelding vuur of niet? Ze stellen een evenwichtige verzameling samen van 5.121 foto’s met zowel brand- als niet-brandtaferelen, afkomstig uit bossen, steden en industriële locaties, en vastgelegd bij daglicht, ’s nachts en door rook of mist heen. Door de dataset zorgvuldig te balanceren en labels handmatig te controleren, willen ze AI-systemen leren hoe echte vlammen in het veld eruitzien, en niet alleen in ideale labvoorbeelden.

Slanke AI gebouwd voor het veld

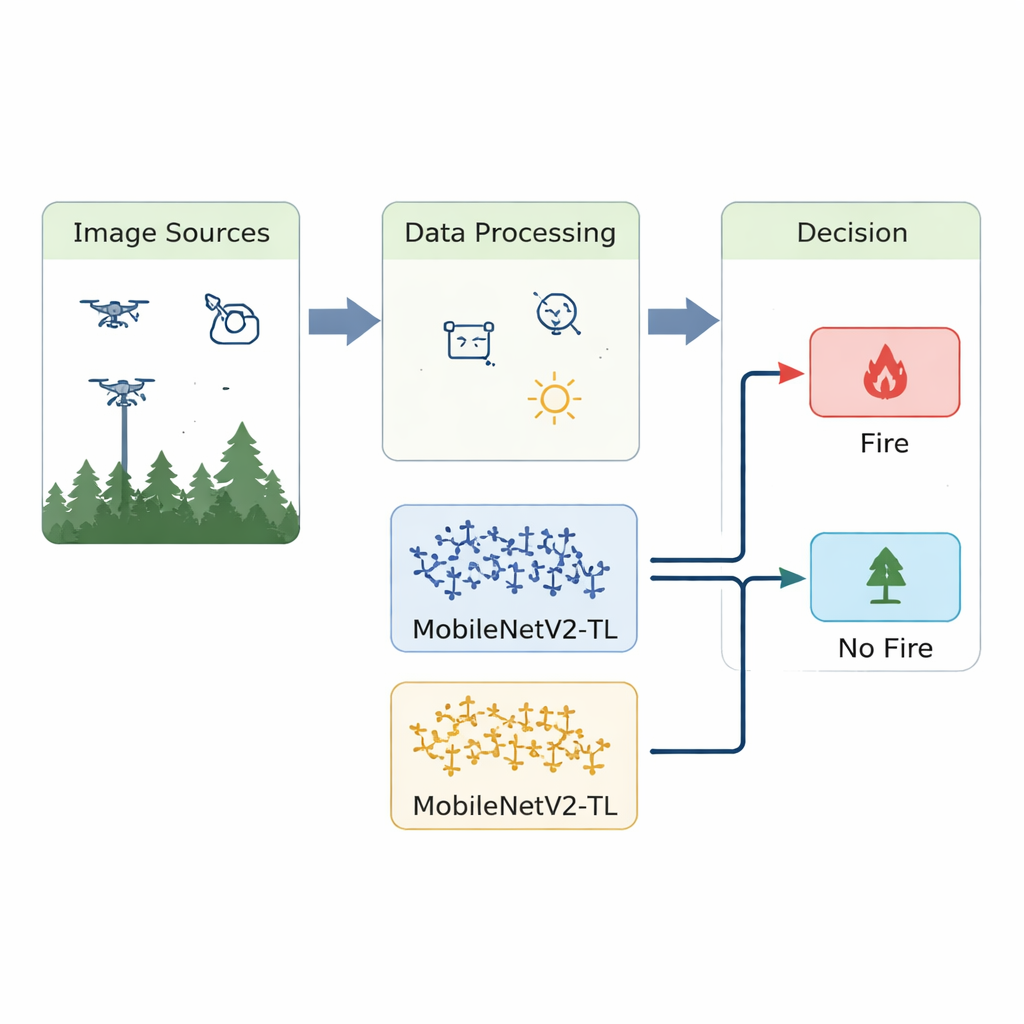

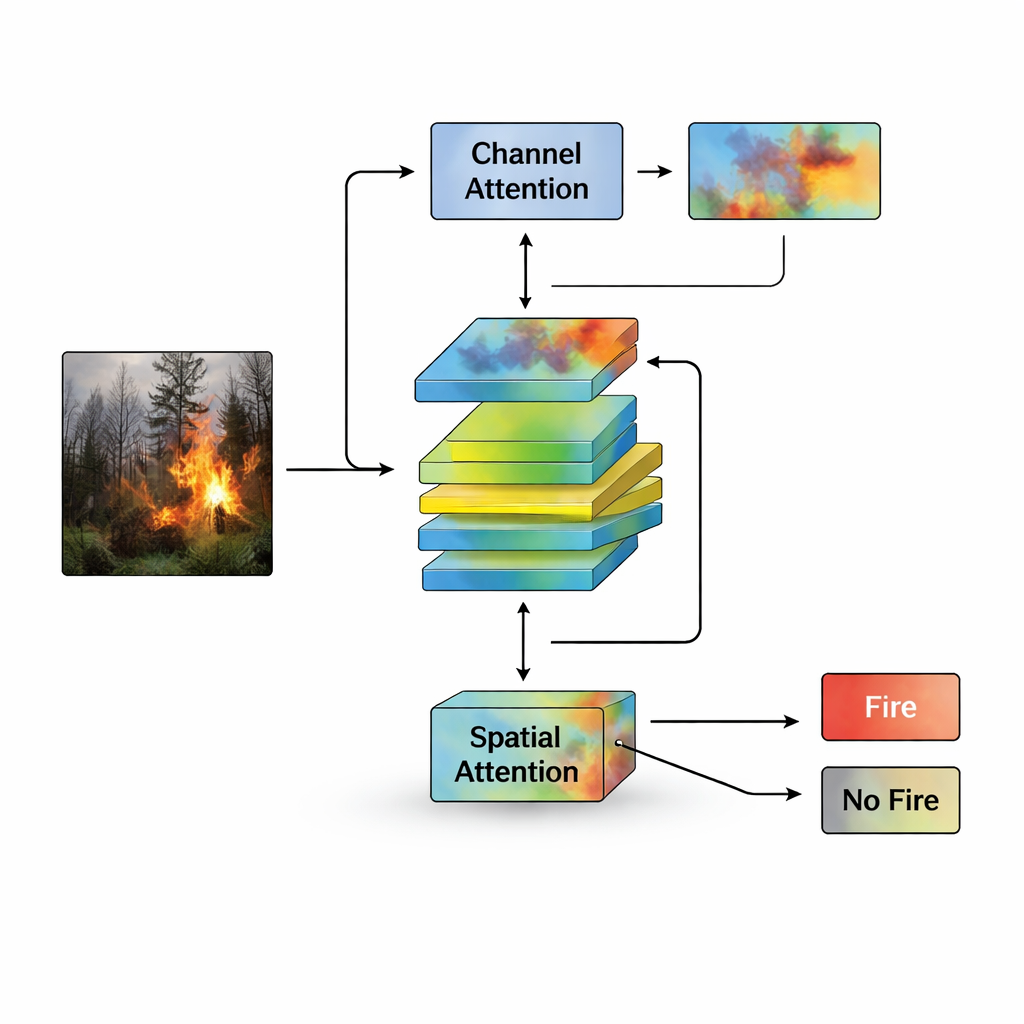

Veel krachtige beeldherkenningssystemen zijn te zwaar om te draaien op de kleine computers in drones of goedkope bewakingscamera’s. Om dat probleem te vermijden bouwt de studie voort op MobileNetV2, een reeks neurale netwerken die ontworpen zijn om snel te zijn en zuinig met geheugen om te gaan. Het eerste model, Att-MobileNetV2, voegt een "attention"-mechanisme toe dat het netwerk helpt te concentreren op kenmerkende vlamkleuren, texturen en randen, terwijl rommel zoals door de zon verlichte wolken of felle gebouwverlichting wordt genegeerd. Het tweede model, MobileNetV2-TL, leunt op transfer learning: het hergebruikt visuele vaardigheden geleerd uit miljoenen algemene foto’s en traint alleen een klein, taak-specifiek hoofd voor brand versus geen brand, waardoor verwerkings- en energiegebruik laag blijven.

Trainingsmethoden voor lastige echte-wereldcondities

Om de rommelige omstandigheden van echte brandmonitoring na te bootsen doen de onderzoekers meer dan alleen gevarieerde beelden verzamelen. Ze passen ook gecontroleerde aanpassingen toe op elke trainingsfoto—zoals kleine rotaties, spiegelen en veranderingen in helderheid of contrast—om verschillende cameraposities en belichting te simuleren. Beide modellen worden vervolgens getraind en geëvalueerd onder dezelfde regels, met standaardmaatstaven zoals nauwkeurigheid, precisie en recall, en door te controleren hoe vaak ze branden missen of valse alarmen geven. Att-MobileNetV2 bereikt een nauwkeurigheid van ongeveer 99,6%, terwijl MobileNetV2-TL ongeveer 98,4% haalt. Cruciaal is dat deze resultaten worden behaald met slechts een paar miljoen parameters en een fractie van een miljard bewerkingen per afbeelding, waardoor beslissingen in slechts 10–12 milliseconden op een enkele grafische processor mogelijk zijn.

Beter presteren dan grotere systemen met minder middelen

De twee compacte modellen worden vergeleken met zowel klassieke machine-learningmethoden als complexere diepe netwerken. Onder identieke trainings- en testomstandigheden biedt Att-MobileNetV2 de beste algehele balans tussen correcte branddetecties en correcte "veilig"-beslissingen, terwijl MobileNetV2-TL bijzonder hoge recall behaalt, wat betekent dat het zelden echte branden over het hoofd ziet—een belangrijke eigenschap voor vroegwaarschuwingssystemen. Een ensemble dat beide modellen combineert presteert zelfs iets beter, wat suggereert dat de manieren waarop ze een scène "zien" elkaar aanvullen. Tests op een onafhankelijke openbare dataset laten zien dat de modellen sterke prestaties behouden op nieuwe beelden, wat aangeeft dat ze generaliseren buiten de specifieke foto’s waarop ze getraind zijn.

Wat dit betekent voor toekomstige brandveiligheid

Simpel gezegd laat dit werk zien dat kleine, efficiënte AI-modellen bosbranden vroeg en betrouwbaar kunnen detecteren, zelfs wanneer ze draaien op bescheiden hardware gemonteerd op drones, torens of wegkantsensoren. Door aandacht te gebruiken om zich op de juiste delen van een afbeelding te richten en transfer learning om eerdere visuele kennis te hergebruiken, bereiken de voorgestelde systemen nauwkeurigheid die kan wedijveren met of zwaardere modellen overtreft. Hoewel uitdagingen blijven in de dikste mist, wijst de aanpak op netwerken van slimme, betaalbare sensoren die sneller alarm kunnen slaan, zodat brandweerlieden sneller kunnen reageren en kleine vonken mogelijk geen catastrofale bosbranden worden.

Bronvermelding: Ul Haq, I., Husnain, G., Iqbal, A. et al. Attention-enhanced MobileNetV2 models for robust forest fire detection and classification. Sci Rep 16, 4805 (2026). https://doi.org/10.1038/s41598-026-35207-z

Trefwoorden: detectie van bosbranden, monitoring van wildbranden, diep leren, edge-AI, computervisie