Clear Sky Science · nl

Efficiënte detectie van door AI gegenereerde wetenschappelijke abstracts met een lichtgewicht transformer

Waarom het belangrijk is AI-geschreven wetenschap te herkennen

Naarmate kunstmatige intelligentie beter wordt in schrijven, kan ze nu wetenschappelijke samenvattingen opstellen die bijna niet te onderscheiden zijn van door mensen geschreven teksten. Dat roept lastige vragen op: hoe kunnen tijdschriften, universiteiten en lezers er zeker van zijn dat een onderzoeksabstract echt het werk van een wetenschapper weerspiegelt en geen uitvinding van een machine? Dit artikel pakt dat probleem aan door een snelle, compacte tool te bouwen die met zeer hoge betrouwbaarheid AI-geschreven wetenschappelijke abstracts kan signaleren, en zo een praktisch middel biedt ter verdediging van academische integriteit.

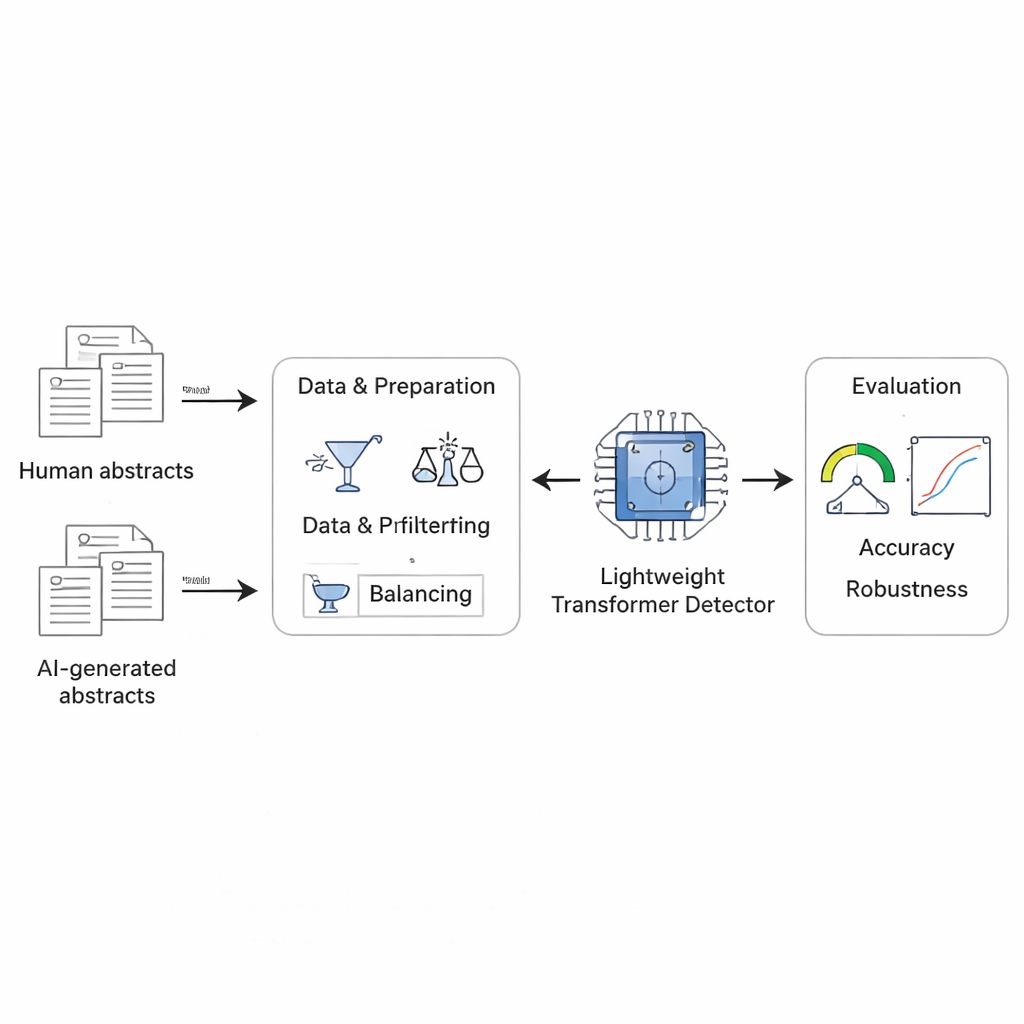

Een testset van echte en synthetische abstracts opbouwen

Om AI-tekstdetectie te meten en te verbeteren, hadden de auteurs eerst betrouwbare data nodig. Ze verzamelden 5.000 wetenschappelijke abstracts van de online preprintserver arXiv, verdeeld over vijf vakgebieden: computer vision, signaalverwerking, kwantitatieve biologie, natuurkunde en andere onderwerpen binnen computerwetenschappen. Voor elk door een mens geschreven abstract gebruikten ze een groot taalmodel om een AI-versie te genereren op basis van de titel van het artikel, waarbij ze zorgvuldig controleerden op bijna-duplicaten en duidelijke aanwijzingen zoals webadressen of codefragmenten verwijderden. Ze zorgden er ook voor dat AI- en menselijke teksten vergelijkbare lengtes hadden, zodat de detector zich niet kon baseren op grove statistieken zoals woordenaantal.

Een compact model afgestemd op de praktijk

In plaats van een groot en duur AI-model te gebruiken, kozen de onderzoekers voor een kleiner systeem dat bekendstaat als DistilBERT, een gestroomlijnde versie van een populair taalmodel. Ze finetuneden het om voor elk abstract te bepalen of het door een persoon was geschreven of door AI gegenereerd. Het model leest tot 256 tokens—ongeveer een paar alinea’s—en geeft een score tussen nul en één, geïnterpreteerd als de kans dat de tekst door een machine is geproduceerd. Training en evaluatie volgden een strikt protocol: de data werd verdeeld in trainings-, validatie- en testsets zonder overlap, en het team rapporteerde niet alleen de nauwkeurigheid maar ook hoe het model presteert wanneer het toegestane vals-alarmpercentage zeer laag gehouden wordt, een regime dat belangrijk is wanneer echte auteurs van AI-gebruik worden verdacht.

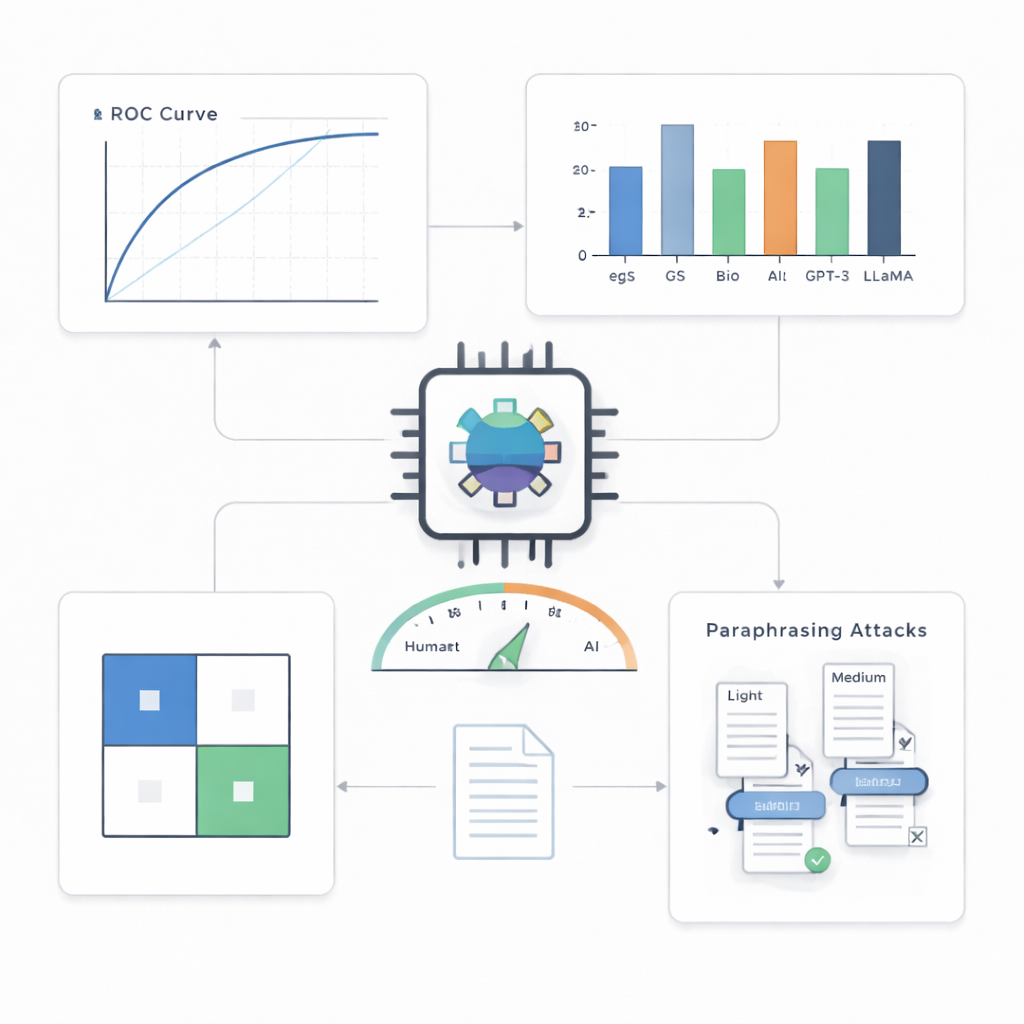

Hoe goed de detector presteert

Op abstracts uit computer vision, de belangrijkste testset, was de detector opmerkelijk nauwkeurig. Hij labelde correct 499 van de 500 AI-gegenereerde teksten en 495 van de 500 menselijke teksten, wat neerkomt op ongeveer 99,4% nauwkeurigheid en vrijwel perfecte scores op een standaard prestatiecurve. Toen de auteurs het systeem dwongen om hooguit één valse beschuldiging per honderd gevallen te maken, ving het nog steeds circa 90% van de AI-teksten; met een iets hogere tolerantie van vijf valse alarmen per honderd, ving het ongeveer 97%. In vergelijking met een reeks alternatieven—waaronder eenvoudigere statistische hulpmiddelen en andere transformermodellen—ging de compacte detector consequent als winnaar uit de bus, vooral in zwaardere scenario’s.

Voorbij één vakgebied, één model en simpele trucjes

Een belangrijke vraag is of zo’n detector om kan gaan met schrijfstijlen en AI-systemen die hij nog nooit heeft gezien. De auteurs testten hem op abstracts uit andere wetenschappelijke velden en op teksten die door verschillende geavanceerde taalmodellen waren geschreven. Over domeinen heen bleef de prestatie sterk, met slechts bescheiden dalingen, wat suggereert dat het systeem algemene patronen van AI-schrijven opvangt in plaats van eigenaardigheden van één onderwerp. Tegen niet eerder geziene AI-modellen presteerde het ook goed, zij het minder perfect dan in de thuissituatie. De zwaarste uitdaging kwam van parafraseeraanvallen: wanneer een andere AI machinegegenereerde abstracts herschreef om anders te klinken terwijl de betekenis behouden bleef, werd detectie merkbaar moeilijker. Bij herschrijving van gemiddelde sterkte steeg het aandeel AI-teksten dat ontsnapte tot bijna 30%, wat laat zien dat zelfs geavanceerde detectors te misleiden zijn door opzettelijke verhullingen.

Wat dit betekent voor de wetenschap en haar waarborgen

De studie toont aan dat AI-geschreven wetenschappelijke abstracts voorlopig nog subtiele sporen achterlaten die een goed ontworpen model kan oppikken, zelfs wanneer dat model klein genoeg is om op bescheiden hardware te draaien. Dit maakt het haalbaar voor uitgevers, conferenties en universiteiten om grote aantallen inzendingen te screenen zonder enorme rekenkosten. Tegelijkertijd benadrukt de kwetsbaarheid voor parafrasering dat zulke hulpmiddelen geen wondermiddel zijn. De auteurs betogen dat AI-tekstdetectie gecombineerd moet worden met andere waarborgen—zoals redactioneel oordeel, plagiaatcontroles en transparantievereisten—om de betrouwbaarheid van wetenschappelijke communicatie te beschermen nu AI-systemen blijven verbeteren.

Bronvermelding: Zhang, C., Zhou, W. Efficient detection of AI-generated scientific abstracts with a lightweight transformer. Sci Rep 16, 4975 (2026). https://doi.org/10.1038/s41598-026-35203-3

Trefwoorden: AI-tekstdetectie, wetenschappelijke abstracts, academische integriteit, grote taalmodellen, door machines gegenereerde tekst