Clear Sky Science · nl

Een nauwkeurige realtime onderwaterobjectsegmentatie met verbeterde dual‑domain YOLOv11‑UOS en fysica‑gestuurde adaptieve verbetering en aandachtversterking

Dieper duiken met scherpere digitale ogen

Onze oceanen worden steeds vaker verkend niet alleen door duikers en onderzeeërs, maar door slimme camera's op onderwaterrobots. Deze camera's helpen bij het zoeken naar scheepswrakken, het inspecteren van offshore pijpleidingen en het monitoren van koraalriffen en vispopulaties. Toch zijn onderwaterfoto's vaak troebel, blauw‑groen en vol visuele rommel, waardoor het moeilijk is voor mensen — laat staan computers — om objecten te onderscheiden. Dit artikel introduceert een nieuw computer‑visiesysteem dat onderwaterbeelden opknapt en vervolgens objecten in die beelden snel opspoort en omlijnt, snel genoeg om realtime robotmissies te sturen.

Waarom onder water zien zo moeilijk is

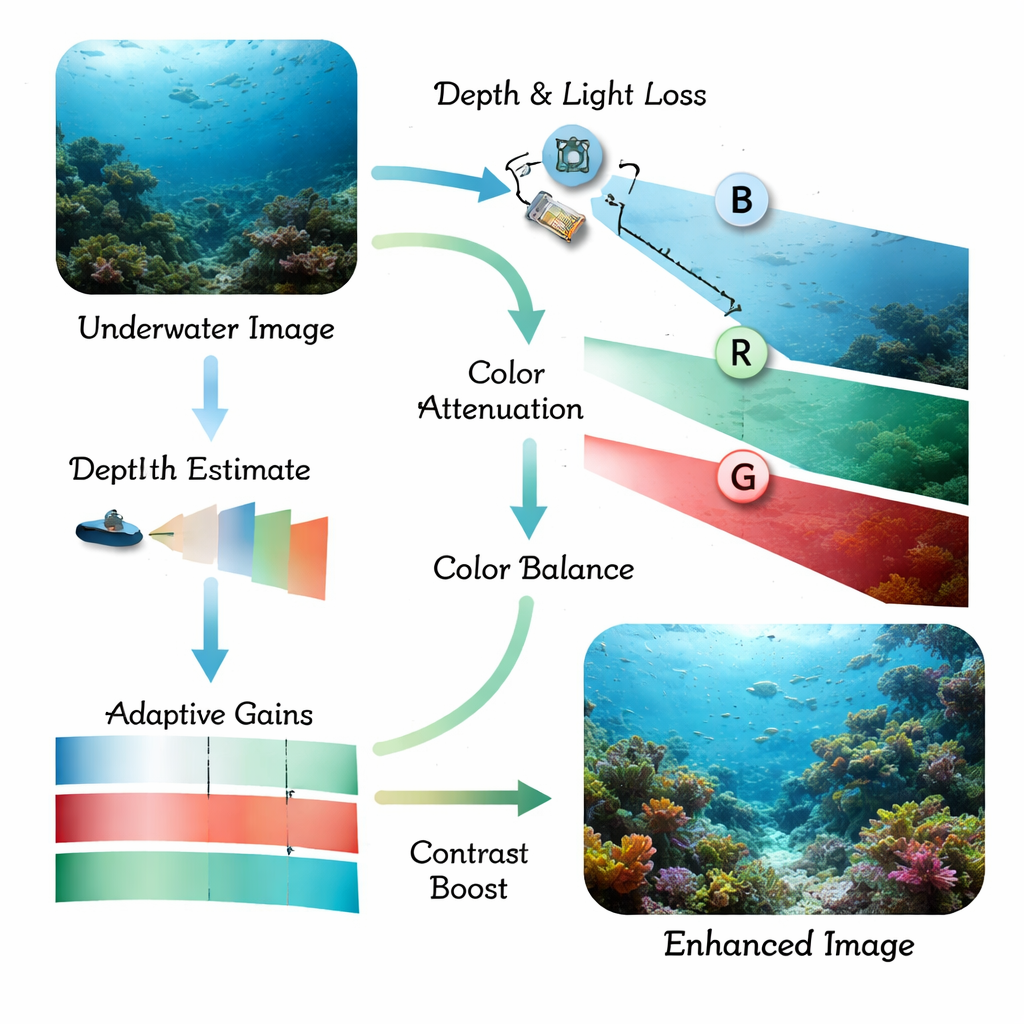

Licht gedraagt zich heel anders in water dan in lucht. Terwijl zonlicht naar beneden reist verdwijnen eerst de rode tonen, daarna de groenen, wat een blauwig kleurzweem en doffe, laagcontrastscènes achterlaat. Fijne deeltjes in het water verstrooien licht, waardoor nevel ontstaat die randen vervaagt en kleine details verbergt. Traditionele objectdetectieprogramma's, en zelfs moderne deep‑learningmodellen, hebben moeite met deze vervormde beelden: vissen vallen samen met koraal, kunstmatige constructies verdwijnen in de achtergrond en scènes met weinig licht worden bijna onleesbaar. Eerder onderzoek pakte meestal ofwel beeldherstel ofwel objectdetectie aan, wat vaak resulteerde in systemen die te traag, te fragiel of nog steeds blind waren in bijzonder troebel water.

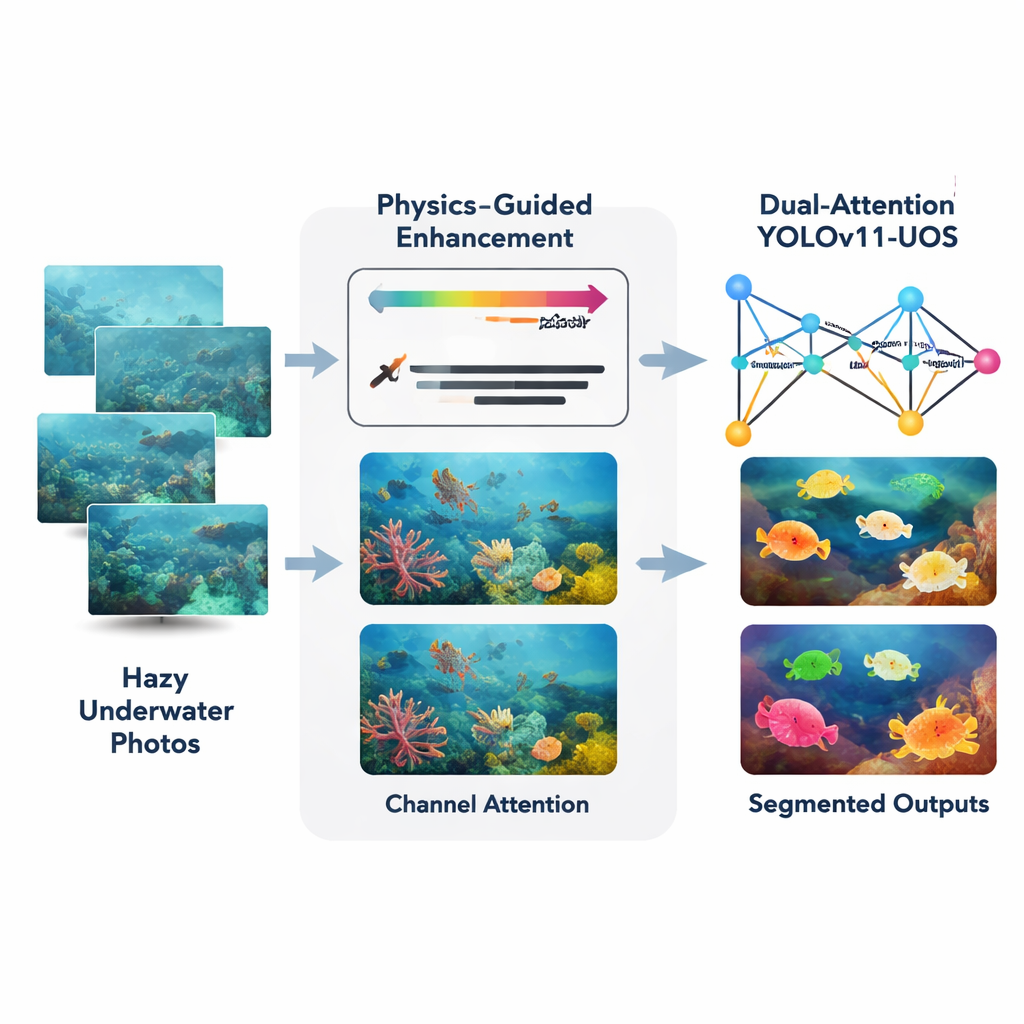

Een tweestapsstrategie: eerst reinigen, dan focussen

De auteurs stellen een gecombineerde aanpak voor rond een recente realtime detector genaamd YOLOv11, hier aangepast voor onderwaterscènes en instance‑segmentatie (het nauwkeurig omlijnen van elk object). Eerst neemt een voorste module genaamd Adaptieve Fysica‑Gestuurde Verbetering ruwe onderwaterfoto's en corrigeert ze met een vereenvoudigd fysisch model van hoe licht in water wordt geabsorbeerd en verstrooid. De module schat de afstand van elk deel van de scène tot de camera in en compenseert vervolgens voor het sterkere verlies van rood licht vergeleken met groen en blauw. Dit herstelt meer natuurlijke kleuren en verhoogt het lokale contrast, terwijl een zorgvuldige histogramgebaseerde stap randen verscherpt zonder ruis te versterken, zelfs in donkere of troebele gebieden.

Het netwerk leren waar het moet kijken

Zodra het beeld is opgeknapt, wordt het doorgegeven aan een verbeterde YOLOv11‑backbone die is uitgerust met aandachtmechanismen. Deze toegevoegde modules werken een beetje als een spotlicht en een kleurfilter. Ruimtelijke aandacht vertelt het netwerk om meer aandacht te schenken aan belangrijke regio's — zoals de omtrek van een vis of de rand van een ondergedoken artefact — en afleidende achtergrond zoals zand of wiegende planten te negeren. Kanaalaandacht past aan hoe sterk het systeem verschillende kleur‑ en textuurpatronen weegt, zodat bruikbare visuele aanwijzingen worden benadrukt terwijl irrelevante worden gedempt. Gezamenlijk helpen deze dubbele aandachtsstadia het netwerk scherpere interne representaties op te bouwen voordat het besluit waar objecten zich bevinden en wat ze zijn.

Testen op echte oceanen en moeilijke omstandigheden

Om te beoordelen hoe goed het systeem in de praktijk werkt, trainden en testten de onderzoekers het op meerdere openbare onderwaterbeeldverzamelingen plus een nieuw, eigen dataset van meer dan 7.000 zorgvuldig gelabelde foto's uit kustwateren met variërende diepte en troebelheid. Ze maten standaard detectie‑ en segmentatiescores en vergeleken hun methode met veelgebruikte modellen zoals U‑Net, DeepLab, transformer‑gebaseerde segmenters en een baseline YOLOv11‑systeem zonder de nieuwe modules. Het gecombineerde ontwerp van verbetering plus aandacht verbeterde de gemiddelde detectienauwkeurigheid met ongeveer 6,5 procentpunt ten opzichte van de baseline YOLOv11, met merkbaar schonere objectomtrekken en minder gemiste of valse detecties. Belangrijk is dat het systeem nog steeds rond de 38 frames per seconde draait op een moderne grafische processor, snel genoeg voor bijna realtime gebruik op robotplatformen.

Wat dit betekent voor oceanrobots en onderzoek

In klare termen laat de studie zien dat slimme preprocessen en gerichte aandacht computers veel beter laten "zien" onder water. Door eerst enkele fysische effecten die onderwaterfoto's verpesten ongedaan te maken en daarna het detectienetwerk te sturen zich te concentreren op de meest informatieve regio's en kleuren, levert de methode scherpere, betrouwbaardere omtrekken van vissen, koraal en kunstmatige structuren. Dit kan autonome onderwatervoertuigen helpen veilig te navigeren, kwetsbare mariene ecosystemen te monitoren en kritieke onderzeese infrastructuur te inspecteren zonder menselijke tussenkomst. Uitdagingen blijven bestaan in extreem modderig water of zeer diepe, roodlicht‑arme scènes, maar het raamwerk biedt een praktische stap richting robuuste, realtime onderwatervisie die toekomstige 3D‑mapping en multisensorische verkenning van de oceaan kan ondersteunen.

Bronvermelding: Deluxni, N., Sudhakaran, P., Alroobaea, R. et al. An accurate realtime underwater object segmentation using improved dual-domain YOLOv11-UOS with physics guided adaptive enhancement and attention-boosting. Sci Rep 16, 4804 (2026). https://doi.org/10.1038/s41598-026-35001-x

Trefwoorden: onderwatervisie, mariene robotica, beeldverbetering, objectsegmentatie, computer vision