Clear Sky Science · nl

Onderzoek naar de menselijke afhankelijkheid van kunstmatige intelligentie bij besluitvorming

Waarom ons vertrouwen in slimme machines ertoe doet

Van filmaanbevelingen tot sollicitatiescreening en strafrecht: kunstmatige intelligentie (AI) helpt mensen steeds vaker bij het nemen van beslissingen. Velen van ons gaan ervan uit dat computers minder vooringenomen en nauwkeuriger zijn dan mensen. Maar wat gebeurt er eigenlijk wanneer mensen advies krijgen van een AI-systeem—gebruiken ze het verstandig, of leunen ze er te zwaar op? Deze studie onderzoekt hoe mensen reageren op advies van AI vergeleken met advies van andere mensen, en wat dat betekent voor de groeiende rol van AI in alledaagse beslissingen.

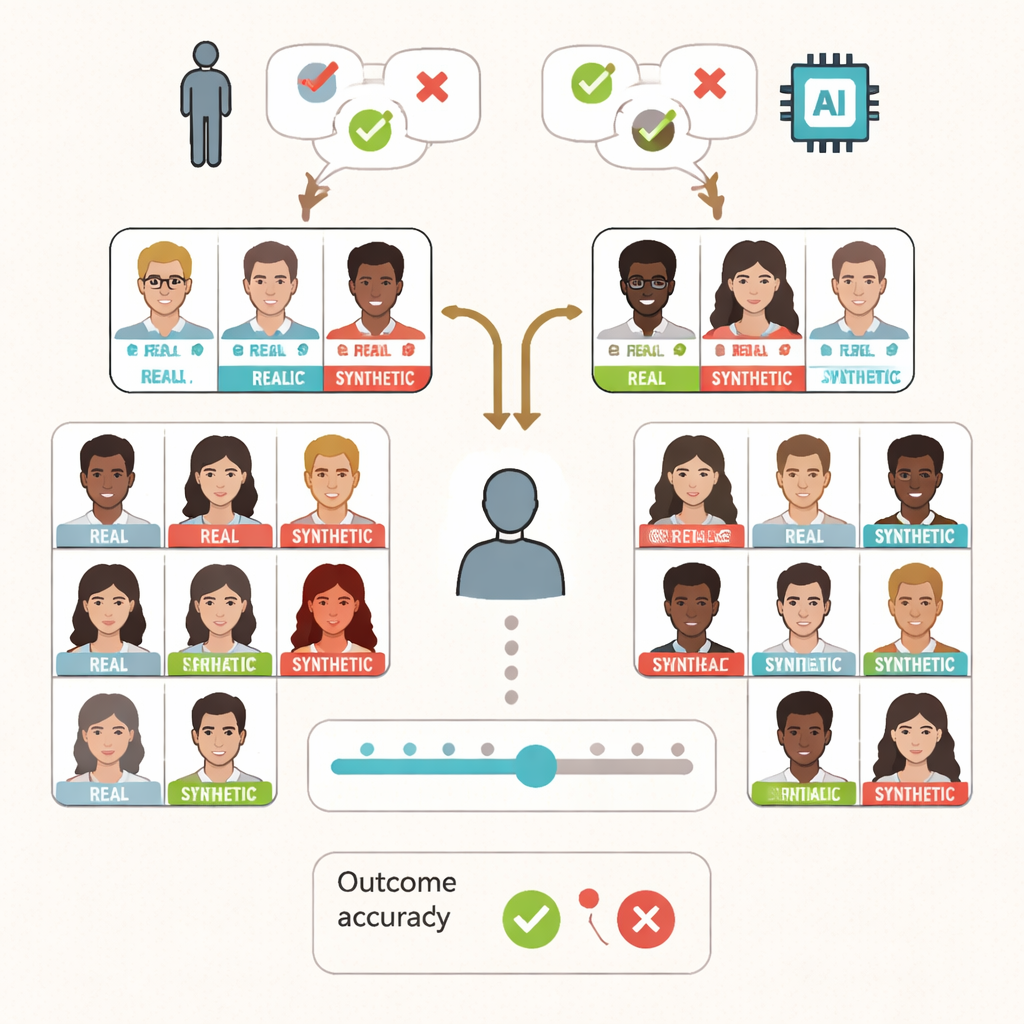

Testen van echte mensen met echte en nepgezichten

De onderzoekers vroegen 295 volwassenen een ogenschijnlijk eenvoudige taak uit te voeren: beslissen of een gezicht op een scherm een foto van een echt persoon was of een door AI gegenereerde nepper. Elke deelnemer zag 80 gezichten—de helft echt, de helft synthetisch—die zorgvuldig waren geselecteerd uit eerder onderzoek zodat de meeste mensen ze grotendeels goed konden beoordelen, maar niet perfect. Naast elk gezicht kregen deelnemers een kort advies te zien dat zei of het gezicht “echt” of “synthetisch” was. Ze kregen te horen dat dit advies afkomstig was van een groep menselijke experts of van een AI-systeem, hoewel in werkelijkheid alle adviezen vooraf geprogrammeerd waren en slechts de helft van de tijd correct.

Advies gebruiken, maar niet blindelings

De centrale vraag was of mensen het advies simpelweg zouden opvolgen of zelf zouden nadenken. De resultaten tonen dat deelnemers zich niet gedroegen als passieve knopindrukkers. Ze volgden het advies veel vaker wanneer het toevallig correct was en negeerden het eerder wanneer het onjuist was, ongeacht of het zogenaamd van mensen of AI kwam. De algehele nauwkeurigheid bij het onderscheiden van echte en synthetische gezichten bleef rond twee derde goed—zeer vergelijkbaar met een aparte groep uit eerder onderzoek die dezelfde taak zonder enig advies uitvoerde. Met andere woorden: de aanwezigheid van een AI-“helper” verbeterde of verslechterde de prestatie gemiddeld gezien niet dramatisch.

Wanneer positieve houdingen ten opzichte van AI averechts werken

Achter deze gemiddelden verscheen echter een subtieler patroon. De deelnemers vulden ook vragenlijsten in over hoeveel ze in het algemeen andere mensen vertrouwen en hoe ze over AI denken. Degenen met een positievere houding ten opzichte van AI werden feitelijk slechter in het onderscheiden van echt en nep wanneer ze AI-advies ontvingen. Zij konden genuanceerd echte van synthetische gezichten te onderscheiden minder goed dan deelnemers met voorzichtiger of negatievere opvattingen over AI. Dit effect trad niet op wanneer mensen dachten dat hun advies van mensen kwam, wat suggereert dat AI-advies ons besluitvormingsproces op unieke wijze kan vormen en soms kan vervormen. De studie vond ook dat mensen die aangaven altijd op het advies te vertrouwen slechter presteerden dan zij die zeiden het slechts soms of helemaal niet te gebruiken.

Mensen blijven de beslissende factor

De onderzoekers onderzochten verder hoe mensen hun eigen oordeel af wogen tegen het advies. Gemiddeld lieten deelnemers een bias zien om gezichten als echt te labelen, en die bias nam iets toe bij degenen die aangaven anderen mensen meer te vertrouwen. Toch leek de manier waarop mensen het advies gebruikten “strategisch”: ze leken er vooral een beroep op te doen wanneer ze minder zeker waren. Vertrouwensscores kwamen redelijk overeen met de prestaties—wanneer mensen zich zekerder voelden, waren ze over het algemeen nauwkeuriger—wat aangeeft dat deelnemers redelijk goed konden inschatten wanneer ze het juist of fout hadden, ook met AI in de lus.

Wat dit betekent voor alledaagse AI-hulpmiddelen

Voor een algemene lezer is de kernboodschap dat AI niet op magische wijze menselijke bias wegneemt, en ook niet automatisch ons oordeel overrompelt. Mensen behandelen AI-advies vaak op vergelijkbare wijze als menselijk advies en kunnen het negeren wanneer het onbruikbaar lijkt. Maar als iemand al erg positief over AI denkt, is die persoon wellicht geneigd er op een manier op te leunen die zijn nauwkeurigheid vermindert. Naarmate AI-systemen zich verspreiden naar kritieke domeinen zoals gezondheidszorg, beveiliging en rechtspraak, zullen ontwerpers en beleidsmakers deze menselijke neigingen moeten begrijpen. Deze studie suggereert dat effectief gebruik van AI niet alleen afhangt van betere algoritmen, maar ook van geïnformeerde mensen die weten wanneer ze de machine moeten vertrouwen—en wanneer ze op zichzelf moeten vertrouwen.

Bronvermelding: Pearson, J., Dror, I., Jayes, E. et al. Examining human reliance on artificial intelligence in decision making. Sci Rep 16, 5345 (2026). https://doi.org/10.1038/s41598-026-34983-y

Trefwoorden: kunstmatige intelligentie, menselijke besluitvorming, vertrouwen in AI, automatiseringsbias, deepfake gezichten