Clear Sky Science · nl

Beoordeling van de effectiviteit van de ZICOMP‑Shewhart-regelkaart voor het monitoren van zero-inflated processen

Waarom veel nullen nog steeds belangrijk zijn

Moderne fabrieken, ziekenhuizen en computersystemen doen hun werk vaak zo goed dat problemen zeldzaam zijn. Kwaliteitslogboeken kunnen lange periodes met perfecte eenheden laten zien—nul defecten—afgewisseld met af en toe een korte uitbarsting van problemen. Op het eerste gezicht lijkt dat goed nieuws, maar het maakt het in werkelijkheid moeilijker om te zien wanneer een proces stilletjes uit de hand loopt. Dit artikel pakt die uitdaging aan door een gespecialiseerd statistisch hulpmiddel te ontwikkelen en te testen—de ZICOMP‑Shewhart-regelkaart—ontworpen om processen te monitoren waar “niets gebeurt” het grootste deel van de tijd, maar niet altijd.

Kwaliteit in de tijd bekijken

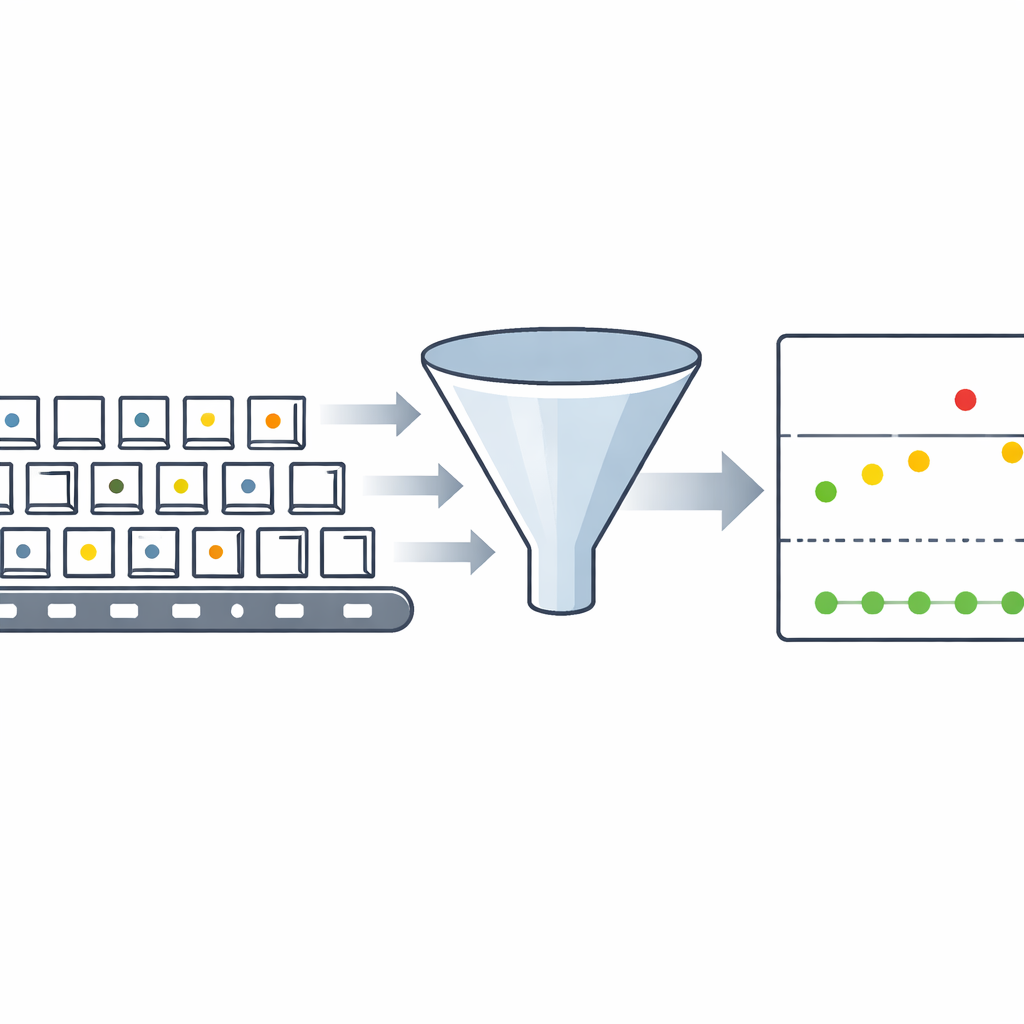

In kwaliteitscontrole gebruiken ingenieurs regelkaarten om te volgen hoe een proces zich in de loop van de tijd gedraagt. Elke nieuwe partij, elk item of elke periode wordt als een punt op de kaart samengevat. Zolang punten binnen de verwachte grenzen blijven, wordt het proces als stabiel beschouwd; wanneer ze een grens overschrijden, gaat er een alarm af en wordt het proces onderzocht. Traditionele kaarten werken goed wanneer het aantal defecten eenvoudige patronen volgt, zoals de bekende Poisson-verdeling. In veel moderne “high‑yield” processen—zoals de productie van harde schijven of foutbewaking in datacenters—zijn de meeste waarnemingen echter precies nul, met slechts enkele niet‑nul tellingen. Standaardmodellen onderschatten dit overschot aan nullen en schatten vaak de mate van variatie verkeerd in, wat belangrijke waarschuwingen kan vertragen of verhullen.

Nullen hun eigen model geven

De auteurs bouwen voort op een flexibele modelklasse, de Conway–Maxwell–Poisson (COMP)-verdeling, die data aankan die meer of minder variabel zijn dan in het klassieke Poisson‑geval. Ze breiden deze uit naar de zero‑inflated COMP (ZICOMP)-verdeling, die expliciet twee componenten scheidt: de kans dat een resultaat überhaupt nul is, en het patroon van niet‑nul tellingen wanneer er zich wel problemen voordoen. Dit stelt het model in staat zich aan te passen aan drie veelvoorkomende situaties: sterk variabele data met lange rechterstaarten, redelijk gebalanceerde data, en strak gecentreerde data met weinig spreiding. De ZICOMP‑Shewhart-regelkaart gebruikt deze rijkere beschrijving om een enkele bovenlimiet vast te stellen die is afgestemd op processen waarin nullen bijzonder vaak voorkomen.

Slimmere alarmgrenzen ontwerpen

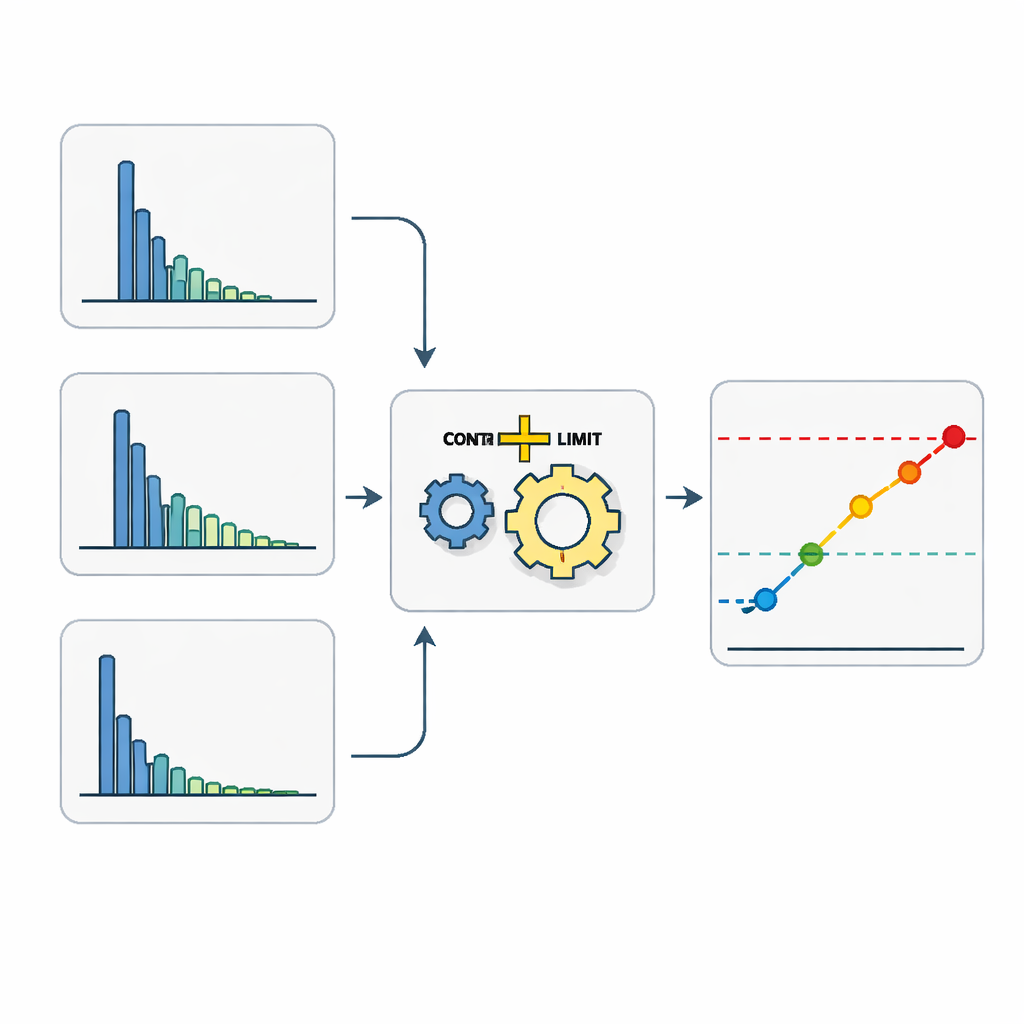

Een centrale vraag in de praktijk is hoe hoog de alarmlijn moet worden geplaatst. Als deze te laag is, roept de kaart onterecht wolf; als hij te hoog staat, worden echte problemen gemist. De auteurs gebruiken grootschalige computerexperimenten om te onderzoeken hoe een “grenscoëfficiënt” deze afweging regelt. Ze bestuderen twee belangrijke prestatiematen. De ene is de gemiddelde runlengte, het verwachte aantal monsters voordat de kaart signaliseert; dit weerspiegelt hoe vaak valse alarmen optreden wanneer het proces gezond is. De andere is de Type II‑fout, de kans dat de kaart niet signaleert wanneer het proces daadwerkelijk is verschoven. Door veel combinaties van modelparameters te doorlopen—voor verschillende niveaus van variabiliteit en verschillende hoeveelheden zero‑inflatie—laten ze zien hoe de grenscoëfficiënt gekozen kan worden om een gewenste gemiddelde runlengte te bereiken terwijl gemiste alarmen aanvaardbaar laag blijven, zelfs wanneer de discrete aard van de data perfecte afstemming onmogelijk maakt.

De methode op de proef stellen

Om te zien hoe hun kaart zich in realistische situaties gedraagt, vergelijken de auteurs deze met een concurrerend ontwerp dat geen speciale behandeling voor nullen aanneemt en alleen de COMP‑verdeling gebruikt. In meerdere gesimuleerde scenario’s vinden zij herhaaldelijk dat de ZICOMP‑Shewhart-kaart verschuivingen in het defectpercentage eerder en vaker detecteert, of de data nu sterk variabel, matig variabel of strak gecentreerd zijn. In een casestudy met echte foutgegevens van harde schijf lees‑schrijfoperaties—waar lange periodes van foutloze werking worden doorbroken door clusters van storingen—detecteert de nieuwe kaart succesvol een verandering na een reeks nullen gevolgd door hogere tellingen, wat aantont dat hij als vroegwaarschuwingssysteem kan dienen in omgevingen met hoge betrouwbaarheid.

Wat dit in de praktijk betekent

Voor praktijkmensen is de boodschap dat het negeren van de bijzondere rol van nullen belangrijke signalen over de toestand van een proces kan verbergen. Door een regelkaart te bouwen rond een model dat zowel extra nullen als afwijkende variatiepatronen herkent, geeft de ZICOMP‑Shewhart-kaart een betrouwbaarder beeld van wanneer een proces werkelijk afwijkt van het beoogde gedrag. Hoewel de prestatie nog steeds afhangt van hoe goed de onderliggende parameters worden geschat en toekomstig werk deze schattingen verder kan verfijnen, toont deze studie aan dat het afstemmen van statistische hulpmiddelen op de eigenaardigheden van echte data kwaliteitsbewaking gevoeliger, betrouwbaarder en uiteindelijk beter kan maken in het voorkomen van kostbare uitvallen.

Bronvermelding: Sattar, A., Raza, M.A., AL-Essa, L.A. et al. Assessing the effectiveness of the ZICOMP-Shewhart control chart for monitoring zero-inflated processes. Sci Rep 16, 8269 (2026). https://doi.org/10.1038/s41598-025-32581-y

Trefwoorden: zero-inflated telgegevens, statistische procescontrole, kwaliteitscontrolekaarten, Conway-Maxwell-Poisson, productiefouten