Clear Sky Science · nl

Detectie van gecamoufleerde objecten via context- en textuurbewuste hiërarchische interactie

Waarom het opsporen van verborgen vormen ertoe doet

Van bladkleurige insecten tot militaire camouflage en zelfs moeilijk te zien gezwellen in medische scans: onze wereld zit vol objecten die zijn ontworpen om in de achtergrond op te gaan. Computers leren om deze verborgen objecten betrouwbaar te vinden kan helpen bij het beschermen van wilde dieren, het verbeteren van veiligheidsinspecties en het ondersteunen van artsen bij het eerder opsporen van ziekte. Dit artikel presenteert een nieuw kunstmatig-intelligentiesysteem, CTHINet, dat leert door camouflage heen te kijken door niet alleen aandacht te besteden aan de algemene context van de scène, maar ook aan fijne textuursignalen die het menselijk oog vaak mist.

Het bos en de bomen zien

Detectie van gecamoufleerde objecten is veel moeilijker dan gewone objectdetectie omdat het doelobject vaak qua kleur, helderheid en vorm overeenkomt met de omgeving. Vroegere computermethoden vertrouwden op eenvoudige handgemaakte aanwijzingen zoals beweging, randen of basistekstuur, die tekortschieten in rommelige of ruisige scènes. Moderne deep-learningbenaderingen hebben vooruitgang geboekt door grote netwerken te trainen op gespecialiseerde beeldverzamelingen van gecamoufleerde dieren en door mensen gemaakte objecten. Veel van deze methoden voegen extra hints toe, zoals het trekken van grenzen rond objecten of het schatten van onzekerheid, maar ze kunnen gemakkelijk worden misleid wanneer die randen zelf vaag of dubbelzinnig zijn — precies het geval bij goede camouflage.

Kleine textuursignalen die het verklappen

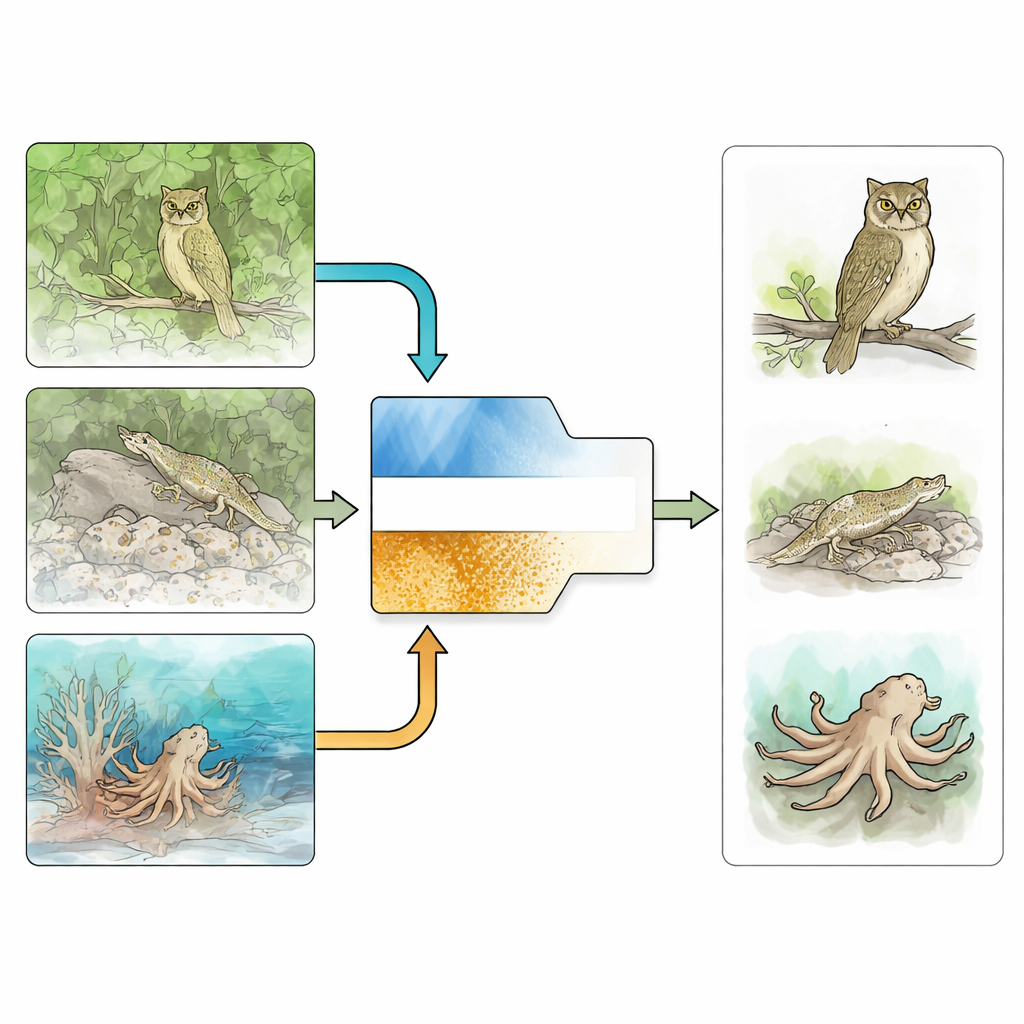

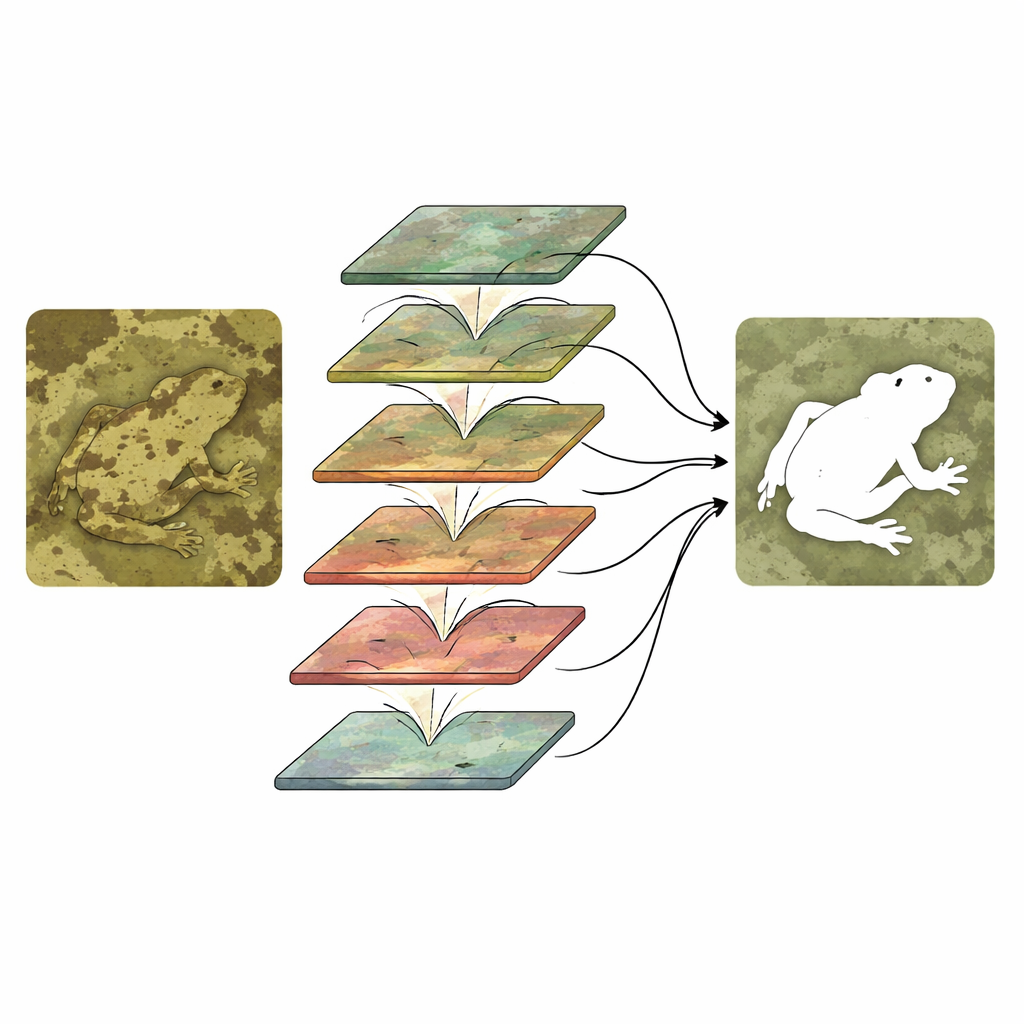

De auteurs betogen dat zelfs de beste camouflage sporen nalaat in de fijne textuur van een afbeelding — kleine verschillen in korrel, patroon of gladheid die gemakkelijk over het hoofd worden gezien wanneer men zich alleen op omtrekken richt. Voortbouwend op dit idee scheidt CTHINet het leren in twee gecoördineerde takken. Een “context”-tak, gebaseerd op een krachtige vision transformer-backbone, legt brede, multiscale-informatie vast over de hele scène: hoe regio’s zich tot elkaar verhouden, waar grote vormen liggen en welke gebieden aannemelijk een object kunnen bevatten. Parallel daaraan richt een speciale “textuur”-tak zich nauw op subtiele oppervlaktpatronen, getraind met speciale textuurlabels die het netwerk vertellen welke soorten fijne details bij het verborgen object horen in plaats van bij de achtergrond.

Hoe de twee takken samenwerken

Het is niet genoeg om simpelweg twee takken te draaien; ze moeten op een slimme manier interacteren. CTHINet verfijnt eerst de contextfeatures met een Multi-head Feature Aggregation Module. Deze module splitst de informatie in meerdere delen, elk verwerkt met een ander effectief “zoomniveau”, zodat het systeem kan reageren op zowel piepkleine insecten als grote dieren. Vervolgens recombineert het deze gezichtspunten zodat ze elkaar informeren zonder de rekencapaciteit te laten exploderen. Daarna koppelen een reeks Hierarchical Mixed-scale Interaction Modules de context- en textuurstromen. Op elk stadium groepeert en mengt het netwerk kanalen uit beide takken, laat ze informatie uitwisselen en weegt ze daarna opnieuw zodat de meest informatieve combinaties worden versterkt terwijl minder nuttige worden onderdrukt. Deze grof-naar-fijn opeenstapeling verscherpt geleidelijk de omtrek van een verborgen object en scheidt het van afleidende achtergronddetails.

Bewijzen dat het werkt in de natuur en de kliniek

Om CTHINet te testen, evalueerden de onderzoekers het op drie uitdagende openbare benchmarks van gecamoufleerde dieren en objecten, met duizenden beelden in gevarieerde natuurlijke omgevingen. Over meerdere standaardnauwkeurigheidsmaten presteerde de nieuwe methode consequent beter dan meer dan twintig toonaangevende systemen, met name in moeilijke scènes met kleine doelen, sterke achtergrondovereenstemming of gedeeltelijke occlusie. Het team probeerde hetzelfde netwerk, met minimale wijzigingen, ook op een medische taak: het segmenteren van poliepen in colonoscopiebeelden. Poliepen lopen vaak in elkaar over met de darmwand op een vergelijkbare manier als dieren met loof. Ook hier leverde CTHINet de beste resultaten onder verschillende sterke medische-beeldmodellen, wat suggereert dat de manier waarop context en textuur worden gecombineerd breed toepasbaar is.

Wat dit betekent voor het vinden van het bijna onzichtbare

In gewone bewoordingen belichaamt CTHINet een eenvoudige maar krachtige inzicht: om iets te vinden dat bedoeld is om verborgen te blijven, moet een computer zowel het grote geheel als de fijnste oppervlaktekenmerken bekijken en deze twee gezichtspunten stap voor stap elkaar laten informeren. Door een netwerk te ontwerpen dat deze rollen helder scheidt en ze vervolgens verenigt via zorgvuldig gefaseerde interacties, bereiken de auteurs een nauwkeurigere detectie van gecamoufleerde doelen en tonen ze veelbelovende resultaten voor medische en industriële inspectietaken waarin belangrijke structuren gemakkelijk over het hoofd worden gezien. Naarmate beeldgegevens blijven groeien, kunnen dergelijke context- en textuurbewuste systemen sleuteltools worden om te onthullen wat bedoeld was onzichtbaar te blijven.

Bronvermelding: Wang, Z., Deng, Y., Shen, C. et al. Camouflaged object detection via context and texture-aware hierarchical interaction. Sci Rep 16, 9328 (2026). https://doi.org/10.1038/s41598-025-32409-9

Trefwoorden: detectie van gecamoufleerde objecten, computer vision, textuuranalyse, medische beeldsegmentatie, deep learning