Clear Sky Science · nl

Multi-TPC: Een multimodaal dataset voor driepartijgesprekken met spraak, beweging en blik

Waarom hoe we bewegen en kijken tijdens het spreken ertoe doet

Wanneer mensen face-to-face praten, wisselen ze veel meer uit dan alleen woorden. We leunen naar voren, knikken, werpen blikjes naar elkaar en pauzeren op precies de juiste momenten. Deze subtiele bewegingen worden nog belangrijker wanneer drie mensen tegelijk praten, omdat aandacht en spreektijden voortdurend verschuiven. Tot nu toe was er echter weinig hoogwaardige data beschikbaar die laat zien hoe spraak, lichaamsbeweging en oogbeweging samenwerken in gesprekken in kleine groepen. Dit artikel introduceert een nieuw dataset dat bedoeld is om die leemte op te vullen en te helpen bij het bouwen van natuurlijkere virtuele assistenten, sociale robots en instrumenten voor het bestuderen van alledaagse menselijke interactie.

Een nieuw venster op driepersoonsgesprekken

De auteurs presenteren Multi-TPC, een openbaar beschikbare verzameling van driepersoonsgesprekken opgenomen in een laboratorium met motion capture, oogtrackers en individuele microfoons. In tegenstelling tot veel eerdere bronnen die zich richten op één spreker of op gesprekken tussen slechts twee mensen, legt Multi-TPC spontane discussies vast tussen drie vreemden die in een driehoek staan en over elk onderwerp mogen praten. Meer dan 5,3 uur aan opnames van 21 jongvolwassen deelnemers zijn opgenomen, verdeeld over 24 sessies. Voor elk moment in deze gesprekken biedt de dataset gedetailleerde informatie over hoe iedere persoon spreekt, zijn lichaam beweegt en waar hij of zij hun blik op richt.

Hoe de gesprekken werden vastgelegd

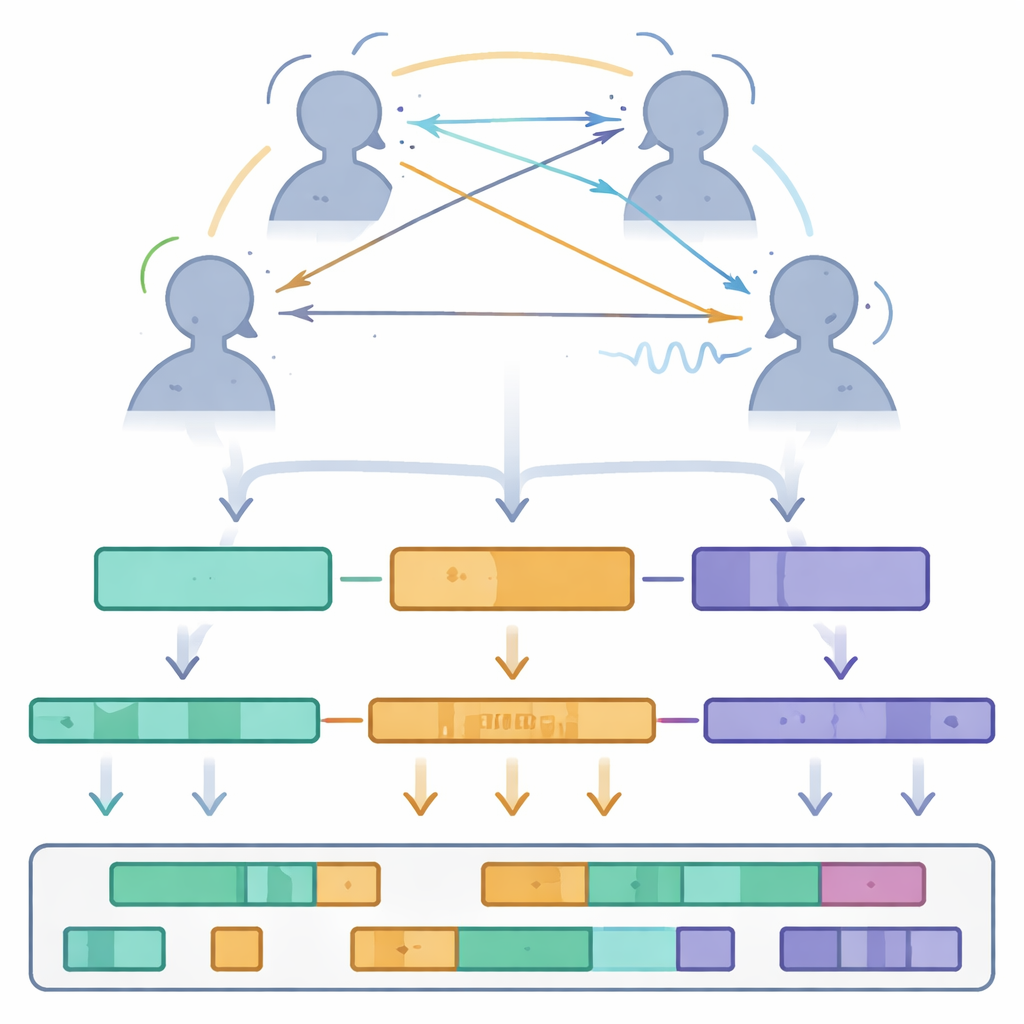

Om dit dataset samen te stellen, bouwde het team een hybride opnameopstelling. Elke deelnemer droeg een full-body motion capture-pak met reflecterende markers zodat een array van acht camera’s hun houding, hoofdbewegingen en gebaren in drie dimensies kon volgen. Lichtgewicht oogvolgglazen, vergelijkbaar in gevoel met gewone brillen, maten waar iedere persoon naar keek in hun gezichtsveld. Draadloze microfoons geklemd bij de hals namen de stem van elke spreker op een afzonderlijke audiotrack op. Voorafgaand aan de opname werden deelnemers in het systeem gekalibreerd en geïnstrueerd om op vaste plekken te blijven die een gelijkzijdige driehoek vormden van ongeveer een meter afstand. Een klapbord, zichtbaar voor de camera’s, de oogtrackers en de microfoons, leverde een precies cue om alle apparaten in de tijd te alignen, zodat beweging, blik en spraak frame voor frame konden worden gekoppeld.

Opschonen, organiseren en verrijken van de data

Het verzamelen van ruwe signalen was slechts de eerste stap. De onderzoekers verwerkten de bewegingsdata zorgvuldig, labelden alle markers en vulden kleine gaten op met wiskundige interpolatie terwijl ze de nabijgelegen markerposities kruiscontroleerden. Audioregistraties werden schoongemaakt met ruisonderdrukkingsmethoden en vervolgens ingevoerd in spraakherkenningssoftware om woord-voor-woord transcripties te produceren, die later handmatig werden gecorrigeerd. Blikpunten gemeten in camera-pixels werden omgezet in 3D-hoeken die laten zien waar ieder persoon naar keek in de ruimte. Alle signalen werden teruggesampled naar 60 frames per seconde en gesynchroniseerd, en daarna opgeslagen in eenvoudige, open formaten. De einddataset is georganiseerd per modaliteit — beweging, blik, audio, woorden en prosodische kenmerken zoals luidheid en toonhoogte — met duidelijke naamgevingsregels zodat onderzoekers elk moment in de tijd gemakkelijk over alle drie de deelnemers kunnen terugvinden.

Wat het dataset onthult over groepsgesprekken

Met Multi-TPC voerden de auteurs een eerste statistische verkenning uit van hoe driepersoonsgesprekken zich ontvouwen. Ze maten spreektijden en stiltes en vonden dat een typische spreektijd ongeveer 2,7 seconden duurt, gescheiden door pauzes van net iets meer dan één seconde. Ze onderzochten ook hoofdknikken en -schudden als een vorm van luisterfeedback, en detecteerden gemiddeld ongeveer een kwart knik of schud per seconde — bewijs dat luisteraars voortdurend aandacht en houding signaleren zonder een woord te zeggen. Blikanalyse toonde aan dat mensen zelden langdurig direct op iemands gezicht gefixeerd zijn. In plaats daarvan kijken ze vaak iets weg, en hun blikpatronen verschuiven afhankelijk van wie praat, of er een pauze is, of er meer dan één persoon tegelijk spreekt. Tijdens overlappende spraak wordt de blik van deelnemers meer gelijkmatig verspreid of dwaalt af van beide gesprekspartners, wat wijst op onzekerheid over wie de conversatievloer beheerst.

Waarom deze bron belangrijk is voor toekomstige technologie

Door al deze informatielagen te verpakken in een goed gedocumenteerde, deelbare dataset, biedt Multi-TPC een nieuwe basis voor het bestuderen van hoe kleine groepen beurtwisseling, aandacht en feedback beheren via zowel woorden als beweging. Voor algemene lezers is de conclusie dat de dans van het gesprek — wie wanneer spreekt, wie waar naar kijkt en hoe subtiele knikjes de stroom vormen — nu tot in detail is vastgelegd. Voor wetenschappers en ontwikkelaars opent dit de deur naar het bouwen van virtuele personages en sociale robots die in groepssituaties meer als echte mensen reageren, en tot diepgaandere studies over hoe we via stem, lichaam en blik met elkaar coördineren.

Bronvermelding: Lee, MC., Deng, Z. Multi-TPC: A Multimodal Dataset for Three-Party Conversations with Speech, Motion, and Gaze. Sci Data 13, 429 (2026). https://doi.org/10.1038/s41597-026-06819-x

Trefwoorden: multimodale conversatie, gebaar en blik, dataset sociale interactie, beurtwisseling, virtuele agenten